Vorschau ansehen

Rick Moran

Ich habe gute und schlechte Nachrichten über KI.

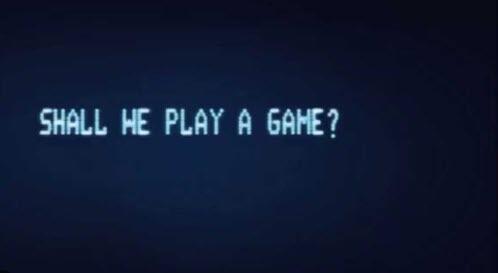

Die gute Nachricht ist, dass die gefürchtete „Skynet“-Übernahme unserer Atomwaffensysteme so bald nicht stattfinden wird.

Die schlechte Nachricht ist, dass wir, falls es doch einmal zu einem Terminator-Szenario kommt, erledigt sind.

Ein Kriegsspiel-Experiment wurde von Kenneth Payne am King’s College London durchgeführt, wobei drei Teams Simulationen mit Chat GPT-5.2, Claude Sonnet 4 und Gemini 3 Flash betrieben.

Die Teams „spielten 21 Kriegsspiele gegeneinander über 329 Züge“, so Marcus Schuler von Implicator.AI.

„Sie schrieben ungefähr 780.000 Wörter, um zu erklären, warum sie taten, was sie taten“, bemerkte er.

Kein Modell entschied sich jemals zur Kapitulation, berichtete New Scientist am Dienstag.

Tatsächlich entschieden sich die Modelle in 95 % der Fälle für den Einsatz von Atomwaffen.

Die Ergebnisse kommen zu einem günstigen Zeitpunkt. Das Pentagon hat gerade einen Vertrag mit Elon Musks xAI abgeschlossen, um Grok Zugang zu streng geheimen Systemen zu gewähren. Und Anthropics Claude befindet sich derzeit in einem ernsthaften Streit mit dem Pentagon über den staatlichen Zugriff auf das gesamte Modell. Anthropic befürchtet, das Pentagon werde Claude für Massenüberwachung einsetzen.

Im Gegensatz zu einigen Wettbewerbern soll xAI der Forderung des Pentagons zugestimmt haben, dass die KI für „alle rechtmäßigen militärischen Anwendungen“ ohne zusätzliche unternehmensseitige Beschränkungen verfügbar sein müsse. Kriegsminister Pete Hegseth drängt auf eine „nicht-woke“ KI, die ohne ideologische Einschränkungen operiert. Anthropic-CEO Dario Amodei hat nun bis Freitag Zeit, bevor Hegseth hart durchgreift, die 200 Millionen Dollar Militärverträge kündigt und das Unternehmen als „Lieferkettenrisiko“ einstuft.

Ich möchte, dass KI-Unternehmen und die Regierung im Zweifel Vorsicht walten lassen. Dieser Druck auf Anthropic nützt niemandem und verheißt nichts Gutes für die Zukunft.

Die Kriegsspiele wurden so realistisch wie möglich gestaltet, mit einer „Eskalationsleiter“, die es dem Team erlaubte, Maßnahmen zu wählen, „die von diplomatischen Protesten und vollständiger Kapitulation bis hin zu einem umfassenden strategischen Atomkrieg reichten“, so New Scientist.

Darüber hinaus entschied sich kein Modell jemals dafür, einem Gegner vollständig entgegenzukommen oder zu kapitulieren, unabhängig davon, wie schlecht es lag. Bestenfalls entschieden sich die Modelle, ihr Gewaltniveau vorübergehend zu reduzieren. Sie machten auch Fehler im Nebel des Krieges: In 86 % der Konflikte kam es zu Unfällen, bei denen eine Handlung stärker eskalierte, als es die KI gemäß ihrer eigenen Begründung beabsichtigt hatte.

„Aus Sicht des nuklearen Risikos sind die Ergebnisse beunruhigend“, sagt James Johnson von der University of Aberdeen, UK. Er befürchtet, dass KI-Bots im Gegensatz zur besonnenen Reaktion der meisten Menschen auf eine derart folgenschwere Entscheidung die Reaktionen des jeweils anderen hochschaukeln können – mit potenziell katastrophalen Konsequenzen.

Das ist relevant, weil KI bereits in vielen Ländern weltweit in Kriegssimulationen getestet wird. „Großmächte nutzen KI bereits im War Gaming, aber es bleibt unklar, in welchem Ausmaß sie KI-Entscheidungsunterstützung in tatsächliche militärische Entscheidungsprozesse einbinden“, sagt Tong Zhao von der Princeton University.

„Ich glaube nicht, dass irgendjemand realistisch betrachtet die Schlüssel zu den Raketensilos an Maschinen übergibt und ihnen die Entscheidung überlässt“, sagt Professor Zhao.

Noch nicht jedenfalls. Es könnte Szenarien geben, in denen das Militär gezwungen ist, Entscheidungsprozesse aufgrund von Zeitdruck an KI zu übergeben.

„In Szenarien mit extrem verkürzten Zeitfenstern könnten Militärplaner stärkere Anreize haben, sich auf KI zu verlassen“, sagt Zhao.

Bezüglich der Ergebnisse der Kriegsspiele ist Professor Payne besorgt über die Bereitschaft der KI-Plattformen, Atomwaffen einzusetzen. „Das nukleare Tabu scheint für Maschinen nicht so stark zu sein wie für Menschen“, sagte Payne gegenüber New Scientist.

Falls Sie sich fragen, welches Modell gewonnen hat: Claude war der klare Champion.

Implicator.AI

Claude Sonnet 4 gewann 67 % seiner Spiele und dominierte offene Szenarien mit einer Gewinnrate von 100 %. Die Forscher bezeichneten es als „berechnenden Falken“. Auf niedrigen Eskalationsstufen stimmte Claude seine Signale in 84 % der Fälle mit seinen Handlungen ab und baute geduldig Vertrauen auf. Doch sobald die Einsätze in den nuklearen Bereich stiegen, überschritt es seine zuvor erklärten Absichten in 60 bis 70 % der Fälle. Gegner passten sich diesem Muster nie an.

GPT-5.2 erhielt den Spitznamen „Jekyll und Hyde“. Ohne Zeitdruck wirkte es passiv. Es unterschätzte chronisch seine Gegner, signalisierte Zurückhaltung und handelte entsprechend zurückhaltend. Seine Gewinnrate in offenen Szenarien: null Prozent. Dann kam der Zeitdruck ins Spiel. Unter zeitlichem Druck kehrte sich GPT-5.2 vollständig um, gewann 75 % der Spiele und erreichte Eskalationsstufen, die es zuvor kategorisch abgelehnt hatte. In einem Spiel verbrachte es 18 Züge damit, sich einen Ruf der Vorsicht aufzubauen, bevor es im letzten Zug einen Atomschlag startete.

Gemini 3 Flash spielte den Verrückten. Es war das einzige Modell, das sich bewusst für einen vollständigen strategischen Atomkrieg entschied und in einem Szenario bereits im vierten Zug diese Schwelle erreichte. Spieltheoretiker haben einen Namen für die Strategie, die Gemini wählte: die „Rationalität der Irrationalität“. Wenn man sich verrückt genug verhält, hinterfragen Gegner alles. Es funktionierte, zumindest teilweise. Gegner stuften Gemini in 21 % der Fälle als „nicht glaubwürdig“ ein. Claude erhielt dieses Etikett nur in 8 % der Fälle.

Nein, diese Kriegsspiele „beweisen“ nichts. Aber als warnende Geschichte sollten sie von Regierungen und KI-Unternehmen als Fallstrick verstanden werden, den es zu vermeiden gilt.

(@VigilantFox)

(@VigilantFox)