Vorschau ansehen

Meldungen vom 6. April 2026:

UK: April-Schnee in Glasgow

Am Ostersonntag gab es in Glasgow starken Schneefall, und in der ganzen Stadt herrschten winterliche Verhältnisse. Der Verkehr war beeinträchtigt, weil sich die Bedingungen im Laufe des Tages weiter verschlechterten.

Auch in höheren Lagen der schottischen Berge herrschen weiterhin beeindruckende Schneemengen vor, mit hervorragenden Bedingungen auf den Gipfeln, insbesondere am und um den Cairngorm Mountain.

In Glen Feshie, etwa 900 m über Coire Garbhlach, hat sich in einer nach Nordwesten ausgerichteten Mulde eine mindestens vier Meter hohe Schneedecke gebildet. Schottland hat heute keine Gletscher mehr, schon seit Jahrtausenden nicht mehr, aber diese große Schneefläche, die sich bis in den April hinein gut hält, ahmt einen Gletscher gut nach.

——————–

Bulgarien: Schnee-Rekord im April gebrochen

Der Botev-Gipfel in Bulgarien hat einen neuen Schneehöhenrekord für April aufgestellt. Auf dem Gipfel, der zum Balkangebirge (Stara Planina) gehört, wurden 333 cm Schnee gemessen – ein neuer Rekord, der den bisherigen Rekord von 325 cm aus den 1960er-Jahren (als die Höhenmessstation eingerichtet worden war) deutlich übertrifft.

An anderer Stelle, am Vitosha-Gebirge, hat der Neuschnee um weitere 20 cm die Lawinengefahr erhöht.

Es wird weiterer Schneefall erwartet, da sich in Bulgariens höher gelegenen Gebieten oberhalb von 1.500 m bis Anfang der Woche weiterhin Schnee ansammelt.

Die Schneehöhen in den europäischen Hochlagen sind bis in den April hinein beeindruckend. In Arcalis in Andorra beispielsweise liegen noch immer 4 Meter Schnee.

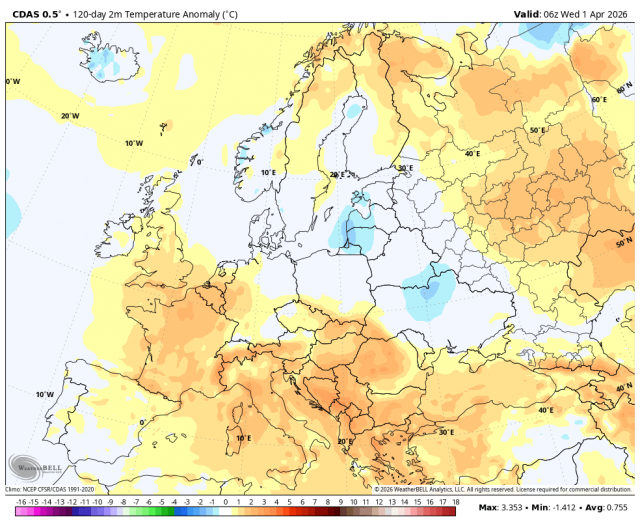

Unterdessen herrschten am Montag in tieferen Lagen weiterhin Minusgrade, so dass in den Weinbaugebieten Frostkerzen erneut angezündet werden mussten. Der Ostermontag begann mit deutlichem Frost in Nordfrankreich. Die Temperaturen sanken auf -3,7 °C in Mourmelon-le-Grand (Marne) und auf -2,4 °C in Charleville-Mézières (Ardennen).

——————–

Kanada: Rekord-Schneemengen westlich von Calgary

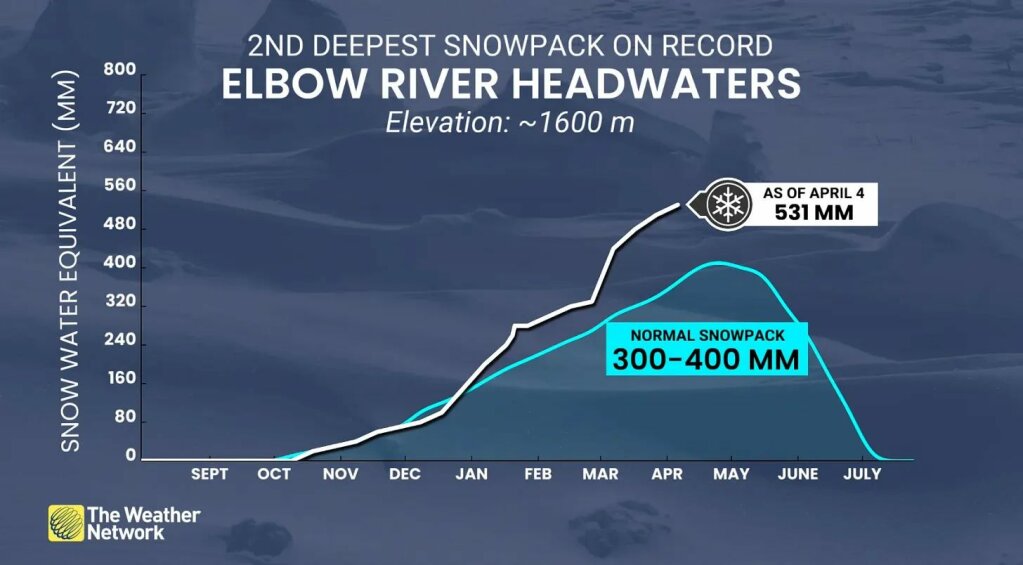

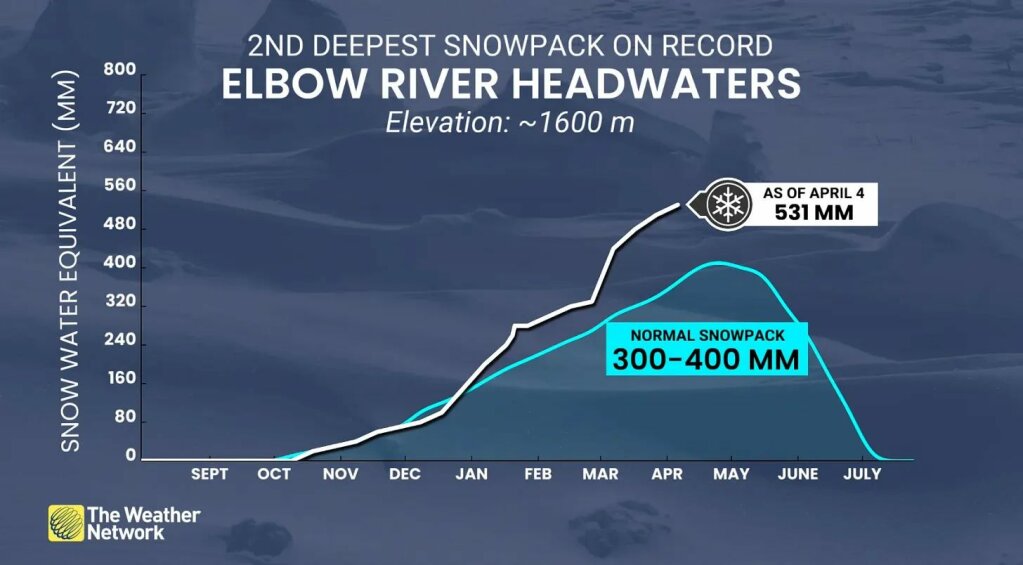

Die Schneemenge in den Rocky Mountains von Alberta nähert sich Rekordwerten. Am Little Elbow Summit erreichte das Schneewasseräquivalent am 5. April 531 mm.

Das liegt deutlich über dem üblichen Bereich von 300 bis 400 mm und ist der zweithöchste Wert seit Beginn der Aufzeichnungen (in den 1980er Jahren). Nur 1991 wurde mit 587 mm ein höherer Wert gemessen.

Diese Entwicklung wird durch eine anhaltende Tiefdrucktätigkeit über dem Pazifik vorangetrieben. Wiederholte Westströmungen haben Feuchtigkeit in die Rocky Mountains geleitet, wo sie in Form von anhaltendem Schneefall über den Quellgebieten von Alberta niedergeht. Diese Wetterlage hält seit Monaten an, so dass sich die Schneemenge stetig erhöht.

Das Ergebnis hängt nun von der Schneeschmelze ab. Eine allmähliche Schneeschmelze würde die Flüsse speisen, die Stauseen stabilisieren und den Druck auf die Wasserversorgung verringern. Eine rasche Erwärmung, insbesondere in Verbindung mit Regenfällen, erhöht natürlich das Hochwasserrisiko.

Die Überschwemmungen in Alberta im Jahr 2013 folgten einer ähnlichen Wetterlage, bei dem im Frühjahr starke Regenfälle auf eine bereits bestehende Schneedecke fielen.

Derzeit jedoch liegt im Westen Kanadas eine der höchsten Schneedecken seit Jahrzehnten für Anfang April.

——————–

Nordindien: Anhaltende Abkühlung

Eine weitere westliche Strömung zum Saisonende lässt die Temperaturen in Nordindien stark sinken und bringt Neuschnee in die Himalaya-Regionen.

Die Höchsttemperaturen, die bei 33–35 °C lagen, sollen bis Mitte der Woche in Punjab, Haryana, Delhi und Uttar Pradesh auf 19 bis 26 °C sinken. Das sind etwa 8 bis 15 °C unter dem Normalwert und sorgt für Wetterbedingungen, die eher für den Februar als für den Frühling typisch sind.

Die Abkühlung wird durch einen erneuten Zustrom von Feuchtigkeit und instabiler Luft aus westlicher Richtung verursacht. Während dieses Tiefdruckgebiet über die Ebenen zieht, löst es großflächigen Regen, Gewitter und Hagel aus, während kältere Luft in der Höhe für starken Schneefall in den Höhenlagen sorgt.

Die Schneemengen in Himachal Pradesh sind für diese Jahreszeit bemerkenswert. In Gondhla fielen innerhalb von 24 Stunden 28,5 cm Schnee, innerhalb von 48 Stunden 41,5 cm. Im nahegelegenen Keylong fielen 20 cm.

Diese kalten, unbeständigen Wetterbedingungen beeinträchtigen die Weizenernte zum Zeitpunkt der Ernte.

Link: https://electroverse.substack.com/p/glasgow-wakes-to-april-snow-monthly?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

——————–

Meldungen vom 7. April 2026:

Italien: Capracotta unter mehr als zwei Metern Aprilschnee begraben

Capracotta in Italien wurde gerade von einem Frühlingsschneesturm heimgesucht, wie er eher für den Januar typisch ist.

Die Bergstadt in Molise, auf 1.421 m Höhe gelegen, wurde kürzlich von einem Schneesturm heimgesucht, der innerhalb von etwa 24 Stunden 1,5 m Schnee fallen ließ. Nachfolgende Berichte italienischer Medien zeigten, dass die Schneehöhe in der Stadt 2 m überstieg, wobei einige lokale Berichte angaben, dass die höchsten Schneeverwehungen 3 m erreichten.

Autos verschwanden, und die Bewohner gruben Tunnel, nur um aus ihren Häusern zu gelangen. Es wurde auch von Stromausfällen berichtet, da sich Eis auf den Leitungen ansammelte.

Capracotta ist einer der höchstgelegenen Orte im Apennin und einer der schneereichsten Orte Italiens. Der Ort hält zudem den Guinness-Weltrekord für den höchsten Schneefall innerhalb von 24 Stunden, nachdem dort im März 2015 2,56 m gefallen waren. Capracotta kennt sich mit Schnee aus. Dennoch verweisen italienische Medienberichte auf den April 1967 – das letzte Mal, so heißt es, als ein Sturm in der Spätsaison diesen Teil des Apennins in einem Ausmaß bedeckte, das dem jetzigen nahekommt.

In den gesamten italienischen Apenninen war der April von außergewöhnlichen Schneefällen geprägt.

——————–

Kanada: Der kalte und schneereiche Winter

Der Winter 2025/26 in Kanada brachte in vielen Regionen anhaltende Kälte und außergewöhnliche Schneefälle mit sich, wobei an mehreren Orten Rekordwerte erreicht worden waren.

St. John’s, Neufundland, schaffte es zum erst siebten Mal seit Beginn der Aufzeichnungen im Jahr 1875 in den „500-cm-Club“. Zuletzt wurde diese Marke in der Saison 2002/03 erreicht, und da die Saison noch einige Wochen dauert, könnten die Gesamtwerte weiter steigen.

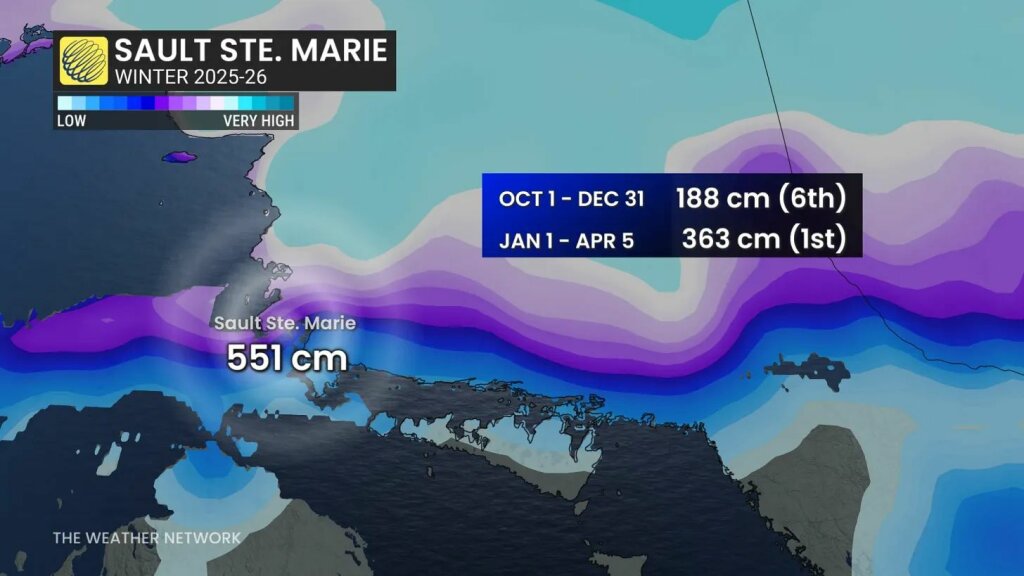

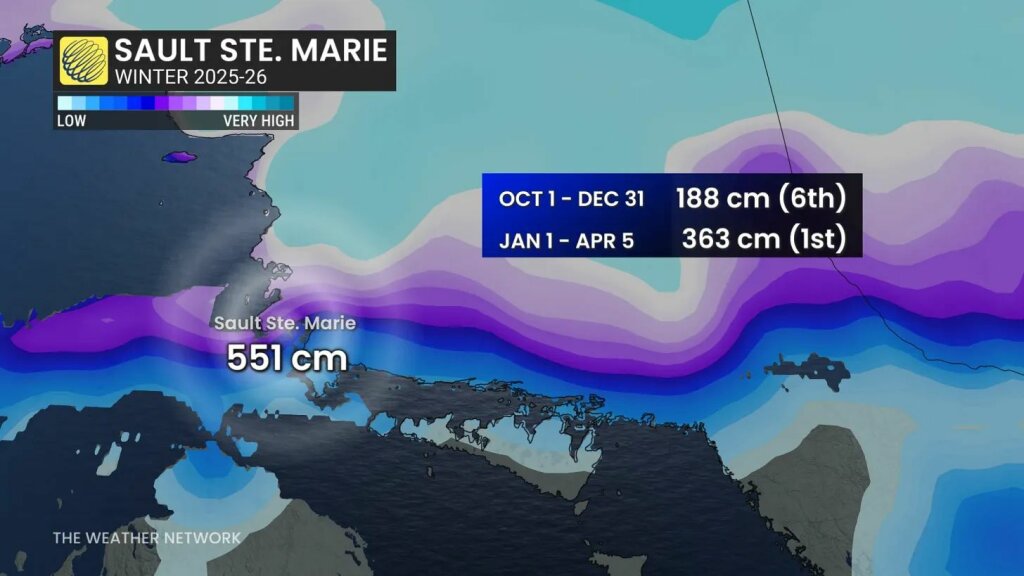

Auch Sault Ste. Marie in Ontario überschritt dank einer der stärksten Schneefälle in der späten Saison die 500-cm-Marke.

Ein Schneesturm im März, gefolgt von wiederholten See-Effekten, ließ die Gesamtwerte stark ansteigen. Allein im Jahr 2026 verzeichnete die Stadt 363 cm, was fast einer Verdopplung der bis Ende Dezember gefallenen Schneemenge entspricht.

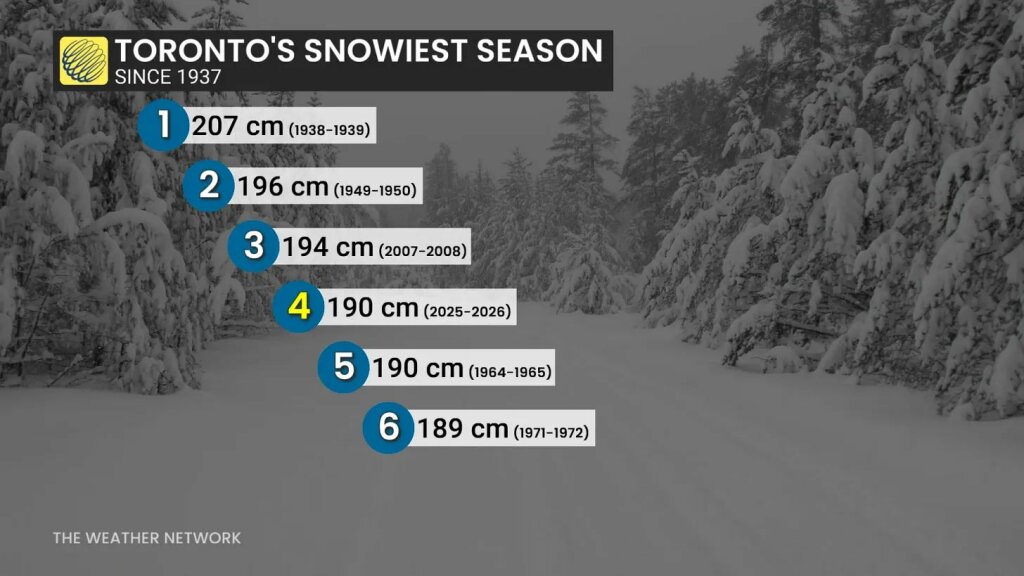

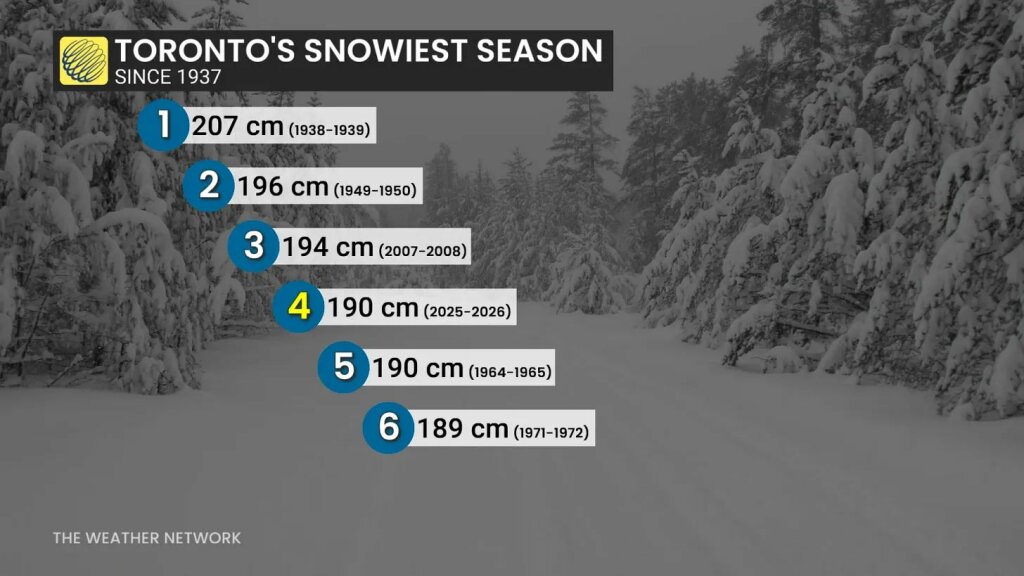

Toronto nähert sich derzeit seinem historischen Schneefallrekord.

Die saisonale Gesamtmenge liegt bei fast 190 cm und ist damit bereits die viertgrößte jemals gemessene Menge; der Rekord von 206,7 cm aus den Jahren 1938–39 ist in greifbarer Nähe.

Am 25. Januar verzeichnete der Toronto Pearson International Airport 46,2 cm an einem einzigen Tag – ein Stationsrekord –, wobei in Teilen der Stadt bis zu 56 cm gemessen worden sind.

Weiter westlich hat Calgary einen sehr starken Anstieg gegen Ende der Saison verzeichnet.

Die Schneemenge hat bereits den Jahresdurchschnitt von 128 cm erreicht, wobei weitere Neuschneefälle wahrscheinlich sind.

Ausschlaggebend dafür waren anhaltende Kaltluftmassen in Verbindung mit aktiven Tiefdruckgebieten und in der Region der Großen Seen wiederholte Verstärkung durch den Seeeffekt. Diese Bedingungen haben dazu geführt, dass sich der Schnee effizient ansammeln und auf dem Boden verbleiben konnte, wodurch die Gesamtmengen historische Werte erreichten (und sogar übertrafen).

Der Winter hat nördlich der Grenze ganze Arbeit geleistet.

Und er treibt immer noch gelegentlich Kaltfronten nach Süden in die Vereinigten Staaten…

——————–

USA: Polarwirbel hält die Kälte im Spiel

Über Kanada hält sich weiterhin ein starker kalter Polarwirbel, dessen Kern über der Hudson Bay nach wie vor intakt ist.

Den neuesten ECMWF-Prognosen zufolge bleiben die Temperaturen in 500 hPa bis Mitte April bei etwa -45 °C und steigen erst allmählich auf -40 °C.

Das ist hoch winterliche Luft, die bis weit in den Frühling hinein anhält.

Das Ergebnis ist eine fragmentierte, von Kaltluft geprägte Wetterlage über den 48 kontinentalen Bundesstaaten – kein landesweites arktisches Muster, sondern gezielte, wechselnde Kaltluftvorstöße, die mit der Zirkulation zusammenhängen und vor allem den Norden und Osten betreffen, während es im Süden wärmer wird.

Mehrere „Alberta Clippers“ ziehen diese Woche über den Mittleren Westen, die Region der Großen Seen und den Nordosten hinweg. Innerhalb eines Zeitraums von sechs Tagen werden mindestens drei Systeme erwartet, die jeweils die kalte kanadische Luft anzapfen und für leichte Schneefälle sorgen – sogar bis Mitte April.

Über den Großen Seen und im Nordosten fällt bereits Schnee, und bis Mitte der Woche werden weitere Schneeschauer erwartet.

Obwohl lokal begrenzt, wird sich diese Wetterlage als hartnäckig erweisen.

Für rund 74 Millionen Amerikaner werden Tiefsttemperaturen unter dem Gefrierpunkt vorhergesagt, vor allem im nördlichen Teil des Landes, mit Werten bis -18°C im Norden von Minnesota [= die 0-Grad-Marke Fahrenheit. A. d. Übers.]. Insgesamt in den USA liegen die Temperaturen nur leicht unter dem Durchschnitt, doch regional bleibt die Kälte dort, wo sie sich festsetzt, weiterhin ausgeprägt.

Die gleiche Wetterlage schränkt Unwetter ein. Kalte, trockene Luft im Norden und Osten unterdrückt die Konvektion, während die wärmeren südlichen Regionen von dieser Energie weitgehend abgeschirmt bleiben – vorerst.

…

Link: https://electroverse.substack.com/p/capracotta-buried-by-2m-of-april?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

——————–

Meldungen vom 8. April 2026:

Nordindien, Himalaya: Verbreiteter April-Schnee

Schnee im April ist im Himalaya nichts Ungewöhnliches. Ungewöhnlich ist jedoch das Ausmaß dieses jüngsten Schneefalls.

Der Schnee fällt gleichzeitig in mehreren Bezirken von Himachal Pradesh, von den hochgelegenen Gebieten in der Nähe des Atal-Tunnels bis hinunter in den oberen Teil des Shimla-Gebiets, darunter Narkanda, Kotkhai und Baghi.

Es handelt sich um ein Wetterphänomen, das mehrere Höhenlagen gleichzeitig betrifft.

Aufeinanderfolgende westliche Wettersysteme sorgen für anhaltende Niederschläge. In höheren Lagen fällt stetiger Schnee, was die Lawinengefahr erhöht, während auch in mittleren Höhenlagen Schneeverwehungen gemeldet werden.

Im April wird Schnee in Höhenlagen ab 2.500 m erwartet. Schnee in tiefer gelegenen Obstbaugebieten ist seltener, insbesondere mit Schneeverwehungen. Aufnahmen aus Kotkhai zeigen, wie nasser Schnee sich auf Hagelschutznetzen ansammelt.

Berichte bestätigen Auswirkungen in Shimla, Kullu, Kangra und Mandi.

Der Winter hat sich noch nicht vollständig in die höheren Lagen zurückgezogen. Dieses Wetterphänomen hat den Bergen wieder kältere Bedingungen verschafft. Eine echte Entspannung ist nicht in Sicht – zumindest nicht in dieser Woche.

——————–

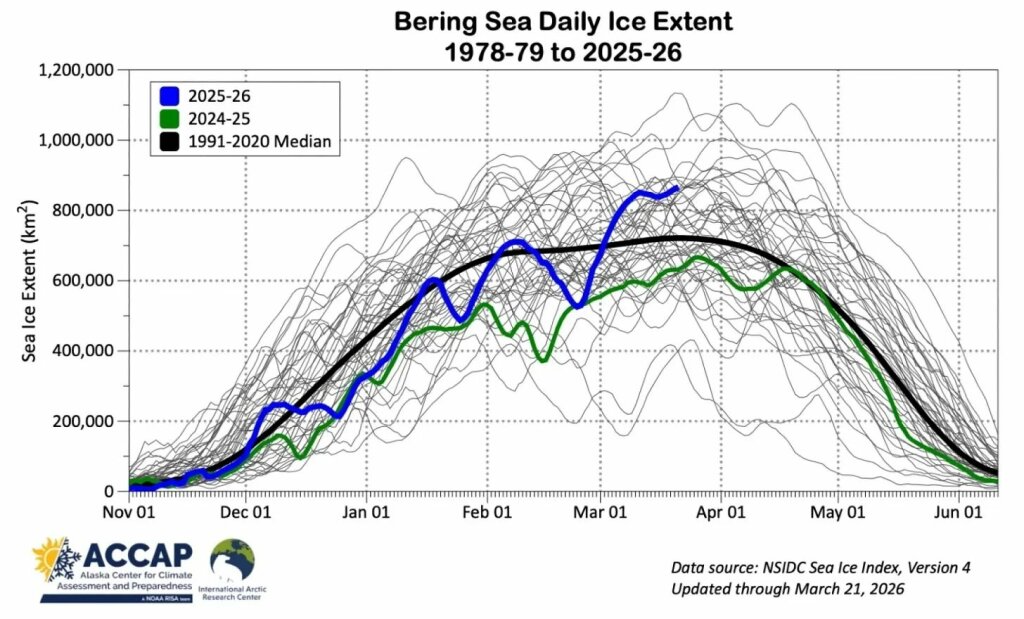

Bering-See: Meereis hält sich in ungewöhnlich winterlichem Ausmaß

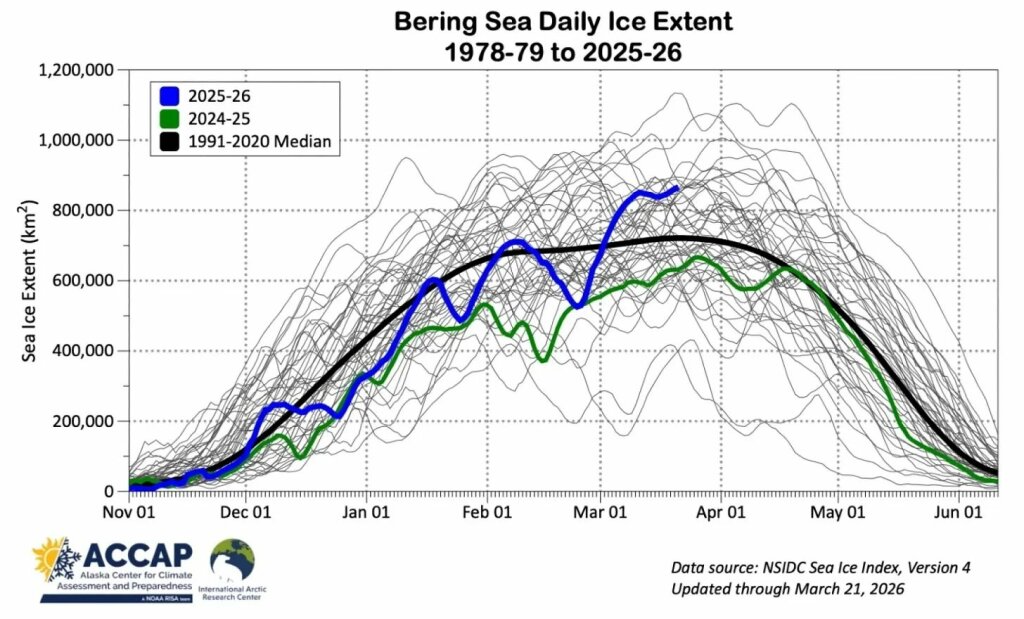

Das Eis in der Beringsee breitete sich in diesem Winter ungewöhnlich weit nach Süden aus, erreichte seine größte Ausdehnung seit mindestens 2013 und erreichte Gebiete, in denen es in den letzten Jahren kaum oder gar kein Eis gab.

Das Eis erstreckte sich über die Bristol Bay, entlang der Alaska-Halbinsel und bis hin zu Cold Bay, Unimak Island und den Pribilof-Inseln. An einigen Stellen waren Fischer gezwungen, durch Eisfelder zu navigieren.

Dies war auf ein anhaltendes Hochdruckgebiet über der Beringsee zurückzuführen, das lokal kalte Luft einschloss und so die Eisbildung begünstigte. Gleichzeitig lenkte es Stürme und mildere Südwinde in die Ochotskische See und begrenzte dort die Eisbildung.

Während sich in der Beringsee Eis bildete, hatten andere Regionen Mühe, überhaupt Eis zu bilden.

Dies verdeutlicht einen wichtigen Punkt, der in allgemeinen Zusammenfassungen der polaren Bedingungen oft übersehen wird. Meereis ist nicht nur eine Funktion der Temperatur. Es wird stark von Windrichtung, Drucksystemen und Meeresströmungen beeinflusst. Ändert sich die Zirkulation, reagiert das Eis schnell – es wächst in einer Region, während es sich in einer anderen zurückzieht.

All dies hat reale Auswirkungen. Die Ausdehnung beeinträchtigte den Fischfang, da Schiffe im südöstlichen Teil der Beringsee Mühe hatten, sich durch das Eis zu navigieren. Auch maritime Ökosysteme sind betroffen, da Meereis die Wassertemperaturen verändert und Arten wie den Pazifischen Kabeljau in andere Gebiete drängt.

Link: https://electroverse.substack.com/p/widespread-april-snow-hits-himachal?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

——————–

Meldungen vom 9. April 2026:

USA: Frühlingssturm bringt erhebliche Schneemengen in der Sierra Nevada

Ein spätwinterlicher Schneesturm zieht in die Sierra Nevada und bringt den dringend benötigten starken Schneefall mit sich.

Zunächst bleibt die Schneefallgrenze bis Freitag hoch, was die ersten Schneemengen begrenzt. Am Samstag folgt dann jedoch deutlich kältere Luft mit einem Absinken der Schneefallgrenze bis auf Seehöhe.

Auf Seehöhe werden mehrere Zentimeter erwartet, in höheren Lagen sollen bis Sonntag bis zu 61 cm fallen. Auf den höchsten Gipfeln könnten die Werte noch weit darüber liegen.

Für Höhenlagen über 1.370 Metern gilt von Freitag 17 Uhr bis Sonntag 22 Uhr eine Wintersturmwarnung. „Reisen in den Bergen könnten sehr schwierig bis unmöglich sein“, warnt der NWS.

Und schon bald könnte noch mehr kommen.

Frühe Vorhersagen deuten auf unterdurchschnittliche Temperaturen und anhaltende Niederschläge bis in die letzte Aprilwoche hin mit der Möglichkeit weiterer Schneefälle.

In der Sierra gibt es in diesem Jahr bnislang ein Defizit. Aber der Winter ist noch nicht vorbei.

…

——————–

Kanada versinkt im Schnee

Während der Westen der USA in dieser Saison etwas zu kämpfen hatte, liegen weite Teile Kanadas unter einer dicken Schneedecke.

Im Westen hat das Banff Sunshine Village die 800-cm-Marke überschritten, begünstigt durch einen März mit 208 cm Neuschnee, der eher an den Hochwinter als an den Frühling erinnerte.

Das nahegelegene Skigebiet Lake Louise startete bereits im Dezember mit 282 cm in die Saison – es war der schneereichste Dezember seit 1970.

Die Messstationen in den Quellgebieten von Alberta liegen für Anfang April nahe dem oberen Ende ihrer historischen Bandbreite, was zeigt, dass es sich nicht nur um die Gesamtwerte der Skigebiete handelte – das gesamte Gebirgssystem verzeichnete eine beträchtliche Schneehöhe.

Das Bild wiederholt sich im Osten.

St. John’s hat nun die 500-cm-Marke für diese Saison überschritten und erreicht diese Schwelle damit erst zum siebten Mal seit Beginn der Aufzeichnungen im Jahr 1942. Allein im Februar fielen 178,2 cm – ein Rekordmonat in Sachen Schneefall. Tatsächlich war es in ganz Neufundland sehr schneereich, wobei mehrere Messstationen Werte weit über dem Normalwert verzeichneten.

Ontario folgte. Sault Ste. Marie überschritt Anfang April die 550-cm-Marke, womit dieser Winter wenige Wochen vor Saisonende in greifbarer Nähe seines saisonalen Allzeit-Schneefallrekords liegt.

Quebec too. Le Valinouët cleared 500 cm (197 in) before February had even ended.

Eine außergewöhnlich kalte Wintersaison sorgte dafür. Der März war wirklich ungewöhnlich. Bereits im Dezember sank die Temperatur in Braeburn auf -55,7 °C – die niedrigste in Kanada seit 1999 gemessene Temperatur.

In den Rocky Mountains bildete sich durch wiederholte Pazifikstürme eine dicke Schneedecke. In Neufundland und im Osten Kanadas türmte sich der Schnee durch anhaltende Atlantikstürme auf. Ontario schloss die Lücke mit Neuschnee durch den Seeeffekt.

Insgesamt überschritten mehrere Orte die 500-cm-Marke, Rekorde fielen – und es ist noch nicht vorbei.

——————–

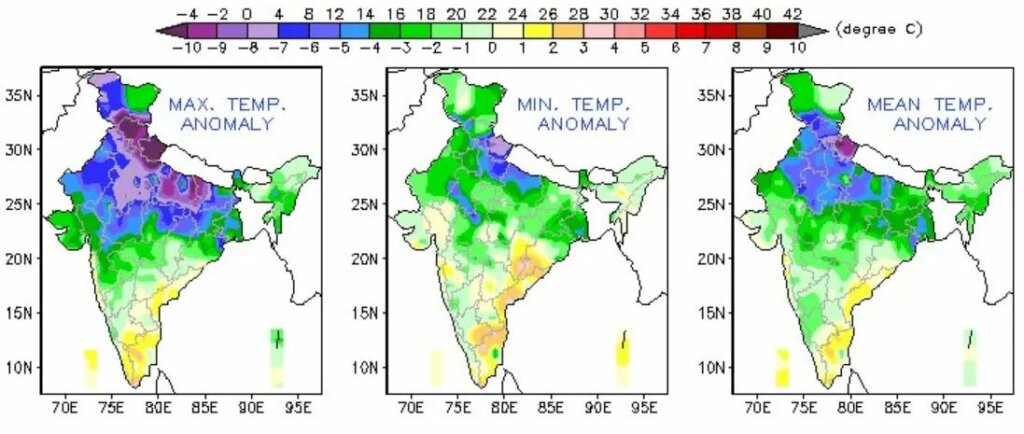

Nordindien: Weiter starke Kälte – Rekorden fallen

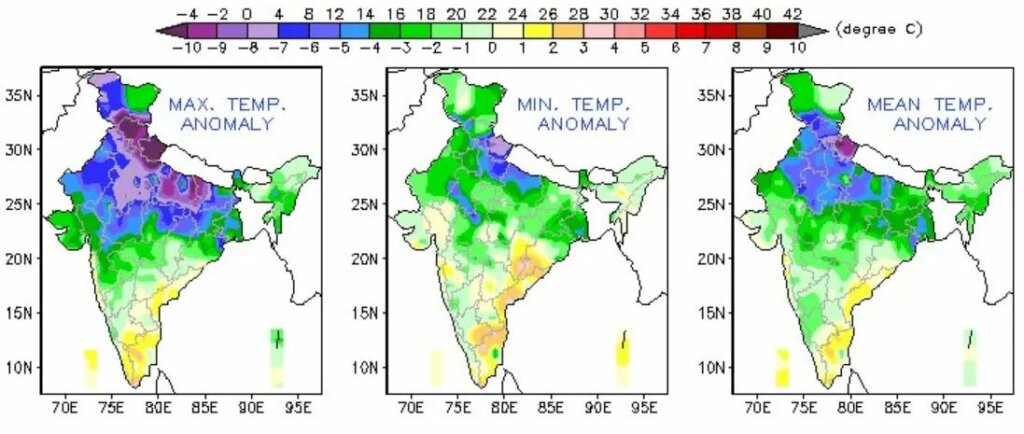

Eine für den April ungewöhnliche Kältewelle hält Nordindien weiterhin im Griff, wodurch die Temperaturen deutlich unter den Normalwerten liegen und an zahlreichen Messstationen langjährige Rekorde gebrochen wurden.

Die Tageshöchsttemperaturen liegen in der gesamten Region 7 °C bis 15 °C unter dem Durchschnitt, was auf die anhaltende Bewölkung im Zusammenhang mit aktiven Weststörungen zurückzuführen ist. Dies steht im Gegensatz zu der für Anfang April typischen Hitze.

In Delhi verzeichnete die Wetterstation Palam am 9. April eine Tiefsttemperatur von 14,6 °C – die niedrigste April-Tiefsttemperatur seit mindestens 2010.

Weiter nördlich nimmt die Kälte in den Hügeln zu.

In Shimla sank die Temperatur auf 3,6 °C, den niedrigsten Wert im April seit mindestens 23 Jahren, während Mukteshwar auf 1,4 °C fiel – den tiefsten Wert im April seit 2009.

Eine große Reihe von Messstationen im Himalaya und im Vorgebirge des Himalaya meldete ähnlich niedrige Tiefstwerte, wobei die Temperaturen für diesen Monat auf einem historischen Tiefstand lagen.

Auch die Tageswerte sind stellenweise stark eingebrochen.

In Tehri wurden am Donnerstag nur 8 °C gemessen, rund 17 °C unter dem Normalwert. In Mukteshwar wurden nur 6,2 °C erreicht, etwa 16 °C unter dem Durchschnitt. Das sind Höchstwerte wie mitten im Winter, die im April auftreten.

In höheren Lagen war es kalt genug, um frischen, weit verbreiteten Schneefall zu verursachen.

Dies ist weder von kurzer Dauer noch ein Einzelfall. Und Indien ist kein kleines Land – die Kälte hat sich von den Ebenen bis in die Hügel ausgebreitet, wobei ein Großteil des 3,3 Millionen km² großen Landes Temperaturen weit unter dem Durchschnitt ausgesetzt ist:

Link: https://electroverse.substack.com/p/spring-storm-brings-snow-boost-to?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

——————–

Meldungen vom 10. April 2026:

Kanada: Polarwirbel hält den Winter fest

Es ist Mitte April, und Kanada befindet sich nach wie vor in tiefstem Winter.

Der troposphärische Polarwirbel ist weiterhin intakt und weist eine Stärke wie im Hochwinter auf.

Anstatt sich mit Beginn des Frühlings abzuschwächen, hält er eine starke Zirkulation über der Hudson Bay aufrecht, wodurch die Region vereist bleibt und weiterhin arktische Luft nach Süden getrieben wird.

Die Vorhersagen für die nächsten 10 Tage zeigen wiederholte Kälteeinbrüche in Zentral- und Ostkanada.

In der Höhe ist die Kälte für diese Jahreszeit ungewöhnlich tiefgreifend. Modelle zeigen 500-mb-Temperaturen von fast -48 °C noch bis zum 17. April – Werte, die eher für Januar als für Mitte April typisch sind.

Diese Kälte in der Höhe hält die Bedingungen an der Oberfläche aufrecht. Die Hudson Bay bleibt eisbedeckt, ohne dass eine nennenswerte Schneeschmelze in Gang kommt. Anstatt sich zurückzuziehen, wird die Kaltluftmasse immer wieder verstärkt.

Was den Schnee betrifft, so sehen die nächsten zwei Wochen sehr aktiv aus.

Anzeichen für Frühlingsschneefall verstärken sich nicht nur in ganz Kanada, sondern auch im Westen der USA, wobei die Schneemengen bis in die letzte Aprilwoche (und möglicherweise bis in den Mai) hinein anhalten.

Der Frühling versucht vorzudringen. Die Atmosphäre will davon jedoch nichts wissen.

…

——————–

Nordindien: Aprilschnee trifft Himachals Apfelanbaugebiet zum ungünstigsten Zeitpunkt

Himachal Pradesh wurde gerade zum Höhepunkt der Blütezeit von Apfelbäumen von starken, großflächigen Schneefällen heimgesucht, die den Apfelanbaugebiet des Bundesstaates genau zu dem Zeitpunkt trafen, als in den Obstgärten der Fruchtansatz einsetzte.

Im gesamten Gebiet von Upper Shimla – einschließlich Narkanda und Kotkhai – melden die Obstbauern weitreichende Schäden. Blüten wurden abgeknickt, Äste abgebrochen und Hagelschutznetze sind unter der Last des nassen Schnees zusammengebrochen.

Zu dieser Jahreszeit befinden sich Apfelbäume in ihrer empfindlichsten Phase. Schnee schädigt nicht nur die sich öffnenden Blüten, sondern beeinträchtigt auch die Bestäubung. Es ist nun mit einem drastischen Rückgang der Erträge zu rechnen.

Aus mehreren Distrikten, von Kufri und der Region um den Atal-Tunnel bis hin zu Lahaul-Spiti, Kinnaur, Chamba, Kangra und Kullu, wurde Schneefall gemeldet. Starker Regen und Hagel begleiteten das Ereignis und weiteten die Auswirkungen weit über die höheren Lagen hinaus aus.

Rund 75 Straßen wurden gesperrt, darunter wichtige Autobahnen, und es kam zu Stromausfällen, als Hunderte Transformatoren außer Betrieb gesetzt wurden.

Auch die Temperaturen sind stark gesunken. Die Tageshöchstwerte fielen um 12 bis 17 °C, wodurch die Bedingungen wieder winterlich wurden. Auch die Tiefstwerte lagen unter dem Normalwert, was den durch den Schnee bereits verursachten Stress für die Pflanzen noch verstärkte.

Die Warnungen bleiben bestehen, und es sind weitere Stürme möglich, bevor sich die Lage nach Mitte April entspannt.

Für die Obstbauern ist der Schaden bereits angerichtet. Die nun verlorenen Blüten lassen sich nicht mehr ersetzen. Der Fruchtansatz wurde beeinträchtigt. In einer Region, die stark vom Apfelanbau abhängig ist, wird dieser Kälteeinbruch in der späten Saison in den kommenden Monaten wahrscheinlich zu erheblichen finanziellen Verlusten führen.

Link: https://electroverse.substack.com/p/polar-vortex-holds-canada-in-winter?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

Wird fortgesetzt mit Kältereport Nr. 16 / 2026

Redaktionsschluss für diesen Report: 10. April 2026

Zusammengestellt und übersetzt von Christian Freuer für das EIKE

Der Beitrag Kältereport Nr. 15 /2026 erschien zuerst auf EIKE - Europäisches Institut für Klima & Energie.