Vorschau ansehen

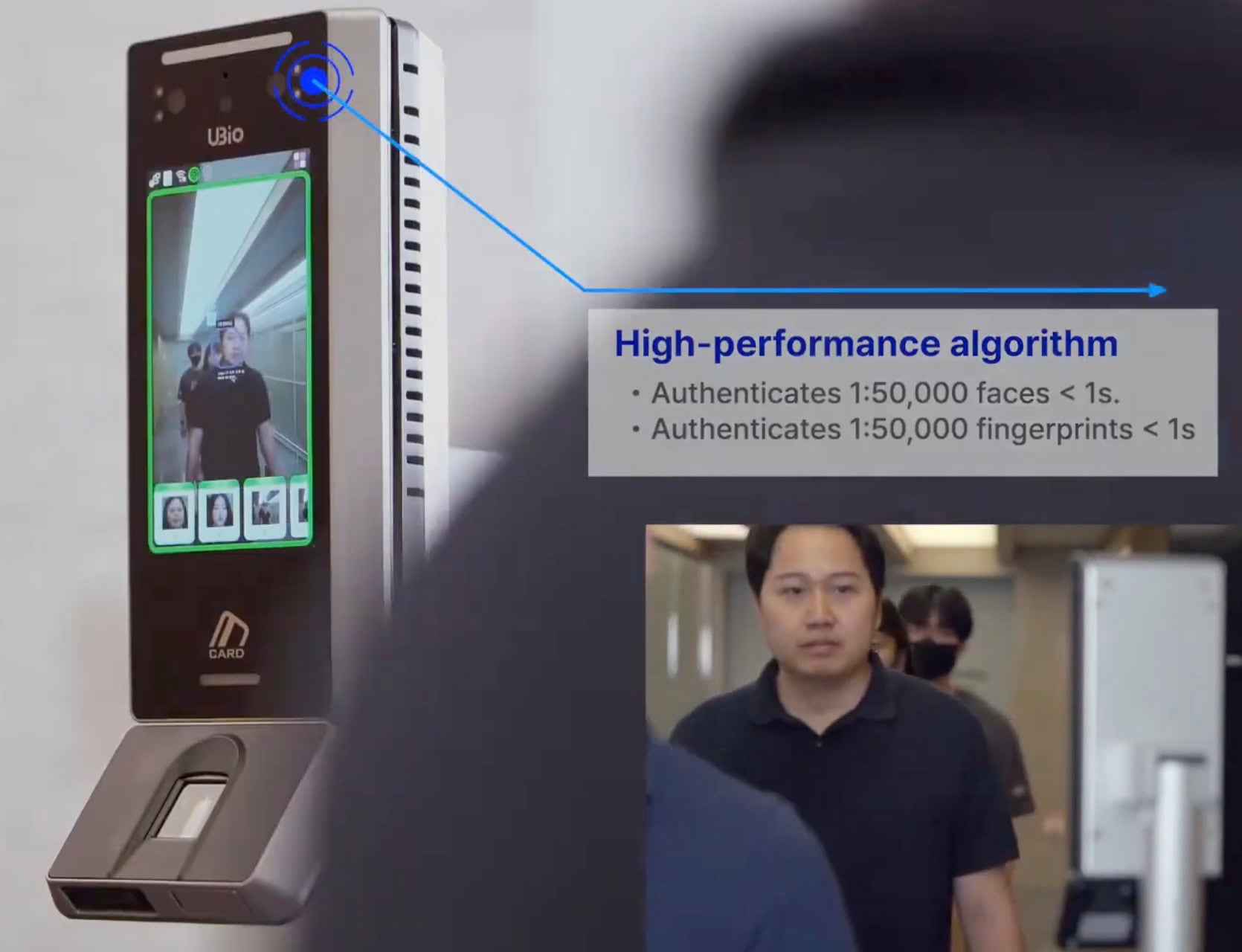

Die Schulung beginnt früh: Gib dein Gesicht ab, erhalte Zugang, nenne es Sicherheit.

Ken Macon

Abstraktes menschliches Gesicht, gebildet aus blau leuchtenden Netzwerkknoten und verbindenden Linien vor dunklem Hintergrund.

Roblox hat entschieden, dass man, bevor man in einer klotzigen Welt aus Cartoon-Avataren „Hallo“ sagen darf, sein Gesicht einer Maschine zeigen muss.

Die neueste Sicherheitsmaßnahme des Unternehmens verlangt nun von jedem Nutzer, überall, einen Gesichtsaltersschätztest zu bestehen, bevor der Chat genutzt werden kann.

Die Richtlinie, durchgesetzt über ein Drittunternehmen namens Persona, wird als Schritt hin zu dem verkauft, was Roblox als „Goldstandard für Kommunikationssicherheit“ bezeichnet.

Das ist also der neue Standard, offenbar: biometrischer Gehorsam im Austausch gegen Sprache.

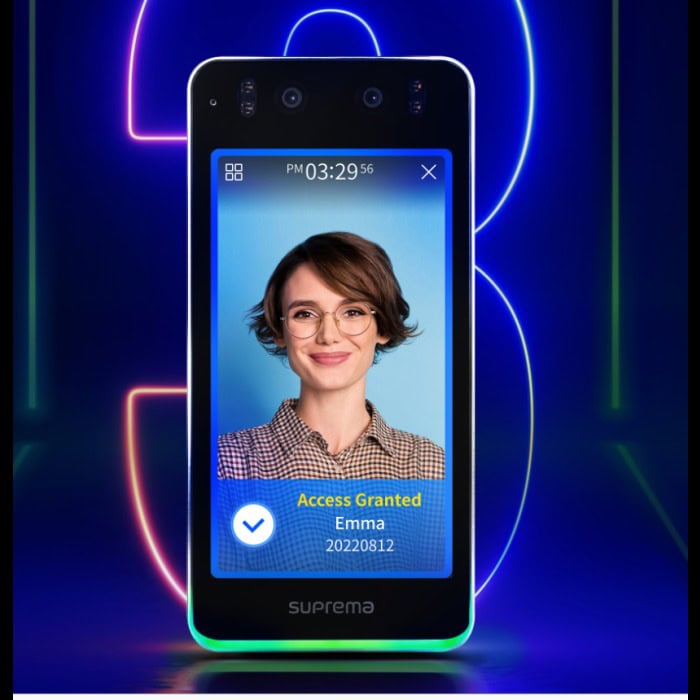

Im neuen System sortiert Roblox seine Millionen Spieler in sechs Altersklassen ein, beginnend mit „unter neun“ und endend bei „über einundzwanzig“.

Jede Klasse bringt Kommunikationsbeschränkungen mit sich. Ein 14-Jähriger kann zum Beispiel anderen 14-Jährigen, 13-Jährigen oder Jüngeren Nachrichten schicken, aber nicht einem 16-Jährigen.

Das Argument des Unternehmens lautet, diese Segmentierung blockiere Erwachsene daran, direkt mit Minderjährigen zu chatten, während „altersgerechte“ soziale Kreise erhalten blieben.

Es ist eine Idee, die in der Theorie vernünftig klingt und in der Praxis bürokratisch ist – ein digitaler Spielplatz, der nach Geburtsdatum überwacht wird. Doch die Implikationen des wachsenden Drangs zur Identitätsprüfung sind tiefgreifend.

Um dem Ganzen einen offiziellen Anstrich zu geben, verwies Roblox auf die Präzision der Persona-Technologie:

„Die von unserem Anbieter Persona eingesetzte Technologie wurde von unabhängigen Laboren getestet und zertifiziert. Die verwendeten Altersschätzmodelle erzielten für Nutzer unter 18 Jahren einen mittleren absoluten Fehler von 1,4 Jahren, basierend auf Tests des Age Check Certification Scheme im Vereinigten Königreich.“

Mit anderen Worten: Der Algorithmus kann um anderthalb Jahre danebenliegen, aber das reicht offenbar aus, um zu entscheiden, wer mit wem sprechen darf.

Wer mit seinem zugewiesenen Alter nicht einverstanden ist, kann Einspruch einlegen, indem er einen Ausweis vorlegt. Das Unternehmen beschreibt dies als „alternative Methode“ der Verifikation, nicht als eine zweite Überwachungsebene.

Parallel zu dieser Einführung kommt eine weitere Neuerung: ein Programm namens Roblox Sentinel, beschrieben als ein Machine-Learning-System, das „mehrere Signale“ überwacht, um Verhalten zu erkennen, das nicht zum angeblichen Alter eines Nutzers passt. Wenn die KI vermutet, dass man über sein Alter lügt, wird man aufgefordert, den Gesichtsscan erneut durchzuführen.

Roblox beteuert, es gehe darum, Kindesausbeutung zu verhindern, bevor sie geschieht. Doch bemerkenswert ist, dass das System nicht nur das Alter überprüft. Es beobachtet ständig, analysiert das Verhalten und erstellt ein Profil.

Die große biometrische Drift

Roblox steht damit nicht allein da. YouTube und andere große Plattformen haben ebenfalls Gesichtsaltersprüfungen eingeführt, oft mit derselben „Sicherheits“-Logik.

Das Problem ist, dass diese Systeme auf biometrischen Daten beruhen – auf Gesichtsgeometrie –, die nicht verändert, gelöscht oder wirklich anonymisiert werden kann.

Unternehmen versprechen einen verantwortungsvollen Umgang, doch Versprechen ändern nichts an der Tatsache, dass Nutzer darauf trainiert werden, ihr Abbild herauszugeben, nur um kommunizieren zu dürfen.

Selbst Kinder lernen, dass ein digitaler Gesichtsscan der Eintrittszoll ist.

Was hier entsteht, ist eine kulturelle Verschiebung hin zu digitalen ID-Systemen, die von privaten Firmen verwaltet werden.

Vor einer Generation hätte die Vorstellung, einen Live-Gesichtsscan einzureichen, um mit Freunden zu chatten, dystopisch geklungen. Heute ist es eine „Verbesserung der Nutzersicherheit“.

Im Fall von Roblox bedeutet die Verweigerung des Scans den vollständigen Verlust des Chat-Zugangs – der zentralen sozialen Funktion der Plattform.

Die Richtlinie definiert Privatsphäre neu als Tauschgeschäft: Wer sich verbinden will, muss zuerst ein Stück seiner Identität abgeben.

Je weiter sich diese Systeme ausbreiten, desto stärker prägen sie Erwartungen. Kinder, die mit Roblox aufwachsen, lernen, dass Online-Sein bedeutet, sich gegenüber einer Maschine zu verifizieren.

Sie verinnerlichen die Vorstellung, dass Vertrauen von Algorithmen vergeben wird und nicht durch Verhalten entsteht.

Mit der Zeit werden diese biometrischen Tore auf andere Bereiche von Roblox und darüber hinaus ausgeweitet. Einmal normalisiert, werden sie selten zurückgenommen.

Die Gewohnheit, sein Alter mit dem Gesicht zu beweisen, wird einen in andere Ecken des Webs begleiten und leise neu definieren, was „Sicherheit“ im digitalen Zeitalter bedeutet.

Für Roblox mag dies eine Geschäftsentscheidung sein. Für alle anderen ist es eine weitere Lektion darüber, wie Bequemlichkeit und Kontrolle zu einem einzigen Produkt verschmolzen sind. Das Unternehmen nennt es Sicherheit. Der Rest von uns könnte es Schulung nennen.

Der Rollout von Roblox ist nur ein Teil eines viel größeren Musters. Branchenübergreifend – vom Bankwesen über Bildung bis zur Unterhaltung – werden biometrische und digitale Identitätssysteme in alltägliche Abläufe eingewoben.

Jede neue „Verifikations-Aufrüstung“ mag für sich genommen harmlos erscheinen, doch zusammen bilden sie ein Netz, aus dem ein Opt-out nahezu unmöglich wird.

Sicherheit im Netz ist wichtig, doch Sicherheit an permanente Identifizierung zu knüpfen, führt eine andere Art von Gefahr ein.

Die Normalisierung digitaler ID-Systeme verwandelt das Internet von einem Ort der Selbstdarstellung in einen Ort der Berechtigungsprüfung. Sobald dieser Wandel greift, hört Privatsphäre auf, ein Recht zu sein, und wird zu etwas, das Individuen aktiv verteidigen müssen.

Personas frühere Probleme

Persona, das Unternehmen, auf das sich Roblox verlässt, um zu entscheiden, wer chatten darf, bringt eigenes rechtliches Gepäck mit. In Washington v. Persona Identities, Inc. reichten die Kläger Charles Washington und Katie Sims in Illinois eine Sammelklage ein und warfen dem Unternehmen vor, gegen den Biometric Information Privacy Act (BIPA) des Bundesstaates verstoßen zu haben.

In der Klage hieß es, Persona habe „die biometrischen Informationen der Sammelkläger unrechtmäßig besessen und daraus Profit gezogen, da es versäumt habe, seine Richtlinien zur Aufbewahrung und Vernichtung biometrischer Daten öffentlich offenzulegen, als diese Informationen erhoben wurden“.

Triptychon eines Frauengesichts unter unterschiedlicher Beleuchtung, das gleichmäßigen Hautton, Verfärbungen und Oberflächenstruktur der Haut zeigt.

Der Fall ging auf Personas Arbeit für DoorDash zurück, bei der Fahrer zur Verifikation „Live-Selfies“ und Fotos ihrer Führerscheine einreichen mussten.

Die Software von Persona analysierte diese Bilder und speicherte Scans der Gesichtsgeometrie jedes Fahrers.

Persona versuchte, den Fall in ein privates Schiedsverfahren zu verlagern und argumentierte, es sei durch DoorDash-Verträge mit den Fahrern geschützt. Das Berufungsgericht von Illinois widersprach und entschied, dass Persona „keine legitime Grundlage hat, die Ansprüche der Kläger in ein Schiedsverfahren zu zwingen“, da es kein direkter Vertragspartner dieser Vereinbarungen war.

Das Gericht beschrieb Personas Rolle als bloße Unterstützung bei der Verifikation, nicht als eigenständige Durchführung von Hintergrundprüfungen, und verwies den Fall zur weiteren Verhandlung zurück.

Die Klage machte deutlich, wie fragil der Begriff „Vertrauen“ in der biometrischen Ökonomie ist. Persona präsentiert sich als sicherer Verifikationsdienst, doch seine Praktiken wurden bereits unter einem der strengsten Datenschutzgesetze der USA angefochten.

Für Roblox-Spieler, die nun Personas Gesichtstests bestehen müssen, wirft diese rechtliche Vorgeschichte eine offensichtliche Frage auf: Was genau passiert mit diesen Scans, wenn das Spiel vorbei ist?

Coinbase und der Eintrittspreis

Coinbase, eine der größten Kryptowährungsbörsen des Landes, sieht sich nun ähnlichen Vorwürfen ausgesetzt.

Eine beim Bundesgericht in Illinois eingereichte Klage behauptet, das Unternehmen habe gegen BIPA verstoßen, indem es Gesichtsbiometrie ohne die gesetzlich vorgeschriebene Zustimmung gesammelt und keine Richtlinie veröffentlicht habe, die erklärt, wie diese Daten gespeichert oder gelöscht werden.

Der Klage zufolge nutzte Coinbase die Verifikationsanbieter Jumio und Onfido, um bei der Kontoeröffnung die Gesichtsaufnahmen der Nutzer zu verarbeiten.

Obwohl Onfido nicht als Beklagter genannt wurde, argumentieren die Kläger, dass Coinbase selbst dafür verantwortlich sei, vor der Erfassung biometrischer Informationen eine schriftliche Einwilligung einzuholen.

Der Streit folgt auf eine frühere Phase des Schiedsverfahrenschaos. Im März 2024 reichten fast 8.000 Personen Schiedsanträge ein, Tausende weitere folgten kurz darauf.

Coinbase versuchte, die Ansprüche an ein Bagatellgericht umzuleiten und weigerte sich anschließend, die Schiedsgebühren zu zahlen, nachdem dieser Antrag scheiterte. Die Kläger zahlten ihren Anteil, Coinbase nicht. Diese Entscheidung beendete faktisch das Schiedsverfahren und ebnete den Weg für eine neue gerichtliche Auseinandersetzung.

Dies ist nicht Coinbases erster BIPA-Konflikt. Eine frühere Klage aus dem Jahr 2023 wurde in ein Schiedsverfahren verwiesen und später ohne Vorurteil abgewiesen, was bedeutet, dass sie zurückkehren könnte, falls das Schiedsverfahren scheitert.

Coinbase ist nicht allein. Walmart, der größte private Arbeitgeber des Landes, einigte sich kürzlich in einem BIPA-Fall im Zusammenhang mit seiner Spark-Liefer-App, die von Persona bereitgestellte Gesichtsbiometrie zur Registrierung und Authentifizierung von Fahrern nutzte.

Die Kläger warfen Walmart vor, vor der Datenerhebung keine ordnungsgemäße Einwilligung eingeholt zu haben. Das Unternehmen stimmte einer Einigung zu, deren finanzielle Details jedoch unter Verschluss bleiben.

Walmart sah sich zudem weiteren BIPA-Klagen wegen biometrischer Zeiterfassungssysteme für Mitarbeiter ausgesetzt. Jeder dieser Fälle zeigt, wie leicht Unternehmen biometrische Erfassung in alltägliche Abläufe integriert haben – oft ohne die Konsequenzen zu erläutern.

Branchenübergreifend schleicht sich biometrische Konformität in den Hintergrund des Alltagslebens.

Der Trend weist in eine Richtung: eine Zukunft, in der Identitätsprüfung zur Voraussetzung für die Online-Existenz wird.

Je vertrauter sich das anfühlt, desto unwahrscheinlicher ist es, dass jemand es noch hinterfragt. Die Maschinen mögen bestätigen, wer wir sind, doch der Preis ist, dass sie auch genau wissen werden, wie sie uns finden.

ID.me hat mit dem US-Finanzministerium einen Rahmenvertrag im Wert von 1 Milliarde Dollar abgeschlossen – eine fünfjährige Vereinbarung, die es dem Unternehmen erlaubt, Authentifizierung und Identitätsprüfung über mehrere Programme des Ministeriums hinweg bereitzustellen. Damit wird die Kontrolle eines privaten Unternehmens über weite Teile der persönlichen Daten der Öffentlichkeit zementiert.

Bundesbeamte beschreiben die Vereinbarung als Fortschritt bei Online-Sicherheit und Betrugsprävention. Doch die wachsende Abhängigkeit von der biometrischen Infrastruktur eines einzelnen Anbieters geht weit über Effizienz hinaus.

Sie verlagert die Verantwortung für die Identitätsprüfung von Millionen Bürgern von öffentlichen Institutionen auf einen gewinnorientierten Vermittler, bei dem der Umgang mit diesen Daten eher von kommerziellen Anreizen als von verfassungsrechtlichen Prinzipien geleitet wird.

ID.me ist kein Neuling bei Bundesverträgen. Die Beziehung zum Internal Revenue Service reicht Jahre zurück, mit Aufträgen im Wert von zig Millionen Dollar.

Der IRS unterzeichnete kürzlich einen Vertrag über 86 Millionen Dollar für die exklusive Nutzung der Authentifizierungsdienste des Unternehmens. Nutzer werden aufgefordert, ihre Identität durch das Einreichen von Dokumenten und einen Gesichtabgleich zu bestätigen.

Öffentlicher Aufschrei im Jahr 2022 zwang den IRS dazu, von der Pflicht zur Gesichtserkennung abzurücken und als Alternative einen Videochat mit einem Live-Mitarbeiter anzubieten. Dennoch bleibt ID.me ein zentraler Bestandteil dessen, wie Amerikaner ihre Identität nachweisen, um auf Steuerdaten zuzugreifen und Steuererklärungen online einzureichen.

Andere Behörden zogen nach. Die Centers for Medicare and Medicaid Services nutzen ID.me inzwischen für Medicare.gov.

Das Department of Veterans Affairs und die Social Security Administration verlassen sich darauf für den Zugang zu Leistungen. Im Jahr 2025 erweiterte die General Services Administration die Reichweite von ID.me durch einen Vertrag, der es erlaubt, mehrere Behörden im Rahmen des Federal Supply Schedule zu bedienen.

Zu diesem Zeitpunkt war ID.me Infrastruktur geworden.

Wenn öffentliche Identität zu Privateigentum wird

Jeder neue Vertrag verschiebt die Grenze zwischen öffentlichem Dienst und privater Verwaltung. Die Auslagerung der Identitätsprüfung bündelt enorme Mengen persönlicher Informationen unter der Kontrolle eines einzigen Unternehmens: Namen, Ausweisnummern, Gesichtsaufnahmen und sogar Verhaltensdaten im Zusammenhang mit Anmeldungen.

Sobald sich dieses Modell etabliert, authentifizieren Bürger sich nicht mehr beim Staat selbst.

Sie authentifizieren sich bei einem Unternehmen, das entscheidet, wie lange Daten aufbewahrt werden, welche Sicherheitsmaßnahmen gelten und wie transparent man darüber informiert.

Der Prozess mag für den Nutzer reibungslos erscheinen, doch er bedeutet die Privatisierung eines Grundpfeilers des bürgerlichen Lebens: der Fähigkeit, die eigene Identität nachzuweisen, ohne sie zu verkaufen.

Was als Versuch begann, Logins zu vereinfachen und Betrug zu verhindern, hat sich zu einem kommerziellen Identitätsnetzwerk entwickelt, das in die föderale Bürokratie eingewoben ist. Der Zugang zu essenziellen Diensten wie Gesundheitsversorgung, Rente und Steuerabwicklung hängt nun von der Einhaltung der biometrischen Standards eines privaten Unternehmens ab.

Kongresskritik und Pandemie-Nachwirkungen

Anmeldeseite des IRS mit Optionen zur Erstellung eines ID.me-Kontos oder zur Anmeldung mit ID.me oder einem bestehenden IRS-Benutzernamen.

Die wachsende Rolle des Unternehmens kommt trotz kritischer Erkenntnisse aus zwei US-Kongressausschüssen, die seine Leistung während der Pandemie untersuchten.

Abgeordnete stellten fest, dass ID.me Behörden und Öffentlichkeit sowohl über Wartezeiten bei virtuellen Interviews als auch über das tatsächliche Ausmaß der verhinderten Arbeitslosenbetrugsfälle in die Irre geführt hatte.

Laut Bericht teilte ID.me den Bundesbehörden mit, dass die manuelle Überprüfung bei fehlgeschlagenen Gesichtsscans etwa zwei Stunden dauere.

In Wirklichkeit lagen die durchschnittlichen Wartezeiten bei über vier Stunden, wobei einige Bundesstaaten Verzögerungen von neun Stunden oder mehr meldeten. Das Unternehmen entfernte zudem Terminoptionen für virtuelle Gespräche, wodurch Menschen mit gemeinsam genutzten oder öffentlichen Computern keinen Zugang zu Arbeitslosenleistungen hatten.

Abgeordneter James Clyburn, damaliger Vorsitzender des Sonderunterausschusses zur Coronavirus-Krise, verurteilte den Umgang des Unternehmens mit steuerfinanzierten Programmen:

„Es ist zutiefst enttäuschend, dass ein Unternehmen, das zig Millionen Dollar an Steuergeldern erhielt, um Amerikanern beim Erhalt dieser Leistungen zu helfen, deren Zugang zu dieser entscheidenden Hilfe möglicherweise behindert hat. Die Praktiken von ID.me riskierten, dringend benötigte Unterstützung für Amerikaner unerreichbar zu machen, die keinen einfachen Zugang zu Computern, Smartphones oder dem Internet haben.“

Abgeordnete Carolyn B. Maloney, Vorsitzende des Ausschusses für Aufsicht und Reform, kritisierte die Transparenz des Unternehmens:

„In einigen Fällen entfernte ID.me wichtige Kundendienstangebote, was es Nutzern erschwerte, mit vertrauenswürdigen Ansprechpartnern zu sprechen. Ich bin zudem zutiefst besorgt darüber, dass ID.me Bundesbehörden unzutreffende Informationen bereitgestellt hat, um Aufträge in Millionenhöhe zu erhalten.“

Das Bild, das die Untersuchung zeichnete, war eines der Dysfunktion. Während der Pandemie wurde ID.me zu einem digitalen Nadelöhr für Arbeitslosenansprüche, mit Millionen Antragstellern, die in virtuellen Warteschlangen festsaßen, während sich das Unternehmen öffentlich als Erfolgsgeschichte der Betrugsprävention präsentierte.

Der Widerstand

Datenschutzaktivisten wurden aufmerksam. Das Electronic Privacy Information Center hat gemeinsam mit mehreren Bürgerrechtsorganisationen Bundes- und Landesbehörden aufgefordert, ihre Verträge mit ID.me und ähnlichen Anbietern zu beenden.

Sie argumentieren, dass biometrische Verifikation den gleichberechtigten Zugang zu staatlichen Dienstleistungen untergräbt, insbesondere für Menschen ohne die nötige Technologie oder Ressourcen.

Nach der Kritik ließ der IRS seine Pläne fallen, Gesichtserkennung für Steuerzahler beim Online-Zugang verpflichtend zu machen.

Dennoch gewinnt das Unternehmen weiterhin neue Bundesaufträge, während die Prüfung seiner Methoden und Datenrichtlinien zunimmt.

Die neue Bürokratie des Gesichts

Der Konflikt um ID.me macht die Widersprüche im Kern der digitalen Identitätsbewegung sichtbar.

Unternehmen behaupten, den Zugang zu modernisieren und Betrug zu bekämpfen, doch ihre Systeme beruhen auf invasiver Datenerhebung und intransparenter Entscheidungsfindung.

Bürger sollen Privatsphäre gegen Bequemlichkeit tauschen, oft ohne zu erkennen, dass sie in ein kommerzielles System eintreten, das Identität als monetarisierbares Gut behandelt.

Organisationen wie EPIC rufen zu direktem Widerstand auf, etwa durch Initiativen wie die Petition „Dump ID.me“, und warnen, dass die Normalisierung verpflichtender biometrischer Verifikation jede einzelne Vertragslaufzeit überdauern wird. Die zugrunde liegende Botschaft ist simpel: Effizienz im Staat darf nicht die Abgabe biometrischer Daten verlangen.

Die tiefere Frage lautet, welche Art von Gesellschaft entsteht, wenn der Nachweis der eigenen Identität untrennbar mit Unternehmensdatenbanken verknüpft ist.

Sobald das Recht, in einem digitalen Raum zu existieren, von einem Gesichtsscan abhängt, ist Privatsphäre kein Schutzmechanismus mehr. Sie wird zu einer Erlaubnis, die entzogen werden kann.