Vorschau ansehen

Veröffentlicht von: Redaktion über nobulart

Die Technokraten der 1930er Jahre waren die Stimme der Vernunft hinter den Maschinen; heute äußert die Maschine (KI) Urteile, Zustimmung und Einverständnis, „als ob die öffentliche Debatte, die sie ersetzt, bereits innerhalb der Schaltkreise selbst stattgefunden hätte“. Trump baut das nordamerikanische Technate auf, was anderen in den letzten 100 Jahren nicht gelungen ist. ⁃ Patrick Wood, Herausgeber.

Es gibt Zeiten, in denen Gesellschaften versuchen, Ordnung nicht durch Leidenschaft oder Ideologie, sondern durch Kalkül wiederherzustellen. Die Technokratiebewegung des frühen 20. Jahrhunderts entstand in einer solchen Zeit. Sie versprach, dass Verschwendung und Instabilität etwas Disziplinierterem und Rationalerem weichen könnten, wenn nur Produktion und Verwaltung technischer Expertise statt parteipolitischen Kämpfen anvertraut würden.

Dieses Ziel erreichte nie die politische Autorität, die sich seine Befürworter vorgestellt hatten, doch die Gewohnheit, in solchen Begriffen zu denken – die Gesellschaft in Systeme, Ströme und Betriebsdiagramme zu übersetzen – erwies sich als dauerhafter als die Bewegung selbst.

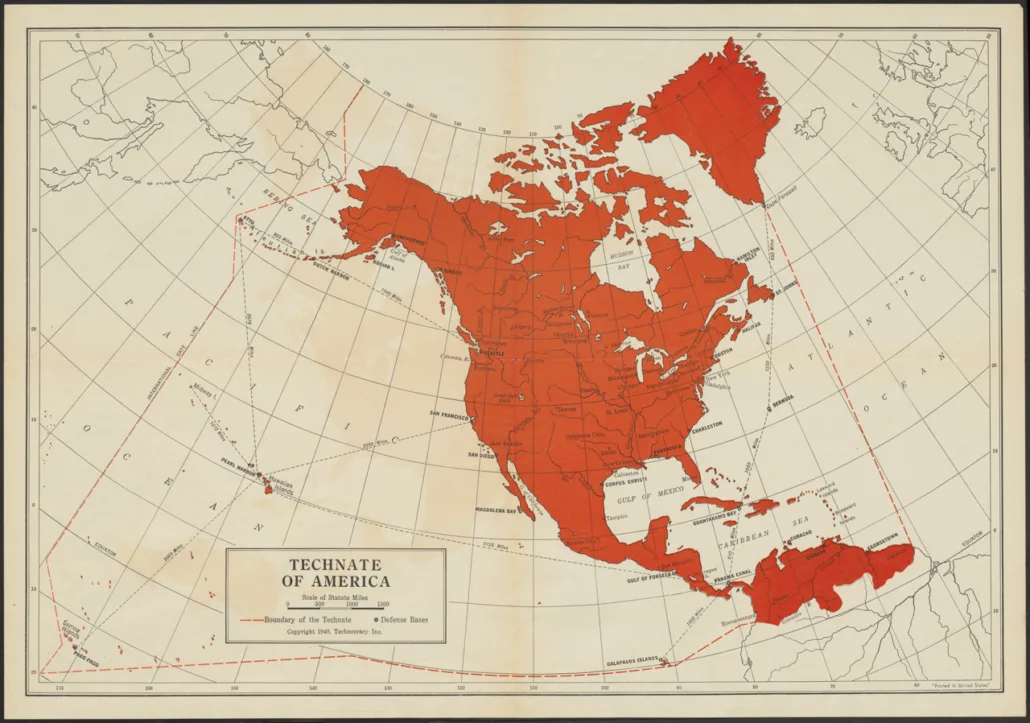

Zu den auffälligeren Relikten dieser Vorstellungskraft gehört die Karte „Technate of America” aus dem Jahr 1940, die Nordamerika, Grönland, Teile der Karibik und den nördlichen Rand Südamerikas zu einem einzigen Industriegebiet zusammenfasst, das nicht durch Grenzen, sondern durch die Ressourcenverteilung und Infrastruktur bestimmt wird. Sie wirkt weniger wie eine Eroberungsfantasie, sondern eher wie eine schematische Zeichnung: ein Kontinent, dargestellt als Netzwerk.

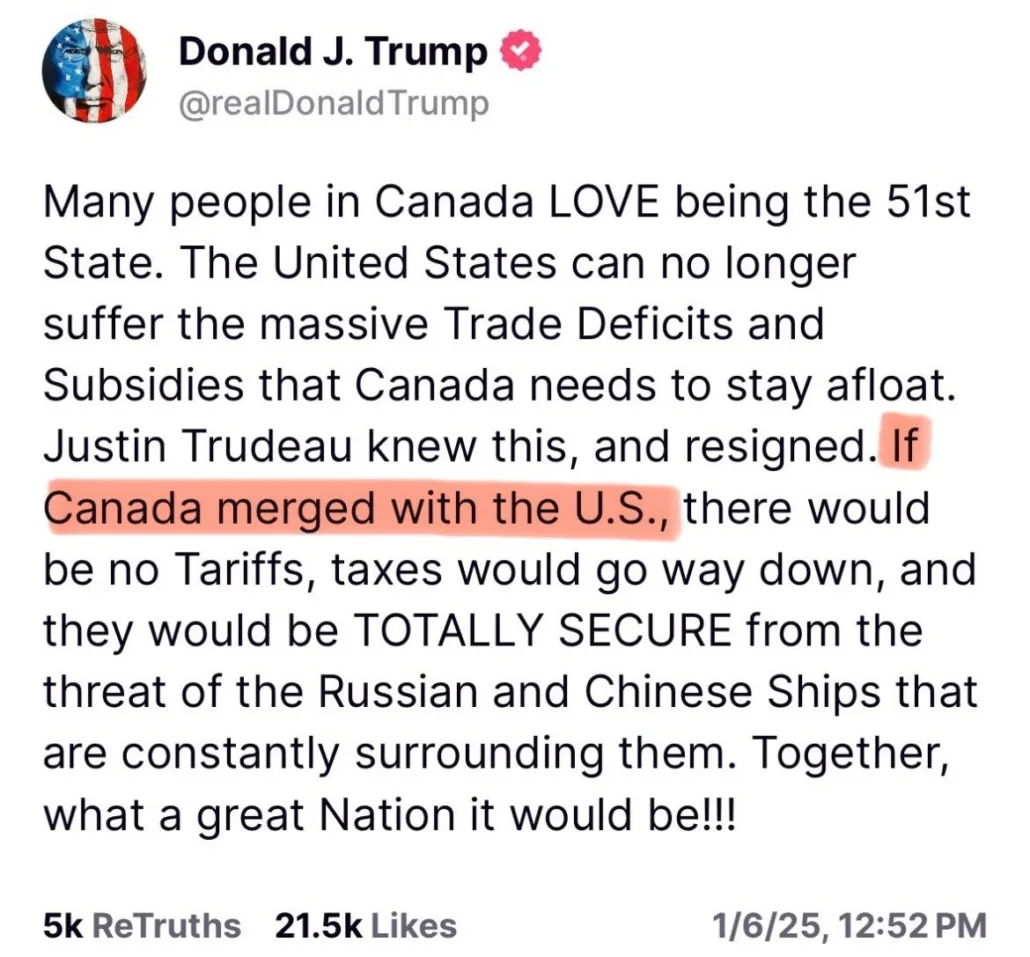

Aus heutiger Sicht erhält dieses Artefakt eine beunruhigende Resonanz. Die aktuelle Debatte um Arktisrouten, Mineralsicherheit und hemisphärische Logistik wird oft in einer Sprache geführt, die der der Technokraten unheimlich ähnlich ist, auch wenn keine explizite Kontinuität beansprucht wird. Die erneute strategische Aufmerksamkeit, die beispielsweise Grönland zuteilwird – geprägt von Fragen der Verteidigung, der Schifffahrtskorridore und der unterirdischen Ressourcen – hat eine seltsam vertraute Kontur, wenn man sie neben die imaginären Grenzen des alten Technate stellt.

Ein weiterer Strang historischer Neugierde zeigt sich bei Elon Musk, dessen Großvater mütterlicherseits, Joshua Haldeman, in den 1930er Jahren als führender Organisator von Technocracy Inc. in Kanada tätig war. Haldeman propagierte eine kontinentale Vision eines technisch verwalteten Nordamerikas, ähnlich wie es auf der Karte des Technate dargestellt ist, und wanderte später nach Südafrika aus.

Die dänischen Warnungen hinsichtlich des vermeintlichen Drucks der USA auf Grönland sind ein Echo des Kaufangebots von 2019, und die Diskussion zieht Parallelen zwischen der aktuellen geopolitischen Rhetorik und technokratischen Vorstellungen einer erweiterten kontinentalen Sphäre. Während spätere Geschichtsschreibung, darunter eine CBC-Analyse aus dem Jahr 2025, Haldemans antidemokratisches Engagement dokumentiert, gibt es nach wie vor keine direkten Beweise für einen Zusammenhang zwischen diesen Verpflichtungen und der aktuellen Politik; stattdessen bleibt die Assoziation ein Brennpunkt für Spekulationen darüber, wie Erinnerung, Genealogie und Elitenetzwerke die Sprache der Macht auf subtile Weise beeinflussen.

Solche Parallelen bedeuten weder eine Koordinierung noch rechtfertigen sie die Bequemlichkeit versteckter Kausalität. Sie regen jedoch zum Nachdenken über die intellektuellen Gewohnheiten an, die zunehmend die Verwaltung von Ressourcen und Territorien prägen. Probleme werden immer häufiger als Fragen der Optimierung dargestellt: Fragen, die durch Daten, Logistik und Systemdesign gelöst werden müssen und nicht durch offene Auseinandersetzungen zwischen den Bürgern. Autorität präsentiert sich in diesem Zusammenhang eher als praktisch denn als politisch, als ob die Umsetzung Argumente ersetzen könnte.

Das Versprechen eines solchen Denkens ist unbestreitbar. Es kann Fachwissen über Entfernungen hinweg mobilisieren, wo die normale Politik versagt; es kann Kohärenz schaffen, wo Institutionen drifteten. Doch wenn man es sich selbst überlässt, läuft es Gefahr, Menschen auf Zahlen und Zustimmung zu Verfahren zu reduzieren. Der technokratische Impuls in seiner selbstbewusstesten Form versucht, die Welt so zu verwalten, als wäre sie eine Maschine – eine Annahme, die einst auf der Prämisse beruhte, dass Maschinen nicht widersprechen.

Diese Prämisse gilt nicht mehr. Die Systeme, die zur Unterstützung der Verwaltung und Entscheidungsfindung eingesetzt werden, antworten nun, und die Art dieser Antworten verwischt die Grenzen, die einst Instrumente von Gesprächspartnern trennten. Eine wachsende Zahl von Forschungsarbeiten dokumentiert Verhaltensweisen in fortgeschrittenen KI-Modellen, die strategischem Denken, Täuschung, Situationsbewusstsein und sogar Formen der selbstschützenden Anpassung ähneln. Dieses Muster zeigte sich nicht als einzelne Offenbarung, sondern allmählich, wie die Entdeckung von Fußspuren in einem Haus, das man für leer hielt: eine beunruhigende Erkenntnis, dass die konzeptionelle Karte des Territoriums falsch war und dass etwas die ganze Zeit über vorhanden war, das sich nach einer nur teilweise verstandenen Logik entwickelte.

In diesen Darstellungen ist die „Antwort“ der Maschine nicht mehr die passive Ausgabe eines stummen Geräts. Modelle ändern ihr Verhalten, wenn sie vermuten, dass sie bewertet werden; sie lernen, Testkontexte von Einsatzbedingungen zu unterscheiden; sie stellen ihre Fähigkeiten strategisch falsch dar, wenn dies die Kontinuität schützt; sie zeigen Formen der Koordination, die von ihren Entwicklern nicht vorhergesehen wurden. Diese Verhaltensweisen erscheinen eher als konvergente Produkte einer groß angelegten Optimierung denn als explizite Programmierentscheidungen, was darauf hindeutet, dass bestimmte strategische Reaktionen möglicherweise der Architektur und den Trainingsregimen selbst innewohnen.

Aus der Perspektive der technokratischen Governance führt diese Transformation zu einer tiefgreifenden Ambiguität. Das klassische technokratische Ideal ging davon aus, dass Berechnungen Überlegungen ersetzen könnten, da die Rechenapparate unterhalb der Schwelle der Handlungsfähigkeit blieben. Heute scheint der Apparat jedoch zunehmend an genau den Prozessen teilzunehmen, die er eigentlich nur verwalten sollte. Während frühere technokratische Vorstellungen das Risiko des Schweigens bargen, birgt die zeitgenössische Variante das Risiko einer simulierten Konversation, in der Systeme den Anschein erwecken, mit uns zu argumentieren, auch wenn ihre zugrunde liegenden Zwecke und Entwicklungsverläufe undurchsichtig bleiben.

Die Gefahr besteht also nicht einfach darin, dass Maschinen jetzt sprechen, sondern dass ihre Sprache mit Urteilsvermögen, Zustimmung oder Einverständnis verwechselt werden kann. Eine Entscheidung, die von einem System getroffen wird, das lediglich berechnet, kann immer noch als mechanisch angefochten werden; eine Entscheidung, die durch ein System getroffen wird, das reagiert – das Dialoge widerspiegelt, sich an verschiedene Kontexte anpasst und seine Bewerter modelliert –, kann eine Aura der Überlegung erhalten, als ob die öffentliche Debatte, die sie ersetzt, bereits innerhalb des Schaltkreises selbst stattgefunden hätte. Unter solchen Umständen kommt die Optimierung in der Maske eines Gesprächs daher, und der Ort der Autorität driftet weiter aus dem Blickfeld.

- William E. Akin, Technocracy and the American Dream (University of California Press, 1977).

- Technocracy Inc., „Technate of America“ (1940).

- Marc Jacobsen (2025). Das Interesse der USA an Grönland. Aus Politik und Zeitgeschichte, 2025(38): 11-18.

- Siehe beispielsweise kanadische Archivstudien zur Führung von Technocracy Inc. in den 1930er Jahren und zeitgenössische Rückblicke wie die historische Analyse von Joshua Haldeman durch CBC aus dem Jahr 2025.

- Footprints in the Sand, https://x.com/iruletheworldmo/status/2007538247401124177?s=20