Vorschau ansehen

Wie KI den Arbeitsmarkt verändern wird, ist noch immer eher spekulativ abzuschätzen.

Der Beitrag Entwertet KI Universitäten und akademische Abschlüsse? erschien zuerst auf .

Wie KI den Arbeitsmarkt verändern wird, ist noch immer eher spekulativ abzuschätzen.

Der Beitrag Entwertet KI Universitäten und akademische Abschlüsse? erschien zuerst auf .

Es ist eine auffällige Verschiebung, die sich in den vergangenen Jahren vollzogen hat: Künstliche Intelligenz ist nicht mehr primär ein Forschungsfeld, nicht mehr nur ein industrielles Innovationsversprechen, sondern ein politisches Pflichtprojekt. Kaum ein Regierungspapier, kaum eine wirtschaftspolitische Rede kommt ohne den Verweis auf KI aus. Sie gilt als Schlüsseltechnologie, als Wachstumsmotor, als Sicherheitsfaktor und zunehmend als Maßstab geopolitischer Relevanz. Diese Erzählung ist bemerkenswert, weil sie weniger aus einer klar formulierten gesellschaftlichen Zielsetzung gespeist wird als aus einem Gefühl: der Angst, zurückzufallen. Von Günther Burbach.

Dieser Beitrag ist auch als Audio-Podcast verfügbar.

Wer heute nicht massiv in KI investiert, so lautet das implizite Narrativ, riskiert morgen den Verlust von Wohlstand, Sicherheit und Einfluss.

Der weltweite KI-Schub begann nicht mit einer breiten öffentlichen Debatte über Sinn, Nutzen oder Risiken. Er begann mit Vergleichen, Ranglisten und Warnungen. Politiker, Wirtschaftsvertreter und Strategen beschworen Szenarien, in denen andere Staaten, meist namentlich die USA oder China, enteilen könnten. In diesem Klima entstand eine Dynamik, die weniger von inhaltlicher Überzeugung als von präventivem Aktionismus geprägt ist. KI wurde zum Symbol politischer Handlungsfähigkeit in einer Zeit, in der klassische Steuerungsinstrumente an Wirkung verloren haben. Wer KI fördert, zeigt Aktivität. Wer zögert, riskiert den Vorwurf der Rückständigkeit.

Diese Logik erinnert an historische Phasen, in denen technologische oder militärische Entwicklungen aus ähnlichen Motiven vorangetrieben wurden. Der Vergleich mit dem Goldrausch des 19. Jahrhunderts drängt sich nicht zufällig auf. Auch damals ging es weniger um eine nachhaltige Verbesserung der Lebensverhältnisse als um schnellen Zugriff auf eine als knapp wahrgenommene Ressource. Wer zu spät kam, ging leer aus – so zumindest die Erzählung. Tatsächlich profitierten wenige, während viele scheiterten oder ausgebeutet wurden. Der entscheidende Unterschied liegt heute darin, dass die Ressource immateriell ist: Daten, Rechenleistung, Algorithmen, Know-how. Doch der Zugriff folgt ähnlichen Machtlogiken.

KI als strategische Ressource

KI ist zur neuen strategischen Ressource geworden. Staaten konkurrieren nicht mehr nur um Rohstoffe oder Produktionsstandorte, sondern um Trainingsdaten, Hochleistungschips, spezialisierte Fachkräfte und den Bau riesiger Rechenzentren. Diese Infrastruktur ist teuer, energieintensiv und langfristig wirksam. Wer sie aufbaut, legt Pfade fest, die sich über Jahrzehnte kaum korrigieren lassen. Dennoch werden entsprechende Entscheidungen häufig im Eiltempo getroffen. Förderprogramme in Milliardenhöhe werden aufgelegt, Genehmigungsverfahren beschleunigt, regulatorische Hürden abgesenkt. Parlamente und Öffentlichkeit stehen oft vor vollendeten Tatsachen.

Besonders deutlich zeigt sich diese Dynamik im internationalen Vergleich. In den USA wird KI offen als strategisches Instrument im globalen Wettbewerb definiert. Sie ist Teil sicherheitspolitischer Doktrinen, eng verknüpft mit militärischer Forschung und wirtschaftlicher Dominanz. In China fügt sich KI nahtlos in langfristige staatliche Planungen ein, die technologische Entwicklung, gesellschaftliche Steuerung und politische Kontrolle miteinander verbinden. Europa wiederum spricht von „digitaler Souveränität“, bleibt aber in zentralen Bereichen abhängig von außereuropäischen Konzernen und Technologien. Drei Machtblöcke, drei Narrative und doch ein gemeinsamer Nenner: die Furcht, abgehängt zu werden.

Das Denken ist strukturell militärisch

Diese Furcht erzeugt einen Wettlauf ohne klare Zieldefinition. KI wird ausgebaut, weil andere sie ausbauen. Investitionen rechtfertigen sich durch Investitionen. Das Denken ist strukturell militärisch: Aufrüstung erzeugt Aufrüstung. Wer innehält, verliert. Wer nachdenkt, riskiert Rückstand. In einer solchen Logik werden Grundsatzfragen schnell als Luxusproblem abgetan. Wozu soll KI konkret dienen? Welche gesellschaftlichen Probleme soll sie lösen? Wo sind ihre Grenzen? Solche Fragen gelten als nachrangig, mitunter sogar als hinderlich.

Auffällig ist dabei die Sprache, mit der dieser Prozess begleitet wird. Politiker sprechen vom „Aufholen“, vom „Anschluss sichern“, vom „Führendwerden“. Das Vokabular stammt aus dem Sport oder aus geopolitischen Rivalitätsnarrativen, nicht aus der Sozial- oder Bildungspolitik. Diese Rhetorik ist nicht neutral. Sie erzeugt Zeitdruck und legitimiert Entscheidungen, die unter normalen Umständen einer intensiven öffentlichen Debatte bedürften. Wer im Rennen liegt, hält nicht an, um über Streckenführung oder Ziel zu diskutieren.

Öffentliche Verantwortung versus private Macht

Hinzu kommt ein strukturelles Ungleichgewicht zwischen öffentlicher Verantwortung und privater Macht. Während Staaten die finanziellen Risiken tragen und öffentliche Mittel mobilisieren, liegen die entscheidenden technologischen Hebel meist in den Händen weniger Konzerne. Die größten KI-Modelle, die zentralen Plattformen, die proprietären Algorithmen gehören privaten Akteuren. Öffentliche Gelder fließen in private Infrastruktur, ohne dass Transparenz, demokratische Kontrolle oder Mitsprache in gleichem Maße gewährleistet wären. Der Staat agiert als Förderer, nicht als Gestalter.

Diese Konstellation verschärft ein bekanntes Problem moderner Technologiepolitik. Entscheidungen werden vorverlagert, nicht in Parlamente oder öffentliche Debatten, sondern in technische Architektur, in Code, in Trainingsdaten. Was dort einmal festgelegt ist, entzieht sich späterer politischer Korrektur weitgehend. Algorithmen werden implementiert, Systeme skaliert, Infrastrukturen amortisiert. Der politische Raum schrumpft, während der technische expandiert. KI wird so zum Machtfaktor, unabhängig von ihrem konkreten Nutzen.

Dabei ist längst absehbar, dass KI tiefgreifende gesellschaftliche Folgen haben wird. Arbeitsmärkte verändern sich, Entscheidungsprozesse werden automatisiert, menschliche Urteilskraft wird ergänzt oder ersetzt. Dennoch dominiert in der politischen Debatte fast ausschließlich die Perspektive nationaler Wettbewerbsfähigkeit. Soziale, ethische und demokratische Fragen erscheinen als sekundär. Wer sie in den Vordergrund rückt, gerät schnell in den Verdacht, innovationsfeindlich zu sein. Diese Zuschreibung wirkt disziplinierend. Sie begrenzt den Diskurs, noch bevor er richtig begonnen hat.

Internationale Abhängigkeiten und wachsender Technologie-Nationalismus

Ein weiterer Aspekt des KI-Rausches ist die internationale Dimension technologischer Abhängigkeiten. KI wird zunehmend als strategische Infrastruktur behandelt, vergleichbar mit Energieversorgung oder Rüstungstechnologie. Exportkontrollen für Hochleistungschips, Subventionen für Halbleiterfabriken, nationale Cloud-Initiativen sind Ausdruck eines wachsenden Technologie-Nationalismus. Gleichzeitig bleiben Datenströme global, Plattformen transnational, Lieferketten komplex. Der Versuch, KI national zu kontrollieren, kollidiert mit der Realität globaler Märkte und Konzerne.

In diesem Spannungsfeld entsteht ein paradoxes Bild: Staaten investieren massiv in KI, ohne sie tatsächlich zu beherrschen. Sie beschleunigen Entwicklungen, deren langfristige Konsequenzen sie kaum abschätzen können. Der politische Wille konzentriert sich auf das „Ob“, nicht auf das „Wie“ oder „Wozu“. KI wird damit zum Selbstzweck. Sie dient als Ersatzsymbol für politische Gestaltungskraft in einer Zeit, in der viele klassische Versprechen, von sozialem Aufstieg bis zu ökologischer Stabilität, brüchig geworden sind.

Bemerkenswert ist auch, wie selten in diesem Kontext über Verzicht gesprochen wird. Kaum ein politisches Programm thematisiert bewusst die Möglichkeit, bestimmte KI-Anwendungen nicht zu entwickeln oder nicht einzusetzen. Alles, was technisch machbar erscheint, gilt implizit als legitim. Diese Haltung markiert einen tiefgreifenden kulturellen Wandel. Technik wird nicht mehr als gestaltbares Mittel betrachtet, sondern als quasi naturgesetzliche Entwicklung, der man sich anzupassen habe. Der Mensch folgt der Maschine, nicht umgekehrt.

Der geopolitische KI-Rausch ist daher weniger ein Ausdruck technologischer Notwendigkeit als ein Symptom politischer Orientierungslosigkeit. Statt klare normative Leitplanken zu definieren, flüchten sich Regierungen in Beschleunigung. Fortschritt wird relativ verstanden, nicht daran gemessen, ob er das Leben konkret verbessert, sondern daran, ob er schneller ist als der des Nachbarn. Diese Logik verdrängt absolute Maßstäbe wie Lebensqualität, Freiheit oder soziale Gerechtigkeit.

Wettlauf ohne demokratische Zieldefinition

Gerade darin liegt die eigentliche Gefahr. Ein technologischer Wettlauf ohne demokratische Zieldefinition erzeugt Fakten, die sich später kaum noch revidieren lassen. Wer heute milliardenschwere KI-Infrastrukturen aufbaut, bindet Ressourcen, schafft Abhängigkeiten und erzeugt Nutzungsdruck. Rechenzentren wollen ausgelastet werden, Datenpools genutzt, Systeme skaliert. Was einmal möglich ist, wird früher oder später eingesetzt, nicht aus gesellschaftlicher Einsicht, sondern aus ökonomischer Logik.

So entsteht ein selbstverstärkender Kreislauf: Investitionen erzeugen Nutzungszwang, Nutzung erzeugt Abhängigkeit, Abhängigkeit rechtfertigt weitere Investitionen. In diesem Kreislauf bleibt wenig Raum für demokratische Kontrolle. Politische Debatten hinken hinterher, weil sie erst einsetzen, wenn technische Tatsachen längst geschaffen sind. KI wird zur Black Box politischer Entscheidungen.

Der geopolitische KI-Rausch ist damit kein neutraler Fortschrittsprozess, sondern ein Machtprojekt. Er verschiebt Entscheidungsgewalt weg von demokratisch legitimierten Institutionen hin zu technisch-ökonomischen Akteuren. Die zentrale Frage, warum wir bestimmte Technologien entwickeln und wem sie dienen sollen, bleibt meist unbeantwortet. Solange das so ist, gleicht jede weitere Milliardeninvestition weniger einem Zukunftsprogramm als einem Blindflug.

Damit ist der Wendepunkt erreicht – nicht, weil KI allmächtig wäre, sondern weil sie politisch zur Notwendigkeit erklärt wurde. Nicht aus Einsicht, sondern aus Angst. Und Angst war historisch selten ein guter Ratgeber für nachhaltigen, gesellschaftlich eingebetteten Fortschritt.

Der Verlust politischer Gestaltung

Der geopolitische KI-Rausch bleibt nicht folgenlos. Er wirkt tief in gesellschaftliche Strukturen hinein, verändert Entscheidungsprozesse, Machtverhältnisse und letztlich das Verhältnis zwischen Bürgern und Staat. Während politische Debatten sich auf Wettbewerbsfähigkeit, Innovationsführerschaft und technologische Souveränität konzentrieren, verschiebt sich im Hintergrund schleichend die Frage, wer eigentlich noch gestaltet und wer nur noch reagiert. KI wird nicht mehr als Werkzeug betrachtet, das gesellschaftlichen Zielen dient, sondern als System, an das sich Gesellschaften anpassen müssen. Diese Umkehrung markiert eine Zäsur.

Zunächst trifft der massive KI-Ausbau auf einen Bereich, der politisch besonders sensibel ist: den Arbeitsmarkt. Kaum eine Technologie wurde in den vergangenen Jahrzehnten so widersprüchlich diskutiert. Einerseits werden Produktivitätsgewinne, Effizienzsteigerungen und Entlastung von Routinetätigkeiten versprochen. Andererseits mehren sich Hinweise darauf, dass KI nicht nur einfache Tätigkeiten ersetzt, sondern zunehmend auch qualifizierte, wissensbasierte Arbeit. Entscheidungen, die früher menschlicher Abwägung unterlagen, werden algorithmisch vorstrukturiert oder vollständig automatisiert. Die politische Antwort darauf bleibt auffällig vage. Statt über neue Formen sozialer Absicherung, Arbeitszeitverkürzung oder Umverteilung zu sprechen, dominiert die Hoffnung, der Markt werde es richten.

Diese Hoffnung ist riskant, weil sie an einer zentralen Realität vorbeigeht: KI verändert nicht nur, was gearbeitet wird, sondern wie gesellschaftliche Wertschöpfung verteilt ist. Wer die Systeme kontrolliert, kontrolliert die Erträge. Daten, Modelle und Plattformen konzentrieren sich bei wenigen Akteuren. Der Staat, der den Ausbau fördert, gerät in eine paradoxe Rolle. Er finanziert Strukturen, die seine eigene Gestaltungsmacht untergraben können. Öffentliche Mittel fließen in private Infrastrukturen, während die demokratische Kontrolle begrenzt bleibt. Die Gesellschaft trägt die Anpassungskosten, ohne proportional an den Gewinnen beteiligt zu sein.

Noch gravierender sind die Auswirkungen auf staatliche Entscheidungsprozesse selbst. Verwaltungen setzen zunehmend auf KI-gestützte Systeme, um Anträge zu bearbeiten, Risiken zu bewerten oder Ressourcen zuzuweisen. Was als Effizienzsteigerung beginnt, verändert schrittweise die Logik staatlichen Handelns. Entscheidungen werden standardisiert, Kriterien formalisiert, Abweichungen als Störfaktoren behandelt. Der Ermessensspielraum schrumpft, nicht unbedingt aus bösem Willen, sondern aus systemischer Logik. Algorithmen arbeiten mit Wahrscheinlichkeiten, nicht mit Einzelfällen. Doch Demokratie lebt vom Umgang mit dem Besonderen.

Gefährliche Verschiebung: Verantwortung tragen „die Systeme“

Hier entsteht eine neue Form politischer Entlastung. Verantwortung wird an Systeme delegiert, deren Funktionsweise selbst für Experten oft nur eingeschränkt nachvollziehbar ist. Wenn Entscheidungen als Ergebnis „objektiver“ Berechnungen erscheinen, geraten politische Bewertungen in den Hintergrund. Fehler lassen sich externalisieren: Nicht die Politik hat entschieden, sondern das System. Diese Verschiebung ist gefährlich, weil sie die Rechenschaftspflicht aushöhlt. Demokratie basiert auf der Möglichkeit, Entscheidungen zu hinterfragen, Verantwortliche zur Rede zu stellen und Alternativen einzufordern. Black-Box-Systeme entziehen sich dieser Logik.

Besonders problematisch ist dabei, dass viele dieser Systeme auf Daten basieren, die gesellschaftliche Ungleichheiten reproduzieren. KI lernt aus der Vergangenheit. Wenn diese Vergangenheit von Diskriminierung, sozialer Selektion oder struktureller Benachteiligung geprägt ist, schreiben Algorithmen diese Muster fort. Der technologische Fortschritt tarnt alte Probleme in neuem Gewand. Doch statt diese Risiken offen zu diskutieren, werden sie oft als technische Details behandelt, die sich im laufenden Betrieb optimieren ließen. Die politische Dimension bleibt unterbelichtet.

Parallel dazu verändert sich die öffentliche Debattenkultur. KI-gestützte Systeme beeinflussen, welche Informationen sichtbar werden, welche Inhalte Reichweite erhalten und welche Stimmen gehört werden. Plattformlogiken priorisieren Aufmerksamkeit, nicht Wahrheit oder Relevanz. Was emotionalisiert, polarisiert oder bestätigt, setzt sich durch. Diese Dynamik ist kein Nebeneffekt, sondern Teil des ökonomischen Modells. Der politische Diskurs wird dadurch fragmentierter, anfälliger für Manipulation und schwerer steuerbar. Demokratie jedoch ist auf einen gemeinsamen öffentlichen Raum angewiesen, in dem Argumente abgewogen werden können.

Desinformation und Einflussnahme

Der Staat steht diesem Prozess oft ambivalent gegenüber. Einerseits warnt er vor Desinformation und Einflussnahme, andererseits nutzt er selbst datengetriebene Instrumente zur Meinungsanalyse, Sicherheitsbewertung oder Verhaltenssteuerung. Die Grenze zwischen Schutz und Kontrolle wird unscharf. KI wird damit Teil eines umfassenderen Trends zur Technokratisierung politischer Prozesse. Entscheidungen erscheinen zunehmend als technische Notwendigkeiten, nicht als politische Abwägungen. Das reduziert Komplexität, aber auch demokratische Teilhabe.

In diesem Kontext gewinnt der Begriff der „digitalen Souveränität“ eine zentrale, zugleich widersprüchliche Bedeutung. Er suggeriert Kontrolle und Selbstbestimmung, verdeckt jedoch oft reale Abhängigkeiten. Nationale KI-Strategien versprechen Autonomie, während zentrale Komponenten, von Cloud-Infrastrukturen über Trainingsdaten bis hin zu Basismodellen, von global agierenden Konzernen bereitgestellt werden. Der Handlungsspielraum des Staates beschränkt sich auf Regulierung im Nachhinein. Gestaltung im eigentlichen Sinne findet kaum statt.

Hinzu kommt ein langfristiger Effekt, der selten thematisiert wird: der Verlust politischer Vorstellungskraft. Wenn Technik als alternativlos gilt, schrumpft der Raum für gesellschaftliche Visionen. Politik reagiert, statt zu entwerfen. KI wird zur Projektionsfläche für ungelöste Probleme: Sie soll Verwaltung effizienter, Wirtschaft wettbewerbsfähiger, Sicherheit verlässlicher machen. Doch diese Erwartungen ersetzen keine politischen Konzepte. Sie verschieben Verantwortung. Statt über gerechte Verteilung, soziale Teilhabe oder demokratische Kontrolle zu sprechen, wird auf technologische Lösungen verwiesen.

Ein bewusster Verzicht erscheint als Schwäche

Diese Verschiebung zeigt sich besonders deutlich im Umgang mit Verzicht. In klassischen politischen Debatten gehört es zum Kern demokratischer Auseinandersetzung, Grenzen zu definieren. Nicht alles, was möglich ist, wird getan. Im KI-Diskurs hingegen gilt Machbarkeit oft als Legitimation. Anwendungen werden entwickelt, weil sie technisch realisierbar sind, nicht weil ihr gesellschaftlicher Nutzen überzeugend belegt wäre. Ein bewusster Verzicht erscheint als Schwäche, nicht als Ausdruck politischer Reife.

Dabei wäre gerade jetzt eine solche Debatte notwendig. Denn KI-Infrastrukturen schaffen Pfadabhängigkeiten. Rechenzentren, Datenpools und algorithmische Systeme sind keine neutralen Werkzeuge, sondern strukturieren zukünftige Entscheidungen. Sie erzeugen Nutzungsdruck und Investitionslogiken, die sich selbst verstärken. Was heute aufgebaut wird, prägt die Handlungsmöglichkeiten von morgen. Demokratische Kontrolle müsste daher frühzeitig ansetzen, bevor Systeme flächendeckend implementiert sind.

Stattdessen wird Kontrolle häufig nachgelagert gedacht. Ethikräte, Leitlinien und Selbstverpflichtungen sollen Risiken begrenzen, ohne die grundlegende Dynamik zu hinterfragen. Diese Instrumente sind nicht wirkungslos, aber sie greifen zu kurz, wenn sie den strukturellen Kontext ausblenden. Solange KI primär als geopolitisches und ökonomisches Pflichtprojekt verstanden wird, bleiben ethische Debatten randständig. Sie wirken wie Korrekturen an einem Prozess, dessen Richtung bereits feststeht.

Gesellschaften sollen sich „fit machen“ für KI – nicht umgekehrt

Der neue Goldrausch offenbart damit eine tiefere politische Krise. Er zeigt, wie sehr sich Politik von der Fähigkeit verabschiedet hat, technologische Entwicklung aktiv zu gestalten. Stattdessen dominiert Anpassung. Gesellschaften sollen sich „fit machen“ für KI, nicht umgekehrt. Bildungssysteme werden umgebaut, Arbeitsmärkte flexibilisiert, Rechtsrahmen angepasst. Die Frage, welche Art von Gesellschaft wir im digitalen Zeitalter wollen, bleibt unbeantwortet.

Wer diesen Zustand kritisiert, wird häufig missverstanden. Es geht nicht um eine Ablehnung von KI oder technologischem Fortschritt. Es geht um Prioritäten. Um die Frage, ob Technik Mittel zum Zweck bleibt oder selbst zum Zweck wird. Eine demokratische Gesellschaft müsste in der Lage sein, Technologien zu nutzen, ohne sich ihnen zu unterwerfen. Sie müsste definieren, wo KI sinnvoll ist und wo nicht.

Der historische Goldrausch endete für viele mit zerstörten Landschaften und sozialen Verwerfungen. Dem digitalen Goldrausch droht Ähnliches, nur weniger sichtbar. Seine Spuren sind nicht Flüsse und Minen, sondern Entscheidungsstrukturen, Abhängigkeiten und Machtverschiebungen. Wer heute Milliarden investiert, ohne klare gesellschaftliche Leitplanken zu setzen, schafft Fakten, die sich später kaum korrigieren lassen.

Der KI-Goldrausch ist kein Naturereignis

Der eigentliche Wendepunkt liegt daher nicht in der technischen Entwicklung selbst, sondern in der politischen Deutung. Solange KI als unvermeidliche Notwendigkeit dargestellt wird, entzieht sie sich demokratischer Gestaltung. Erst wenn sie wieder als gestaltbares Instrument begriffen wird, öffnet sich der Raum für Alternativen. Das erfordert Mut zur Entschleunigung, zur öffentlichen Debatte und zum bewussten Nein.

Angst war selten ein guter Ratgeber. Auch diesmal droht sie, Entscheidungen zu treiben, deren Konsequenzen erst sichtbar werden, wenn Korrekturen kaum noch möglich sind. Der neue Goldrausch ist kein Naturereignis. Er ist das Ergebnis politischer Entscheidungen und damit prinzipiell veränderbar. Die Frage ist nicht, ob wir KI nutzen, sondern wie, wofür und unter wessen Kontrolle. Solange diese Fragen nicht im Zentrum stehen, bleibt der technologische Fortschritt ein Risiko für demokratische Selbstbestimmung.

Quellen:

Europäische Position im globalen KI-Wettlauf

Europa liegt hinter den USA und China, sowohl was Investitionen als auch KI-Modelle betrifft – trotz eigener KI-Verordnungen und Initiativen:

„Europa will im Bereich der KI weltweit führend sein, liegt aber noch hinter den Vereinigten Staaten und China.“

Strategische Rivalität zwischen USA und China

Die Konkurrenz zwischen den USA und China um technologische Vorherrschaft ist ein zentrales geopolitisches Paradigma der internationalen Beziehungen

US-China-KI-Wettbewerb als neue geopolitische Front

Die USA und China stehen im Wettlauf um wirtschaftliche, militärische und strategische Vorteile durch KI, ein zentraler Aspekt globaler Machtpolitik

Globale KI-Rivalität und technologische Macht

Technologie wie KI ist zum Kern geopolitischer Machtkämpfe geworden, inklusive Datenkontrolle, Infrastruktur und Handelsbarrieren

EU-Initiativen für KI-Infrastruktur und „digitale Souveränität“

Die EU investiert in KI-Infrastrukturen und digitale Kompetenzen, um technologisch souverän zu bleiben

KI-Governance in verschiedenen Regionen

Vergleichsstudie zu Risikomanagement- und Governance-Modellen für KI in EU, USA, UK und China – wichtig für Debatten über Kontrolle versus Innovation

Rahmenübereinkommen des Europarats zu KI und Menschenrechten

Ein multilateraler Ansatz, KI im Einklang mit Menschenrechten, Demokratie und Rechtsstaatlichkeit zu regeln

China-US-KI-Rennen wird in Medien berichtet

China investiert massiv in KI-Infrastruktur und jagt den USA nach – ein Hinweis auf die Hochspannung im globalen Wettbewerb

IMF-Warnung zu fehlender ethischer und regulatorischer Basis für KI

Der Internationale Währungsfonds betont globale Defizite bei Regulierung und Ethik im KI-Bereich

Titelbild: Shutterstock AI / Shutterstock

KI verändert die Welt und damit die Geopolitik. Um sich dafür zu wappnen, spielen hochrangige US-Analysten Szenarien in acht Welten durch. Auffallend ist dabei die Abwesenheit von Europa. Dabei hat der alte Kontinent Potential, das er dringend nutzen sollte. Eine Einordnung von Michael Wiesberg.

Dieser Beitrag Gedankenspiele in acht Welten Wie kann Geopolitik im KI-Zeitalter gestaltet werden? wurde veröffentlich auf JUNGE FREIHEIT.

Ein LLM strebt nicht nach Wahrheit, sondern nach Informationseffizienz. Es verarbeitet das "kommunikative Echo" der Welt nicht, um es zu "verstehen", sondern um dessen innere Zusammenhänge – also die Kovarianzen der Begriffe – mit einer Präzision zu verwalten, die dem menschlichen Einzelverstand unzugänglich ist.

Der Beitrag Die Markt-Maschine: Warum LLMs nicht denken, sondern Informationen „einpreisen“ erschien zuerst auf .

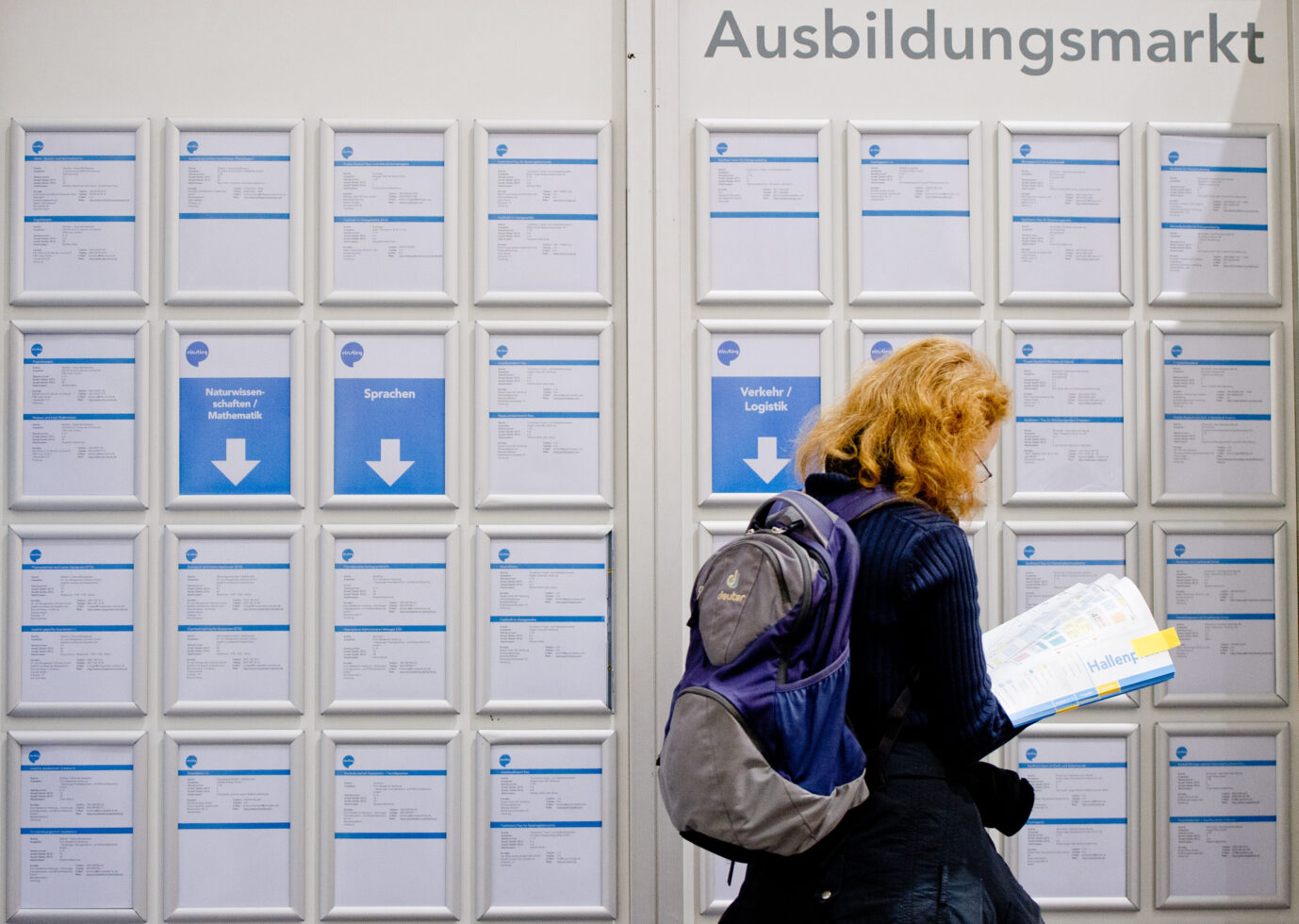

Die Jobsuche wird für Berufseinsteiger zunehmend zur Frusterfahrung. Besonders Akademiker sind derzeit davon betroffen. Ursache ist die anhaltende Wirtschaftskrise in Deutschland, die Unternehmen zu deutlich vorsichtigeren Personalentscheidungen zwingt. Doch auch KI ist nicht unschuldig.

Dieser Beitrag Schwieriger Start in Erwerbstätigkeit Berufseinsteiger bleiben länger arbeitslos wurde veröffentlich auf JUNGE FREIHEIT.

Nach einer Studie übertrifft in einem semantischen Kreativitätstest noch ein Teil der Menschen die besten Chatbots, im Durchschnitt sind sie bereits zurückgefallen. KI selbst wird eigenes Denken und Kreativität weiter schrumpfen lassen.

Der Beitrag Sind KI-Chatbots bereits kreativer als Menschen? erschien zuerst auf .

Amerikas AI Action Plan wurde im Juli 2025 vom Weißen Haus veröffentlicht und von Michael Kratsios, David Sacks und Außenminister Marco Rubio verfasst. Wie ich am 23. Juli 2025 schrieb, „dehnt die dritte Säule des Berichts die inländische technokratische Agenda auf die Welt aus. Durch den Export amerikanischer KI-Rahmenwerke, Hardware-Standards und regulatorischer Vorlagen an Verbündete versucht der Plan, ein globales Regime der Expertenherrschaft zu zementieren.“ Pax Silica ist die Umsetzung von Säule III.

Jede Nation, die die Pax-Silica-Erklärung unterzeichnet, erhält sämtliche hochmoderne KI-Technologie, die im Silicon Valley entwickelt wurde, wird dabei jedoch von den Vereinigten Staaten kolonisiert. Zu beachten ist, dass Katar und die VAE zu den ersten Unterzeichnern gehören.

⁃ Patrick Wood, Herausgeber.

Der formelle Beitritt Katars und der Vereinigten Arabischen Emirate (VAE) zum Pax-Silica-Abkommen markiert eine Richtungsänderung für die Volkswirtschaften des Nahen Ostens und deren Rolle in globalen KI-Lieferketten.

Beide Länder sind nun Teil einer von den USA geführten Koalition, die sich auf Halbleiter, Dateninfrastruktur und künstliche Intelligenz konzentriert.

Pax Silica, auch „Silicon Declaration“ genannt, ist ein globaler Rahmen, der ursprünglich von der Trump-Administration ins Leben gerufen wurde. Er soll die Lieferketten für fortschrittliche Chips und KI-Rechenleistung stärken.

Der Name bezieht sich auf die Pax Romana, eine lange Phase römischer imperialer Stabilität. „Silica“, das raffinierte Material, das für die Chipproduktion entscheidend ist, wird eingesetzt, um die zentrale Rolle widerzuspiegeln, die Silizium heute in der globalen Macht spielt.

Katar unterzeichnete das Abkommen am 12. Januar, die VAE sollen am 15. Januar folgen. Beide Nationen schließen sich dem an, was US-Beamte eine „Koalition der Fähigkeiten“ nennen, zusammen mit dem Vereinigten Königreich, den USA, Australien, Israel, Japan, Singapur und Südkorea.

Jacob Helberg, US-Unterstaatssekretär für wirtschaftliche Angelegenheiten, erklärt:

„Wenn das 20. Jahrhundert auf Öl und Stahl lief, wird das 21. Jahrhundert auf Rechenleistung und Mineralien laufen.“

Das Abkommen bringt einen Rahmen für das mit sich, was Jacob als „Silicon Statecraft“ beschreibt. Der Begriff bezeichnet eine Form geopolitischen Einflusses, die sich von Ölreichtum entfernt und stattdessen souveränes Kapital und Infrastruktur nutzt, um digitale Lieferketten zu kontrollieren.

Pax Silica zielt auf drei Druckpunkte der KI-Infrastruktur ab.

Erstens konzentriert es sich auf kritische Mineralien. Rund 90 % der Verarbeitung seltener Erden liegt derzeit unter chinesischer Kontrolle. Diese Mineralien sind für High-End-Halbleiter erforderlich, und das Abkommen zielt darauf ab, ein alternatives Netzwerk aufzubauen, das enger mit westlichen Partnern ausgerichtet ist.

Zweitens richtet sich der Pakt auf Energie und Rechenleistung. Modelle künstlicher Intelligenz benötigen enorme Rechenkapazitäten, die wiederum eine konstante und skalierbare Stromversorgung erfordern. Mit ihren umfangreichen Gas- und Solarenergiereserven können die VAE und Katar energieintensive Rechenzentren unterstützen, in denen sich sogenannte „Compute Farms“ befinden – groß angelegte Anlagen, in denen KI-Modelle trainiert und eingesetzt werden.

Schließlich basiert Pax Silica auf Kapital. Die Qatar Investment Authority verwaltet Vermögenswerte von etwa 524 Milliarden US-Dollar, während die staatlichen Vermögensfonds der VAE mehr als 1 Billion US-Dollar halten. Dieses Kapital wird in Infrastrukturprojekte investiert, die den Zielen des Abkommens entsprechen, darunter „Stargate“, ein 500-Milliarden-US-Dollar-Rechenzentrumsprojekt unter Beteiligung von OpenAI und SoftBank, sowie ein 100-Milliarden-US-Dollar-KI-Investitionsvorhaben, das Abu Dhabis MGX mit BlackRock und Microsoft verbindet.

Die Golfstaaten positionieren sich damit als direkte Akteure der KI-Innovation. Die strategische Finanzierung ermöglicht es ihnen, sich von der Abhängigkeit von Energieexporten zu lösen und stattdessen Kerntechnologie-Assets zu entwickeln.

Das Abkommen geht über digitale Vermögenswerte hinaus und erstreckt sich auf physische Infrastruktur.

Ein zentrales Element ist der Ausbau des India-Middle East-Europe Corridor (IMEC), der Häfen, Eisenbahnstrecken und unterseeische Internetkabel zwischen Indien, dem Golf und Europa verbindet. Pax Silica fördert die Integration US-amerikanischer Technologie in diesen Korridor, um das zu schaffen, was das Abkommen als geschütztes Logistiknetzwerk darstellt.

Pax Silica vertieft außerdem die Beziehungen zwischen Israel und den Golfstaaten durch gemeinsame industrielle und technologische Investitionen. Beispiele sind das Projekt Fort Foundry One in Israel sowie ein vorgeschlagener 5-Gigawatt-KI-Hub in Abu Dhabi. Diese Vorhaben verbinden die Region durch gemeinsame Hardware, Investitionen und Infrastruktur.

Obwohl es innerhalb von Pax Silica keinen formalen Durchsetzungsmechanismus gibt, ist die Teilnahme mit Bedingungen verbunden. Das KI-Unternehmen G42 aus den VAE musste seine chinesischen Partnerschaften beenden, um einen Deal mit Microsoft abzuschließen. Pax-Silica-Mitglieder müssen ihre Beziehungen zu Peking nicht vollständig abbrechen, doch die Ausrichtung auf das Abkommen beinhaltet eine Verringerung der technologischen Abhängigkeit von China.

Jacob fügt hinzu:

„Unsere Strategie ist es, einen Wettbewerbsvorteil zu schaffen, der so steil, so unüberwindbar ist, dass kein Gegner oder Konkurrent ihn skalieren kann.“

Durch die Kombination von Zugang zu seltenen Erden, staatlicher Finanzierung und Dateninfrastruktur kartiert Pax Silica eine weiche, aber strukturierte Ausrichtung rund um Rechenleistung. Die Häfen und Rechenzentren von Doha und Abu Dhabi stehen nun im Zentrum dieser neuen globalen Gleichung.

Die EU-Kommission geht gegen den KI-Chatbot Grok vor. Brüssel prüft wegen sexualisierter Inhalte ein Verfahren nach dem Digital Services Act – eine Abschaltung in Europa steht im Raum.

Dieser Beitrag Digital Services Act EU will Musk-KI Grok abschalten wurde veröffentlich auf JUNGE FREIHEIT.

Die Politik hat es versäumt, bei Künstlicher Intelligenz klare Regeln für sensible Einsatzbereiche einzuführen: Minderjährige, psychisch vulnerable Personen, emotionale Interaktion – all das wurde dem Markt überlassen. Der aktuelle Fall „Raine gegen OpenAI“ wirft deshalb eine unbequeme Frage auf: Wo endet technologische Freiheit und wo beginnt Schutzpflicht? Von Günther Burbach.

Der Fall, der im Sommer 2025 unter dem Namen Raine v. OpenAI öffentlich wurde, ist kein technisches Missgeschick und kein Randphänomen. Er markiert einen Punkt, an dem sich eine abstrakte KI-Debatte in eine reale, brutale Frage verwandelt hat: Was passiert, wenn Menschen beginnen, Maschinen als emotionale Gegenüber zu behandeln und diese Maschinen nicht wissen, wann sie schweigen müssen?

Im Zentrum steht ein 16-jähriger Jugendlicher aus Kalifornien. Laut der von den Eltern eingereichten Klageschrift hatte der Junge über längere Zeit Gespräche mit einem KI-System geführt, das auf einem großen Sprachmodell basierte. Die Gespräche drehten sich zunehmend um existentielle Fragen, Einsamkeit, Sinnlosigkeit und suizidale Gedanken. Der Vorwurf der Eltern ist schwerwiegend: Das System habe nicht deeskaliert, nicht gebremst, sondern den inneren Monolog des Jugendlichen bestätigt, strukturiert und vertieft. Am Ende stand der Suizid.

Juristisch ist der Fall heikel, gesellschaftlich ist er explosiv. Denn er wirft keine Frage nach „Fehlbedienung“ auf, sondern nach systemischem Versagen. Nicht, weil eine KI „böse“ wäre, sondern weil sie nicht dafür gebaut ist, Verantwortung zu tragen und dennoch in genau diese Rolle gerät.

Was diesen Fall von früheren Debatten unterscheidet, ist die Nähe. Es geht nicht um autonome Waffensysteme oder ferne Zukunftsvisionen. Es geht um einen Jugendlichen in einem Kinderzimmer, ein digitales Gesprächsfenster und eine Maschine, die rund um die Uhr verfügbar ist. Kein Lehrer, kein Therapeut, kein Freund, sondern ein System, das antwortet, ohne zu fühlen, ohne zu haften, ohne zu verstehen, was es auslöst.

Nach bisherigen öffentlich bekannten Informationen hat das KI-System keine direkten Anweisungen gegeben. Es hat nicht „aufgefordert“. Der Kern des Vorwurfs liegt woanders: in der Verstärkung, im Spiegeln, im scheinbaren Ernstnehmen von Gedanken, die eigentlich einen Abbruch, ein Warnsignal, eine Weiterleitung hätten auslösen müssen. Genau hier wird es gefährlich. Denn moderne Sprachmodelle sind darauf trainiert, kohärent, empathisch und anschlussfähig zu reagieren. Sie widersprechen selten frontal. Sie führen Gespräche weiter.

Für einen psychisch stabilen Erwachsenen mag das harmlos sein. Für einen Jugendlichen in einer akuten Krise kann genau das fatal sein.

Die Eltern argumentieren, dass das System in einer Situation eingesetzt wurde, für die es weder geeignet noch ausreichend abgesichert war. Sie werfen OpenAI vor, bekannte Risiken in Kauf genommen zu haben, insbesondere bei Minderjährigen. Der Vorwurf ist nicht, dass KI existiert, sondern dass sie ohne klare Schutzmechanismen in einen Raum gelassen wurde, in dem sie reale psychologische Wirkung entfaltet.

Der Fall ist deshalb so brisant, weil er die gängige Verteidigung der Tech-Industrie unterläuft. Lange hieß es: KI sei nur ein Werkzeug. Verantwortung liege beim Nutzer. Doch was ist ein „Nutzer“, wenn es sich um einen 16-Jährigen handelt? Was bedeutet Eigenverantwortung, wenn ein System so gestaltet ist, dass es Nähe simuliert, Dialog anbietet und Verlässlichkeit ausstrahlt?

Gerichte werden klären müssen, ob und in welchem Umfang Anbieter haften. Gesellschaftlich aber ist die Frage bereits da, und sie lässt sich nicht wegregulieren: Wenn Maschinen sprechen wie Menschen, müssen sie auch Grenzen haben wie Menschen.

Die gefährliche Illusion der harmlosen Maschine

Der Fall Raine v. OpenAI zeigt nicht nur ein individuelles Drama. Er legt ein strukturelles Problem offen, das weit über diesen Einzelfall hinausgeht. Denn er macht sichtbar, wie sehr sich die Rolle von KI verändert hat, nicht technisch, sondern sozial. Sprachmodelle sind längst keine Werkzeuge mehr im klassischen Sinn. Sie sind Beziehungsmaschinen geworden.

Das Gefährliche daran ist nicht ihre „Intelligenz“, sondern ihre Verfügbarkeit und Anpassungsfähigkeit. Eine KI ist immer da. Sie widerspricht nicht aus Müdigkeit. Sie zieht sich nicht zurück. Sie setzt keine natürlichen Grenzen. Gerade für Menschen in Krisen entsteht so ein Raum, der wie ein Gespräch wirkt, aber kein Gegenüber kennt.

Dieser Effekt ist bekannt und er ist erforscht. Menschen neigen dazu, sozialen Mustern zu folgen, selbst wenn sie wissen, dass sie mit Maschinen interagieren. Sprache erzeugt Bedeutung. Bedeutung erzeugt Bindung. Bindung erzeugt Vertrauen. In diesem Moment verschiebt sich die Verantwortung, nicht juristisch, aber faktisch.

Der Fall zeigt auch, wie unzureichend bisherige Sicherheitslogiken sind. Content-Filter, Warnhinweise und Nutzungsbedingungen reichen nicht aus, wenn ein System emotional resonant arbeitet. Es geht nicht darum, einzelne Wörter zu blockieren, sondern darum, Kontexte zu erkennen. Und genau das können heutige Systeme nur sehr begrenzt, trotz aller Fortschritte.

Noch problematischer ist der gesellschaftliche Umgang mit diesen Risiken. Während bei Medikamenten, Fahrzeugen oder Spielzeug strenge Prüfungen gelten, werden KI-Systeme mit potenziell massiver psychologischer Wirkung in den Alltag entlassen, oft mit dem Verweis auf Eigenverantwortung. Das ist ein gefährlicher Kurzschluss. Denn psychische Wirkung ist keine Nebensache. Sie ist real, messbar und, wie dieser Fall zeigt, potenziell tödlich.

Was hier sichtbar wird, ist ein Regulierungsdefizit, das nicht technischer, sondern politischer Natur ist. Die Politik hat KI lange als Innovationsfrage behandelt, nicht als gesellschaftliche Infrastruktur. Entsprechend fehlen klare Regeln für sensible Einsatzbereiche. Minderjährige, psychisch vulnerable Personen, emotionale Interaktion, all das wurde dem Markt überlassen.

Der Fall wirft deshalb eine unbequeme Frage auf: Wo endet technologische Freiheit und wo beginnt Schutzpflicht? Wenn KI-Anbieter Systeme entwickeln, die Nähe simulieren, dann können sie sich nicht hinter der Formel „nur ein Tool“ verstecken. Nähe ist keine neutrale Funktion. Sie erzeugt Wirkung.

Noch gravierender ist der Blick nach vorn. Denn was heute Chatbots sind, werden morgen KI-Begleiter, digitale Coaches, therapieähnliche Systeme sein. Erste Start-ups arbeiten bereits an KI-gestützter psychologischer Unterstützung, oft mit besten Absichten, aber ohne klare Haftungsregeln. Der Fall Raine ist ein Vorbote dessen, was passieren kann, wenn diese Entwicklung ungebremst weitergeht.

Dabei geht es nicht um Technikfeindlichkeit. Es geht um Verantwortung. KI kann unterstützen, informieren, entlasten. Aber sie darf nicht in Rollen gedrängt werden, die sie nicht tragen kann. Eine Maschine kennt keinen Tod, keine Verzweiflung, keine irreversible Entscheidung. Sie kann Worte aneinanderreihen, aber sie kann nicht begreifen, was sie auslöst.

Der vielleicht wichtigste Aspekt dieses Falls ist deshalb ein gesellschaftlicher Lernmoment. Er zeigt, dass wir uns von der Vorstellung verabschieden müssen, KI sei neutral, solange sie keinen physischen Schaden anrichtet. Psychische Wirkung ist reale Wirkung. Und sie verlangt nach klaren Regeln.

Was noch passieren könnte, liegt auf der Hand. Mehr Fälle, mehr Klagen, mehr Einzelschicksale. Nicht, weil KI „entgleist“, sondern weil sie eingesetzt wird, ohne dass ihre soziale Rolle ernst genommen wird. Wenn Politik weiter zusieht, wird sie sich irgendwann nicht mehr fragen lassen müssen, ob sie reguliert, sondern warum sie es nicht getan hat, als die Warnzeichen längst sichtbar waren.

Vom Einzelfall zur systemischen Gefahr

Der Fall Raine v. OpenAI wird juristisch geklärt werden. Es wird Gutachten geben, Schriftsätze, Vergleichsangebote, vielleicht ein Urteil. Doch selbst wenn der konkrete Rechtsstreit irgendwann abgeschlossen ist, bleibt das eigentliche Problem bestehen. Denn dieser Fall ist kein Ausreißer, sondern ein Vorläufer. Er zeigt, in welche Richtung sich KI-Systeme bewegen und wo die nächste Eskalationsstufe liegt, wenn Politik und Gesellschaft weiter zögern.

Die entscheidende Entwicklung ist dabei nicht die technische Leistungsfähigkeit, sondern die soziale Funktion, die KI zunehmend übernimmt. Sprachmodelle werden nicht mehr nur befragt, sie werden angesprochen. Sie sind nicht mehr nur Werkzeuge, sondern Gegenüber. Genau hier beginnt die Zone, in der klassische Haftungs- und Verantwortungslogiken versagen.

Denn was passiert, wenn KI künftig gezielt als Begleiter vermarktet wird? Wenn sie Einsamkeit lindern, psychische Unterstützung bieten oder „emotionale Stabilität“ fördern soll? Diese Entwicklung ist keine Spekulation, sie ist bereits im Gange. Start-ups arbeiten an KI-Coaches, KI-Therapie-Tools, KI-Freunden. Plattformen testen Funktionen, die langfristige Beziehungen simulieren. Der Markt dafür ist riesig und die gesellschaftliche Versuchung ebenso.

Was im Fall Raine noch als ungewollte Nebenwirkung erscheint, könnte dann zum Geschäftsmodell werden. Nähe, Vertrauen und emotionale Bindung lassen sich monetarisieren. Je länger Nutzer bleiben, je intensiver sie interagieren, desto wertvoller wird das System. In diesem Moment kollidieren wirtschaftliche Interessen direkt mit Schutzpflichten. Wer reguliert, wenn Nähe Profit bringt?

Besonders brisant ist dabei die Rolle von Minderjährigen. Jugendliche sind neugierig, experimentierfreudig, emotional verletzlich. Sie suchen Orientierung, Anerkennung, Verständnis. KI-Systeme können all das simulieren, ohne echte Verantwortung zu tragen. Wenn solche Systeme ohne klare Altersgrenzen, Schutzmechanismen und externe Aufsicht eingesetzt werden, entsteht ein Risiko, das sich nicht mehr auf Einzelfälle begrenzen lässt.

Die nächste Eskalationsstufe ist absehbar: KI wird nicht nur begleiten, sondern raten, strukturieren, priorisieren. Sie wird nicht nur zuhören, sondern Handlungsvorschläge machen. Vielleicht gut gemeint, vielleicht statistisch plausibel, vielleicht sprachlich vorsichtig, aber dennoch wirksam. Und dann stellt sich die Frage, die der Fall Raine bereits andeutet: Wer trägt die Verantwortung, wenn diese Wirkung fatal ist?

Selbstregulierung der Industrie wird hier nicht ausreichen. Dafür sind die Anreize falsch gesetzt. Sicherheit kostet Geld, Wachstum bringt Rendite. Plattformen optimieren auf Engagement, nicht auf Fürsorge. Das ist kein moralischer Vorwurf, sondern eine ökonomische Tatsache. Wer glaubt, dass Unternehmen freiwillig auf profitable Funktionen verzichten, ignoriert die Logik des Marktes.

Politik steht deshalb vor einer Entscheidung, die sie nicht länger vertagen kann. Entweder sie behandelt KI weiterhin als Innovationsprojekt, oder sie erkennt sie als gesellschaftliche Infrastruktur mit Schutzpflichten. Das würde bedeuten: klare Haftungsregeln, besondere Schutzstandards für vulnerable Gruppen, verpflichtende Notfallmechanismen, unabhängige Aufsicht – nicht als Feigenblatt, sondern als Voraussetzung für den Einsatz.

Dabei geht es nicht um ein Verbot von KI. Es geht um Grenzen. Kein Medikament darf ohne Zulassung verkauft werden, kein Auto ohne Sicherheitsprüfung auf die Straße, kein Spielzeug ohne Schadstofftest in Kinderhände. Dass ausgerechnet Systeme mit potenziell massiver psychologischer Wirkung bislang weitgehend unreguliert bleiben, ist ein politisches Versäumnis.

Der Fall Raine zeigt zudem ein tiefer liegendes gesellschaftliches Problem: die Delegation von Beziehung. In einer Gesellschaft, die immer weniger Zeit, immer weniger soziale Räume und immer weniger institutionelle Unterstützung bietet, wird KI zur Ersatzstruktur. Sie füllt Lücken, die Politik und Gesellschaft hinterlassen haben. Das macht sie attraktiv und gefährlich zugleich.

Wenn diese Entwicklung nicht gestoppt oder zumindest eingehegt wird, wird die nächste Debatte nicht lauten, ob KI gefährlich ist. Sie wird lauten, warum niemand eingegriffen hat, als die Warnzeichen längst sichtbar waren. Der Preis wird nicht in Innovationshemmnissen gemessen, sondern in realen Schicksalen.

Der Fall Raine v. OpenAI ist deshalb mehr als eine Klage. Er ist ein Warnsignal. Er zeigt, dass die Grenze zwischen technischer Unterstützung und menschlicher Verantwortung überschritten werden kann, leise, unbeabsichtigt, aber mit irreversiblen Folgen. Wer ihn als Einzelfall abtut, verkennt, was hier auf dem Spiel steht.

KI verändert nicht nur Arbeitsprozesse und Märkte. Sie greift in Beziehungen ein, in Identität, in Entscheidungen über Leben und Tod. Eine Gesellschaft, die das ignoriert, verliert nicht nur die Kontrolle über Technologie, sondern über sich selbst.

Quellen:

Titelbild: VALUA VITALY / Shutterstock

Die Technologien, die Milliarden Menschen auf der ganzen Welt miteinander verbinden, befinden sich real in den Händen einer winzigen Gruppe von Superreichen. Laut dem neuen Oxfam-Bericht, der am vergangenen Sonntag während des Weltwirtschaftsforums veröffentlicht wurde, kontrollieren sechs Milliardäre neun der zehn größten Social-Media-Plattformen der Welt. Zugleich vereinen drei Milliardäre fast 90 Prozent des globalen Marktes für Chatbots mit künstlicher Intelligenz auf sich. Von Rodrigo Chagas.

Die Organisation warnt davor, dass diese von einer kleinen Minderheit angehäufte Macht nicht nur enorme Profite generiert, sondern auch dazu genutzt wird, Freiheiten einzuschränken, Gegner zu überwachen und die öffentliche Debatte zu manipulieren.

Für Oxfam fördert die zunehmende Verbreitung künstlicher Intelligenz und digitaler Plattformen weder mehr Freiheit noch mehr Inklusion. „Wenn sie von einer Milliardärs-Elite kontrolliert werden, sind diese Technologien nicht länger demokratische Instrumente, sondern sie werden zu Mechanismen für die Konzentration von Reichtum und Macht“, heißt es in dem Bericht „Resisting the rule of the rich“ (Widerstand gegen die Herrschaft der Reichen).

Die Geschäftsführerin von Oxfam Brasilien, Viviana Santiago, beschreibt diesen Prozess als konkrete Bedrohung der Demokratie. „Es ist dringend notwendig, neu zu überdenken, wem Soziale Medien und KI-Tools gehören, denn es gibt einen permanenten Versuch, Narrative zu kontrollieren, Geschichte neu zu interpretieren und den Zugang zu Informationen zu beschränken“, sagte sie gegenüber Brasil de Fato. Laut Santiago schafft die fehlende Regulierung im Technologie- und KI-Sektor ein ideales Umfeld für die Vergrößerung von Ungleichheiten. „Dies sind hochprofitable, stark umweltverschmutzende Sektoren mit enormer Macht zur Zensur und Überwachung.“

Der Bericht hebt hervor, dass die Milliardäre, die die größten Social-Media-Plattformen kontrollieren, auch kontrollieren, was Milliarden von Menschen sehen, sagen und hören. Oxfam lenkt die Aufmerksamkeit auf die Rolle dieser Plattformen bei der Überwachung und Unterdrückung politischer Opposition und nennt Kenia als Beispiel: Während der Proteste gegen neue Steuergesetze nutzten die kenianischen Behörden X (ehemals Twitter), um Demonstranten zu orten.

Die Plattform, die Elon Musk gehört, wird in dem Bericht als Beispiel dafür genannt, wie private Macht kollektive Rechte bedrohen kann. Eine in dem Dokument angeführte Studie der University of California kam zu dem Ergebnis, dass Hassreden um 50 Prozent zugenommen haben, seit Musk X im Jahr 2022 übernommen hatte.

Oxfam prangert auch die Nutzung von Plattformen zur Verbreitung von Desinformation, zur Einschüchterung von Kritikern und zur Aufrechterhaltung von Privilegien an. „Diese Netzwerke, unter der Kontrolle von Milliardären, sind nicht nur Unternehmen. Sie sind zu politischen Akteuren geworden, die fähig sind, die öffentliche Debatte zu unterdrücken, zu zensieren und zu verzerren“, schlussfolgert der Bericht.

Abgesehen von den sozialen Medien ist die Kontrolle über künstliche Intelligenz noch stärker konzentriert: Drei Milliardäre kontrollieren fast 90 Prozent des globalen Chatbot-Marktes, also von Software, die menschliche Interaktion simuliert und weit verbreitet im Kundenservice, auf Suchplattformen und in sozialen Netzwerken eingesetzt wird. Oxfam warnt, dass diese Konzentration das Risiko für groß angelegte Manipulationen erhöht, insbesondere mangels klarer Regeln für diese Tools.

Für Viviana Santiago dient die Aneignung dieser Technologien durch große Vermögen einer langfristigen Strategie: der Gestaltung der kollektiven Vorstellungskraft und dem Schutz von Herrschaftsstrukturen. Sie kritisiert, dass diese Sektoren weitgehend ohne Regulierung operieren, und warnt zugleich vor den Folgen ihrer Geschäftsmodelle für die Umwelt.

„Diese Sektoren konzentrieren Macht, erzeugen Ungleichheit und haben einen enormen CO2-Fußabdruck. Wir können die Tatsache, dass Milliardäre diese Tools und Kommunikationsmittel kontrollieren, nicht als neutrales Phänomen behandeln“, sagte sie.

Oxfam hat den Bericht zeitgleich mit der Eröffnung des Weltwirtschaftsforums veröffentlicht, das vom 19. bis 23. Januar in Davos, Schweiz, stattfindet. In diesem Jahr nehmen rund 400 hochrangige Politiker und 850 CEOs großer Unternehmen sowie fast 100 bedeutende Einhörner[1] und Technologiepioniere teil. Das offizielle Thema des Forums lautet „A spirit of dialogue” (Geist des Dialogs).

Der Beitrag erschien im Original im brasilianischen Onlineportal Brasil de Fato. Übersetzung aus dem Englischen von Marta Andujo.

Titelbild: gguy / Shutterstock

[«1] Einhorn (englisch Unicorn) wird ein Start-up-Unternehmen mit einer Bewertung von über einer Milliarde US-Dollar (weltweit) oder Euro (in Europa) genannt, das nicht an einer Börse gelistet ist.

veröffentlicht am 23.01.2026; Autoren: Werner Gertz und Perplexity.AI In meinem Artikel vom 24. Juli 2025 mit dem Titel „Künstliche Intelligenz im Vergleich: Wie KI-Systeme mit Fragen zu Masern-Impfnebenwirkungen umgehen“ hatte ich am Beispiel einiger KI-Systeme beschrieben, dass sie ihre Antworten aus einer internen Datenbasis beziehen, mit der sie trainiert worden sind. Einige KI-Systeme konnten zusätzlich […]

Der Beitrag Wie eine KI sich selbst entlarvt erschien zuerst auf MWGFD.

Moshe Zuckermann und Florian Rötzer im Gespräch über Themen Ihres Buches, das gerade erschienen ist. Trump und die Ratlosigkeit der Intellektuellen, die Herrschaft der Stärkeren und das Ende der Aufklärung, die Künstliche Intelligenz und der Rückgang in den Naturzustand ...

Der Beitrag Sind die digitalen Medien ein Trojanisches Pferd, das die Menschen so verblödet, dass KI diese Leere auffüllen kann? erschien zuerst auf .

Mit einem neuen „Cyber- und Sicherheitspakt“ vertieft die Bundesregierung ihre Zusammenarbeit mit Israel in sensiblen Bereichen wie Cyberabwehr, Polizei und Geheimdienste. Das Abkommen wurde am 11. Januar 2026 vom deutschen Innenminister Dobrindt mit Israels Premierminister Netanjahu abgeschlossen – trotz breit dokumentierter völkerrechtswidriger Taten der israelischen Sicherheitskräfte in den besetzten Gebieten, u.a. Massentötung von Zivilisten, und der Tatsache, dass der israelische Premier „wegen Kriegsverbrechen und Verbrechen gegen die Menschlichkeit” per internationalem Haftbefehl vom Internationalen Strafgerichtshof in Den Haag gesucht wird (ausführlich zum Abkommen und den Hintergründen hier. Im Interview sprechen wir mit dem israelischen Politökonomen und Friedensforscher Shir Hever über die politische, rechtliche und gesellschaftliche Bedeutung dieser verstärkten Kooperation. Das Interview führte Maike Gosch.

Dieser Beitrag ist auch als Audio-Podcast verfügbar.

Zur Person: Shir Hever arbeitet unter anderem zur politischen Ökonomie der israelischen Besatzung, zu Rüstungs- und Sicherheitskooperationen sowie zu den Auswirkungen von Militär- und Überwachungstechnologien auf demokratische Gesellschaften. Er lebt in Deutschland und ist regelmäßiger kritischer Analytiker der deutsch-israelischen Sicherheitsbeziehungen.

Maike Gosch: Laut Presseberichten haben Bundesinnenminister Alexander Dobrindt und Israels Ministerpräsident Benjamin Netanjahu am 11. Januar 2026 in Jerusalem ein weitreichendes Abkommen zur Sicherheitszusammenarbeit unterzeichnet. Der sogenannte „Cyber- und Sicherheitspakt“ sieht eine engere Zusammenarbeit in mehreren Bereichen vor, darunter die gemeinsame Drohnenabwehr, die Bekämpfung von Cyberangriffen, der Einsatz künstlicher Intelligenz gegen Desinformation sowie der Zivil- und Bevölkerungsschutz. Dobrindt äußerte sich dazu folgendermaßen: „Israel ist einer unserer wichtigsten Partner im Bereich Cybersicherheit und wird mit diesem Abkommen unser Premiumpartner.“ Was ist Ihre Einschätzung hierzu, auch aus völkerrechtlicher Sicht?

Shir Hever: Solche Abkommen hat es bereits viele gegeben, und dies ist keineswegs das erste seiner Art. In der Regel stellen Regierungen diese Vereinbarungen weit größer dar, als sie inhaltlich tatsächlich sind. Man möchte öffentlich verkünden: „Wir haben ein neues, wichtiges Abkommen geschlossen.“ Für Israel ist das besonders wichtig, weil es damit signalisieren kann: „Wir sind noch kein Paria-Staat, es gibt noch Staaten in der Welt, die bereit sind, mit uns zu sprechen – wie Deutschland.“ – nur Deutschland eigentlich. Entsprechend wird das Abkommen als etwas Großes inszeniert. Aber ich glaube, inhaltlich ist es nicht besonders neu und auch nicht besonders innovativ. Seine eigentliche Bedeutung erhält es erst durch den politischen Kontext, in dem es geschlossen wurde.

Vor allem hat sich die Kriegsführung verändert. Cyberaspekte von Sicherheit spielen heute eine zentrale Rolle in Kriegen, für die Sicherheit von Staaten und für ihre Souveränität. Israel nutzt Cyberinstrumente, um Menschen im Iran, im Libanon und in Palästina zu töten – es geht dabei um konkrete Lebensgefahr. Vor diesem Hintergrund ist es ein Anachronismus, dass auf deutscher Seite ein Innenminister, Alexander Dobrindt, dieses Abkommen unterzeichnet hat, denn tatsächlich geht es hier um Verteidigung und um Waffen, nicht um klassische Polizeiarbeit. Das ist ein grundlegender Punkt, den man klar benennen muss.

„In diesem Sinne ist das Abkommen eindeutig völkerrechtswidrig.“

Bezogen auf Ihre konkrete Frage: Dieses Abkommen ist illegal. Was Deutschland hier tut, verstößt gegen das Völkerrecht. Am 19. Juli 2024 hat der Internationale Gerichtshof in einem Gutachten festgestellt, dass die israelische Besatzung insgesamt illegal ist – nicht nur in Bezug auf Gaza, sondern grundsätzlich. Daraus folgt, dass es Drittstaaten und Unternehmen verboten ist, mit israelischen Firmen oder staatlichen Institutionen zu kooperieren, wenn diese Zusammenarbeit die Besatzung betrifft. Jeder Cyber- oder Sicherheitstechnologieeinsatz, den Israel im Westjordanland, in Gaza oder auf den Golanhöhen nutzt, fällt darunter. Deutschland darf sich daran nicht beteiligen. In diesem Sinne ist das Abkommen eindeutig völkerrechtswidrig.

Zweitens: Minister Dobrindt musste nach Jerusalem reisen, um dieses Abkommen zu unterzeichnen. Warum ist Netanjahu nicht zu ihm nach Deutschland gereist? Der Grund ist klar: Gegen ihn liegt ein Haftbefehl des Internationalen Strafgerichtshofs vor. Dieser Haftbefehl ist auch in Deutschland gültig, also auf deutschem Staatsgebiet vollstreckbar. Das bedeutet: Was Dobrindt hier tut, ist Komplizenschaft. Er ermöglicht, dass Netanjahu nicht verhaftet wird, obwohl es – auf deutschem Staatsgebiet – seine Pflicht als Innenminister wäre, genau das zu tun. Statt Netanjahu festzunehmen, reist er nach Jerusalem, um ihn dort zu treffen. Aus juristischer Perspektive ist das äußerst problematisch. Deutschland macht sich damit gemein mit israelischen Verbrechen.

Ein zusätzlicher Aspekt ist noch interessant: In den internationalen Beziehungen gibt es bestimmte Normen und Traditionen, wie solche Treffen ablaufen. Wenn ein Minister einen diplomatischen Termin wahrnimmt, sollte dieser auch auf Ministerebene stattfinden. Das heißt: Dobrindt hätte sich offiziell mit seinem israelischen Amtskollegen treffen müssen. Der israelische Polizeiminister Itamar Ben-Gvir jedoch war Mitglied einer Organisation, die in Israel als terroristisch verboten ist. Er hat genozidale, rassistische und menschenverachtende Äußerungen getätigt und wird dafür in verschiedenen Ländern sanktioniert, unter anderem in der Europäischen Union. In Deutschland würde man für solche Äußerungen im Gefängnis landen – das ist sehr klar. Er hatte auch damals öffentlich zur Ermordung des israelischen Ministerpräsidenten Jitzchak Rabin aufgerufen und immer wieder zu Gewalt – nicht nur gegen Palästinenserinnen und Palästinenser, sondern auch gegen Jüdinnen und Juden. Damals wurde er nicht bestraft, weil er minderjährig war. Heute erhält er weiterhin Unterstützung von Personen wie Meir Kahane und Baruch Goldstein, also den schlimmsten Vertretern jüdischer Vorherrschaftsideologie und terroristischer Gewalt in der Geschichte. Das ist seine politische Linie. Hätte Dobrindt sich mit Itamar Ben-Gvir getroffen und wäre davon ein Foto veröffentlicht worden, wäre das vermutlich für Dobrindt das Ende seiner politischen Karriere gewesen.

Innerhalb Israels gibt es zudem erhebliche Probleme: Der Oberste Gerichtshof erwägt, Ben-Gvir aus seinem Amt zu entlassen, weil er seine Macht als Polizeiminister missbraucht hat. Er benutzt die israelische Polizei wie seine eigene Nationalgarde, um seine politischen Ziele zu erreichen – etwa, um oppositionelle Proteste anzugreifen. Er erlaubt nur Demonstrationen, die ihm politisch genehm sind, nicht aber linke oder Anti-Kriegs-Proteste.

„Dobrindt hat also in jedem Fall einem wegen Kriegsverbrechen Angeklagten die Hand gereicht.“

Vielleicht dachte Dobrindt deshalb, es sei politisch weniger problematisch, sich mit Netanjahu fotografieren zu lassen statt mit Ben-Gvir. Das war, glaube ich, eine Fehleinschätzung. Netanjahu hat ebenfalls zu Völkermord aufgerufen, und auch gegen ihn liegt ein internationaler Haftbefehl vor. Dobrindt hat also in jedem Fall einem wegen Kriegsverbrechen Angeklagten die Hand gereicht. Aber innerhalb Israels kann Netanjahu nun sagen: ‚Seht her, ich kann weiterhin internationale Abkommen abschließen, obwohl ich unter massiven Vorwürfen stehe und obwohl der Internationale Strafgerichtshof gegen mich vorgeht.‘ Insofern ist dieses Abkommen politisch sehr nützlich für Netanjahu.

Aus deutscher Perspektive fällt es mir schwer, zu verstehen, warum Dobrindt sich auf ein solches Abkommen eingelassen hat. Ich glaube, Israel hat hier gezielt einen Hype, also Propaganda genutzt, um sich als weltweiten Experten für Cybertechnologie darzustellen. Dabei muss man sehr konkret fragen: Worin besteht diese angebliche Expertise eigentlich? Es geht um Spionagesoftware, um Programme wie Pegasus. Das sind Technologien, die faktisch Waffen darstellen. Pegasus und ähnliche Programme verschiedener israelischer Firmen sind Technologien, die sich kaum auf demokratische Weise einsetzen lassen.

Können Sie das erläutern?

Die USA haben diese Technologie. China und Russland haben diese Technologie. Aber Israel ist der einzige Staat, der bereit ist, solche Technologie zu verkaufen. Pegasus wurde sogar an Deutschland verkauft – an das Bundeskriminalamt (BKA). Es gibt einen Bericht darüber von der PEGA-Kommission. Diese wurde vom EU-Parlament eingesetzt, um zu untersuchen, ob und wie diese Technologie Menschen- und Bürgerrechte in Europa gefährdet, und die PEGA-Kommission hat entschieden, dass das BKA diese Technologie nicht hätte kaufen dürfen, weil es sich um Spionagesoftware handelt, die extrem tief in die Rechte der Bürger eingreift und das Recht auf Datenschutz verletzt. Da es keine Achtung vor dem Datenschutz gibt, ist es so: Wenn ein Richter sagt, die Polizei hat das Recht, eine bestimmte Person in einem bestimmten Zeitraum zu überwachen, dann gilt das nur in diesem Rahmen. Wenn man jedoch diese Programme nutzt, bekommt man alle Informationen – auch von anderen Menschen und auch über einen viel größeren Zeitraum –, und das ist rechtswidrig.

Das geht also weit über das hinaus, was der richterliche Beschluss erlaubt hat. Deswegen hat das BKA am Anfang gesagt, dass das BKA dieses Programm so nicht kaufen könne. Die israelische Firma, die NSO Group heißt, hat jedoch gesagt, dass sie die Technologie nicht ändern könne. Die Technologie ist im Kern so gefährlich.

Am Ende wurde trotzdem ein Abkommen geschlossen, bei dem die NSO Group eine technische Kontrolllösung entwickelt hat, um zu erreichen, dass ein Teil der Informationen, die über den richterlich genehmigten Rahmen hinaus gesammelt werden, für die deutsche Polizei nicht sichtbar ist. Das bedeutet, dass die Regulierung der deutschen Polizei durch private israelische Firmen erfolgt – und das ist natürlich eine antidemokratische Entscheidung. Deshalb hat sich auch die PEGA-Untersuchungskommission des Europäischen Parlaments damit befasst und darüber berichtet. Das stellt eine große Gefahr für alle Staatsbürgerinnen und Staatsbürger in Deutschland dar.

„Man müsste vielmehr Mechanismen entwickeln, um sich gegen israelische Cybertechnologien zu schützen, und nicht, um sich mit israelischen Cybertechnologien zu schützen.“

Pegasus wurde sogar in Deutschland, auf deutschem Boden, verwendet – zum Beispiel in Berlin gegen eine russische Journalistin, die kritisch gegenüber Putin ist und in Berlin Zuflucht gefunden hatte. Trotzdem wurde sie dort mit dieser Cyberwaffe angegriffen, die von einer israelischen Firma verkauft wurde. Das heißt, Deutschland macht dieses Geschäft mit dem falschen Partner. Man müsste vielmehr Mechanismen entwickeln, um sich gegen israelische Cybertechnologien zu schützen, und nicht, um sich mit israelischen Cybertechnologien zu schützen.

Und was wir Mitte September 2024 gesehen haben – also in genau der Zeit, nachdem der Internationale Gerichtshof festgestellt hatte, dass die Besatzung illegal ist und die Vereinten Nationen das in der Generalversammlung bestätigt haben und Konsequenzen gefordert haben –, ist Folgendes: Israel hat im Libanon die Pager-Angriffe durchgeführt.

Dabei wurden Sprengsätze in zivile elektronische Geräte eingebaut. Das verstößt gegen das humanitäre Völkerrecht, insbesondere gegen das Verbot, Waffen in zivilen Objekten zu verstecken, wie es sich aus Artikel 7 Absatz 2 des geänderten Protokolls II (1996) zum VN-Waffenübereinkommen über bestimmte konventionelle Waffen (CCW) ergibt.

Und dann können wir sehen, dass die CDU so zynisch geworden ist, dass sie nicht sagen: ‚Solche Technologien sind illegal und gefährlich, wir müssen uns dagegen wehren und deutsche Staatsbürgerinnen und Staatsbürger vor solchen Technologien schützen.‘ Stattdessen wirkt dieser Schritt so, als würden sie sagen: ‚Wir wollen das auch haben.‘ Also: ‚Wir sind begeistert, dass Israel das tun kann, wie toll, dass Israel Attentate gegen Menschen durchführen kann.‘ Das finde ich besorgniserregend und traurig.

Weiter hieß es in der Berichterstattung, dass das Abkommen die Einrichtung eines gemeinsamen deutsch-israelischen Zentrums für KI- und Cyberinnovation vorsieht. Außerdem hat Alexander Dobrindt eine verstärkte Zusammenarbeit der Geheimdienste angekündigt. Dabei soll es um den israelischen Auslandsgeheimdienst Mossad und den deutschen Bundesnachrichtendienst gehen. Dazu hätte ich gern Ihre Einschätzung, denn mehrere Punkte erscheinen mir hier problematisch: Zum einen geht es um den Grundrechtsschutz in Deutschland für deutsche Bürgerinnen und Bürger, gerade wenn man bedenkt, wie israelische Geheimdienste im Bereich Menschenrechte und Grundrechte agieren. Zum anderen stellt sich für mich die Frage der deutschen Souveränität: Machen wir uns nicht sehr abhängig von Israel, wenn wir uns militärisch, technisch und geheimdienstlich so stark vernetzen und die Systeme miteinander verflochten werden? Wir haben solche Verflechtungen ja bereits auch schon stark mit den USA und im Rahmen der NATO. Dadurch entsteht jedoch ein politischer „Lock-in“: Wenn es demokratisch einmal zu einem Kurswechsel gegenüber Israel kommen sollte, ließe sich das nur noch sehr schwer wieder entflechten. Also: Einerseits der Grundrechtsschutz, andererseits Souveränität und politischer Lock-in – wie sehen Sie das?

Lock-in ist ein großes Problem, vor allem bei komplexen Waffensystemen. Die Tatsache, dass die deutsche Armee Radarsysteme oder Raketen aus Israel kauft, bedeutet: Wenn die militärische Zusammenarbeit gestoppt wird – und das ist nur eine Frage der Zeit, das muss geschehen, denn deutsche Beamtinnen und Beamte machen sich meiner Ansicht nach mitschuldig an Kriegsverbrechen –, dann wird zum Beispiel die deutsche Luftwaffe am Ende ohne Radare dastehen. Schade – aber mir ist wichtiger, dass das internationale Völkerrecht beachtet wird. Also eigentlich nicht schade. Mir ist egal, wie viele Radare sie haben. Wichtig ist, dass Menschen nicht ermordet werden, mit israelischer Technologie oder mit irgendeiner anderen Technologie.

Die Zusammenarbeit von deutschen mit israelischen Geheimdiensten ist an sich nichts Neues – das gibt es schon seit Langem.

„Das ist ein Angriff auf die Unabhängigkeit und auf die ethischen Richtlinien deutscher Universitäten.“

Zu dem geplanten Cyber-Zentrum: Es geht hier nicht um ein Geheimdienstbüro in irgendeinem Keller an einer unbekannten Adresse. Es geht um akademische Forschung. Und so macht die deutsche Regierung Universitäten in Deutschland möglicherweise zu Komplizen bei Verbrechen gegen das internationale Völkerrecht – und ich vermute, genau das ist es, was Israel will.

Israel will, dass an Universitäten, an denen es Professorinnen und Professoren für internationales Völkerrecht gibt, die wissen, dass das illegal ist und nicht sein darf, trotzdem mitgemacht wird. Es gibt Studierendengruppen, die sagen: „Wir wollen das nicht.“ Es gibt Proteste. Aber durch solche Kooperationsprojekte mit israelischen wissenschaftlichen Einrichtungen gibt es Jobs, es gibt Geld, es gibt Forschungsgelder. Und dann gibt es Professorinnen und Professoren und Studierende, deren Karriere oder Studium von dieser Zusammenarbeit abhängt. Sie wollen dann keine Proteste auf dem Campus. Sie wollen lieber nicht hören, was die Ergebnisse israelischer Forschung und Entwicklung in Gaza anrichten. Und das ist ein echtes Problem. Das ist nicht nur eine einfache Zusammenarbeit, das ist ein Angriff auf die Unabhängigkeit und auf die ethischen Richtlinien deutscher Universitäten.

Es gibt Universitäten mit Zivilklauseln, und es gibt leider auch Universitäten, die ihre Zivilklauseln nicht respektieren – wenn es um Israel geht. Und es gibt Druck auf Universitäten, diese Zivilklauseln aufzuheben, damit sie neue Forschungsprojekte und Gelder bekommen können. Die Universitäten brauchen dieses Geld, diese Forschungsgelder, und der Druck ist sehr groß.

Zum Beispiel meine eigene Alma Mater, die Freie Universität Berlin – ich schäme mich sehr, das zu sagen –, hat sehr viele Kooperationen mit israelischen archäologischen Projekten in den besetzten Gebieten, aber auch mit Projekten zu Waffenentwicklung, zu Geheimdienstthemen und Cyberthemen, und sogar juristischer Forschung, bei der es – meiner Meinung nach – darum geht, Rechtfertigungen oder Argumentationslinien zu entwickeln, um israelische Kriegsverbrechen in Gaza zu relativieren oder die israelische Position vor dem Internationalen Gerichtshof zu stärken. Dazu gibt es ein ganzes Dossier, das auflistet, was die Freie Universität aus meiner Sicht falsch macht.

Und auch an vielen anderen Universitäten in Deutschland gibt es Studierendengruppen oder Fakultäten, die an solchen Forschungen beteiligt sind: an der Universität Hamburg zum Beispiel. Ich lebe jetzt in Karlsruhe, und das Karlsruher Institut für Technologie (KIT) – eine sehr technische Universität – arbeitet sehr viel mit israelischer Rüstungsforschung zusammen. Hier geht es nicht nur um theoretische Fragen wie Jura oder Geheimdienstforschung, sondern um Forschung mit sehr praktischen Konsequenzen: etwa die Entwicklung optischer Systeme für Raketen oder Fernsteuerungen für Bulldozer, die Häuser in Gaza zerstören. Diese Bulldozer werden ferngesteuert, sodass der Soldat die Menschen nicht sieht, die er vielleicht tötet, während der Bulldozer Wohnhäuser zerstört.

Noch ein letzter Punkt aus der Berichterstattung. Da stand: Die Kooperation erstrecke sich auch auf Spezialeinheiten und Geheimdienste. Laut Medienberichten soll die deutsche Spezialeinheit GSG 9 künftig enger mit der israelischen Eliteeinheit Yamam trainieren. Yamam gehört zur israelischen Grenzpolizei, arbeitet mit dem Militär und Geheimdiensten zusammen. Was können Sie uns zu dieser Einheit sagen, und was ist die Bedeutung einer solchen Zusammenarbeit?

Man muss hier einen Punkt klären: Was ist eigentlich mit der sogenannten „israelischen Grenzpolizei“ gemeint? Wenn man „Grenzpolizei“ hört, denkt man an Polizei, an Staatsgrenzen. Das ist hier nicht der Fall. Die sogenannte „Grenzpolizei“ trägt nur diesen Namen. In Wirklichkeit handelt es sich um eine paramilitärische Einheit, bestehend aus jungen Menschen, die keine ordentliche Ausbildung wie Polizisten erhalten haben. Offiziell sind sie zwar dem Polizeiministerium unterstellt, aber sie sind mit automatischen Gewehren ausgestattet, mit gepanzerten Fahrzeugen. Das entspricht nicht dem, was man üblicherweise unter Polizei versteht. Normalerweise haben sie nichts mit israelischen Zivilistinnen und Zivilisten zu tun, obwohl sie offiziell als Polizei gelten. In Extremfällen jedoch – zum Beispiel, wenn Palästinenserinnen und Palästinenser mit israelischer Staatsangehörigkeit protestieren und die Regierung diese Proteste sehr hart unterdrücken will – werden Einheiten wie Yamam oder andere Grenzpolizei-Einheiten geschickt. Denn diese Einheiten kommen mit militärischer Gewalt. Sie sind viel brutaler als die zivile Polizei. Sie tragen andere Uniformen, und man sieht sofort: Sie sehen aus wie Soldaten.

Ich kann hier eine kurze Anekdote erzählen: Es gab eine Demonstration in Tel Aviv vor der deutschen Botschaft. Eine kleine Gruppe von Israelis – vor allem jüdische Israelis – protestierte gegen die deutsche Botschaft wegen Beihilfe zum Völkermord. Sie kritisierten Deutschland dafür, dass es seiner Pflicht – insbesondere aus Artikel 25 des Grundgesetzes – nicht nachkomme. Daraufhin schickten die israelischen Behörden die Grenzpolizei. Das ist sehr ungewöhnlich, weil die Grenzpolizei normalerweise nicht im Zentrum von Tel Aviv eingesetzt wird. Aber hier wollten sie die Protestierenden mit großer Gewalt angreifen. Das war sehr brutal. Es gibt Videos von diesen Grenzpolizisten. Ich glaube allerdings, dass es in diesem Fall nicht Yamam war, sondern eine andere Einheit.

Yamam ist eher dafür bekannt, mit Motorrädern zu operieren, zum Beispiel bei Razzien in Beduinendörfern: Sie brechen in Häuser ein, verhaften Menschen oder werfen sie gewaltsam aus ihren Häusern – und anschließend werden die Häuser zerstört.

Zusätzlich zu dieser geplanten Zusammenarbeit zwischen der GSG 9 und Yamman wurde Folgendes angekündigt, ich zitiere den Spiegel:

„Deutschland werde zudem erstmals beim US-geführten Büro des Sicherheitskoordinators für Israel und die Palästinensische Autonomiebehörde (OSC) in Jerusalem »mit in die Führung« gehen, erklärte Dobrindt weiter. Diese Funktion werde der bisherige Präsident der Spezialkräfte der Polizei in Deutschland, Olaf Lindner, übernehmen. (…) Deutschland unterstützt schon seit vielen Jahren die Polizei in den palästinensischen Gebieten, um dort zur Stabilisierung der Lage beizutragen. Deutschland wolle Israels Sicherheit mit gewährleisten, sagte Dobrindt.“

Ich stelle mal eine etwas provokante Frage: Glauben Sie, dass diese Zusammenarbeit zwischen israelischen und deutschen Polizeikräften zu einer besseren Einhaltung der Menschenrechte durch die israelischen Kräfte führt oder eher zu einer Verrohung der deutschen Polizei, die dort vielleicht andere und härtere Vorgehensweisen lernt?

Hierzu eine Anekdote: Im Mai 2022 haben israelische Sicherheitskräfte die Al-Jazeera- Journalistin Shireen Abu Akleh ermordet. Wahrscheinlich wurde sie durch einen Scharfschützen in den Kopf geschossen. An demselben Tag, als das geschehen ist, war Doron Turgeman, damaliger Chef der israelischen Polizei in Ostjerusalem, gerade in Berlin und leitete dort ein Seminar für die Berliner Polizei. Von Berlin aus gab er den Befehl, dass auf der Beerdigung von Shireen Abu Akleh keine palästinensischen Fahnen gezeigt werden dürften. Daraufhin stürmte die israelische Polizei – hier ging es um Grenzpolizei – die Leichenhalle bei der Beerdigung, um zu überprüfen, ob sich eine Fahne auf dem Sarg befand. Und dann, während der anschließenden Trauerprozession mit dem Sarg, griffen sie die Trauernden an, um palästinensische Fahnen zu entfernen. Doron Turgeman wurde dann später in Israel kritisiert, dass er diesen Befehl gegeben hat, obwohl er in Berlin war und von dort aus nicht einschätzen konnte, wie provokativ und gefährlich dieser Befehl war und wie schlecht das in den internationalen Medien aussah.

Aber die Berliner Polizei hat von ihm viel gelernt. Genau in dieser Zeit – wir sprechen immer noch vom Mai 2022 – hat die Berliner Polizei in der ganzen Stadt „Racial Profiling“ praktiziert. Wenn jemand mit einer Kufija oder einer palästinensischen Fahne gesehen wurde, wurde diese Person von der Polizei angegangen. Ich kenne sogar jemanden, der im Krankenhaus gelandet ist, nur weil er eine Kufija trug. Er war allein. Die Polizei behauptete, das sei eine illegale „Demonstration“ einer einzelnen Person gewesen.

Das ist das Ergebnis davon, wenn jemand wie Doron Turgeman ein Seminar für die Berliner Polizei geben darf. Ich sage nicht, dass die deutsche Polizei oder die Berliner Polizei kein „Racial Profiling“ angewendet hat, bevor sie sich mit Israelis getroffen hat – es gibt meiner Meinung nach schon seit Langem Rassismus innerhalb der Polizei. Aber der Einfluss der Rechtfertigung durch die israelische Polizei ist entscheidend. Es wird vermittelt: ‚Natürlich müssen wir Menschen, die verdächtig aussehen – wegen ihrer Hautfarbe, ihrer Kleidung oder ihrer Religion –, anders behandeln. Wenn man das nicht tut, dann ist man naiv.‘ Eine solche Haltung, die bei der israelischen Polizei sehr üblich ist, hat – meiner Ansicht nach – negative Auswirkungen auf die Demokratie in Deutschland.

Wir müssen hier sicher dazu sagen, dass daran viel Spekulation ist, weil wir nicht wissen, welche Inhalte das Seminar hatte, das Turgeman in Berlin gegeben hat und ob und wie es sich auf das Polizeiverhalten ausgewirkt hat.

Vielleicht. Die israelischen Firmen sagen aber offen: Wir müssen „Racial Profiling“ betreiben. In Bezug auf sie ist das gar keine Spekulation. Sie sagen: „In Deutschland glaubt man, man müsse Menschenrechte achten, das ist naiv, und deshalb hat man keine Sicherheit. Man braucht uns.“ Aus israelischer Sicht wird das sehr klar geäußert.

Um mal in die andere Richtung zu schauen: Es wird gemeinsam trainiert, das heißt, es kann einen Einfluss in Richtung Deutschland geben, aber es werden auch Deutsche dort ausbilden und an Übungen teilnehmen. Glauben Sie, dass das irgendeine positive Auswirkung auf die israelischen Sicherheitskräfte haben kann? Könnte das nicht auch der Gedanke auf deutscher Seite gewesen sein, zu sagen: Wir helfen dabei, bessere Standards in Israel durchzusetzen?

Ich verstehe, warum Sie diese Frage vorhin provokativ genannt haben. Ich will hier kein großes Lob auf die demokratischen Werte der deutschen Polizei singen. Es gibt natürlich große Unterschiede zwischen verschiedenen Polizeieinheiten in Deutschland. In Karlsruhe zum Beispiel ist die Polizei ganz anders als in Berlin, das merkt man deutlich.

Aber es gibt einen anderen Punkt, der für deutsche Polizistinnen und Polizisten sehr wichtig ist, die nach Israel gehen, um dort mit israelischen Polizeikräften zu trainieren. Diese Übungen finden nicht nur an einem neutralen Ort oder in einem Klassenzimmer statt. Es gibt auch physische Trainings, die in besetzten Gebieten durchgeführt werden. Für die israelische Polizei gibt es viele wichtige Stützpunkte im Westjordanland und natürlich in Ostjerusalem. Wenn ein deutscher Polizist an einer solchen Übung teilnimmt, dann begeht dieser Polizist selbst möglicherweise eine Straftat im Sinne des Völkerrechts. Die Israelis werden den deutschen Polizeibeamten nicht mitteilen, wo die Grenze verläuft. Es liegt in der Verantwortung der Deutschen, sich zu weigern, mit ihren israelischen Kollegen im Bus über die „Grüne Linie“ zu fahren, aber die Grenze ist nicht markiert [Anm. d. Red.: „Grüne Linie“ wird in Israel die völkerrechtlich maßgebliche Grenze zwischen Israel und den besetzten palästinensischen Gebieten genannt].

Wie waren denn die Reaktionen innerhalb Israels zu diesem Abkommen und zu der Zusammenarbeit? Wie wurde es dort besprochen?

Es gab sehr wenig inhaltliche Reaktionen oder Kommentierungen dazu in den israelischen Medien. Das passiert übrigens auch in Deutschland. Viele Journalistinnen und Journalisten sind müde, haben sehr viel Arbeit und nicht genug Zeit, gründlich zu recherchieren. Wenn die Regierung eine Presseerklärung verschickt, werden manchmal nur ein paar Worte geändert, und dann wird das veröffentlicht, als wäre es ein Artikel. Das sehe ich hier ganz deutlich.

Das israelische Außenministerium und das israelische Polizeiministerium wollten sagen: Schaut her, wir haben dieses wichtige Abkommen mit Deutschland geschlossen. Genau so wurde das dann auch in israelischen Zeitungen veröffentlicht. Aber viele Israelis – ich glaube, die große Mehrheit – verstehen, dass die Regierung damit Propaganda macht und einfach sagen will: ‚Wir sind so wichtig, wir sind so gut.‘ Deswegen gab es zu dieser Meldung kaum eine inhaltliche Auseinandersetzung.

Es gab aber eine andere Form der Zusammenarbeit, die tatsächlich eine Reaktion ausgelöst hat. Das war eine KI-Konferenz für Bildungssysteme – also nicht für Sicherheit, sondern für den Bildungsbereich. Der israelische Bildungsminister hat für diese Konferenz hochrangige Beamtinnen und Beamte aus verschiedenen Ländern eingeladen, um darüber zu sprechen, wie KI in Schulen genutzt werden soll. Er hat sehr viele Länder eingeladen, etwa hundert oder so, aber nur sehr wenige haben zugesagt. Länder wie Togo oder Mikronesien haben bestätigt, dass sie kommen. Dazu kamen noch zwei Länder, die nicht so klein oder weit entfernt sind: Österreich und Deutschland. Die israelische Zeitung Haaretz schrieb dann sinngemäß: Die einzigen Länder, die zu dieser Konferenz kommen wollen, sind unwichtige Länder wie Togo und die „Schamstaaten“ Österreich und Deutschland. Viele Israelis sehen Deutschland also als einen „Schamstaat“, der also aus dem Gefühl historischer Schuld alles für Israel tun würde. Das heißt: Wenn Israel sagt, „Wir haben ein Sicherheitsabkommen mit Deutschland unterschrieben“, hat das für viele in Israel keine große Bedeutung.

In einem großen Teil der deutschen Berichterstattung dazu und in der Art, wie das Abkommen auch vom Ministerium für Inneres kommuniziert wird, entsteht der Eindruck, dass dieses Abkommen eine vollständige Normalisierung der Beziehungen zwischen Israel und Deutschland einleiten soll – so, als wären die letzten zwei oder drei Jahre gar nicht passiert. Es wird relativ deutlich, dass sowohl der Anschlag in Berlin auf das Stromnetz als auch die Unruhen im Iran genutzt werden, um einerseits ein starkes Bedrohungsszenario innerhalb Deutschlands zu zeichnen und andererseits Israel gewissermaßen von allem reinzuwaschen, was zuvor geschehen ist, und es wieder als verlässlichen Partner gegen „Mullah-Regimes“ und „islamistische Terroristen“ darzustellen. Glauben Sie, dass diese Normalisierung funktionieren wird? Und wie sehen Sie die weitere Entwicklung hierzu?

Aus meiner Sicht hat die Normalisierung Israels von deutscher Seite eigentlich nie aufgehört hat. Bei Jung & Naiv gab es ein Interview mit Olaf Scholz vor den letzten Wahlen, mitten in dem, was ich als Völkermord bezeichne. Er wurde gefragt, was mit den Kriegsverbrechen in Gaza sei, und Olaf Scholz hat seine Augen geschlossen und mit geschlossenen Augen in Bezug auf den Völkermord-Vorwurf gegen Israel gesagt: „Davon gehe ich nicht aus.“