Vorschau ansehen

Dr. Lutz Niemann

Als die Regierung Schröder / Fischer im Jahre 2000 die Energiewende mit dem Ausstieg aus der Kernenergie den Umstieg auf Sonne und Wind einleitete, schrieben die beiden Professoren Heinz Maier-Leibnitz und Elisabeth Noelle-Neumann ein Büchlein mit dem Titel „Zweifel am Verstand“. In den weiteren Jahren gab es weitere ähnliche Bezeichnungen für Deutschlands Verhalten – Schwachsinn, Deppenvolk, Hirnabschaltung, Blödland. Meine Sammlung enthält inzwischen ca. 20 verschiedene Bezeichnungen. Daraus ist besonders zu erwähnen „sind Bekloppte“ von Sigmar Gabriel. Das zeigt: natürlich wissen auch Politiker, daß Deutschlands Ausstieg aus seiner sicheren Stromversorgung wirtschaftlicher Selbstmord bedeutet. Warum machen sie es dennoch? – das bleibt ein Geheimnis.

In 2011 sprang auch die CDU/CSU unter der Leitung von Frau Merkel auf diesen Zug auf und wollte ebenfalls die Kernenergie weghaben. Die gesamte CDU/CSU folgte dem Beschluß der Chefin. Dabei ist 2011 in Fukushima nichts besonders Schlimmes passiert. Es wurden einige Außenmauern des Kernkraftwerkes durch Wasserstoffexplosionen zerlegt, aber alle Reaktoren blieben heil und nur wegen der Kernschmelzen musste Druck abgelassen und so wurde Radioaktivität freigesetzt.

Nun aber will Deutschland seine Energieversorgung auf hoch explosiven Wasserstoff umstellen, der in Fukushima das Kernkraftwerk zerlegte. Wo bleibt da der Verstand?

Und wie gefährlich ist die Strahlung von einem Kernkraftwerk?

Es gibt Grenzwerte, und solch ein Grenzwert wird von den Menschen als Grenze zwischen gefährlich und harmlos gesehen. In Kernkraftwerken gibt es einen Grenzwert für die zusätzliche Strahlendosis von einem Milli-Sievert über das Jahr verteilt.

Da nur wenige Fachleute etwas damit anfangen können, ist ein für alle Menschen verständlicher Vergleich nützlich. Dazu nehmen wir Alkohol, das kennt jeder. Die tödliche Dosis ist eine oder zwei Flaschen Hochprozentiges, wenn diese tödliche Dosis innerhalb von kürzester Zeit hinuntergekippt wird. Aber es ist harmlos, wenn diese tödliche Dosis über das Jahr gleichmäßig verteilt wird.

Übertragen wir das auf Strahlung: Bei Radioaktivität bedeutet der Grenzwert von einem Milli-Sievert/Jahr weniger als einem Tausendstel der tödlichen Dosis über das Jahr verteilt. Das kann keine Gefahr sein, das ist harmlos — nur verstehen die Menschen die Zusammenhänge nicht. Der Grenzwert von einem Milli-Sievert/Jahr bei Radioaktivität gaukelt eine nicht vorhandene Gefahr vor.

Um eine nicht vorhandene Gefahr zu vermeiden, steigt Deutschland sogar aus seiner Stromversorgung aus, will offenbar zurück ins Mittelalter. Wo bleibt da der Verstand?

Die Grenzwerte, zu deren Einhalt in Kernkraftwerken riesige Geldbeträge ausgegeben werden müssen, werden im Flugverkehr vom fliegenden Personal durch die Höhenstrahlung jedes Jahr um das Doppelte bis Zehnfache überschritten. Es ist daher ein Paradigmenwechsel im Strahlenschutz erforderlich, so schrieb es Prof. Klaus Becker in der Fachzeitschrift StrahlenschutzPRAXIS.

Aber die Fachzeitschrift StrahlenschutzPRAXIS wird nur von den Fachleuten gelesen. Und bei Strahlung werden die Grenzwerte von Politikern festgelegt, die vom Thema „Radioaktivität und Gesundheit“ keine Ahnung haben

Ein anderes in Deutschland verschwiegenes Thema

Dazu vergleichen wir wieder mit Alkohol, denn Alkohol ist giftig, kanzerogen, teratogen, brennbar, kann mit Luft explosive Gemische bilden — Alkohol hat viele schädliche Eigenschaften. Aber Alkohol hat bei kleiner Dosis auch nützliche Eigenschaften, und das genießen die Menschen.

Auch Strahlung von Radioaktivität ist in geringer Dosis und bei geringer Dosisleistung gut für die Gesundheit von Lebewesen, weil die Strahlung das Immunsystem anregt. Das äußert sich in besserer Gesundheit, Lebensdauerverlängerung, weniger Krebs, weniger genetische Defekte. Eine zusätzliche Strahlendosis, wie sie in Kernkraftwerken laut Gesetz vermieden werden muß, kann niemals schädlich sein, wie auch das zitierte Glas Schnaps bei Verteilung über ein ganzes Jahr niemals schädlich sein kann. Die positive Wirkung einer kleinen Strahlendosis ist sicher nachgewiesen und in der Strahlenschutz-Fachwelt bekannt. Nur in Deutschland wird darüber nicht geredet. Die arbeitenden Menschen in Deutschlands Kernkraftwerken glauben an die hypothetischen Strahlengefahren, die vom unwissenden Gesetzgeber vorgegaukelt werden, denn in ihrer Ausbildung haben sie von der Strahlengefahr lernen müssen. Man muß englisch sprachige Literatur zur Hand nehmen [1] bis [4] mit weit über1000 dort zitierten Originalarbeiten, um etwas von den positiven Strahlenwirkungen zu erfahren. Ein deutsches Lehrbuch ist diesbezüglich ein Leerbuch [5].

Die Strahlendosis von 1 mSv bedeutet, daß jede Zelle vom Körper eines Menschen von einer Strahlenspur getroffen wird, was als ein Training des Immunsystems der Zelle bedeutet. 1 mSv/Jahr bedeutet also für jede Zelle ein Training pro Jahr, und das kann keinen Effekt haben wie vom Sport bekannt ist (siehe hier). T.D. Luckey, M. Doss, W. Allison, C.L. Sanders geben Empfehlungen für optimale Dosis zum Erreichen einer optimalen biopositiven Wirkung im Bereich von 60mSv/Jahr bis 3000mSv/Jahr, natürlich gleichmäßig über die Zeit verteilt.

Hoch droben in der Internationalen Raumstation ist der Strahlenpegel rund 1000-fach höher als unten auf der Erde. Bei Astromauten, die sehr lang Zeit in der Raumstation verbracht haben, soll ein positiver Effekt an den Telomeren festgestellt worden sein.

Mit dem Co-60-Ereignis von Taiwan gibt es durch einen glücklichen Zufall einen Menschenversuch mit 10 000 Personen über bis zu 20 Jahre mit sicherem Nachweis der nützlichen Strahlenwirkung.

Im Februar 2015 haben die Professoren Carol S. Marcus, Mark L. Miller und Mohan Doss an die Genehmigungsbehörde NRC (Nuclear Regulatory Commission) der USA eine Petition gerichtet mit der Bitte zur Korrektur der heute geltenden Prinzipien beim Umgang mit Strahlung. Die Petition hatte mit den dazu abgegebenen ca. 650 Kommentaren ein gewaltiges Echo in der Fachwelt der USA. Die NRC hatte die Existenz der biopositiven Wirkung von Strahlung anerkannt, jedoch als nicht zuständiges Gremium die Petition zurückgewiesen und die ICRP als zuständig benannt.

Es ist an der Zeit, nicht nur den Bau von Kernkraftwerken durch unsinnigen Strahlenschutz zu behindern, sondern auch die Ämter für Strahlenschutz abzuschaffen und das freiwerdende Personal zum Segen der Menschheit mit der Erforschung der biopositiven Wirkung der Strahlung zu beauftragen. Die Fachwelt und die Politik sind weltweit gefordert.

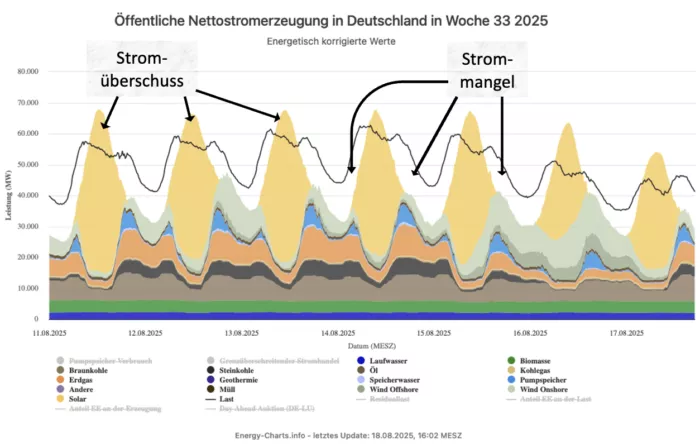

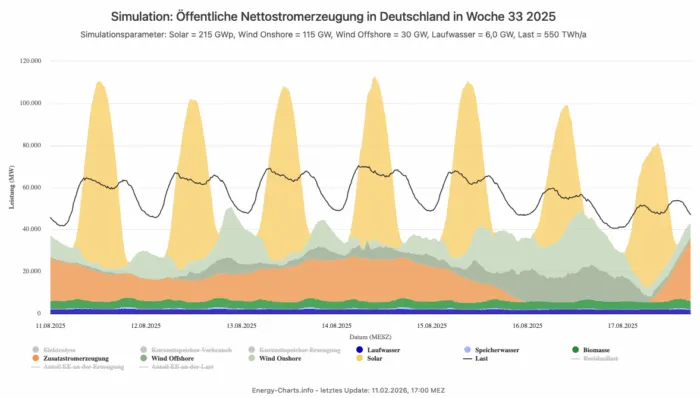

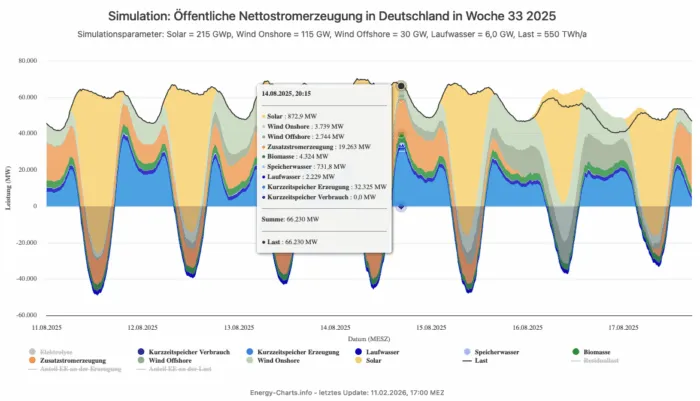

Die Realitätsverweigerung in Deutschland

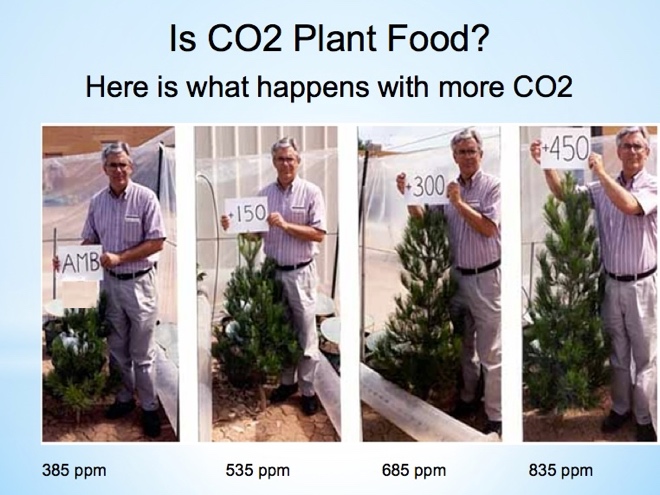

Um den lebensnotwendigen Strom zur Verfügung zu haben, sind Kraftwerke erforderlich. Das sollte einzusehen sein. Zuerst wurden die Kernkraftwerke abgeschaltet und sogleich danach rückgebaut, obwohl diese keine Gefahr bedeuten — es war das Werk von Frau Merkel. Dann kamen als nächstes die Kohlekraftwerke an die Reihe mit dem Kohleverstromungsbeendigungsgesetz, obwohl es keinen Einfluß von CO2 auf die Physik der Atmosphäre gibt — auch das war das Werk von Frau Merkel. Alles soll in Deutschland durch Wind und Sonne ersetzt werden. Aber wenn es dunkel wird und wir Licht einschalten wollen, kann es keinen Solarstrom geben, das sollte einzusehen sein. Wenn dann auch der Wind Flaute hat, gibt es gar keinen Strom mehr, das nennt man Dunkelflaute. Dann sind wieder konventionelle Kraftwerke zur Versorgung notwendig, die aber längst zerstört sind oder deren Ende bereits per Gesetz festgelegt worden ist.

Diese Realität wird in Deutschland nicht zur Kenntnis genommen, fehlt es am Verstand?

Einige sehr persönliche Worte

Als Rentner hatte ich mich für die Kernenergie engagiert. Daher wurde ich von der örtlichen CSU angesprochen und mir der Eintritt in die Partei nahegelegt. Das habe ich gemacht, ich war etwa fünf Jahre CSU-Mitglied, ich bin aber nach der fatalen von Frau Merkel initiierten Entscheidung im März 2011 sofort wieder ausgetreten. Dem damaligen Generalsekretär Alexander Dobrinth der CSU habe ich meine Gründe in einem Brief erklärt. In einem Antwortbrief vom August 2011 schrieb Alexander Dobrinth, daß man „die Kernenergie als Brücke ins Zeitalter der erneuerbaren Energien betrachtet“. Versteht Herr Dobrinth die Situation bei einer Dunkelflaute nicht, fehlt es an Verstand?

In meinem Text habe ich meine Sätze zum „Zweifel an Verstand“ ganz bewusst als Frage formuliert. Nun bin ich der Meinung, daß nicht fehlender Verstand die Ursache für die falschen Entscheidungen zur Energieversorgung Deutschlands ist, sondern daß es das mit der Wahl an die Spitze eines 80-Millionen-Volkes verbundene gestiegene Selbstbewusstsein ist, daß zu einer Selbstüberschätzung der Führungspersönlichkeiten in der Politik geführt hat, immer alles richtig zu machen. Ferner fehlt das physikalische Verständnis zu Arbeit und Leistung im Bereich der Energieversorgung bei Strom, Wärme, Verkehr. In der Politik sind geschicktes demagogisches Reden notwendig, um Begeisterung beim Wähler zu erreichen — das ist das wichtigste Erfolgsrezept für politischen Aufstieg.

Die wirtschaftlichen Folgen für Deutschland

Durch die Vorrangeinspeisung des Flatterstromes von Wind und Sonne ab dem Jahr 2000 wurde der billige Strom der Kernkraftwerke von 2,4 ct/kWh ersetzt durch Strom von rund 50 ct/kWh. Das führte zu stetig steigenden Strompreisen. Wo in der Industrie der Strom zur Wärmeerzeugung gebraucht wird ist der Stromverbrauch sehr hoch und die höheren Strompreise machen diese Industrien konkurrenzunfähig. Insbesondere ist das in der Metallurgie der Fall. Es wurden in der Folge Fertigungen ins Ausland mit niedrigeren Stromkosten verlegt. Das dauerte einige Jahre, erst ab 2018 sank der Stromverbrauch in Deutschland deutlich. In 2025 war der Stromverbrauch in Deutschland von zuvor über 600 TWh um rund ein Drittel auf etwa 430 TWh gesunken. Das führte nicht sogleich zu merklich höherer Arbeitslosigkeit, inzwischen aber häufen sich die Meldungen über Massenentlassungen.

Das Industrieland Deutschland vergrault seine Industrie, wo bleibt das der Verstand?

Dazu einige Zahlen:

- Die abgeschalteten Kernkraftwerke haben einen Neubauwert von 250 Mrd. EURO

- Bei 10ct/kWh und der Hälfte unseres Stroms aus Wind und Sonne werden dafür pro Jahr mehr als 20 Mrd. EURO fällig, von Anbeginn bis heute liegen die Kosten der Energiewende bei weit über 500 Mrd. EURO

- Die Kohlekraftwerke werden nach dem Kohleverstromungsbeendigungsgesetz abgeschaltet, Hamburg-Moosburg lief nur 5 ½ Jahre und kostete 3 Mrd. EURO, und es geht weiter damit.

Deutschland steigt aus seiner Stromerzeugung aus, Kernkraft ist schon weg, auch die Kohle soll verschwinden. Wegen Klimaschutz soll nur noch Erdgas verwendet werden. Das billige Erdgas aus Russland gibt es nicht mehr, die Pipeline durch die Ostsee wurde zerstört — wie das vollbracht werden konnte ist ein mit Schweigen belegtes Thema in Deutschland.

Die politischen Folgen für Deutschland

Die absolut schädliche Energiewende von Deutschland in Richtung zurück ins Mittelalter wurde 2011 mit dem Kernenergieausstieg durch die CDU/CSU endgültig zementiert, denn ALLE Parteien wollten das nunmehr. Daher gründete sich bald eine neue Partei, die als Kennzeichen gegen die von Frau Merkel betonte Alternativlosigkeit das Wort „Alternative“ im Namen trägt — die AfD. Beim politischen Streit wird der erste und hauptsächlichste Grund für diese Parteineugründung, nämlich der Ausstieg aus der gesicherten Stromversorgung unterschlagen. Es sei dem interessierten Bürger empfohlen, die Bundestagsdebatten unter www.bundestag.de selber zu verfolgen, sich also selber ein Urteil zu bilden anstatt der Propaganda der Meinungsmacher zu folgen.

Noch haben die Parteien im deutschen Bundestag eine Mehrheit, die sowohl den Ausstieg aus der Stromversorgung unseres Landes wie auch die Klimaideologie verfolgen. Aber es kommen Wahlen. Um die steigenden Stromkosten und die steigenden Heizkosten zu verheimlichen, wurde eine

erfunden: Der über der jeweiligen Preisbremse liegende Geldbetrag für Strom und Gas muß nicht mehr vom Bürger bezahlt werden, sondern er wird vom Bund bezahlt. Der Bund ist kein Dukatenesel, er holt sich das Geld vom Bürger über Steuern oder „Sondervermögen“. Die Preisbremsen werden in den Medien nicht thematisiert, der Bürger findet darüber manchmal etwas in den Rechnungen der Stromanbieter und Heizgaslieferanten. Zur Selbstinformation ist unter www.bundestag.de die Suchfunktion zu benutzen. Für jede der beiden Preisbremsen sind jedes Jahr Beträge im 2-stelligen Milliardenbereich fällig — das ist ein weiterer Grund für die Abwanderung der Industrie.

Was gibt es Positives zu berichten?

Jedermann braucht Arbeit, um sich seinen Lebensunterhalt zu verdienen. Im Handwerk bei den Herstellern von Fenstern geht es voran und wird der Deindustrialisierung unseres Landes entgegengearbeitet. Es wird in Berliner Regierungskreisen in neue breitere Fenster investiert, damit das Geld gleichzeitig mit beiden Händen hinausgeworfen werden kann. So beschrieb Zippert in DIE WELT kürzlich den Fortschritt in Deutschland.

[1] „Radiation and Health“ by Thormod Henriksen and Biophysics group at UiO, frei im Internet

[2] W. Allison, „Nuclear is for Life, A Cultural Revolution“, ISBN 978-0-9562756-4-6, Nov. 2015

[3] „Underexposed – What if Radiation is Actually GOOD for You?“ By Ed Hiserodt, 2005

[4] Ch. Sanders „Radiation Hormesis and the Linear-No-Threshold Assumption“ Springer-Verlag 2010

[5] Jürgen Kiefer, „Strahlen und Gesundheit“, WILEY-VCH Verlag, 2012

Der Beitrag „Zweifel am Verstand“, ein Urteil über Deutschland erschien zuerst auf EIKE - Europäisches Institut für Klima & Energie.