Vorschau ansehen

Paul Homewood, NOT A LOT OF PEOPLE KNOW THAT

Großartiges Video von Peter Ridd:

Hier das mit KI formatierte Transskript:

Computermodelle zur Vorhersage von Wetter und Klima ähneln sich eigentlich ziemlich stark. Sie basieren auf grundlegenden physikalischen Prinzipien – den Bewegungsgesetzen, Newton’schen Bewegungsgesetzen, Thermodynamik, Strahlungstransport – und benötigen einen sehr leistungsstarken Computer.

Und der Wettermann bekommt oft viel Kritik für Vorhersagen, die nicht immer zutreffen. Das ist meiner Meinung nach sehr unfair, denn die Modelle sind eigentlich hervorragend, und es besteht kein Zweifel daran, dass sie sich in den letzten Jahrzehnten enorm verbessert haben.

[Siehe hierzu meine Anmerkung am Ende. A. d. Übers.]

Aber Klimamodelle? Nicht so sehr.

Nun lebe ich in einer Gegend, in der wir jedes Jahr ein paar Zyklone meistern müssen, und ich finde es unglaublich, wie gut zum Beispiel der Wetterdienst die zukünftigen Zugbahnen dieser Zyklone vorhersagt. Beim tropischen Zyklon Narelle haben sie zum Beispiel hervorragende Arbeit geleistet. Sie sagten voraus, er würde über die Kap-York-Halbinsel hinweg ins Northern Territory ziehen. Und genau das ist auch passiert. Ich erinnere mich an eine Zeit, als diese Vorhersagen so gut wie nutzlos waren – wenn es einen Zyklon im Korallenmeer gab, lauteten die Vorhersagen im Grunde genommen, dass er überall hinziehen könnte.

Schauen wir uns also einmal an, warum die Wettervorhersagen in den letzten Jahrzehnten so viel besser geworden sind. Es gibt vier Gründe, und wir werden uns nur auf einen konzentrieren.

Erstens haben wir die physikalischen Vorgänge in der Atmosphäre besser im Griff. Es ist nicht viel besser, und eigentlich ist es auch keine große Sache. Der zweite Punkt ist, dass wir viel leistungsfähigere Computer haben, und das macht einen Unterschied. Der dritte Grund, und der wird jetzt langsam wichtig ist, dass wir heute riesige Datenmengen aus der jüngeren Vergangenheit haben und fortschrittliche statistische Verfahren nutzen können – KI, wenn man so will –, um die Vorhersagen zu unterstützen. Genauso wie ChatGPT auf alles trainiert wird, was jemals im Internet geschrieben worden ist, um eine Antwort auf eine Frage zu geben, die einigermaßen plausibel klingt, lässt sich das Gleiche auch beim Wetter tun. Man nutzt die Daten aus der Vergangenheit, um herauszufinden, was passieren würde, wenn die Bedingungen damals mehr oder weniger denen von heute ähnelten.

Der vierte Grund ist jedoch sehr, sehr wichtig, und darauf werden wir uns heute konzentrieren. Und es ist etwas, das nicht allgemein bekannt ist: Wir können die Atmosphäre mittlerweile viel genauer messen, manchmal sogar auf überraschende Weise.

Es hat sich herausgestellt, dass es für eine Wettervorhersage für morgen sehr hilfreich ist, wenn man – überall – genau weiß, wie das Wetter heute ist.

Um das zu verstehen, müssen wir uns nun genauer ansehen, wie Wetter- und Klimamodelle funktionieren, inwiefern sie sich ähneln und worin sie sich unterscheiden.

Die großen physikalischen Berechnungen stützen sich also auf die Gesetze der Thermodynamik – darüber, wie sich Luft ausdehnt, erwärmt, abkühlt und wie sich Wasserdampf bildet – und dafür gibt es jede Menge wirklich schöne mathematische Gleichungen. Einige sind sehr genau. Andere, etwa die zu Wolken, sind eigentlich ziemlich kompliziert – im Grunde nur fundierte Vermutungen. Dann gibt es noch die Physik der gesamten Strahlung: die einfallende Sonnenstrahlung, die Infrarotstrahlung, die vom Boden, von den Wolken und sogar von der Luft selbst ausgeht.

Diese basieren auf einem großen Modell, das Newtons Bewegungsgesetze nutzt – der gute alte Newton –, um zu berechnen, wie sich die Luft bewegt: der Wind, die vertikalen Bewegungen und was diese Luft mit sich führt – die Luftfeuchtigkeit, ihren Impuls, ihre kinetische Energie. Mit Newtons zweitem Gesetz lässt sich berechnen, wie diese Luft beschleunigt. Das ist das A in F = MA – im Grunde genommen, wie sie ihre Geschwindigkeit oder Richtung ändert.

Aber wir müssen die Masse der Luft kennen, und das ist nicht allzu schwer. Wir teilen einfach die gesamte Atmosphäre in viele kleine Abschnitte auf, die jeweils einige Kilometer breit und etwa einen Kilometer hoch sind. Dann müssen wir F kennen, also die Kraft, die auf die Luft wirkt. Viele Faktoren tragen dazu bei: der Luftdruck, die Erdrotation, die Luftdichte. Anschließend berechnen wir die Beschleunigung, also die Änderung der Geschwindigkeit oder Richtung, über einen bestimmten Zeitraum.

Wir können das mit den Berechnungen für ein beschleunigendes Auto vergleichen. Man hat einen Motor, der die Kraft erzeugt, und nehmen wir an, das Auto beschleunigt um 20 km/h pro Sekunde – oder zumindest wird es jede Sekunde um 20 km/h schneller. So können wir berechnen, wie schnell es beispielsweise in fünf Sekunden fahren wird. Fünf mal 20 ist 100 – wir werden 100 km/h schneller fahren als zu Beginn.

Aber hier ist der entscheidende Punkt: Um zu wissen, wie schnell wir in fünf Sekunden fahren werden, muss man wissen, wie schnell man zu Beginn gefahren ist. Wenn wir an der Ampel stillstanden, fahren wir in fünf Sekunden 100 km/h. Wenn wir jedoch bereits 60 km/h fuhren, als wir das Gaspedal durchdrückten, fahren wir nun 60 plus 100 – also 160 km/h – in fünf Sekunden.

Man muss die Anfangsbedingungen kennen, um herauszufinden, wie schnell man am Ende sein wird. Die Anfangsbedingung ist der Fachbegriff aus der Differentialgleichung, auf der das alles basiert, und das gilt auch für das Wetter. Man kann die Windgeschwindigkeit oder -richtung von morgen nicht berechnen, wenn man nicht weiß, wie hoch die Windgeschwindigkeit und -richtung heute sind. Und es geht nicht nur um den Wind – es geht auch um den Luftdruck und die Luftfeuchtigkeit.

Nun, beim Wetter ist es wie bei vielen anderen Systemen auch: Wenn man die Anfangsbedingungen falsch angibt, kann das Endergebnis völlig anders ausfallen, selbst wenn man sich bei der Anfangsbedingung nur um ein winziges bisschen irrt. Diese hier herumrollenden Kugeln beispielsweise starteten aus einer nur ganz leicht unterschiedlichen Position, und nach kurzer Zeit befinden sie sich an einer völlig anderen Stelle. Das ist ein klassisches Beispiel für ein zusammengesetztes Pendel – die beiden Pendel starteten an ganz leicht unterschiedlichen Positionen, aber wenn man die Zeit voranschreitet, sind sie schließlich nicht mehr annähernd an derselben Position. Und genau so ist es auch mit dem Wetter. Wenn man die Anfangsbedingungen falsch einschätzt, kann man in ein, zwei oder drei Wochen unmöglich eine genaue Wettervorhersage haben.

Wie hat sich also unsere Fähigkeit, das Wetter zu messen, so sehr verbessert?

Erstens können Satelliten zwar Wolken erkennen, aber das ist erst der Anfang. Sie können tatsächlich die von der Luft selbst ausgehende Mikrowellen- und Infrarotstrahlung überwachen und messen, um ein Profil der Lufttemperatur und der Luftfeuchtigkeit von der Obergrenze der Atmosphäre bis hinunter zur Erdoberfläche zu erstellen. Zwar wird nach wie vor das alte Verfahren angewendet, bei dem Ballons mit Feuchtigkeits- und Temperatursensoren aufsteigen gelassen werden, doch ist dies nur an wenigen Orten möglich. Wenn das Amt dies also tut, wie Sie auf dieser Karte sehen können, sind es nicht sehr viele Orte, und mitten auf dem Ozean ist dies nicht möglich.

Aber hier ist etwas, das ich sehr interessant fand – eine Messmethode, die wir tatsächlich nutzen können: das GPS-System – das gleiche, das ihr mit eurem Handy nutzt, um euren Standort zu bestimmen. Es stellt sich heraus, dass es zur Überwachung der Luftfeuchtigkeit eingesetzt werden kann. Beim GPS-System werden Signale vom Satelliten zu Bodenstationen gesendet, und anhand der Zeit, die diese Signale benötigen, wird euer Standort ermittelt. Die Laufzeit dieser Signale hängt jedoch von der Luftfeuchtigkeit ab. So lassen sich ziemlich raffinierte Berechnungen anstellen und die Atmosphäre tatsächlich mit dem GPS-Signal untersuchen.

Was Sie hier also gerade sehen, ist nichts Geringeres als eine Revolution in der Art und Weise, wie wir das Wetter messen können. Wenn man das Wetter von heute kennt, kann man viel genauer vorhersagen, wie das Wetter morgen sein wird.

Schauen wir uns nun die Klimamodelle an. In vielerlei Hinsicht ähneln sie sich, aber das Klima ist gewissermaßen ein Durchschnitt der Wetterbedingungen, und diesen Durchschnitt bilden wir oft über einen Zeitraum von beispielsweise 30 Jahren. In einem Wettermodell berechnen wir die Veränderungen des Wetters und addieren oder subtrahieren diese von den heutigen Bedingungen. Bei Klimamodellen versuchen wir, anstatt Veränderungen im Laufe der Zeit zu berechnen, die durchschnittlichen Bedingungen über einen langen Zeitraum zu ermitteln.

Und es ist tatsächlich ziemlich interessant, dass selbst hier die aktuellen Klimamodelle oft von den großen, berühmten Klimamodellen falsch vorhergesagt werden – sie weichen also um bis zu einige Grad voneinander ab. Ich habe dazu ein Video gedreht.

Nun, vielleicht spielt das keine allzu große Rolle, denn was wir wirklich wissen wollen ist, wie sich das Klima verändern wird, wenn man beispielsweise die Kohlendioxidmenge oder einen anderen Parameter verdoppelt. So führen Modellierer oft interessante Simulationen durch, bei denen sie die Sonneneinstrahlung reduzieren oder sogar die Position der Kontinente und Ozeane verändern, um vergangene Klimata zu simulieren.

Das ist also ein wichtiger Unterschied: Wettermodelle berechnen die Wetterveränderung ausgehend vom heutigen Wetter und simulieren so das Wetter für morgen. Klimamodelle gehen in der Regel von einem groben Klimazustand aus und berechnen die Klimaveränderungen, wenn wir einen wichtigen Parameter verändern, wie zum Beispiel die Kohlendioxidkonzentration.

Verdopplung der Klimamodelle – Klimamodelle benötigen keine hochgenauen Messungen des heutigen Klimas, um die Veränderungen zu berechnen, wenn man beispielsweise die Kohlendioxidkonzentration verdoppelt. Wettermodelle hingegen benötigen sehr genaue Messungen des heutigen Wetters, um das Wetter in einer Woche oder einem Tag in der Zukunft zu berechnen.

Das bedeutet also, dass die Wettermodelle massiv von all den zusätzlichen Messungen profitiert haben, die Klimamodelle jedoch nicht – die zusätzlichen Daten, die wir für das heutige Wetter haben, helfen uns nicht dabei, das Wetter in 100 Jahren zu berechnen. Klimamodelle profitieren also nicht von dieser Revolution.

Was ist also die Moral der Geschichte? Man sollte den Wettermann nicht ständig kritisieren. Er leistet tatsächlich unglaublich gute Arbeit. Und dasselbe gilt für all die Techniker, die die Satellitenüberwachungssysteme, die GPS-Systeme und die statistischen Verfahren entwickelt haben – sie haben eine Revolution ausgelöst.

Was nun die Klimamodelle angeht – nun, sind sie tatsächlich besser bei der Vorhersage als eine einfache Überschlagsrechnung? Man kann eine sehr einfache Berechnung durchführen und erhält am Ende eine Zahl, die den Ergebnissen dieser riesigen Supercomputer sehr ähnlich ist. Und sagen die Modelle wirklich eine Katastrophe voraus? Und weisen die Modelle Diskrepanzen untereinander auf – große Diskrepanzen? Und haben wir ein grundlegendes Problem, dass wir erst 2050 oder 2100 sagen können, ob sie richtig oder falsch liegen, wenn es dann vielleicht schon viel zu spät ist, weil wir den Bogen überspannt haben – oder vielleicht erkennen wir, dass sie alle falsch lagen?

Meine Güte, sehen Sie mal auf die Uhr. Das müssen wir an einem anderen Tag machen.

Übersetzt von Christian Freuer für das EIKE

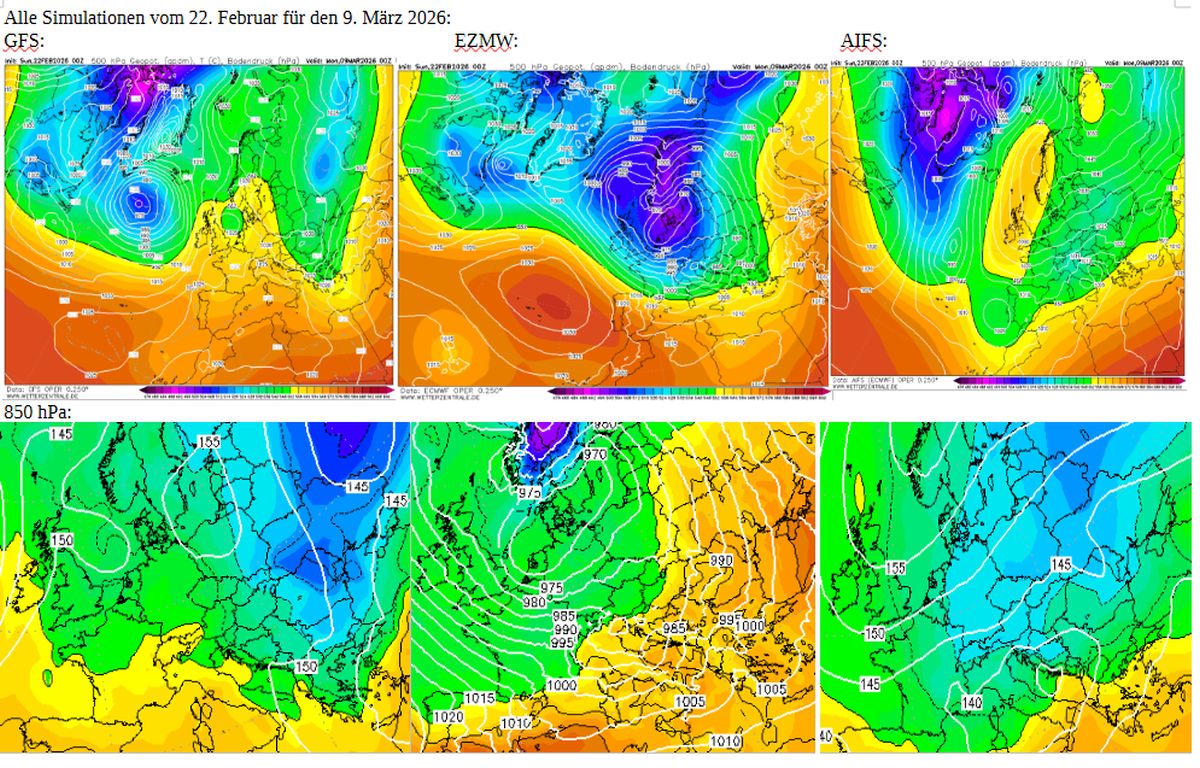

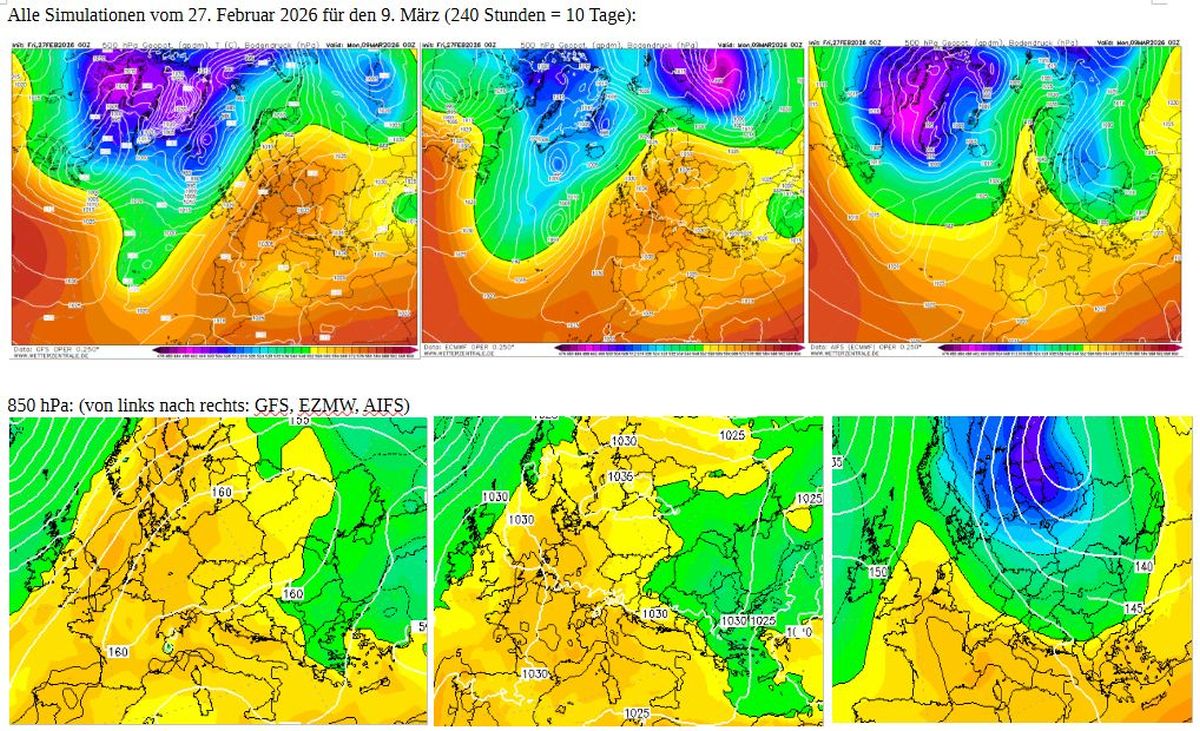

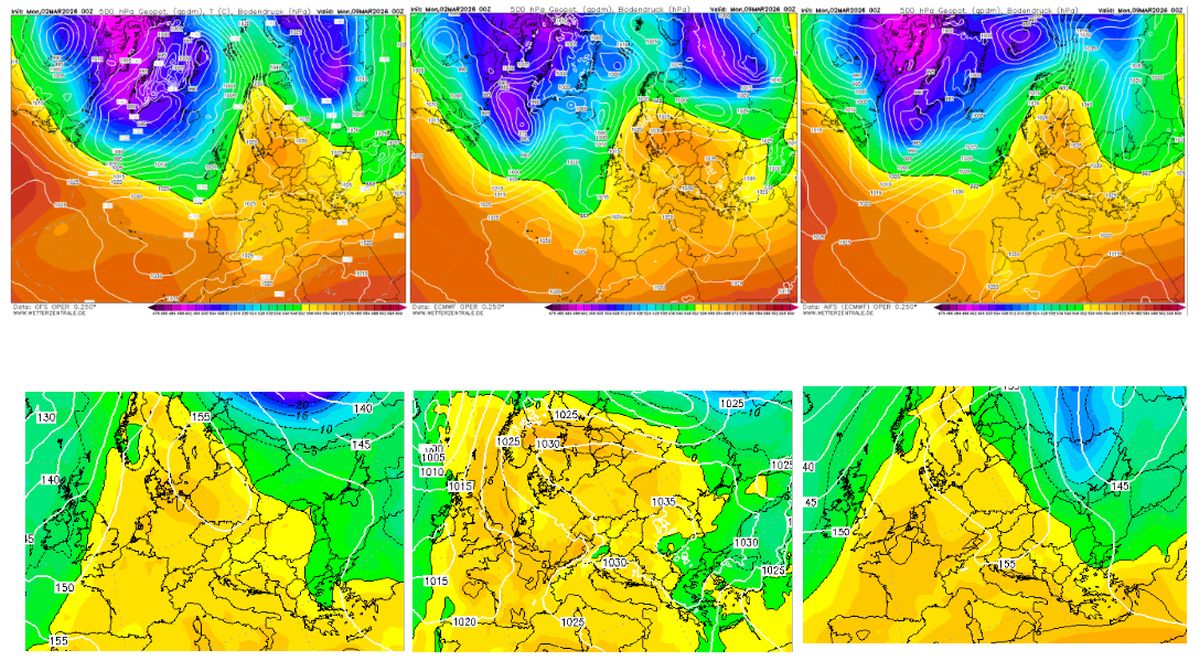

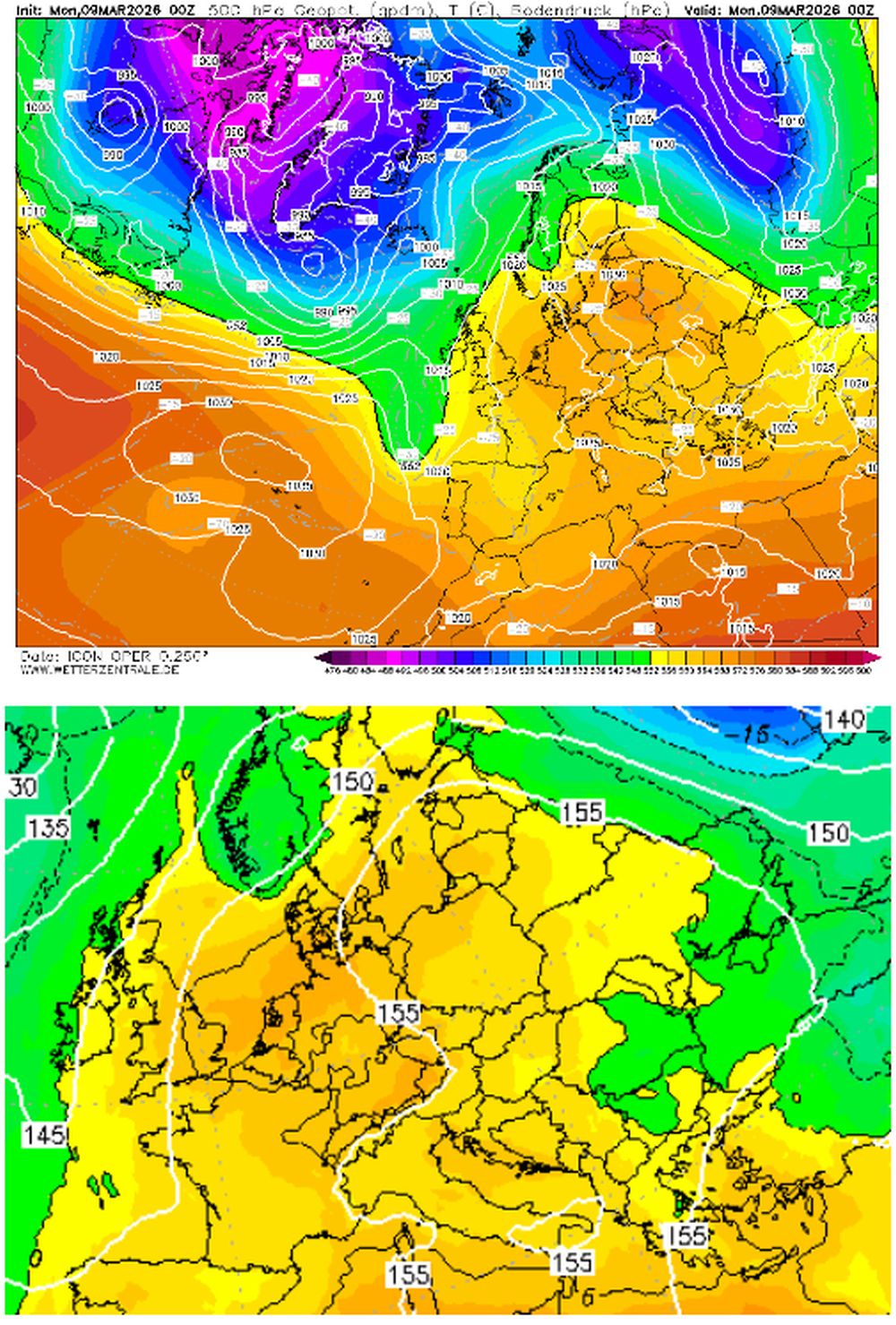

Anmerkung des Übersetzers: Bei den WETTER-Vorhersagemodellen (72 bis max, 168 Std. im Voraus, danach zeigen sie mehr oder weniger nur noch statistisches Rauschen) muss man unterscheiden zwischen den Basisfeldern und der Modell-eigenen Interpretation. Basisfelder sind die Verteilung von Druck, Feuchtigkeit und Temperatur in allen Schichten der Atmosphäre, so wie von Ridd beschrieben. Die Modell-eigene Interpretation interpretiert dann das Wetter, welches aus der Anordnung dieser Basisfelder folgt, also z. B. Niederschlagsmenge und -zeit, Sonnenscheindauer, Höchst- und Tiefsttemperaturen usw. Nichts Anderes machen auch die sog. „Wetter-Apps“. Die Erfahrung des Prognostikers dazu: Die Simulation der Basisfelder ist für 72 Stunden im Voraus fast perfekt, wie auch der Vergleich verschiedener Modellläufe (GFS, EZMW usw.) zeigt. Die Modell-eigene Interpretation ist es jedoch nicht, und hier kann ein erfahrener Prognostiker durchaus noch Verbesserungen des Modells erreichen. Es kommt nämlich immer wieder vor, dass verschiedene Modelle bei fast identisch simulierten Basisfeldern nach 72 Std. z. B. völlig unterschiedliche Niederschlagsmengen simulieren.

Nichts dergleichen gilt für Klima-Modelle.

Der Beitrag Warum Wettervorhersage-Modelle richtig gut geworden sind – Klimavorhersage-Modelle aber nicht erschien zuerst auf EIKE - Europäisches Institut für Klima & Energie.