Vorschau ansehen

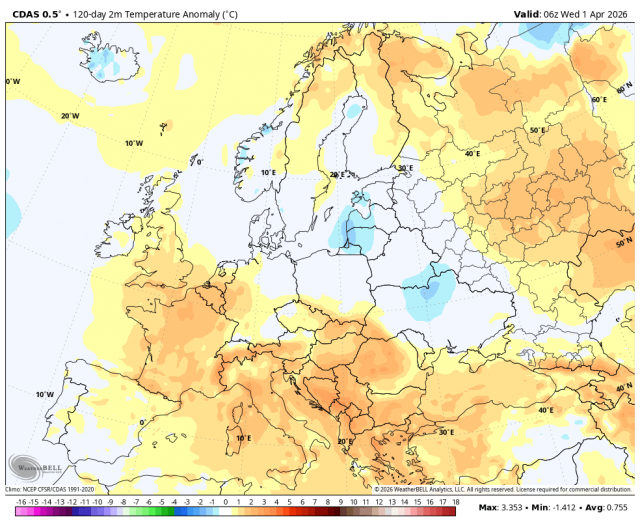

Meldungen vom 30. März 2026:

Europa: Der Winter kehrt zurück

In den letzten Märztagen hat der Winter in weiten Teilen Europas wieder Einzug gehalten, begleitet von Neuschnee, Minustemperaturen und einem derzeit über den Alpen tobenden heftigen Sturm.

In der Region Elbasan in Zentralalbanien sorgte starker Schneefall für eine abrupte Rückkehr des Winters in Elbasan, Librazhd, Gramsh und Prrenjas, wo sich 25 cm Schnee ansammelten; in höheren Lagen, darunter im Nationalpark Shebenik, fielen noch größere Schneemengen.

Im Süden, in Griechenland, kam es zu Schneefällen über den Bergregionen von Epirus und Westmakedonien. Im Nordwesten Griechenlands herrschen eher für den Hochwinter als für Ende März typische Bedingungen, so dass Schneeräumdienste im Einsatz sind.

Im Osten, in den Alpen, entwickelt sich ein zweistufiger Sturmzyklus.

Eine erste, eher schwache Welle brachte in der Nacht zum Samstag 15 cm Schnee in den westlichen und nördlichen Gebirgsregionen, wobei die Schneefallgrenze auf 400 m sank, und in den meisten Skigebieten gab es Schneeverwehungen.

Das Hauptereignis erstreckt sich von Montagnachmittag bis Dienstagabend, wobei die Modelle nun weitgehend übereinstimmen: Die Schneefallgrenze sinkt von anfänglich etwa 900–1.100 m unter 500 m während der höchsten Intensität, wobei in den nördlichen und westlichen Alpen flächendeckend 35–60 cm erwartet werden, lokal sogar weit mehr.

In besonders betroffenen Gebieten könnten 80 cm erreicht werden, teilweise sogar bis zu 100 cm.

Die Situation hat sich bereits als gefährlich erwiesen.

Im Zillertal, einem Alpental östlich von Innsbruck im Westen Österreichs, wurden am Wochenende zwei Freerider von einer Schneebrettlawine verschüttet. Einer konnte sich befreien; der andere wurde aus 1,6 m Tiefe geborgen, aber für tot erklärt. Die Lawinengefahr wurde aufgrund der Neuschneelast auf Stufe 4 von 5 eingestuft. Mit diesem Todesfall steigt die Gesamtzahl der Todesopfer in Österreich in dieser Saison auf 30, fast doppelt so viele wie im 10-Jahres-Durchschnitt.

…

————————————-

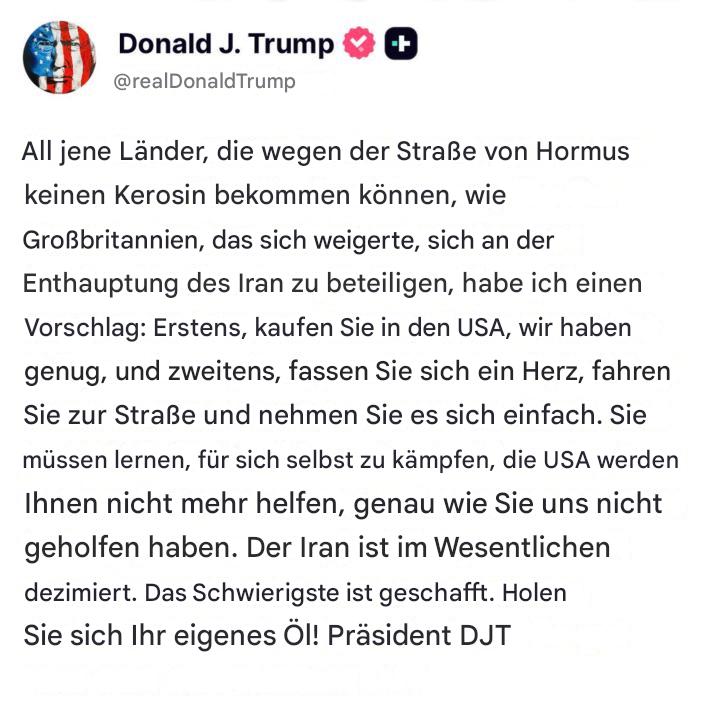

Die Kälte erstreckt sich bis nach Nordafrika

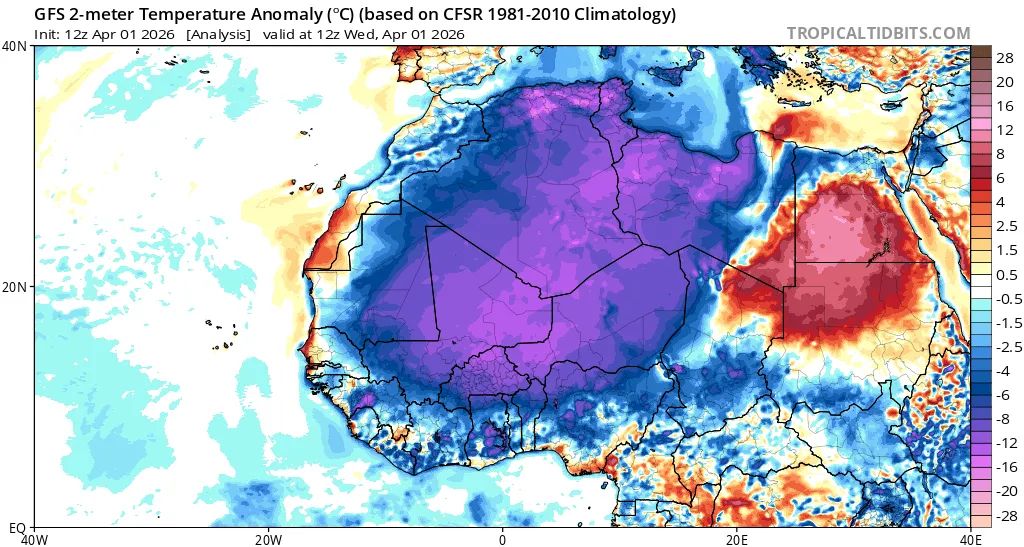

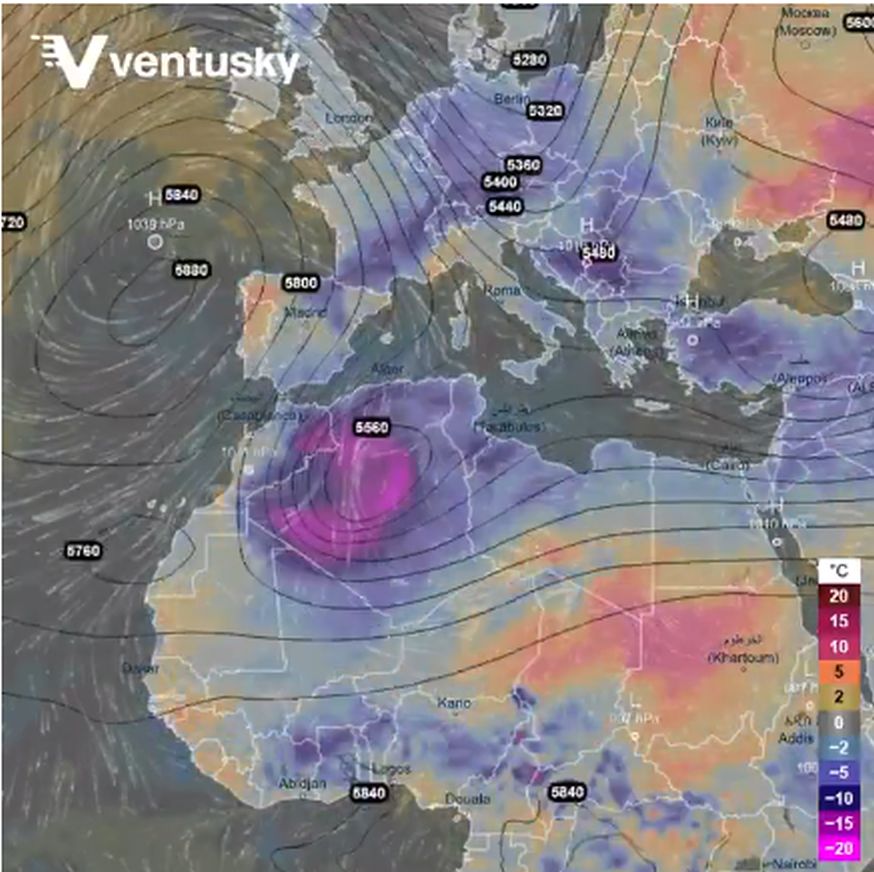

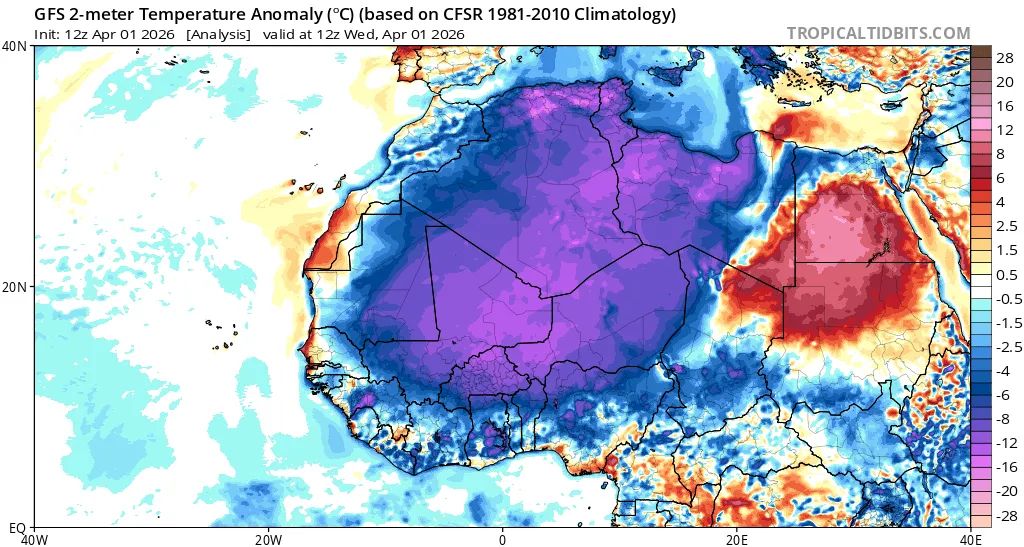

Die gleiche Kaltluftmasse, die derzeit Schnee in Europa bringt, dringt nun nach Süden in Richtung Sahara vor.

Aktuelle Vorhersagen zeigen Temperaturabweichungen von etwa 15 °C unter dem Normalwert in Teilen Nordafrikas. Anstelle der üblichen Tageshöchsttemperaturen um die 25 °C könnten einige Regionen Mühe haben, zweistellige Werte (10 °C) zu erreichen.

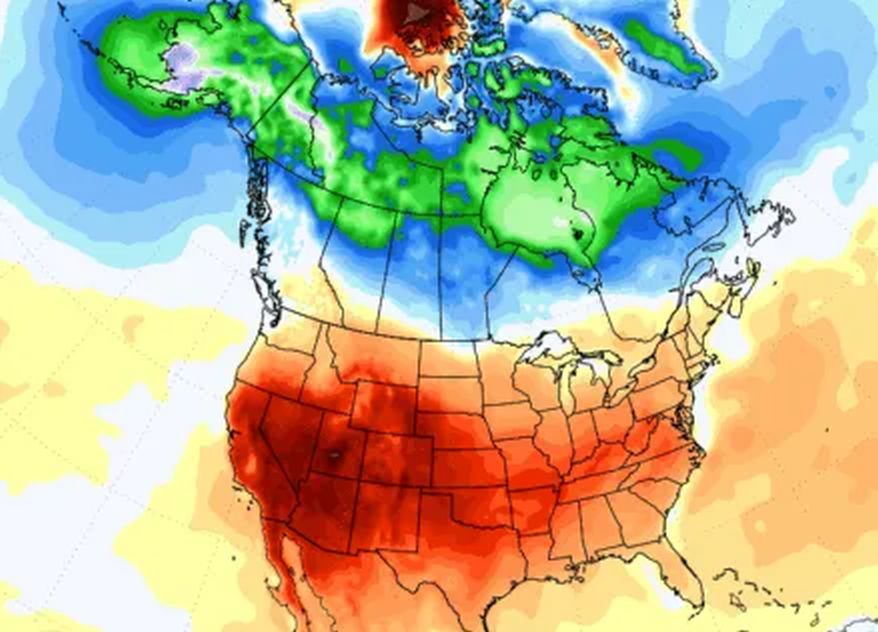

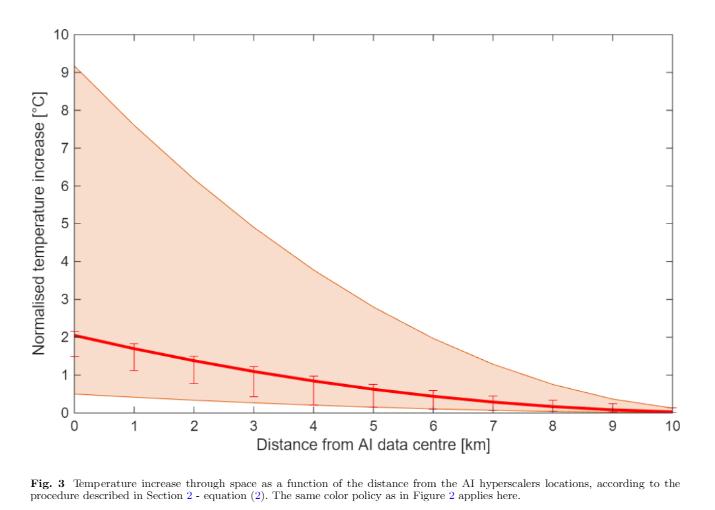

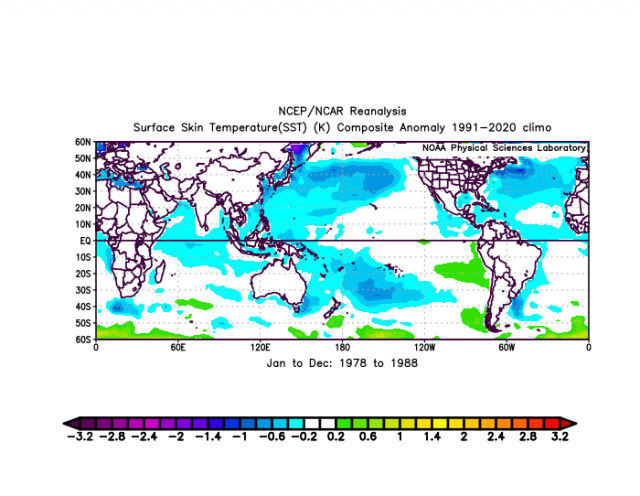

Graphik: 500-hPa-Strömungsfeld (dünne Linien) und Temperatur-ABWEICHUNG am Boden lt. Farbskala rechts unten.

In den höheren Schichten dürfte ein sich bildendes Tiefdruckgebiet die Instabilität verstärken, wodurch Feuchtigkeit tief in die Wüstenregionen vordringen kann. Das Ergebnis ist eine seltene Wetterlage, die in Teilen der Sahara zu Niederschlägen führt.

Kalendertechnisch ist es zwar Ende März, doch in einem breiten Streifen von Mitteleuropa bis zur Sahara verhält sich die Atmosphäre ganz anders.

————————————-

Kaschmir: Viele Lawinen

Entlang der Autobahn zwischen Srinagar und Leh im Norden Indiens sind mehrere Lawinen abgegangen; dabei kamen sieben Menschen ums Leben und fünf weitere wurden verletzt, nachdem Fahrzeuge in der Nähe des Zojila-Passes unter Schnee und Geröll begraben worden waren.

Rettungskräfte wurden sofort entsandt und bemühten sich, den Schnee zu räumen und die unter den Trümmern Verschütteten zu lokalisieren.

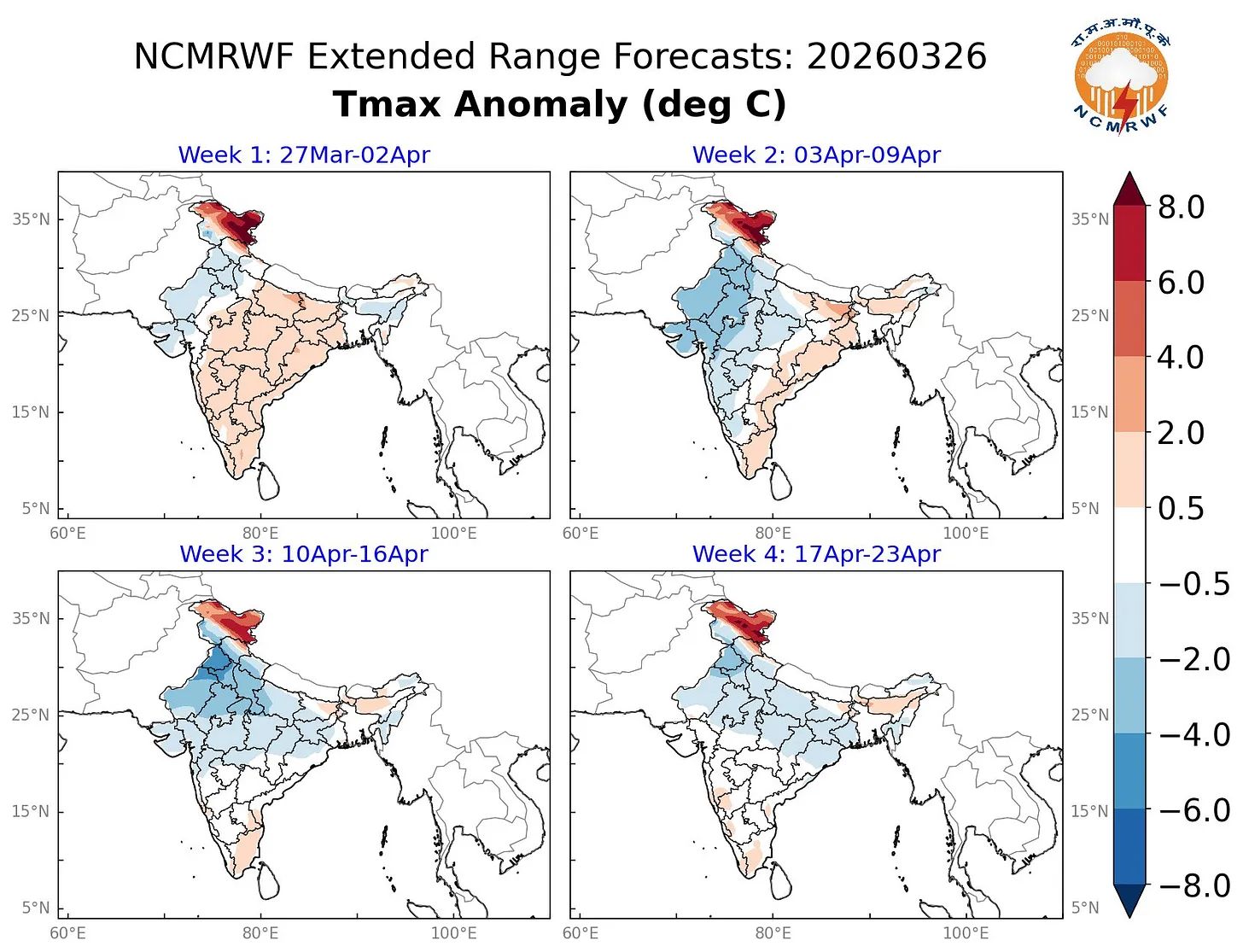

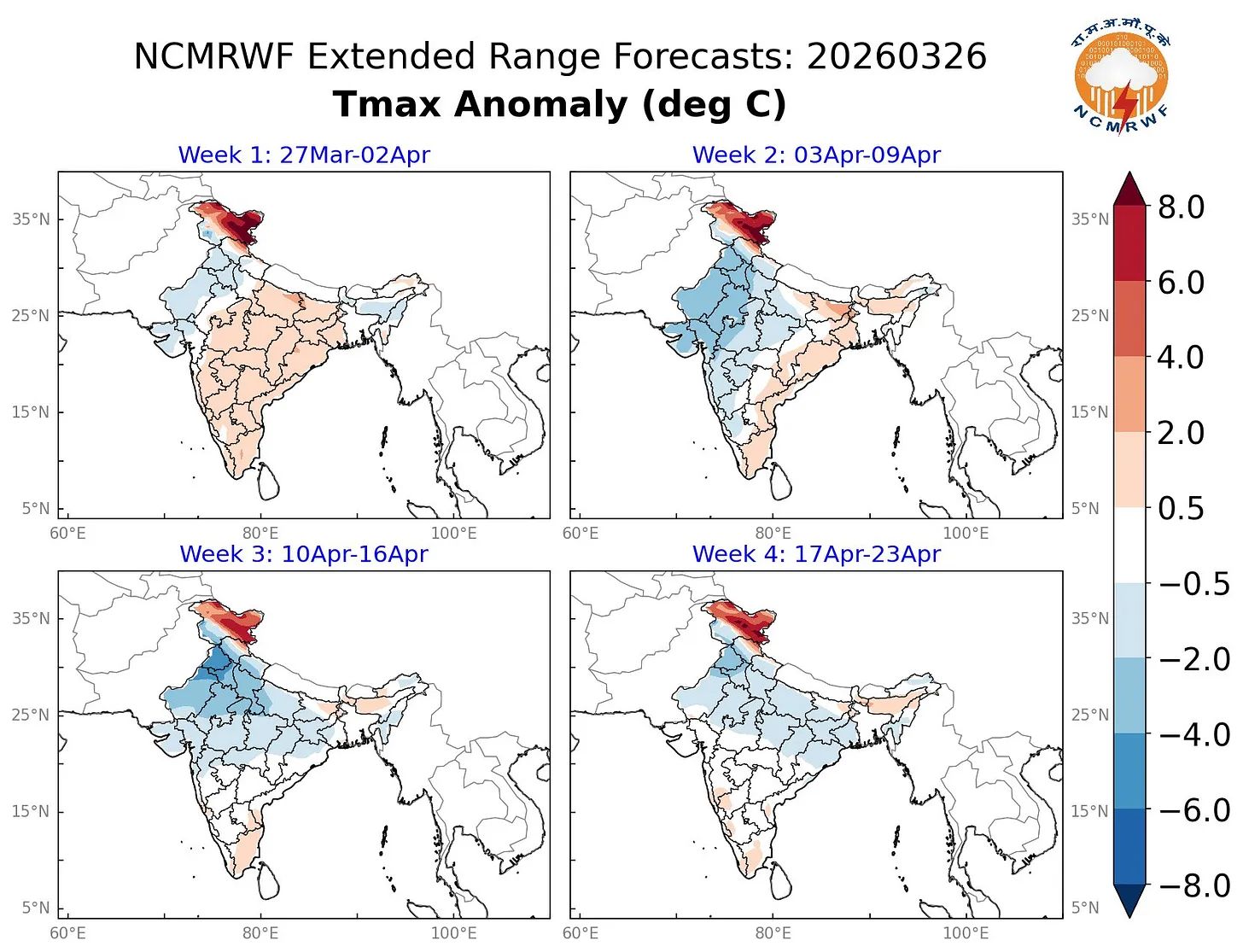

Mit Blick auf die Zukunft werden häufig Wettersysteme von Westen her weiterhin über Nordindien ziehen, wodurch die Temperaturen niedrig bleiben und wahrscheinlich bis mindestens zum 20. April keine Hitzewellen im April auftreten werden – was in diesem Teil der Welt oft ein Problem zu Beginn der Saison darstellt.

Auch in den Ebenen hat sich der jahreszeitliche Temperaturanstieg verzögert.

————————————-

Kanada: Spätfrost in Quebec

In Nunavik, Quebec, wurde gerade eine extreme Kältewelle verzeichnet.

Die Region verzeichnet Rekordwerte für Ende März: In Renard Mine sank die Temperatur auf -45 °C, im Pingualuit-Nationalpark auf -40,7 °C, in den Monts de Puvirnituq auf -40,5 °C, in Akulivik auf -39,8 °C und in der Raglan-Mine auf -38,7 °C.

Zum Vergleich: Der bisherige Tiefstwert für den Monat April in Quebec liegt bei -40 °C. Doch schon jetzt, nur wenige Tage vor Ende des Monats, friert die Provinz bei -45 °C.

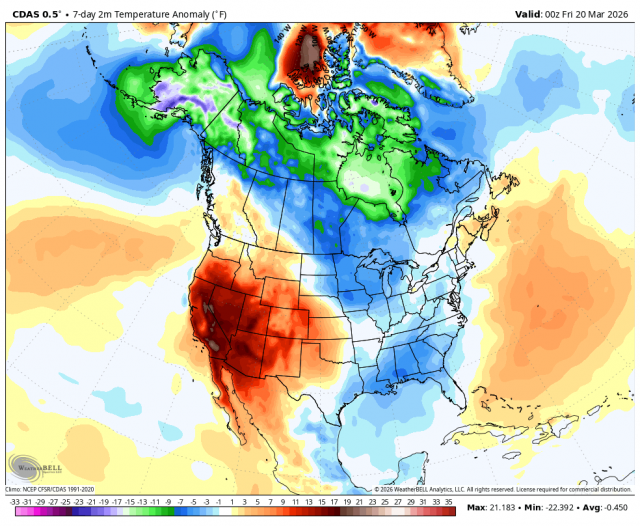

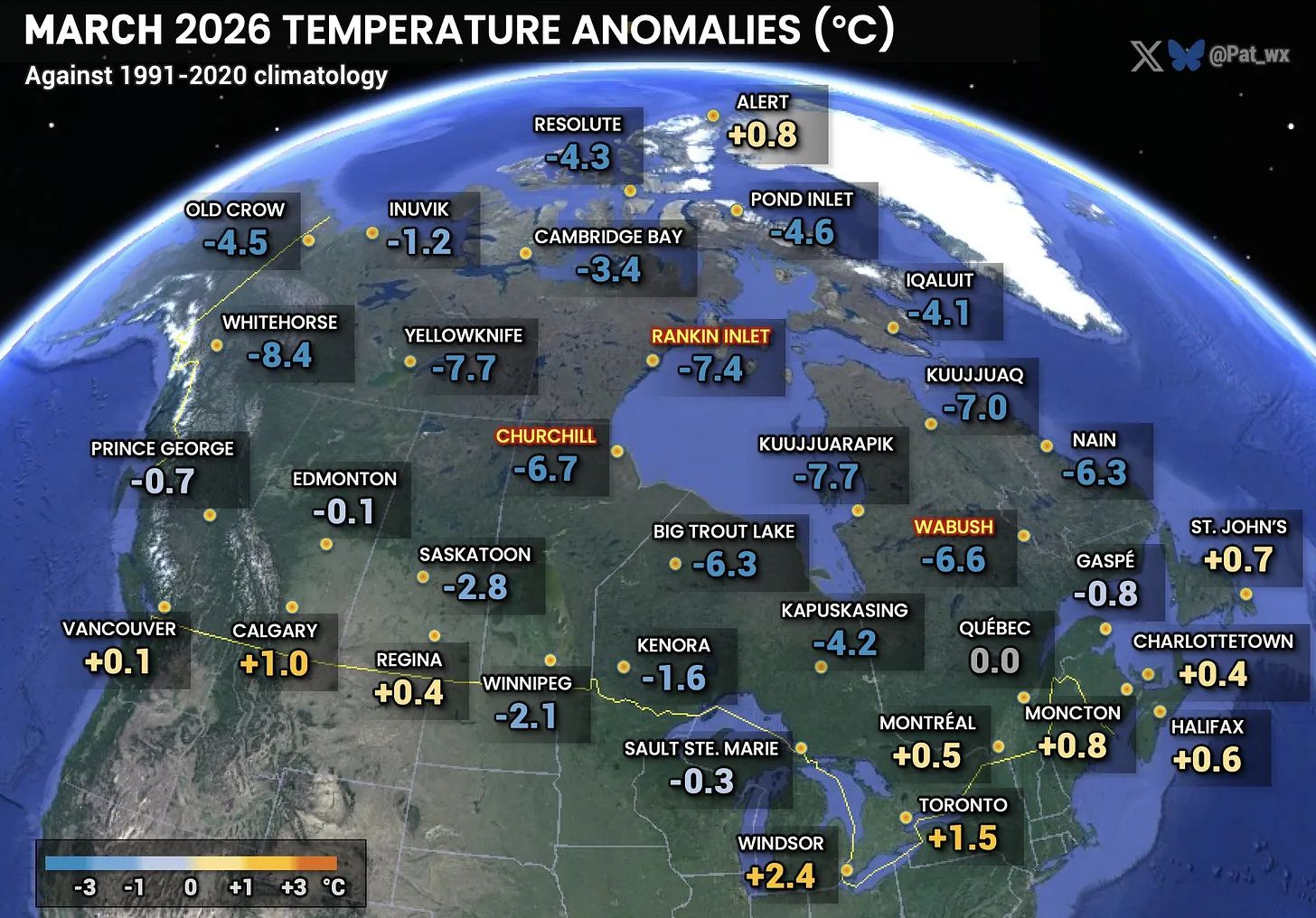

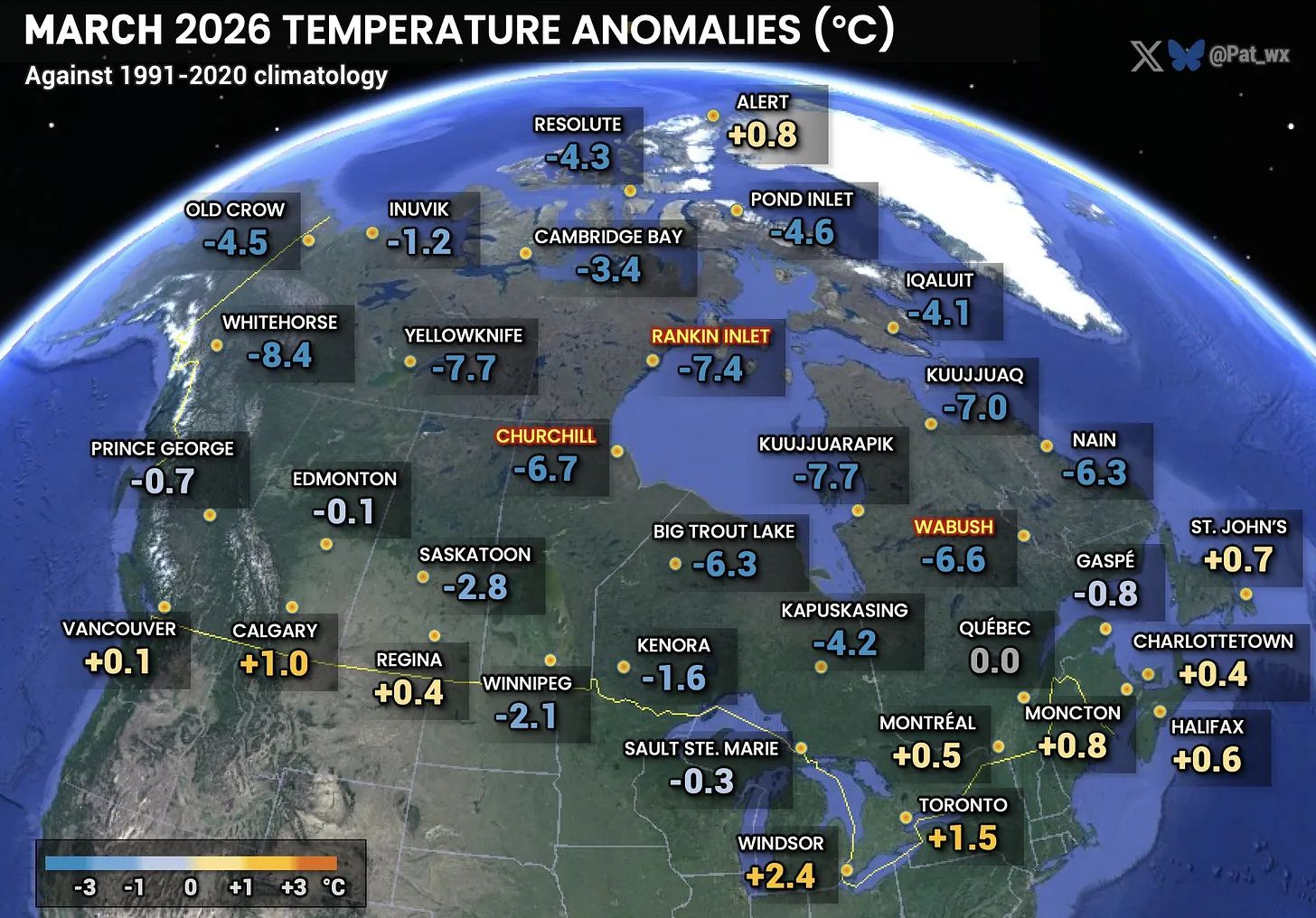

In weiten Teilen Kanadas lagen die Temperaturen in diesem März deutlich unter dem Normalwert.

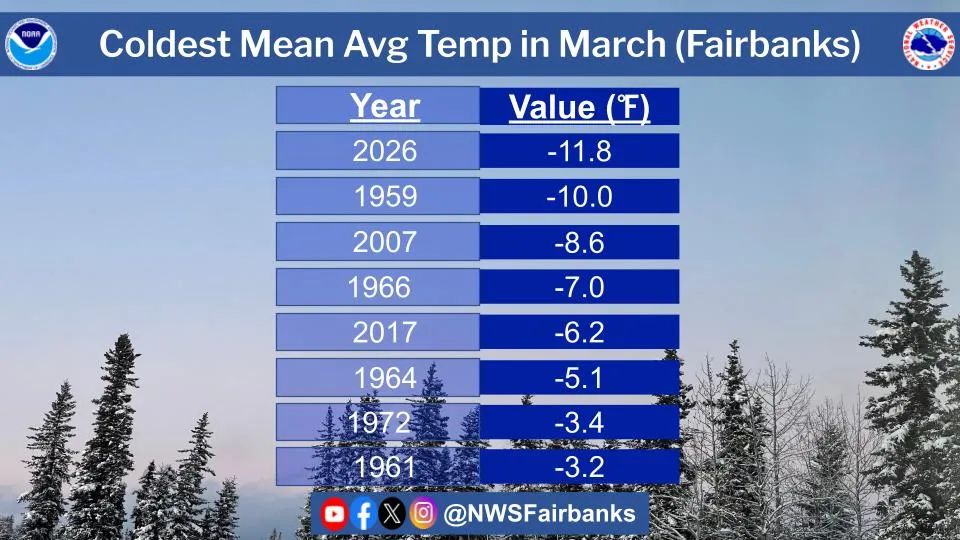

Das gilt auch für Alaska.

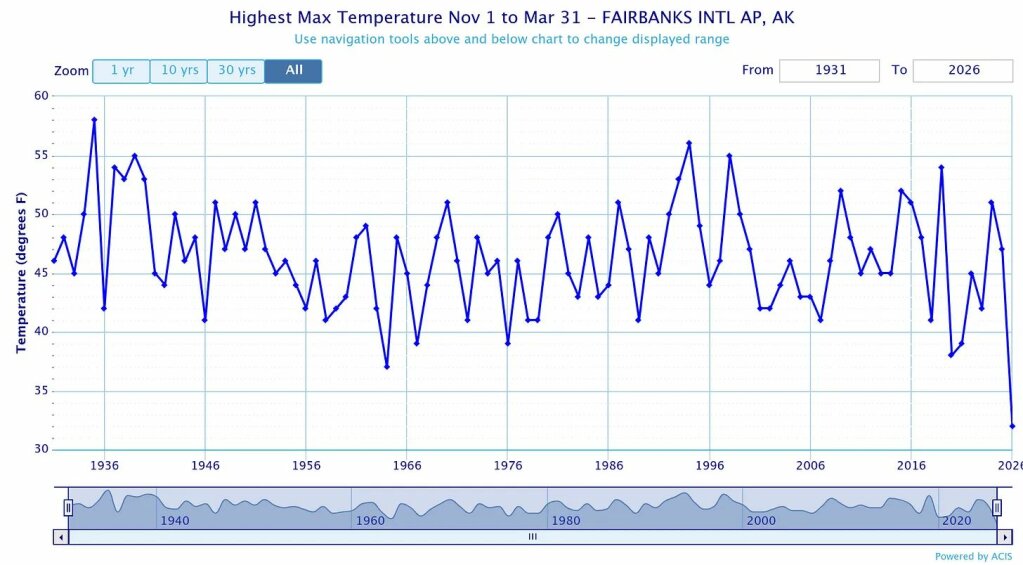

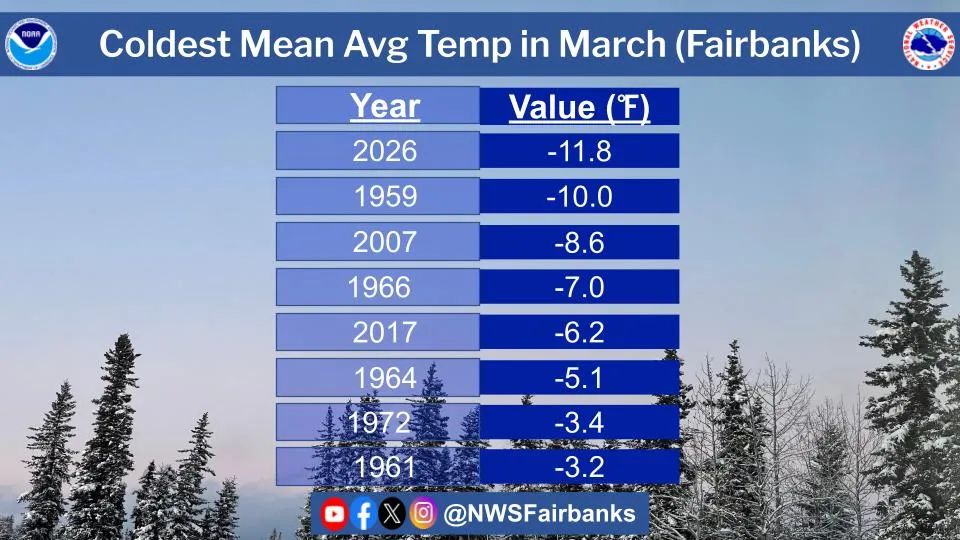

Fairbanks beispielsweise ist auf dem besten Weg, den kältesten März seit Beginn der Aufzeichnungen (seit 1929) zu verzeichnen:

Niedrigster Wert in diesem Jahr: -11,8°F ≈ -24,3°C! {Höchster Wert im Jahr 1961 -3,2°F ≈ -19,6°C}

Link: https://electroverse.substack.com/p/winter-returns-to-europe-cold-extends?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

————————————-

Meldungen vom 31. März 2026:

Kanada: Auch Ende März im Griff arktischer Kälte

Der Winter hat Kanada nach wie vor fest im Griff.

In Rivière aux Feuilles, Nunavik, Quebec, sank die Temperatur am 30. März auf -43,3 °C – ein extremer Wert für diese späte Jahreszeit und rund 25 °C unter dem Durchschnitt. Zwei Tage vor April liegt dieser Wert nur 3,3 °C über dem absoluten April-Rekordwert für Quebec.

Das ist kein Einzelfall. In weiten Teilen Kanadas lagen die Temperaturen bis März deutlich unter dem Normalwert.

Und diese Wetterlage hält an.

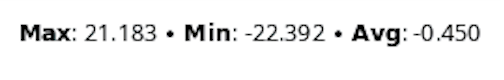

Eine anhaltende Tiefdruckrinne über Kanada hält die arktische Luft fest, während in weiten Teilen der Vereinigten Staaten ein Hochdruckgebiet vorherrscht. Eine positive Arktische Oszillation drängt die Kälte praktisch in die hohen Breitengrade – mit Kanada im Zentrum.

Die Vorhersagen deuten auf kaum Veränderungen im April hin.

Unterdurchschnittliche Temperaturen werden voraussichtlich im ganzen Land anhalten.

Der Frühling mag laut Kalender bereits begonnen haben. Doch in ganz Kanada (sowie in Alaska, weiten Teilen Grönlands und Zentralsibiriens) ist der Winter noch nicht abgezogen.

————————————-

USA: April-Schnee südlich der Grenze zu Kanada

Diese Kälte wird in den kommenden Tagen im Süden etwas nachlassen, da Sturmsysteme in die USA ziehen.

Wärmere Luft drängt vom Golf nach Norden und lässt die Temperaturen in weiten Teilen des Ostens der USA steigen. Diese Wärme trifft jedoch auf die fest sitzende Kälte im Norden und wird zu einem aktiveren Wettergeschehen führen.

Bis Anfang April reihen sich mehrere Tiefdruckgebiete über den Mittleren Westen und die Region der Großen Seen auf, wobei auf der kalten Seite wieder Schnee fällt. Die Schneemengen nehmen im nördlichen Teil des Landes daher wieder zu.

…

————————————-

Alpen: Weitere starke Schneefälle

Am 30. und 31. März zog ein weiteres Tiefdruckgebiet über die europäischen Alpen hinweg und brachte an den Nordhängen verbreitet Schneefall.

Die Gesamtneuschneemengen liegen in höheren Lagen im Großen und Ganzen im Bereich von 50 cm, wobei es lokal zu höheren Werten gekommen ist.

Es hat bis auf 400 m hinab geschneit – ungewöhnlich tief für Ende März –, was sich stellenweise auch auf Talebene ausgewirkt hat.

Im März gab es mehrere Neuschneefälle, wobei jedes Wettersystem die bereits gut ausgebildete Schneedecke weiter erhöht hat.

Starke Winde – bis zu 120 km/h in den Höhenlagen – begleiteten den Schneefall, bildeten instabile Schneebretter und erhöhten die Lawinengefahr in exponierten Geländen.

Link: https://electroverse.substack.com/p/late-march-arctic-cold-grips-canada?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

————————————-

Meldungen vom 1. April 2026:

Alpen: Kein Ende der starken Schneefälle

In den europäischen Alpen hat sich der Neuschnee rasch angehäuft – vielerorts werden 50 cm gemeldet, lokal sogar doppelt so viel.

In höheren Lagen in Teilen Frankreichs, der Schweiz, Österreichs und der bayerischen Alpen wurden mehr als ein Meter gemessen.

Starke Höhenwinde haben den Schnee über die üblichen Gebiete hinaus verteilt und die Schneemengen bis in Regionen wie das Tessin getrieben.

Viele Skigebiete bieten nun, kurz vor April, wieder Bedingungen wie mitten im Winter. Gletscher und höhere Lagen – Sölden, Stubai, Zermatt, Val Thorens, Tignes – sind in bester Verfassung, mit tiefem Schnee und frischem Pulverschnee. Selbst Gebiete, die in der Spätsaison traditionell eher mäßige Bedingungen bieten, sind wieder ins Spiel gekommen, wie Ischgl, St. Anton, Engelberg und Verbier.

„Die Bedingungen sind besser als Mitte Februar“, sagte ein Skifahrer.

Die Rückkehr des Winters beschränkt sich nicht nur auf die Alpen. Weiter südlich hat das sonst so milde Sardinien im Mittelmeer gerade einen starken Kälteeinbruch erlebt.

Im Gennargentu-Gebirge ist Schnee gefallen; in Su Separadorgiu wurden auf rund 1.440 m Höhe -2,1 °C gemessen, und in weiten Teilen von Nuoro und Alta Gallura wurden Minustemperaturen gemeldet.

Oberhalb von 1.000 m hat sich Schnee festgesetzt – eine Seltenheit im Frühling.

Das Wetter war unbeständig, kalt und turbulent – eine Fortsetzung der allgemeinen Wetterlage in Europa, die in den letzten Wochen wiederholt Luft arktischen Ursprungs nach Süden getrieben hat.

————————————-

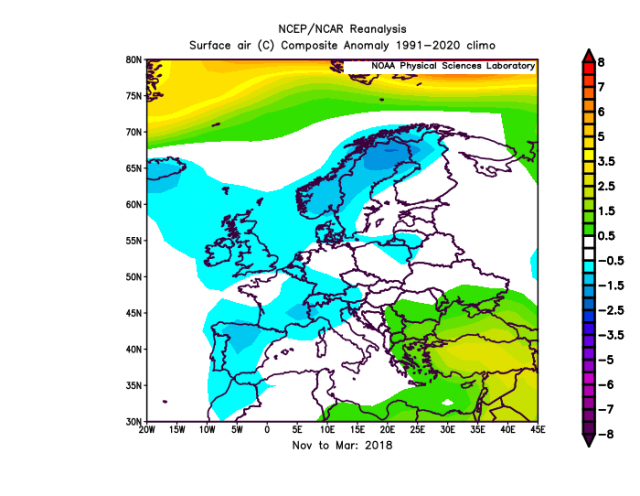

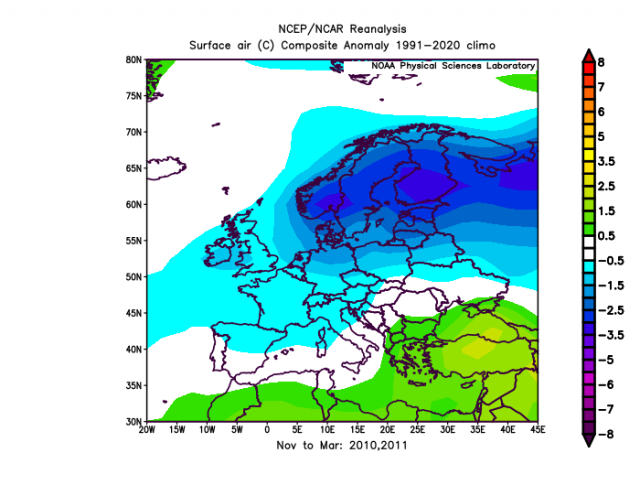

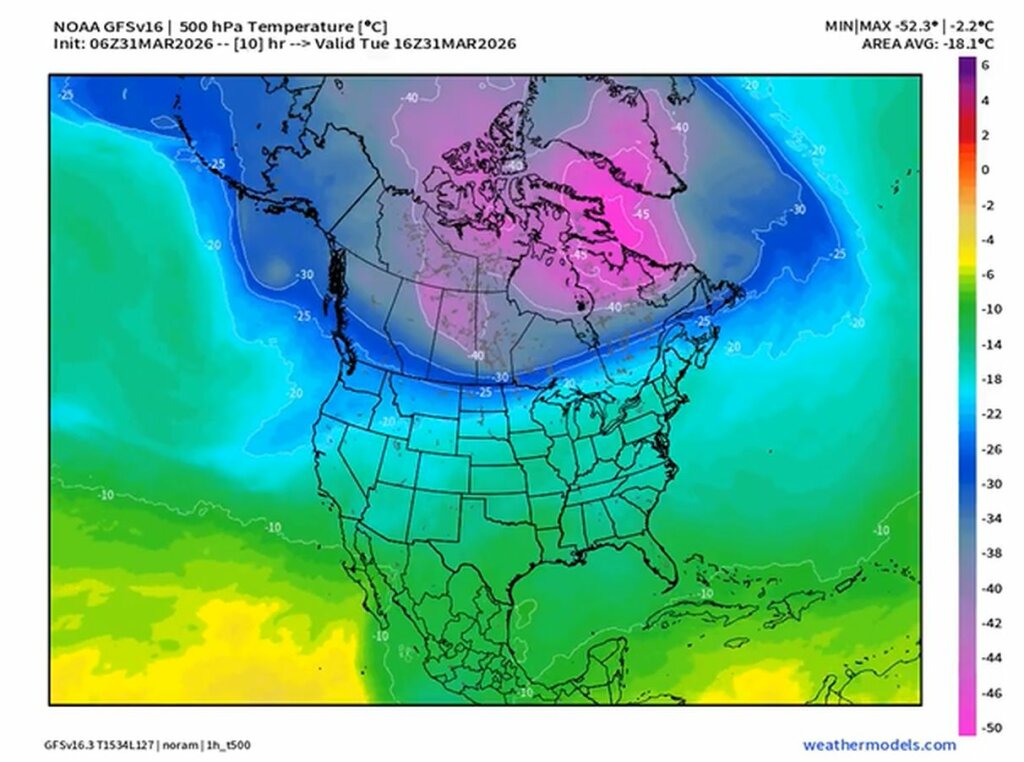

Nordamerika: Polarwirbel verstärkt sich wieder

Während ein Teil der Anomalie des Polarwirbels über die Labradorsee in Richtung Grönland verdrängt wird, taucht bereits ein weiterer hinter ihm auf – diesmal mit Ursprung in Sibirien, überquert die Arktis und zielt auf die gleiche Region ab. Das System lädt sich neu auf.

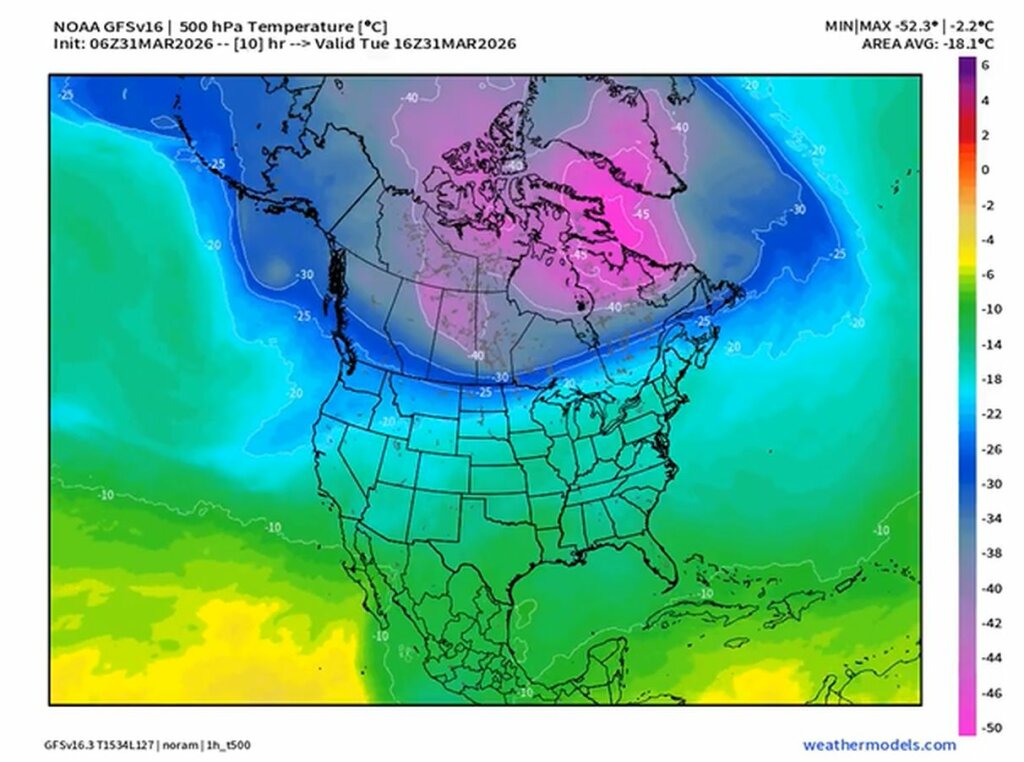

Der winterliche troposphärische Polarwirbel bleibt für diese Jahreszeit ungewöhnlich intensiv. In 500 mb sinken die Temperaturen in Teilen der nördlichen Hemisphäre immer noch auf rund -53 °C – Werte, die eher für den Hochwinter als für den April typisch sind.

Diese Kälte überträgt sich direkt auf die Erdoberfläche.

Diese Kälte überträgt sich direkt auf die Erdoberfläche.

Die Vorhersagen bis in die erste Aprilwoche hinein zeigen weitreichende Schneefälle in Ontario, Quebec, dem Mittleren Westen und der Region der Großen Seen. In vielen Regionen sind Gesamtmengen von 30 bis 60 cm zu erwarten.

Eine anhaltende Tiefdruckrinne über Kanada wirkt wie ein Anker und zieht arktische Luft immer wieder nach Süden. Jedes Mal, wenn sich das Muster zu verschieben beginnt, strömt eine weitere Kaltluftwelle aus dem polaren Reservoir herab – und setzt das System zurück.

Dies ist kein normaler saisonaler Verlauf. Bis Ende März sollte sich der Wirbel eigentlich abschwächen und aufbrechen.

Stattdessen scheint der Winter endlos zu dauern – besonders im Norden, wo immer wieder Rekorde gebrochen werden.

Nehmen wir zum Beispiel British Columbia.

In Tofino fielen die Temperaturen kürzlich auf -3,2 °C und brachen damit einen 121 Jahre alten Rekord aus dem Jahr 1905 (Aufzeichnungen reichen bis 1896 zurück).

In Burns Lake sank die Temperatur auf -19,5 °C, in Chetwynd auf -19,9 °C und in Campbell River auf -4,6 °C – ebenfalls allesamt neue Tagesrekorde. Port Hardy, Squamish und Sechelt verzeichneten ebenfalls neue Tiefstwerte für Ende März, während Bella Bella seinen Rekord einstellte.

Dies sind keine vereinzelten Ausreißer. Der Kalender mag zwar April anzeigen, doch große Teile Kanadas bekommen keine Verschnaufpause.

————————————-

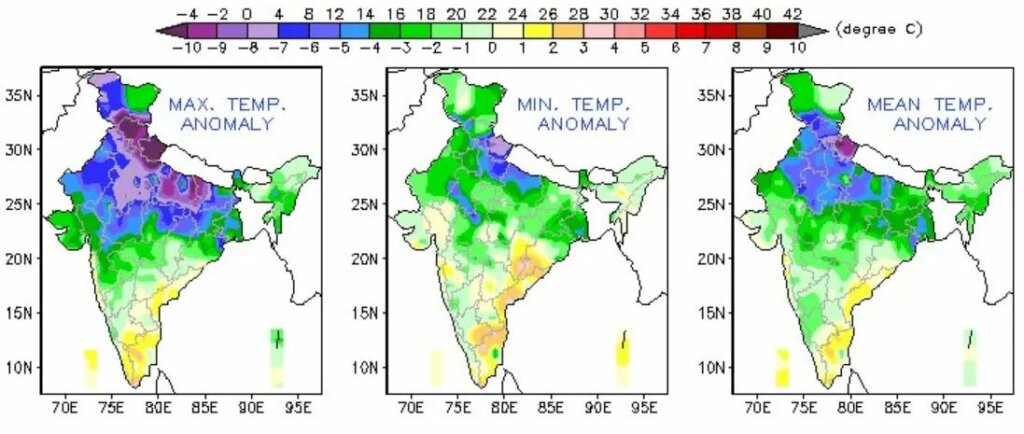

Nordindien: Seltene April-Kälte

Ein mäandrierender Jetstream wird ab dem 3. April eine Tiefdruckrinne nach Süden in Richtung des asiatischen Subkontinents führen. Diese Wetterlage wird kältere Luft ungewöhnlich weit nach Süden treiben und eine starke westliche Störung über Indien anfachen.

In den nördlichen und westlichen Regionen ist in wichtigen landwirtschaftlichen Gebieten mit einem Einbruch winterähnlichen Wetters zu rechnen. Auch in Zentralindien und Teilen der südlichen Halbinsel werden seltene und heftige Abendgewitter erwartet – und das in einem der trockensten Monate Indiens.

Die Rabi-Ernte, die kurz bevorsteht, ist anfällig für Kälte, Hagel und untypische Niederschläge.

Es ist mit weitreichenden Ernteschäden und -ausfällen zu rechnen.

Eine gekrümmte Jetstream-Strömung stört den saisonalen Übergang und verzögert den Beginn der beständigen Hitze vor dem Monsun. Anstelle eines stetigen Übergangs in den Sommer bleiben die Bedingungen bis Anfang April unbeständig, wobei die Hitze frühestens Mitte des Monats einsetzen dürfte.

Link: https://electroverse.substack.com/p/late-march-snow-buries-the-alps-as?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

————————————-

Meldungen vom 2. April 2026:

Östliches Kanada: April beginnt mit Rekord-Kälte

In Kanada werden weiterhin Tiefsttemperaturen unter -40 °C gemessen.

Schefferville in Quebec hat mit -40,4 °C einen neuen provinzweiten Kälterekord für den Monat April aufgestellt und damit die bisherige Bestmarke von -40 °C aus dem Jahr 1994 in Bonnard gebrochen (die Aufzeichnungen in Quebec reichen bis Ende des 19. Jahrhunderts zurück).

In der Nähe stellte Rivière aux Feuilles mit -39,8 °C einen neuen April-Rekord auf.

In Kuujjuarapik sank die Temperatur auf -36,2 °C und unterbot damit das bisherige April-Tief von -33,9 °C, das 1950 und 1970 gemessen worden war.

Weiter östlich erreichte der Wabush Lake in Labrador -35,3 °C – knapp unter den monatlichen und provinziellen April-Rekorden.

Dies ist kein Einzelfall. Es folgt auf einen außergewöhnlich kalten März im gesamten Norden Kanadas.

Weite Teile der Territorien, Ontarios, Quebecs und Labradors erlebten den kältesten Monat der Saison. Messstationen wie Rankin Inlet (seit 1953), Churchill (seit 1929) und Wabush (seit 1960) verzeichneten im März durchschnittliche Rekordtiefstwerte.

Diese Wetterlage hält weiter an. Die arktische Kaltluft hat sich im Norden festgesetzt, und es gibt kaum Anzeichen für einen normalen Saisonwechsel.

Und es ist nicht nur die Kälte.

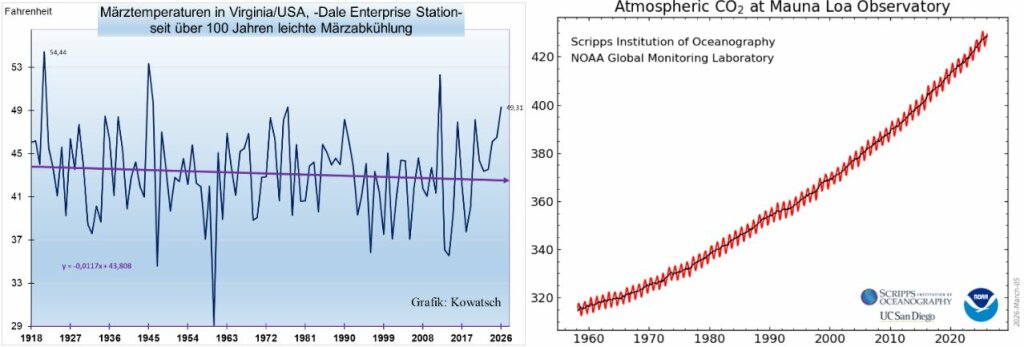

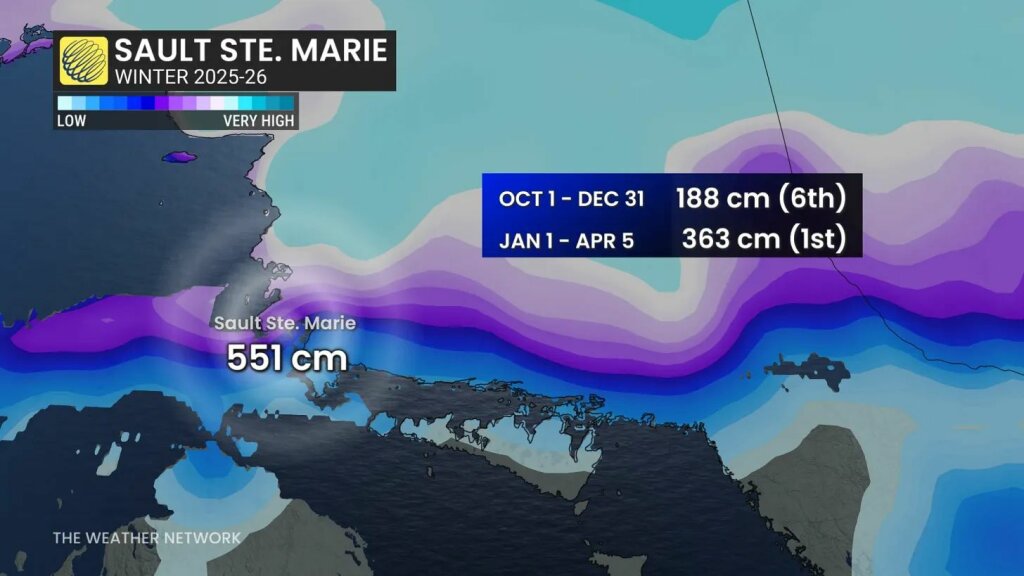

Im Westen Kanadas fällt weiterhin Schnee. Skigebiete wie Banff Sunshine, Whistler Blackcomb und Lake Louise planen nun, bis in den Mai hinein geöffnet zu bleiben. Allein Marmot Basin verzeichnete in den letzten 7 Tagen 55 cm Neuschnee.

————————————-

Sahara: Außerordentliche Kälte

Eine seltene Kältewelle hat sich bis tief in die zentrale Sahara ausgebreitet und in Ländern wie Algerien zu Rekordtiefstwerten für den Monat April geführt.

Im Assekrem-Gebirge fielen die Temperaturen auf -6 °C – ein außergewöhnlicher Rekordwert für den April.

Weiter nördlich sank die Temperatur in Tamanrasset auf 2,3 °C – ebenfalls ein neuer Tiefstwert für den Monat April (seit den 1950er Jahren).

Im gesamten westlichen Sahel liegen die Temperaturen innerhalb von 2 °C der für April üblichen Werte.

————————————-

Italien und darüber hinaus: Seltene April-Schneefälle

In Roccacaramanico in Italien schneit es weiterhin außergewöhnlich stark, wobei sich bereits mehr als ein Meter Schnee angesammelt hat.

Im Mittelpunkt des Wettergeschehens steht das Apennin-Gebirge, wo feuchtwarme Mittelmeerluft auf die von Norden einströmende Kaltluft getroffen ist.

Schnee im April ist in dieser Region zwar nicht ungewöhnlich, wohl aber dessen Intensität.

Die Schneemengen haben rasch zugenommen, die Schneefallgrenze ist gesunken und die Schneedecke breitet sich über das Hochland der Abruzzen aus.

In den höheren Lagen herrschen wieder Bedingungen wie mitten im Winter.

In den Alpen hat es bis Anfang April weiter geschneit.

In der polnischen Tatra haben sich die Bedingungen drastisch verschlechtert: Tiefschnee, Sichtweiten nahe Null und instabile Hänge haben die Behörden dazu gezwungen, das Gebiet zu sperren. Die Schneehöhe hat stellenweise 1,8 m überschritten.

Alle 275 km Wanderwege im Tatra-Nationalpark wurden aufgrund der erhöhten Lawinengefahr gesperrt. Es gilt die Warnstufe 4 – die zweithöchste – was bedeutet, dass Lawinen bereits durch geringe zusätzliche Belastungen leicht ausgelöst werden können.

Link: https://electroverse.substack.com/p/april-opens-with-record-cold-across?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

————————————-

Meldungen vom 3. April 2026:

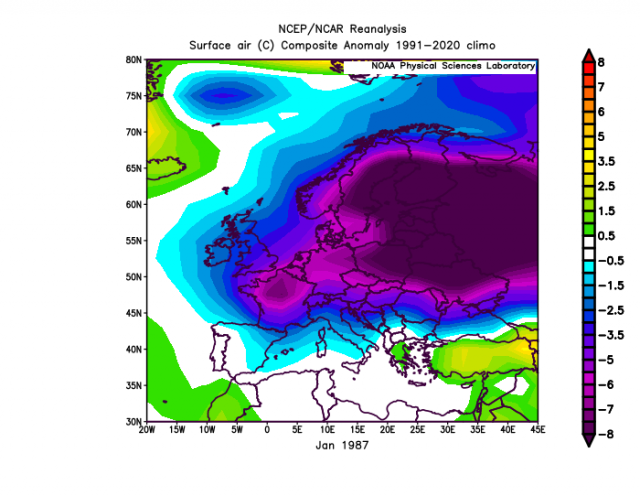

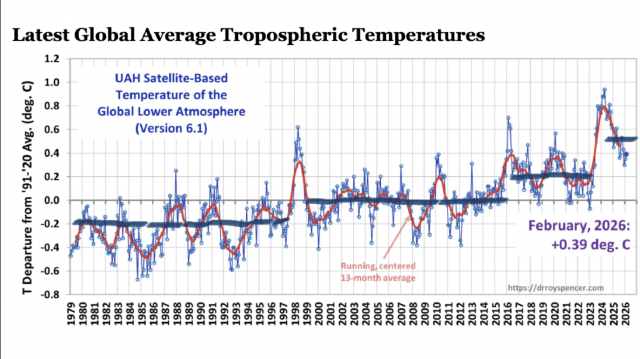

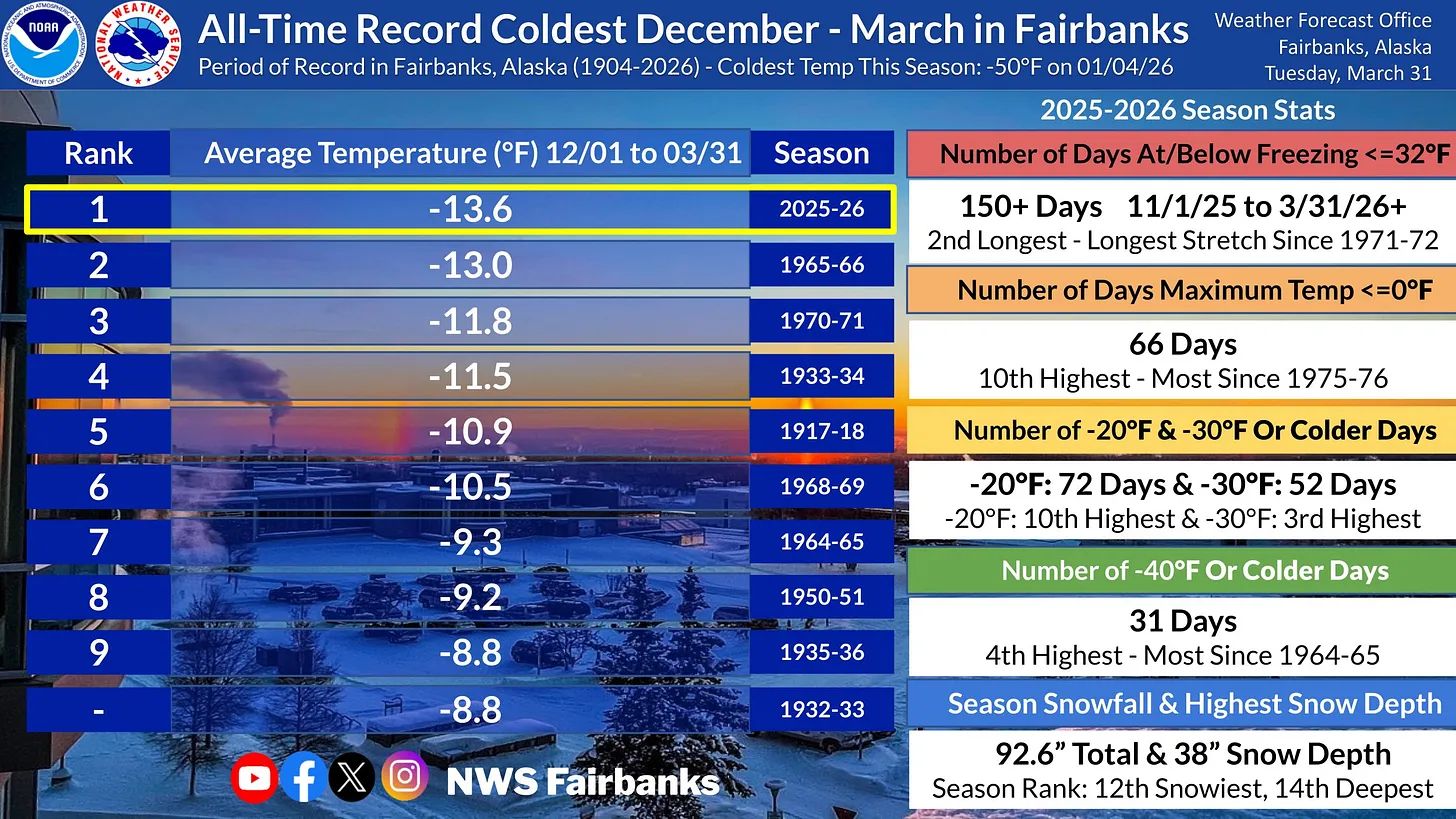

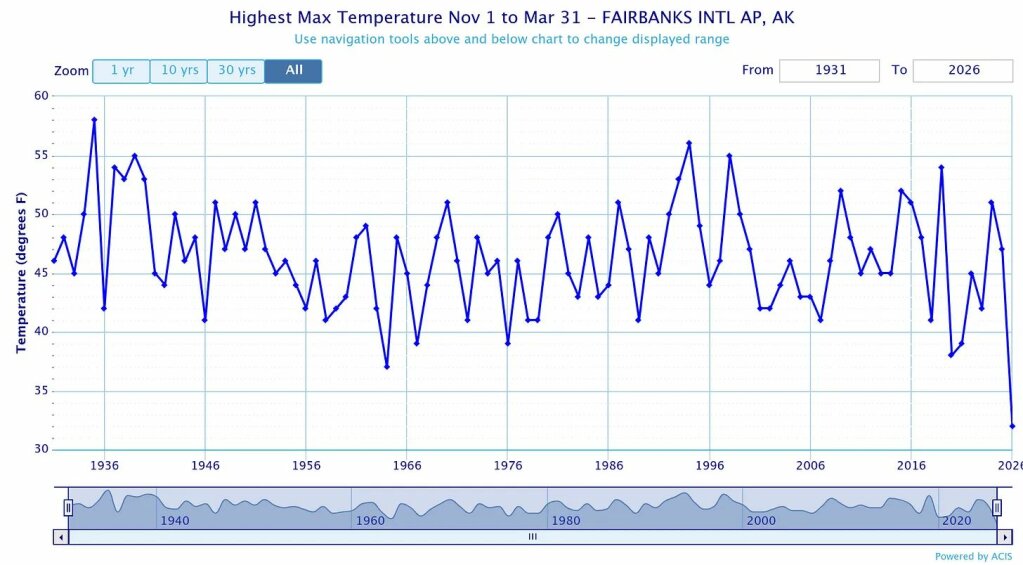

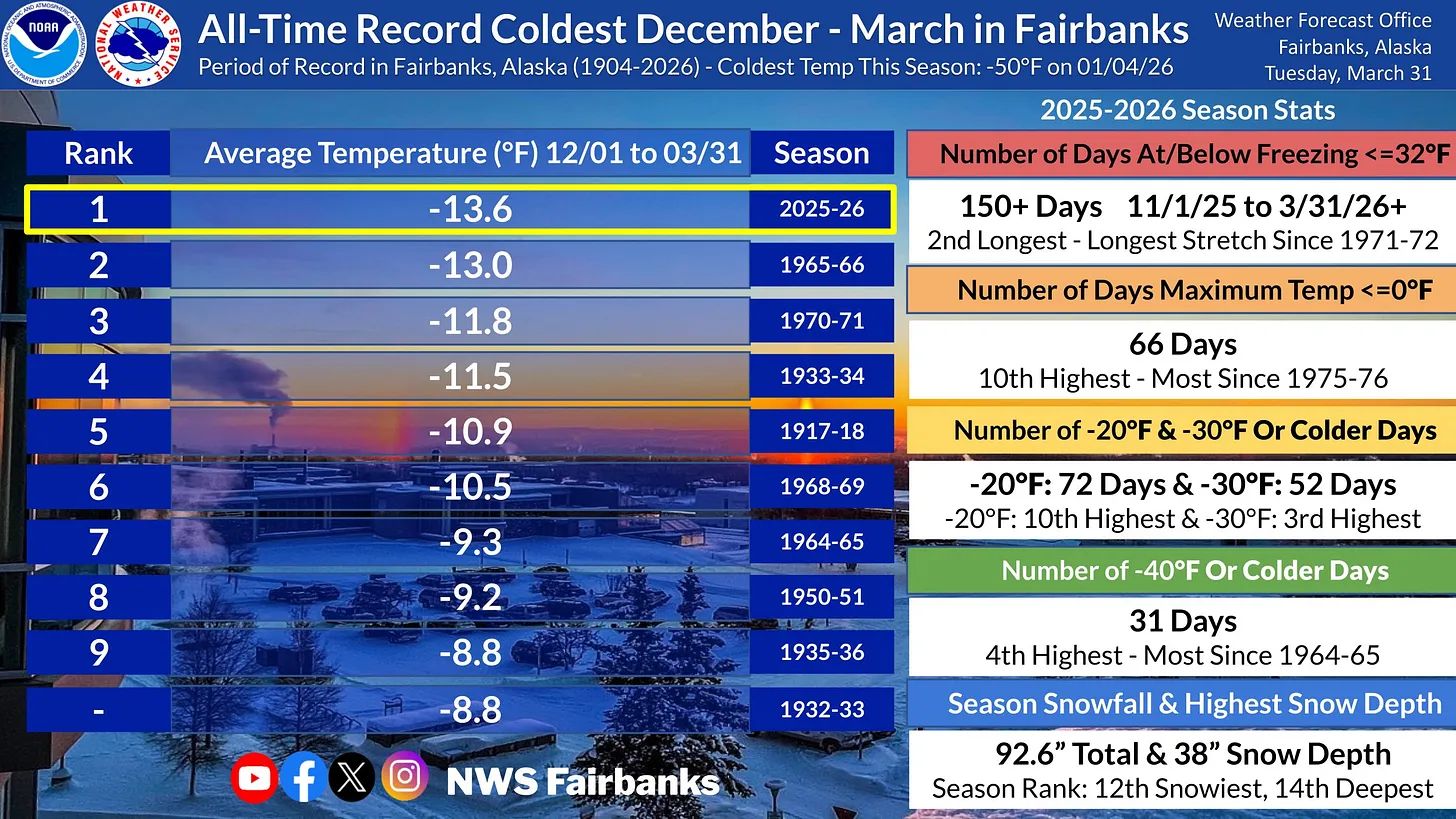

Alaska: Kältester Winter jemals in Fairbanks

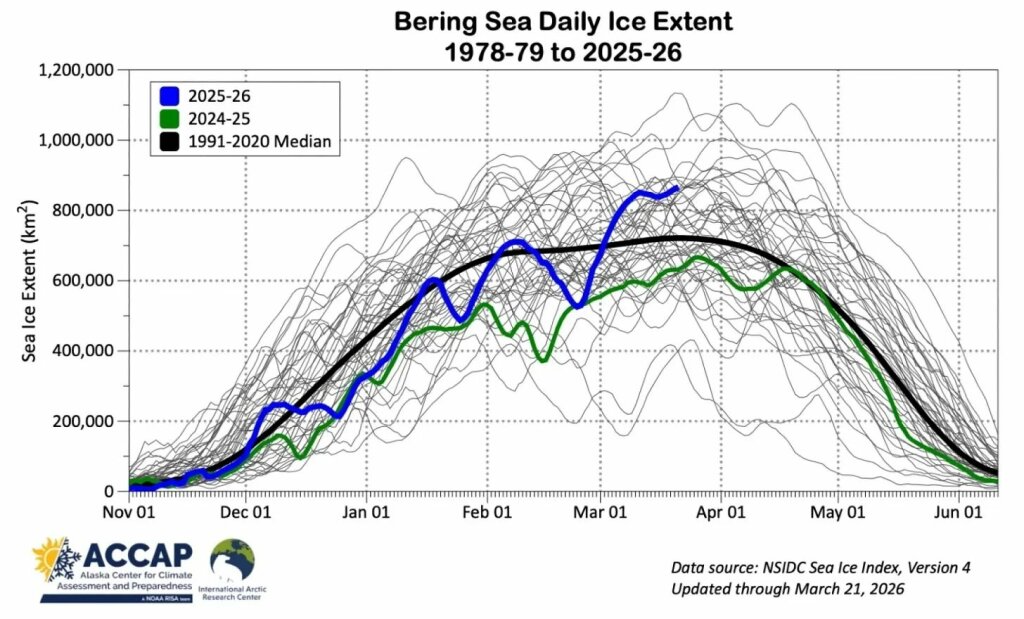

Fairbanks hat gerade den kältesten Zeitraum von Dezember bis März seit Beginn der Aufzeichnungen verzeichnet.

Die Durchschnittstemperatur in der Saison 2025/26 lag bei nur -25,3 °C – der niedrigste Wert seit Beginn der Aufzeichnungen im Jahr 1904.

Von November bis März stieg die Temperatur zu keinem Zeitpunkt über den Gefrierpunkt – das ist das erste Mal, dass dies passiert ist. Der letzte Tag mit Temperaturen über dem Gefrierpunkt war der 31. Oktober.

Die saisonalen Werte sind extrem:

• 152 Tage mit Temperaturen bei oder unter dem Gefrierpunkt

• 66 Tage mit Höchsttemperaturen bei oder unter -17,8 °C

• 72 Tage mit Temperaturen bei oder unter -28,9 °C

• 52 Tage mit Temperaturen von -34,4 °C oder darunter

• 31 Tage mit Temperaturen von -40 °C oder darunter

Temperaturspanne: –13,6°F ≈ –25,3°C; –8,8°F ≈ –22,7°C. A. d. Übers.

Diese Kälteperiode endete am Donnerstag um 17:05 Uhr, als die Temperatur +0,6 °C erreichte. Sie dauerte 152 Tage und stellte damit den Rekord für die späteste erste Temperatur über dem Gefrierpunkt in einer Saison ein.

Auch die Schneemenge war beeindruckend: 235 cm, was Platz 12 in der 122-jährigen Aufzeichnungsgeschichte bedeutet.

So sah es diesen Winter in weiten Teilen Alaskas und auch in weiten Teilen Kanadas aus…

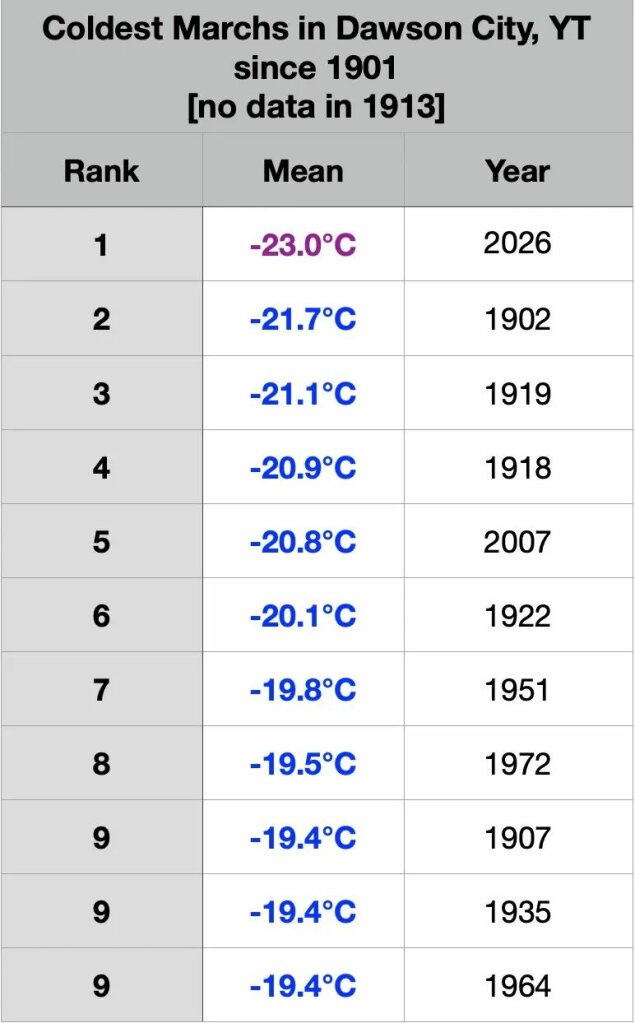

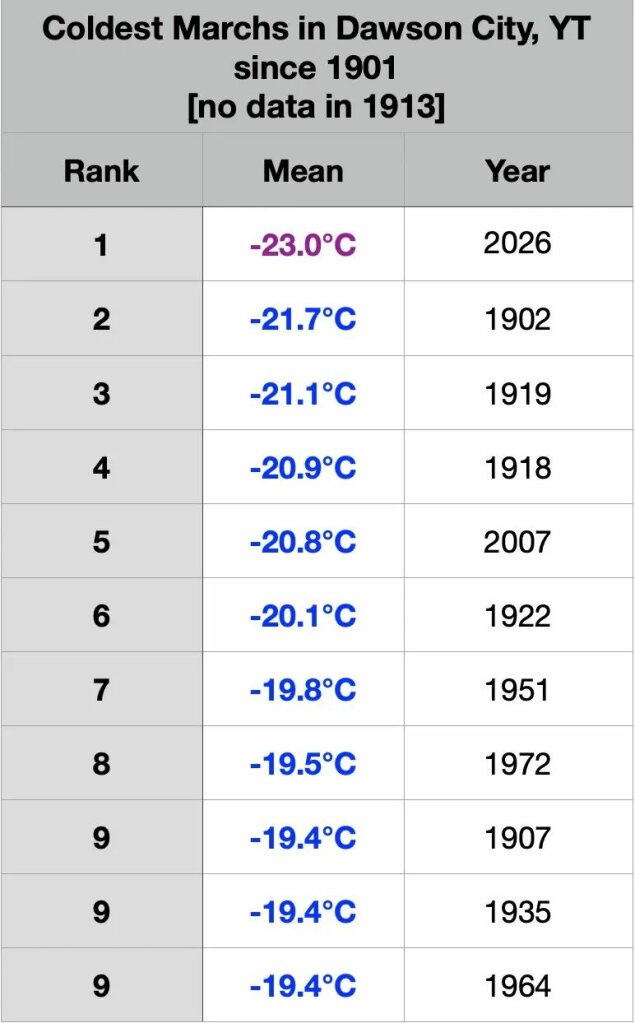

Neben Rankin Inlet (NU), Churchill (MB) und Wabush (NL) (wie gestern erwähnt) verzeichnete auch Dawson (YK) den kältesten März seit Beginn der Aufzeichnungen (Daten seit 1901). Der Monatsdurchschnitt lag bei -23 °C, ganze 10,4 °C unter dem Durchschnitt für den Monat März und sogar etwa 2 °C kälter als ein typischer Februar.

Fairbanks und andere Stationen liegen im Zentrum Alaskas weitab von irgendwelchen Küsten. Warum Kälterekorde dort – vor allem in dieser Größenordnung – ein ganz anderes Gewicht haben als Kälterekorde irgendwo in den Mittleren Breiten wird in einem Anhang am Ende dieses Reports erläutert. A. d. Übers.

————————————-

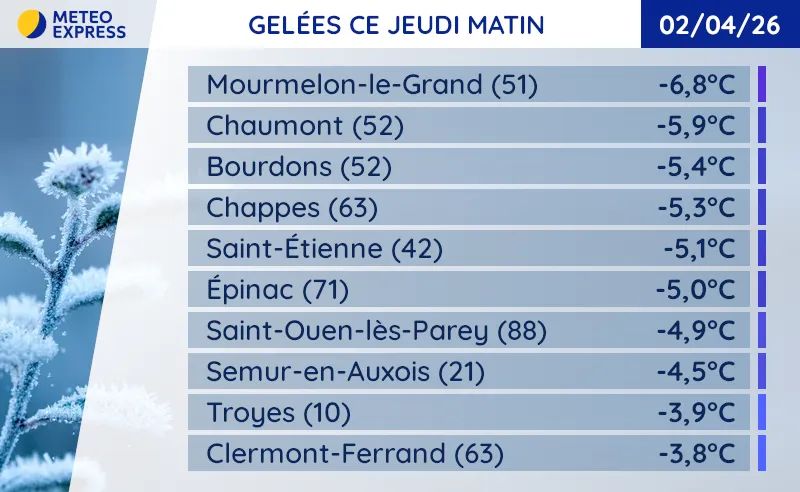

Frankreich: April-Frost gefährdet Weinanbaugebiete

Die Weinregionen Frankreichs haben mit Frost Anfang April zu kämpfen; in Chablis im Departement Yonne sind die Temperaturen bis auf -3 °C gesunken.

Die Winzer ergreifen Notfallmaßnahmen.

Über Nacht werden in den Weinbergen Tausende von Brennern entzündet in der Hoffnung, die Temperaturen gerade so weit anzuheben, dass die frisch gebildeten Knospen geschützt werden. Ein Temperatursturz unter den Gefrierpunkt kann das frühe Wachstum zerstören und die Erträge drastisch verringern.

Chablis ist besonders gefährdet.

Als eine der nördlichsten Weinregionen Frankreichs ist sie während des Austriebs besonders anfällig.

Doch das Risiko erstreckt sich über Burgund hinaus.

Für Zentral- und Ostfrankreich, einschließlich der Champagne und Teilen des Loire-Tals, wurden Frostwarnungen ausgegeben.

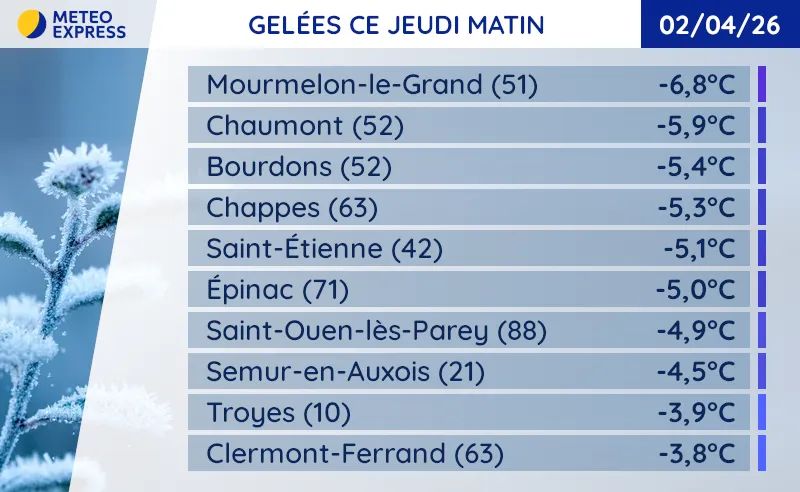

Die Tiefsttemperaturen am 2. April fielen auf -6,8 °C in Mourmelon-le-Grand (Marne), -5,9 °C in Chaumont (Haute-Marne) und -3,9 °C in Troyes (Aube) – allesamt mitten in wichtigen Weinbaugebieten.

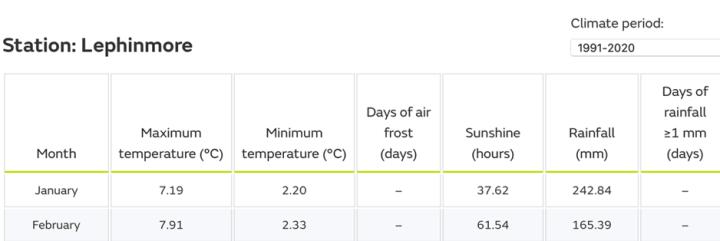

Hier ist Bagneux-la-Fosse im Departement Aube:

Auch jenseits der Grenze, in Westdeutschland und der Schweiz, entzünden die Winzer Frostfeuer.

————————————-

Alpen: Weiterer Schneezuwachs in höheren Lagen

Während die tiefer gelegenen Regionen Europas unter untypischem Frost leiden, kommt es in den Bergen zu weiteren starken Schneefällen.

In den Alpen haben die jüngsten Stürme in Frankreich, der Schweiz, Österreich und Norditalien für Neuschnee gesorgt, wobei die Schneehöhen in den höheren Lagen weiterhin die 1-Meter-Marke überschreiten.

Skigebiete, in denen normalerweise der Schnee im Frühling weicher wird, erleben stattdessen bis in den April hinein anhaltende winterliche Bedingungen.

Und das betrifft nicht nur die Alpen.

Im Osten verzeichnen die polnischen Tatra-Berge Schneehöhen über 1,8 m.

Im Westen hingegen verzeichnen auch die Pyrenäen sehr starke Schneefälle in und um Orte wie Font-Romeu.

Link: https://electroverse.substack.com/p/fairbanks-just-logged-its-coldest?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email

Wird fortgesetzt mit Kältereport Nr. 15 / 2026

Redaktionsschluss für diesen Report: 3. April 2026

Zusammengestellt und übersetzt von Christian Freuer für das EIKE

Anhang: Warum die Kälte in Kanada so bedeutsam ist

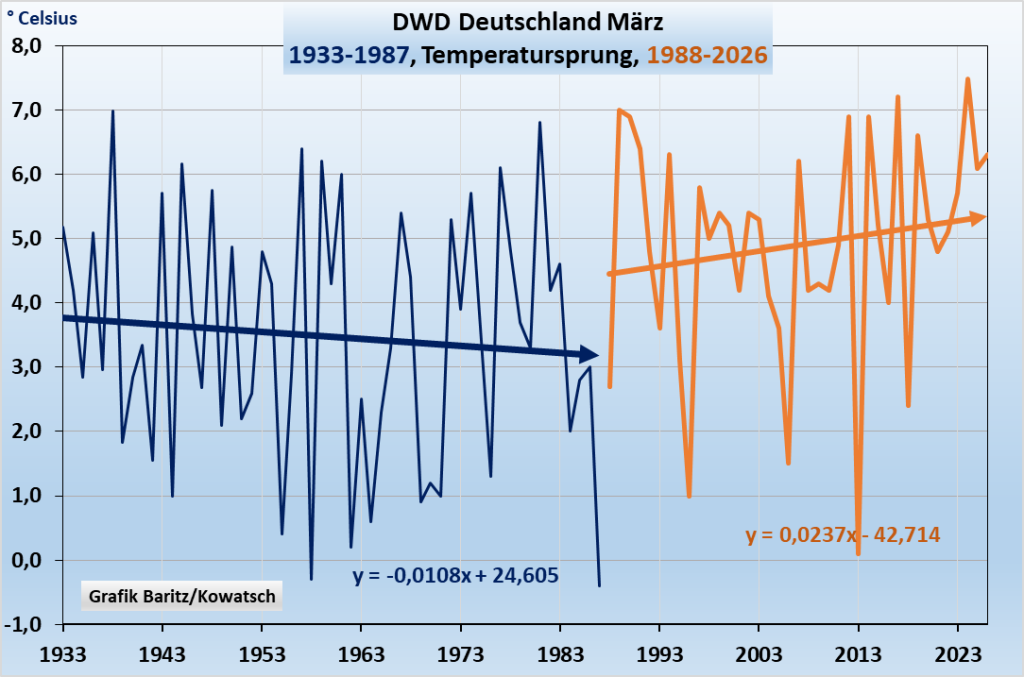

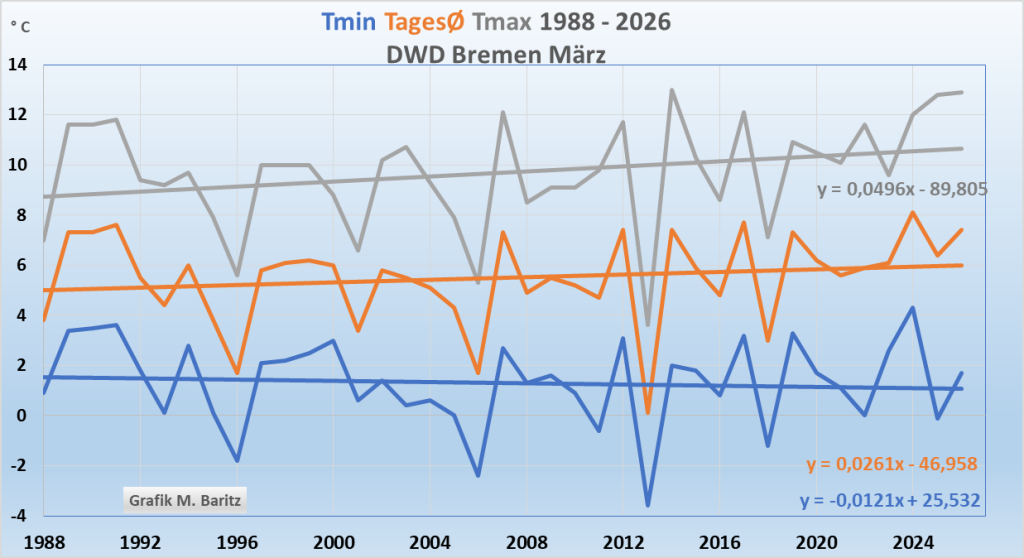

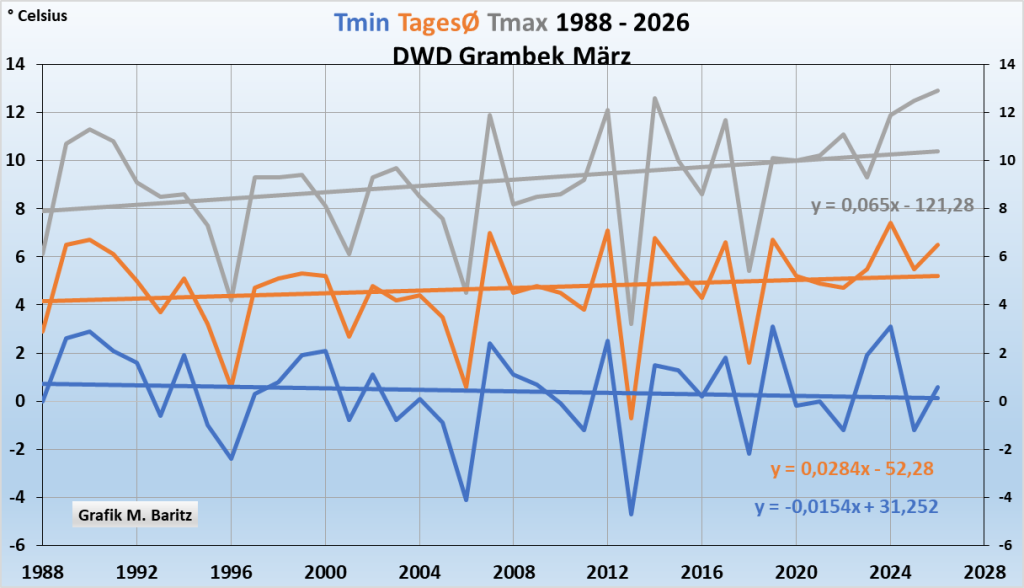

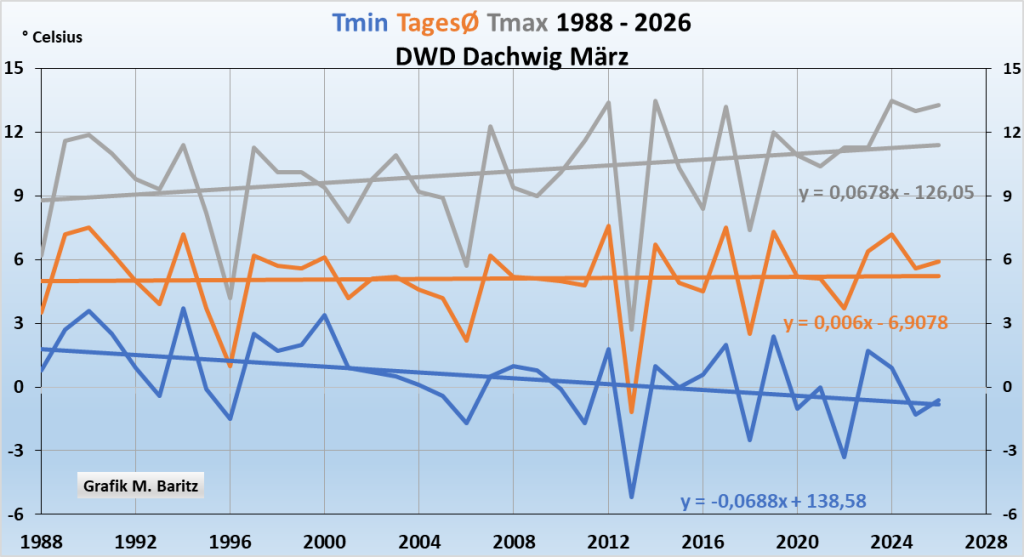

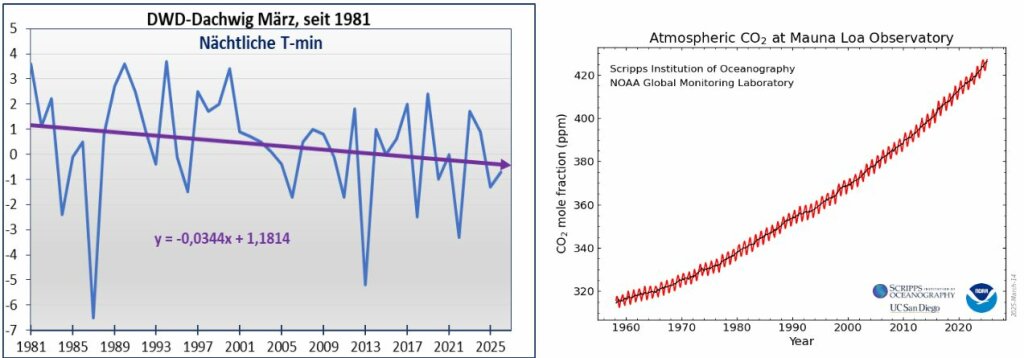

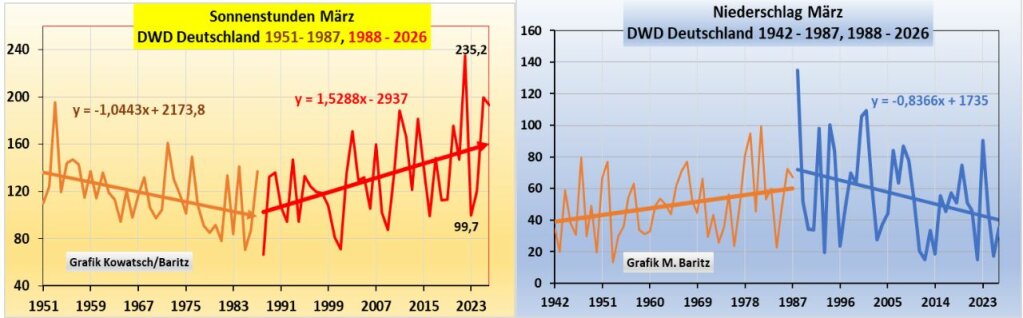

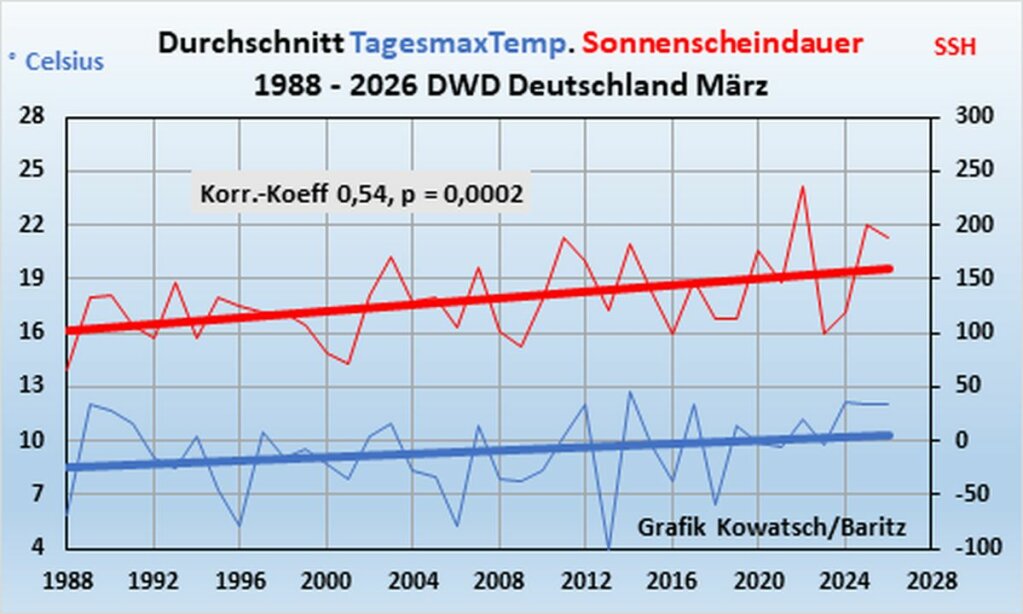

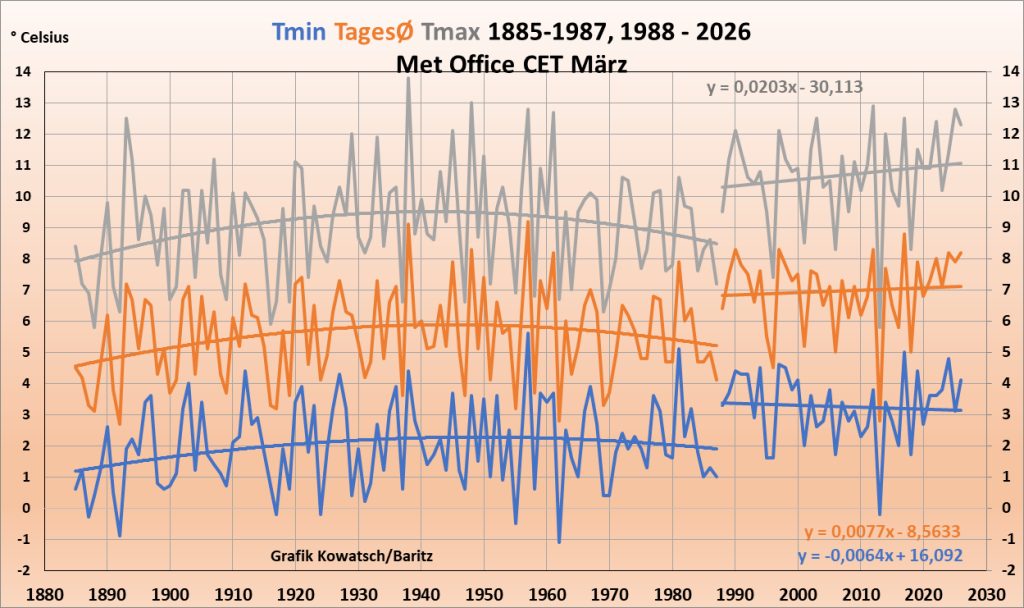

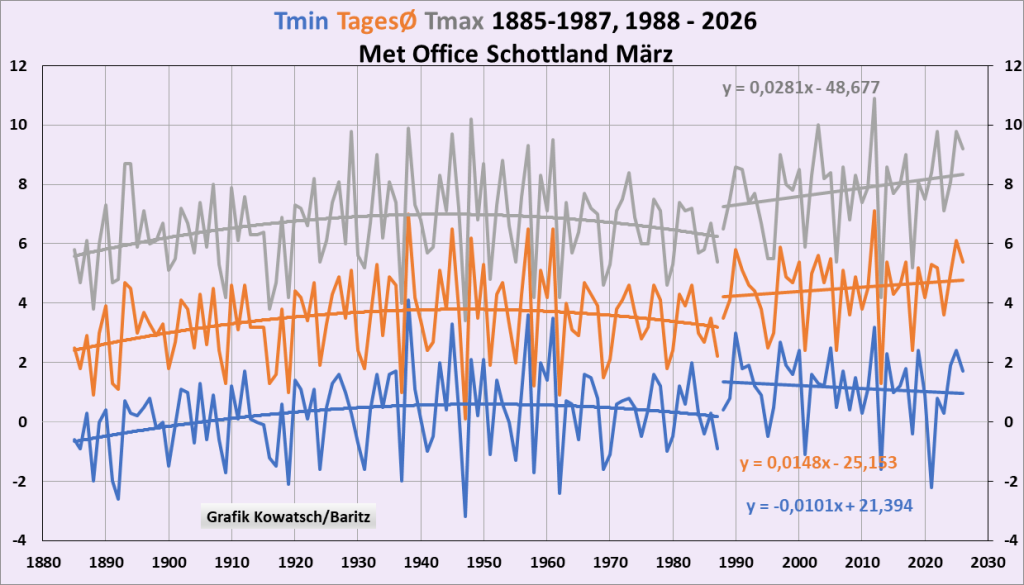

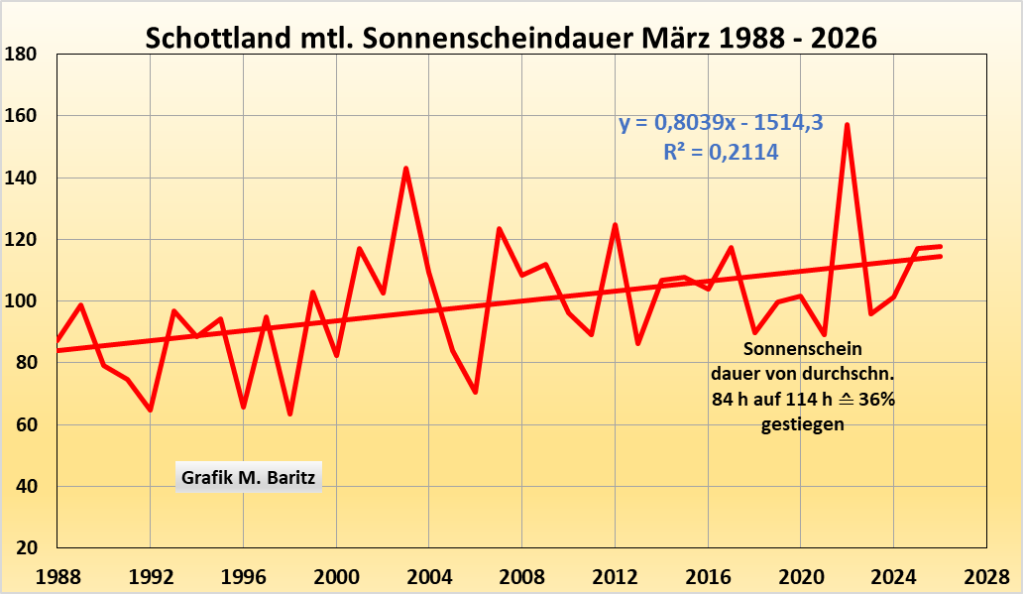

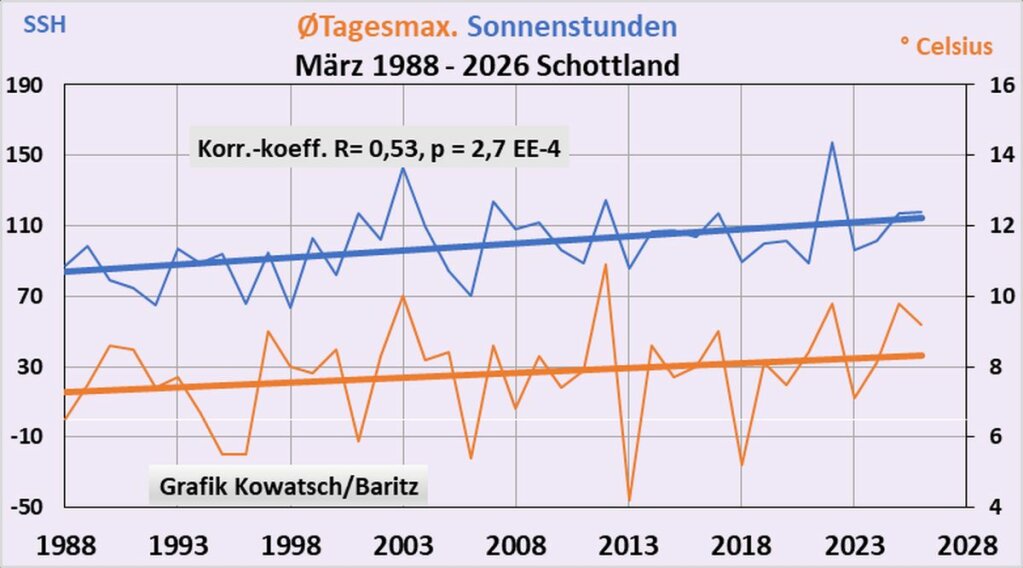

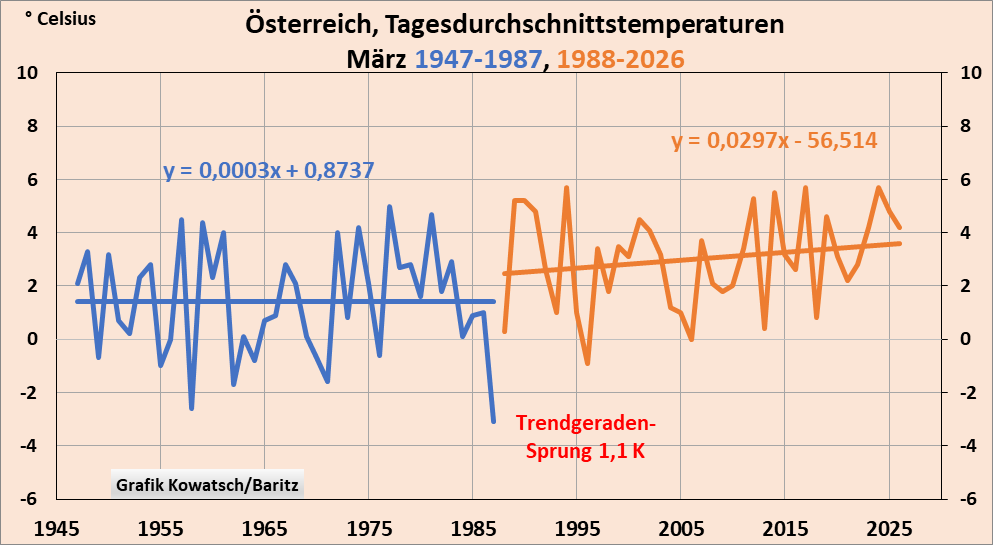

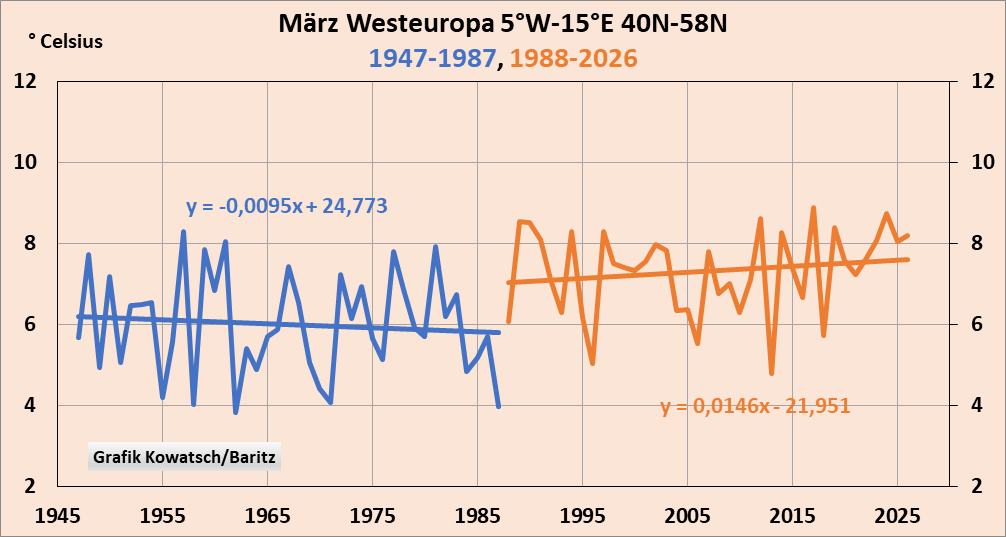

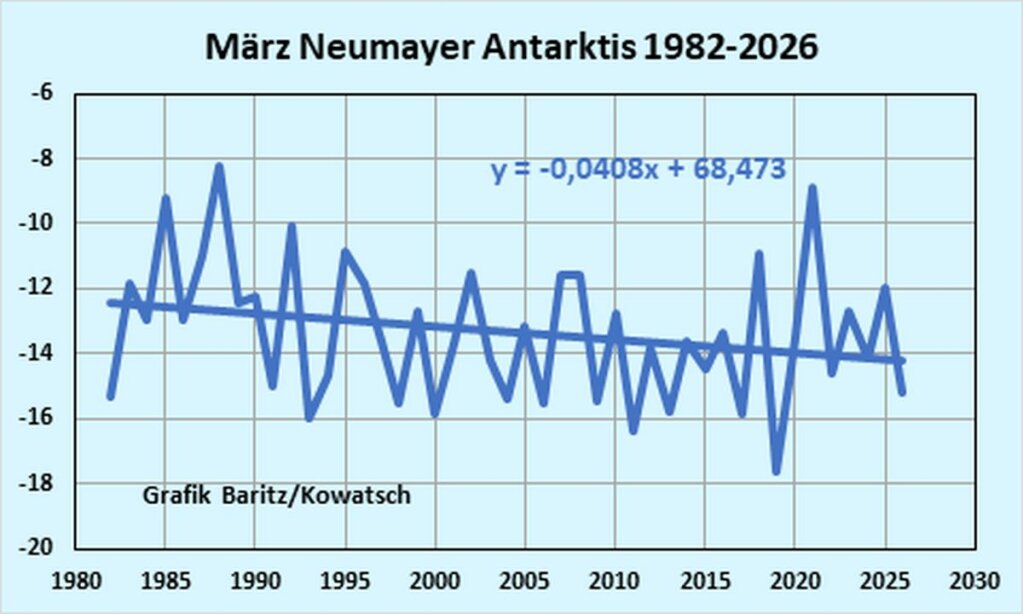

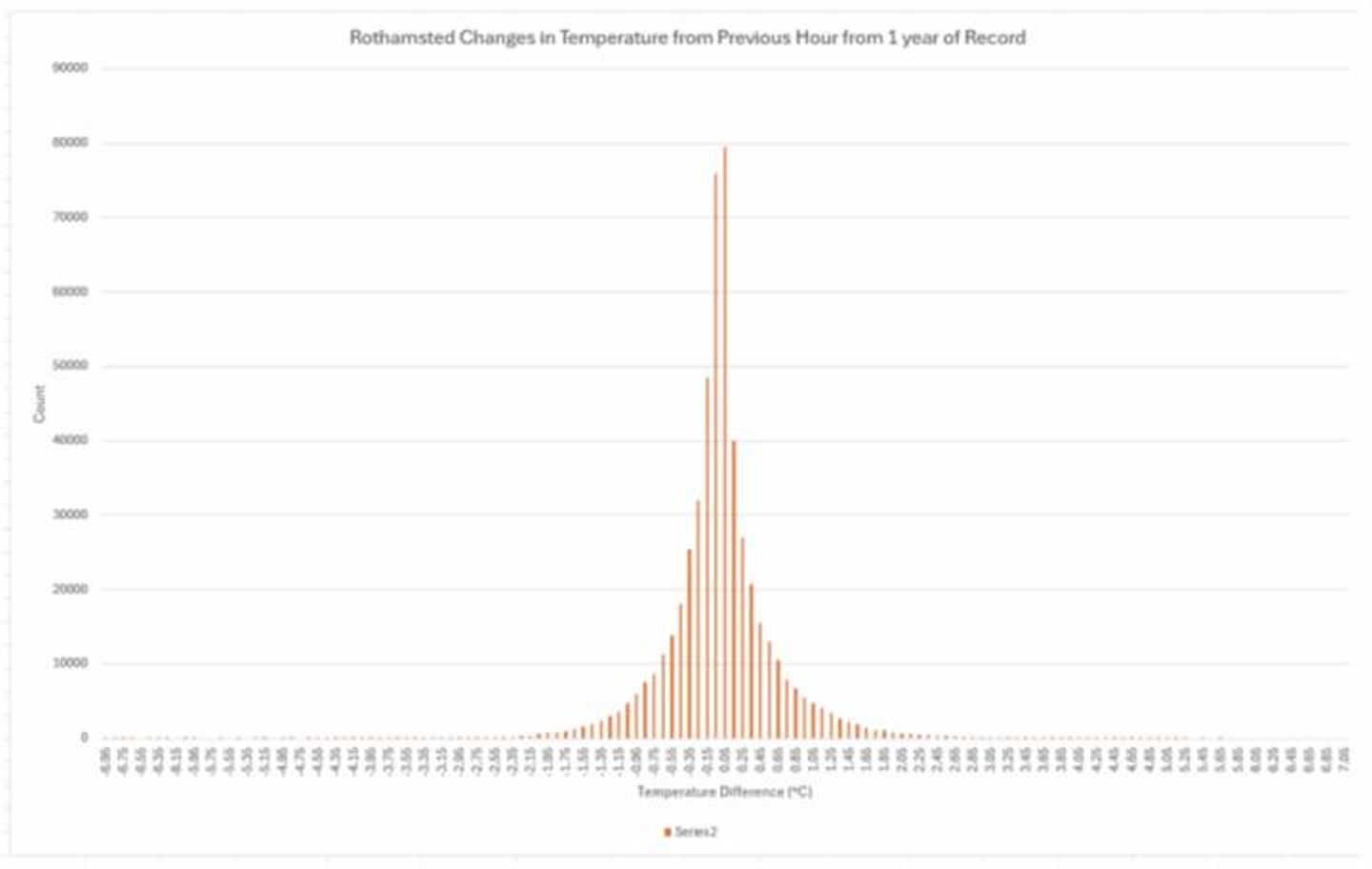

In den Mittleren Breiten, also auch hierzulande, ist es entscheidend von der Wetterlage abhängig, ob Kälte- oder auch Wärmerekorde auftreten, je nachdem, wie lange die entsprechenden Luftmassen advehiert werden (Advektion = horizontaler Austausch von Luftmassen; Konvektion = vertikaler Austausch von Luftmassen). Kowatsch & Baritz haben in verschiedenen Arbeiten die Häufung von Südwestlagen in Mitteleuropa nachgewiesen, die natürlich zu milderen/wärmeren Bedingungen führen.

Im Zentrum des Kältepols über Kanada gibt es jedoch kaum oder gar keine Advektion. Milde Luftmassen vom Pazifik können die Gebiete in der geographischen Mitte von Alaska Fairbanks) nicht erreichen. Die erwähnte extreme Kälte in jenen Gebieten kann also nicht durch das Vorherrschen bestimmter Luftmassen erklärt werden, einfach weil es keinen Austausch derselben gibt. Das heißt, dass die Kälte diesmal besonders intensiv war.

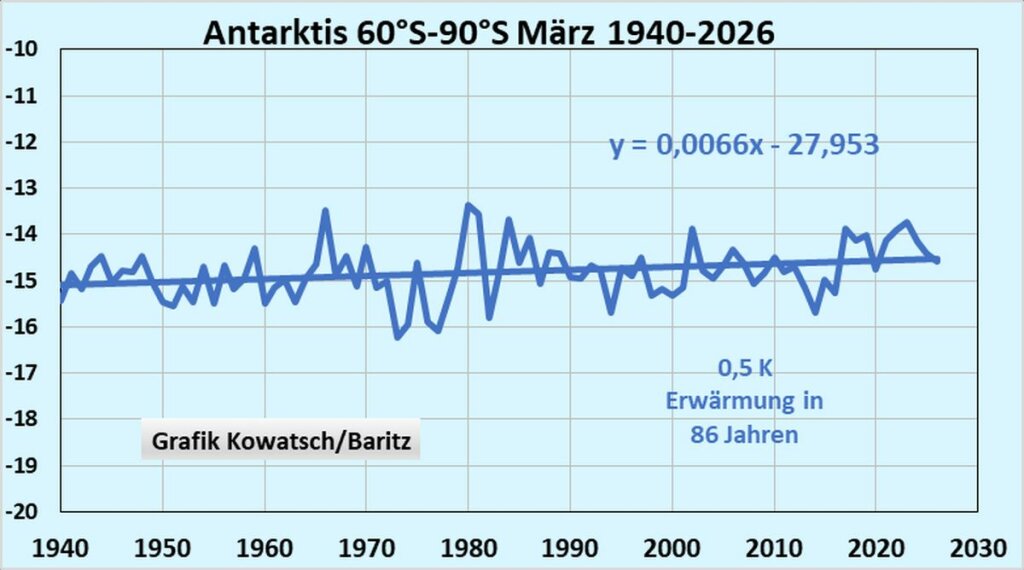

Für den Kältepol über der Antarktis gilt natürlich Entsprechendes. Diese findet zwar im Gegensatz zur vorigen Ausgabe (Nr. 13 / 2026) hier keine Erwähnung, wohl aber in der vorigen Ausgabe. Offenbar ist die Abkühlung im Zentrum der Kältepole ein Vorgang an beiden Polen – was immer das auch zur Folge hat.

Der Beitrag Kältereport Nr. 14 /2026 erschien zuerst auf EIKE - Europäisches Institut für Klima & Energie.