Vorschau ansehen

Von Matthias Baritz und Josef Kowatsch.

- CO₂ ist ein sauberes Gas und lebensnotwendig.

- CO₂ ist Leben, CO₂ ist Schöpfung

- Wir brauchen mehr CO₂ in der Atmosphäre

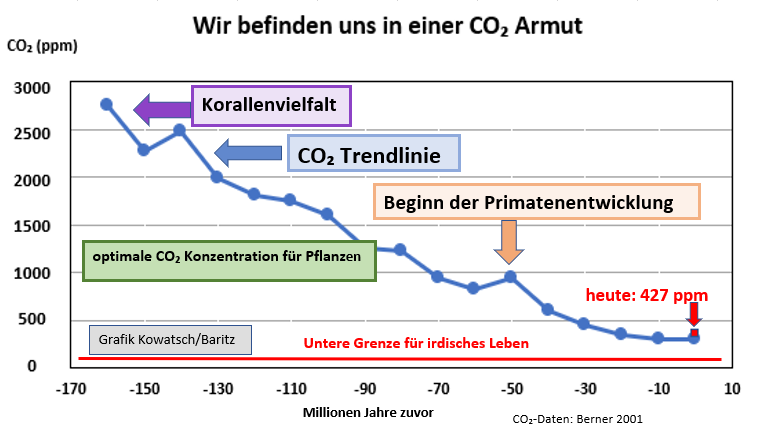

- Wir befinden uns in einer CO₂-Armut

- Der CO₂-gehalt ist über Jahrmillionen immer mehr gesunken

- Der Mensch hat die Schöpfung Erde vorerst gerettet

- CO₂ ist der Lebensmotor für die Schöpfung

- Schützt den Klimawandel

Kohlendioxid ist ein sauberes Gas und lebensnotwendig.

Im Allgemeinen gibt es unklare Vorstellungen darüber, was Kohlendioxid eigentlich ist. In den Medien zeigt man dann rauchende Schornsteine, Smog und qualmende Autos. Klimakiller und Klimakatastrophe sind weitere negative Attribute. Gewisse Nachrichtensprecher bezeichnen C02 sogar als Giftgas. Wer so etwas sagt, dem sollte man das Atmen verbieten, denn jeder von uns atmet dieses „Giftgas“ aus, etwas mehr als ein halbes Kilo täglich.

Genau das Gegenteil dieser Falschdarstellungen ist C02. Kohlendioxid ist ein farbloses, geruchloses völlig unsichtbares Gas, das 1,5mal schwerer als Luft ist. In der Atmosphäre ist es lediglich ein Spurengas mit einem Vorkommen von 0,043 Vol%. Physikalisch ist C02 so gut wie wirkungslos, chemisch hingegen ist sein Wirkung lebensnotwendig.

Ohne Luftdurchmischung konzentriert CO₂ sich in Senken oder Höhlen. In größeren Konzentration riecht es leicht säuerlich. Es wird im Feuerlöscher benutzt, genauso wie im sauren Mineralwasser. C02 ist das Endprodukt einer extrem sauberen Verbrennung. Je sauberer ein Motor oder eine Heizung arbeitet, desto höher ist der Wirkungsgrad und desto mehr CO₂ werden aus dem Brennstoff als „sauberes Abgas“ hergestellt. Wir atmen es gerade aus.

Kohlendioxid ist Leben, Kohlendioxid ist Schöpfung.

CO₂ ist der notwendige Grundbaustein für das Leben auf der Erde. Wir Menschen wie auch Tiere und Pflanzen bestehen neben einigen anorganischen Komponenten aus unzähligen und ganz unterschiedlichen organischen Molekülen, die in hochkomplexer Weise interagieren als läge dem ein göttlicher Bauplan zugrunde. Sämtliche organische Verbindungen basieren dabei auf Kohlenstoff. Und jedes einzelne dieser C-atome stammt letztlich von dem Spurengas CO₂!!! Leider viel zu wenig vorhanden, nur 425 ppm in der Luft, das ist zu wenig CO₂ für eine optimale Lebensentfaltung auf diesem Planeten. Es muss erstaunen, dass diese relative geringe CO₂-Konzentration in der Luft überhaupt ausreicht, soviel pflanzliche Biomasse zu erzeugen. Tatsächlich müssen sich Pflanzen einige Tricks einfallen lassen, um ausreichend CO₂ bei der Fotosynthese zu kriegen. Die meisten Pflanzen sind C-3 Pflanzen, bei denen hängt die Bindung von einem Enzym, namens Rubisco ab. Sie haben gelernt, sich mit weniger CO₂ zurecht zu finden

Das Leben auf dem Raumschiff Erde ist auf Kohlenstoff aufgebaut und CO₂ ist das gasförmige Transportmittel, um den Wachstumsmotor Kohlenstoff zu transportieren. Wer CO₂ vermindern will, versündigt sich gegen die Schöpfung dieses Planeten.

Wir brauchen mehr CO₂ in der Atmosphäre

Der Kohlendioxidgehalt hatte ein unteres Minimum erreicht.

Eine positive Eigenschaft hat die CO₂-Zunahme der Atmosphäre. Es ist das notwendige Wachstums- und Düngemittel aller Pflanzen, mehr CO₂ führt zu einem beschleunigten Wachstum, steigert die Hektarerträge und bekämpft somit den Hunger in der Welt. Ohne Kohlendioxid wäre die Erde kahl wie der Mond. Das Leben auf der Erde braucht Wasser, Sauerstoff, ausreichend Kohlendioxid, Mineralien und eine angenehm milde Temperatur. Der optimale CO₂-gehalt der Atmosphäre liegt etwa bei 800 bis 1200ppm, das sind etwa 0,1%. Das ist auch die Konzentration in den Gewächshäusern für den Gemüseanbau. Z.B. hier beschrieben.

Nicht nur für das Pflanzenwachstum, also auch für uns eine Art Wohlfühlfaktor. Von dieser Idealkonzentration sind wir derzeit weit entfernt. Das Leben auf der Erde braucht mehr und nicht weniger CO₂ in der Luft. Untersuchungen der NASA bestätigen dies (auch hier) Und vor allem dieser Versuchsbeweis.

Jeder, der CO₂ freisetzt, dürfte nicht ein Malus, sondern müsste einen Bonus bekommen. Und wir müssten uns auf das Grundgesetz berufen

„Grundgesetz für die Bundesrepublik Deutschland, Art 20a: Der Staat schützt auch in Verantwortung für die künftigen Generationen die natürlichen Lebensgrundlagen und die Tiere im Rahmen der verfassungsmäßigen Ordnung

Zu den natürlichen Lebensgrundlagen dieses Planeten gehört eine ausreichende CO₂-Konzentration. Unter 290 ppm bekommt das Leben seine Schwierigkeiten.

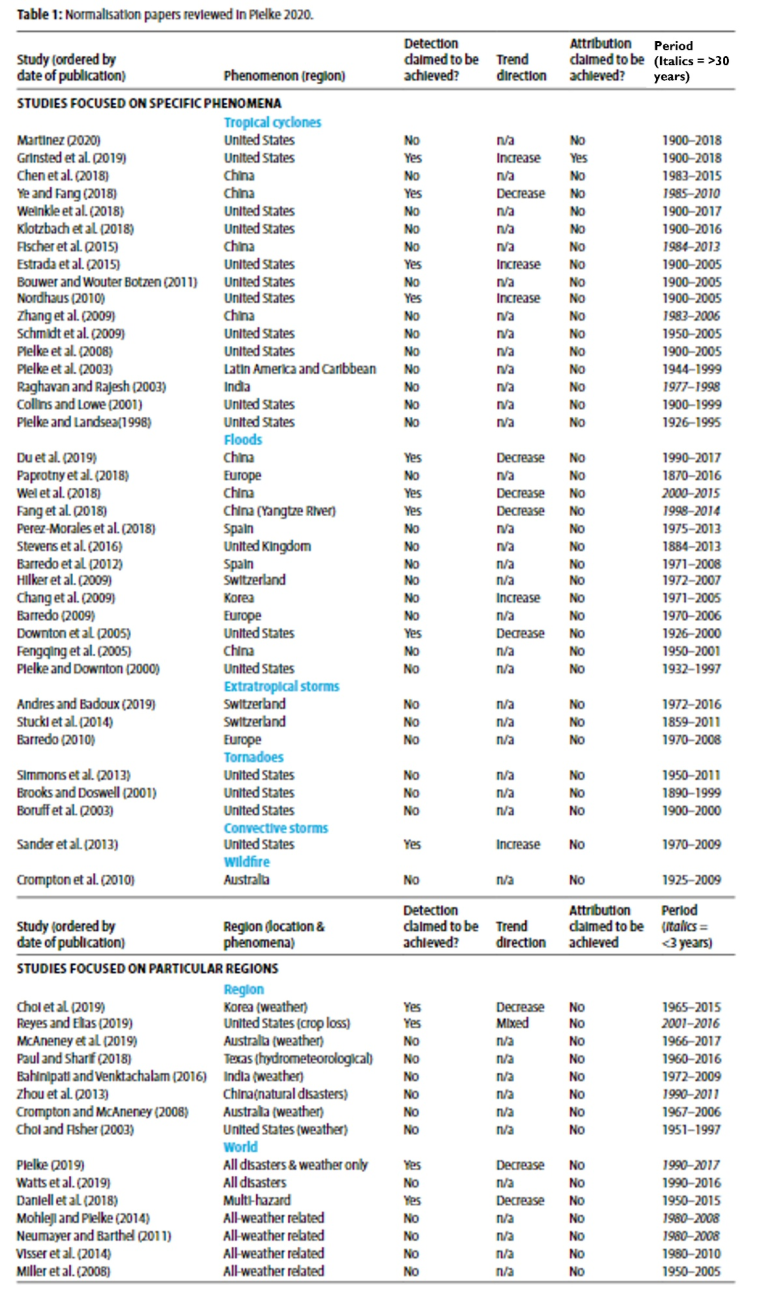

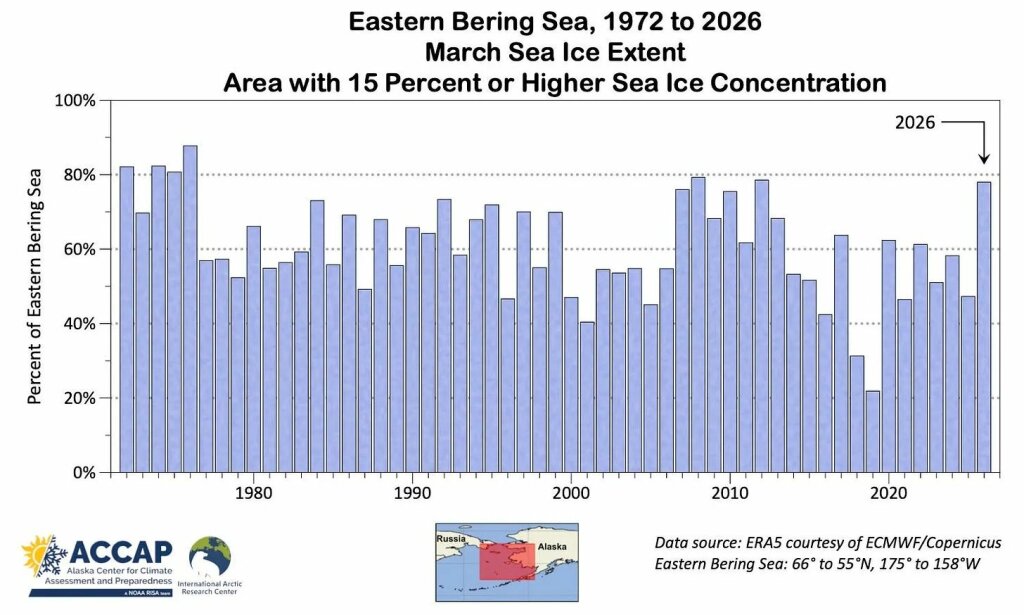

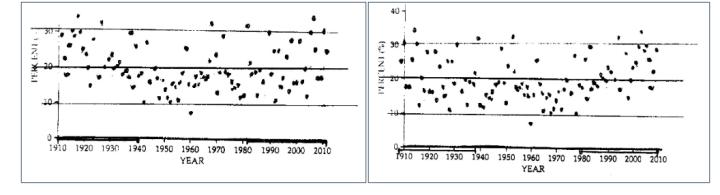

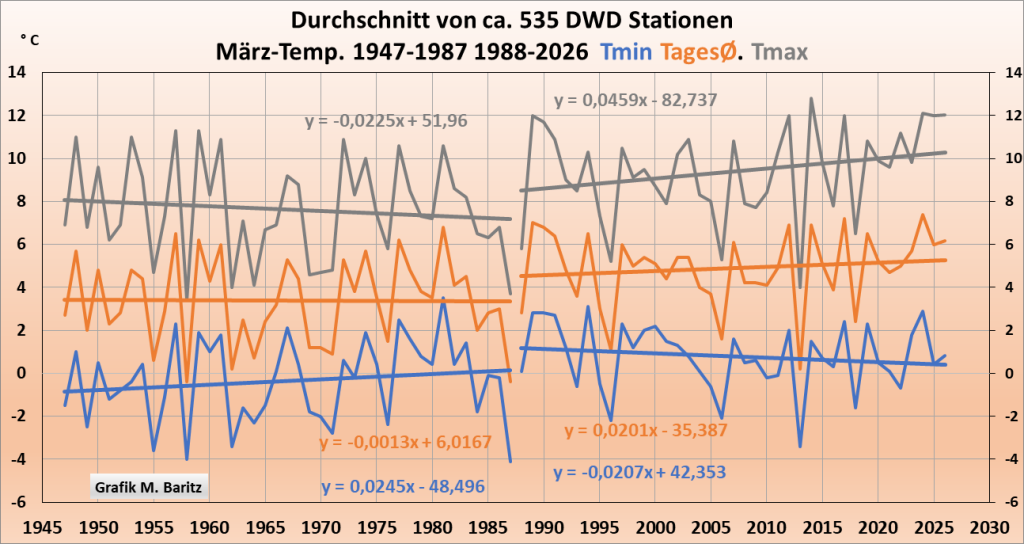

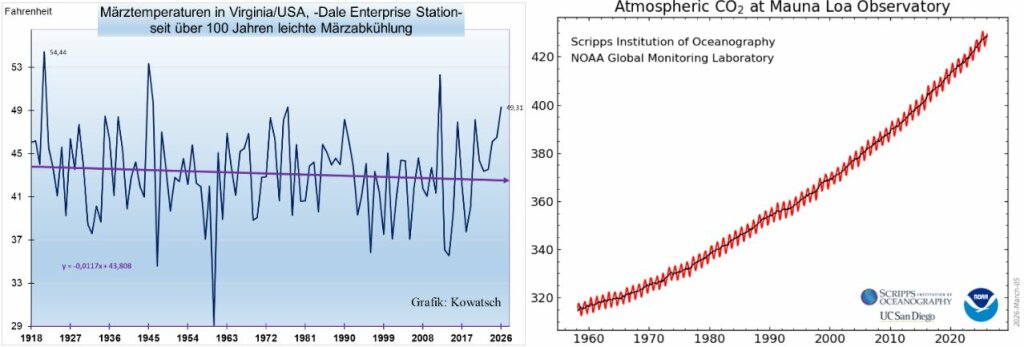

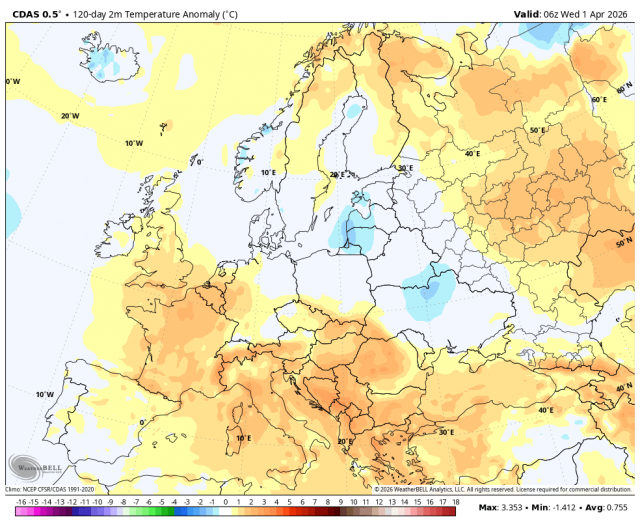

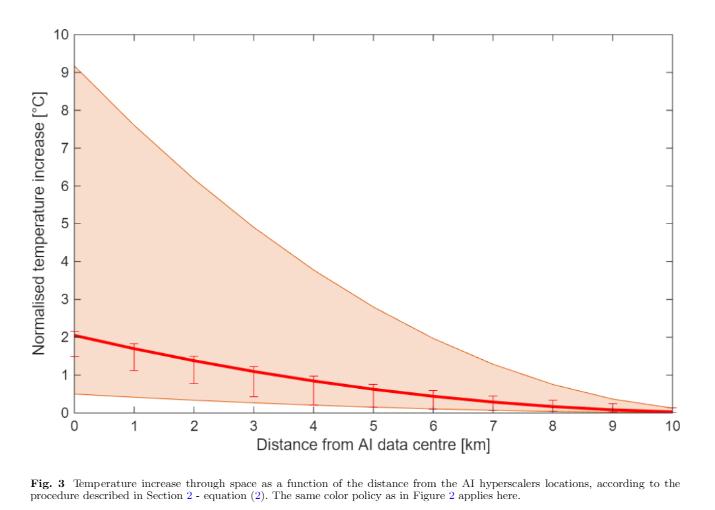

Grafik 1: Noch ist die Flora und Fauna auf diesem Planeten nicht gerettet. Wir haben bisher erst die CO₂-Konzentrationsabnahme stoppen können. Ein deutlicher CO₂-Aufwärtstrend, eine Konzentrationszunahme auf den optimalen Wert für Flora und Fauna ist noch nicht erkennbar

Weshalb ist die CO₂-Konzentration der Atmosphäre im Laufe von Jahrmillionen überhaupt gefallen?

Dafür sind geologische und biologische Prozesse die Ursache. Diese Prozesse entzogen der Atmosphäre kontinuierlich Kohlenstoff und speicherten ihn in verschiedenen Senken.

Die Hauptgründe für diese Entwicklung sind:

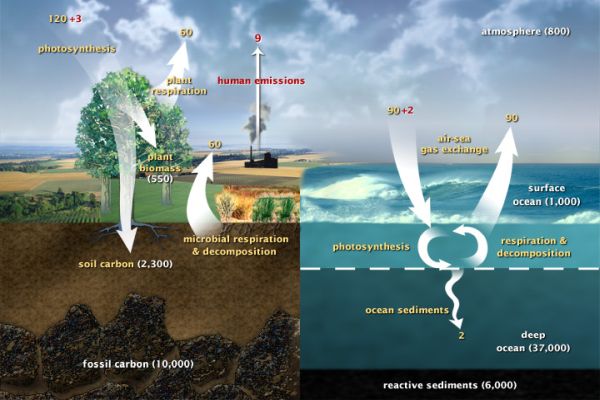

- Auflösung in den Ozeanen: Ein Großteil des atmosphärischen CO₂ löste sich im Wasser und bildete Kohlensäure. Diese Säure reagierte dann mit Mineralien im Wasser, wodurch Karbonate und andere Verbindungen entstanden, die sich am Meeresboden ablagerten und so langfristig dem Kohlenstoffkreislauf entzogen wurden.

- Photosynthese und Entstehung fossiler Brennstoffe: Mit der Evolution und Ausbreitung von Pflanzen, insbesondere im Karbonzeitalter, wurde durch Photosynthese große Mengen CO₂ aus der Atmosphäre aufgenommen. Abgestorbene Pflanzenmaterie, die nicht vollständig zersetzt wurde, sammelte sich über Millionen von Jahren an und bildete die riesigen Lagerstätten fossiler Brennstoffe (Kohle, Öl, teilweise auch Gas), wodurch der Kohlenstoff dem kurzfristigen CO₂-Kreislauf dauerhaft entzogen und eingebunkert wurde.

- Chemische Verwitterung von Gesteinen (Silikatverwitterung): Atmosphärisches CO₂ (in Form von Kohlensäure im Regenwasser) reagierte mit Silikatgesteinen auf der Erdoberfläche. Bei dieser chemischen Verwitterung wird das CO₂ gebunden und über Flüsse in die Ozeane transportiert, wo es als Sedimentgestein (z.B. Kalkstein) abgelagert wird. Durch Anhebung des Meeresbodens sind ganze oberirdische Kalkgebirge entstanden.

- Einlagerung ins Knochenskelett und in den Kalkpanzer von Land- und Meereslebewesen: Nach dem Tode lagert sich der Kalk im Boden oder auf dem Meeresgrund ab. Die Folge all dieser Prozesse war eine schleichende Reduzierung des schöpfungsnotwendigen CO₂ in der Atmosphäre. Die Schöpfung war auf einem unteren Niveau angekommen, die Fotosynthese extrem behindert.

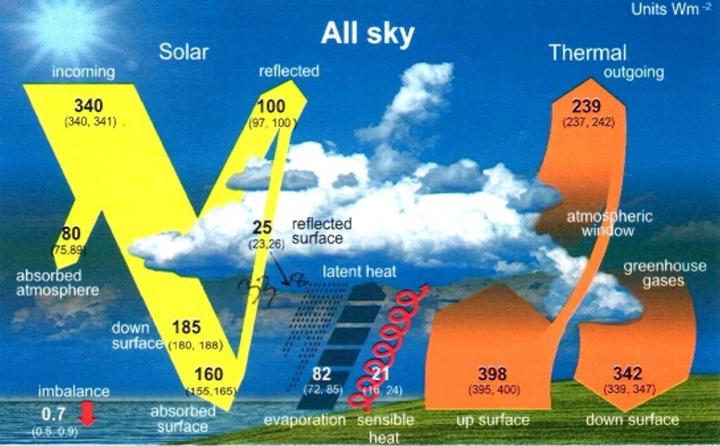

Der Kreislauf des Kohlendioxids zum Lebenserhalt auf der Erde

Abb. 2: Ein Teil des CO₂ wird auf dem Land ständig im Erdboden eingebunkert (siehe linke Hälfte der Abbildung) und somit aus der Luftkonzentration entzogen. Dasselbe geschieht im Meer, wenn Lebewesen absterben, ihr Knochengerüst absinkt und den Meeresboden als Sedimente auffüllt. Ganze unterirdische Kalkgebirge sind im Laufe der Jahrhundertmillionen entstanden, die nach Anhebung als Kalklandschaften die Landflächen bedecken.

Der Mensch hat die Schöpfung und das Leben auf der Erde vorerst gerettet.

Es ist wohl eine wunderbare Vorsehung der Schöpfung, dass der Mensch berufen war, das Zugrundegehen der Vegetation auf diesem Planeten infolge immer weniger CO₂-Konzentration in der Atmosphäre durch das industrielle Zeitalter zu bekämpfen und zu beenden. Die CO₂-Zunahme durch vermehrte Verbrennung kohlenstoffhaltiger Energieträger hat diesen Planeten wieder lebensfähig gemacht, die 428 ppm CO₂ in der Atmosphäre sind aktuell noch zu wenig, die Photosynthese braucht für ein optimales Wachstum der Nahrungsmittelpflanzen etwa das doppelte.

Die Wüsten würden weiter zurückgehen und die Erde weiter ergrünen. Jede von der Politik verordnete CO₂-Einsparung ist eine Sünde gegen die lebende, grüne Erde. Den teuren CO₂-Einsparungsideen müssen wir entschieden widersprechen.

Nebenbei: CO₂ ist zwar klimawirksam, jedoch kein Treibhausgas – der Begriff ist eine Werbeerfindung- und bewirkt bei diesen geringen CO₂-Konzentrationsänderungen von 400 auf 800 ppm keine messbaren Temperaturerhöhungen. Das zeigen alle Versuche. Zuletzt im September 2022 der Großversuch mit dem zig-fach stärkeren „Treibhausgas“ Methan bei der Sprengung der Ostseepipeline. Jetzt weiß es alle Welt, – nur die Medien haben das nicht mitbekommen – dass Treibhausgase nichts wesentliches erwärmen, und die Behauptung ein weltweiter Schwindel ist mit dem alleinigen Ziel, eine Klimaangst und Panik zu erzeugen. Bei vielen Schulkindern zeigt diese irrsinnige Hysterie bereits psychische Angststörungen. Und nur mit einer CO₂-Ablaßhandelssteuer kann man sein Gewissen beruhigen. Dieses verwerflich sündige Geschäftsmodell kennen wir aus dem Mittelalter vom Sündenablasshandel. Wir dürfen diese CO₂-Panikmache nicht länger zulassen.

Und die hochverschuldeten westlichen Staaten haben nun einen Sündenbock gefunden, letztlich wird die Luft besteuert. Eine nie versiegende Geldquelle, um uns auszubeuten. Richtig gelesen, die Besteuerung der Luft.

Die Erde ist einzigartig wegen Kohlendioxid: Das Leben auf dem Raumschiff Erde ist auf Kohlenstoff aufgebaut und CO₂ ist das gasförmige Transportmittel, um den Wachstumsmotor Kohlenstoff zu transportieren. Wer CO₂ verteufelt und vermindern will, versündigt sich gegen die Schöpfung dieses Planeten. CO₂ ist kein Klimakiller, wer das behauptet, will das Leben auf dem Planeten Erde ausrotten. Und solchen Falschaussagen müssen wir offensiv entgegentreten. Wir wollen keine Schöpfungszerstörer auf diesem Planeten dulden.

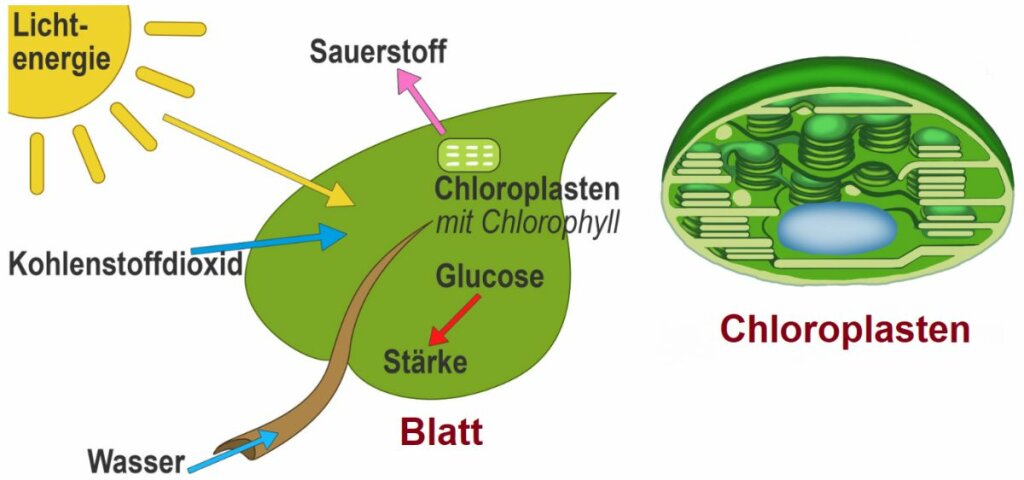

Die Fotosynthese ist der Lebensmotor für die einzigartige Schöpfungsgeschichte der Erde

Hier sollen nur in aller Kürze das Notwendige hervorgehoben werden. Wir verweisen auf die reichliche Literatur zu diesem Thema.

Abb. 3: Bei der Fotosynthese geht es eigentlich um 2 unterschiedliche Vorgänge, die zusammenwirken: die Fotolyse des Wassers und der Calvinzyklus. Ersterer liefert die im Calvinzyklus benötigte Energie und den reduzierenden Wasserstoff und setzt nebenbei noch Sauerstoff frei. Beim Calvinzyklus wird CO₂ unter Mitwirkung eines besonderen Enzyms assimiliert

Dabei ergibt sich folgende Fotosynthese-Bilanz

6 CO₂ + 12 H₂O ——— C₆H₁₂O₆ + 6 O₂ + 6 H₂O

Hierbei werden die energiearmen Stoffwechselendprodukte CO₂ und H2O verbraucht und unter Verwendung von physikalisch hochfrequenter Lichtenergie energiereiche Glucose hergestellt. Die ursprüngliche Lichtenergie ist in den Molekülverbindungen der Glucose gespeichert.

Sowohl der freigewordene Sauerstoff als auch das energiereiche Zuckermolekül steht dann am Anfang der Nahrungskette für die gesamte Fauna.

Wäre eine andere Schöpfungsentstehung möglich gewesen, auf der Grundlage eines anderen Elementes?

Grundsätzlich bietet sich das vierwertige Silicium an oder auch Schwefel. Wasserstoff bestimmt nicht, da es einwertig ist und somit scheidet die Lebensvielfalt aus.

Ein Leben auf Siliziumbasis ist eher ein beliebtes Thema in der Science-Fiction, aber wissenschaftlich gilt es als extrem unwahrscheinlich, da Silizium im Vergleich zu Kohlenstoff deutlich weniger stabile und vielseitige Bindungen eingehen kann wegen der geringeren Elektronegativität des Siliziumatomes im Vergleich zu C-atom, was somit eine Entwicklung komplexer Lebensformen wie auf der Erde unmöglich macht. Ein Leben auf Si-Basiss ist eher ein hypothetisches Konzept für extrem andere Umgebungen mit sehr niedrigen Temperaturen und wenig Wasser, wo es vielleicht eine primitive Form ermöglichen könnte. Solches Leben bräuchte sehr kalte Umgebungen, vielleicht mit Lösungsmitteln wie flüssigem Methan oder Schwefelsäure, und wenig Wasser und Sauerstoff.

Und noch ein Grund: Silicium ist das zweithäufigste Element in der Erdkruste. Das Leben hat jedoch Kohlenstoff bevorzugt. Es gibt jedoch auf der Erde Mikroorganismen, die in den Siliziumkreislauf eingebunden sind und Siliziumverbindungen verstoffwechseln können, allerdings nicht als primäre Energiequelle im Sinne des „Fressens“ von reinem Silizium oder von Siliziumdioxid.

Schwefelbasis: ja, das gibt es, sogar auf der Erde, siehe hier. Leben auf Schwefelbasis existiert sogar in Form von Schwefelbakterien, die Schwefelwasserstoff zur Energiegewinnung nutzen und in extremen Umgebungen wie Tiefsee-Hydrothermalquellen vorkommen, wo sie Basis für Ökosysteme bilden; theoretisch könnten auch komplexere Lebensformen auf Schwefel basieren, da Schwefel ähnliche Bindungseigenschaften wie Kohlenstoff hat, aber Kohlenstoff ist wegen seiner größeren Vielfalt an Verbindungen überlegener.

Ist es momentan zu heiß auf der Erde? Antwort Nein

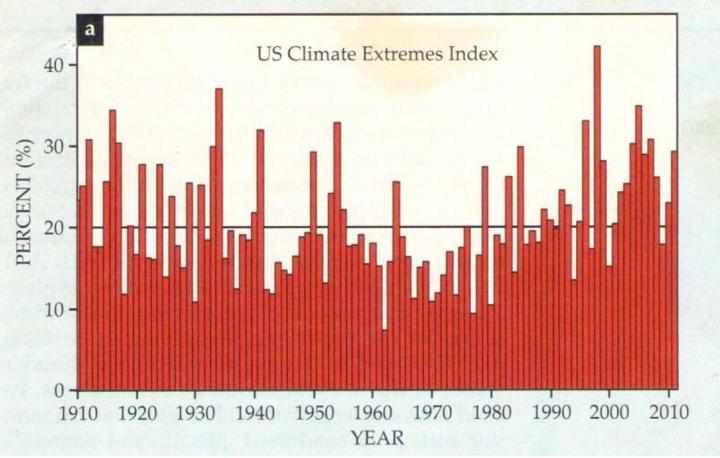

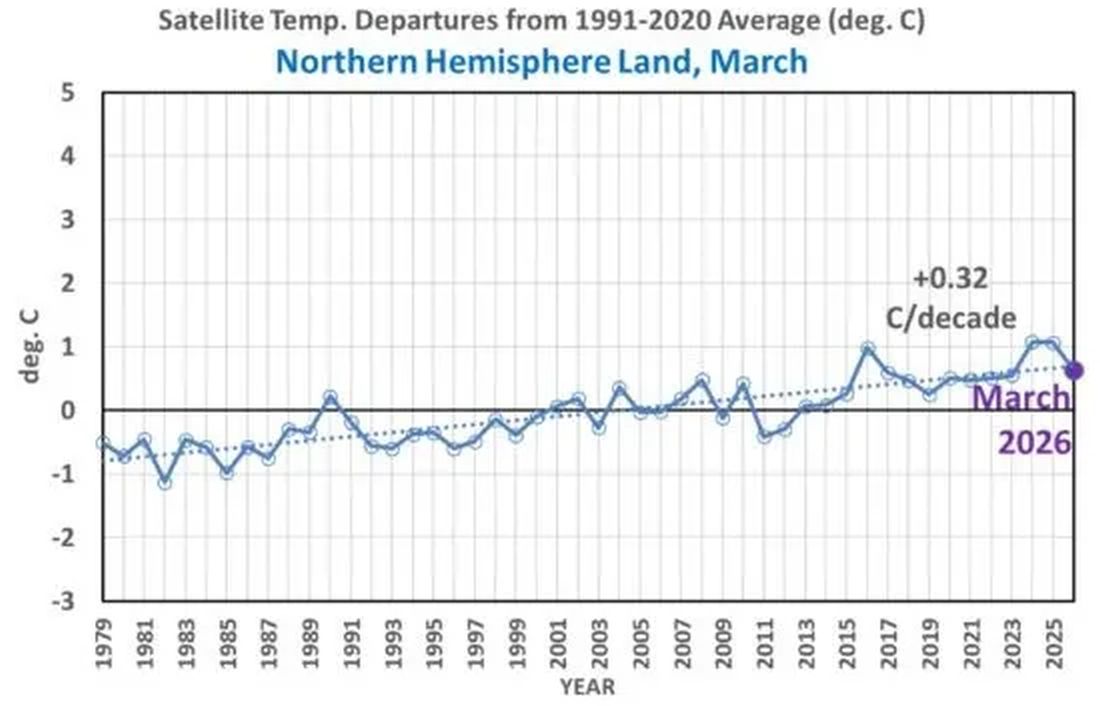

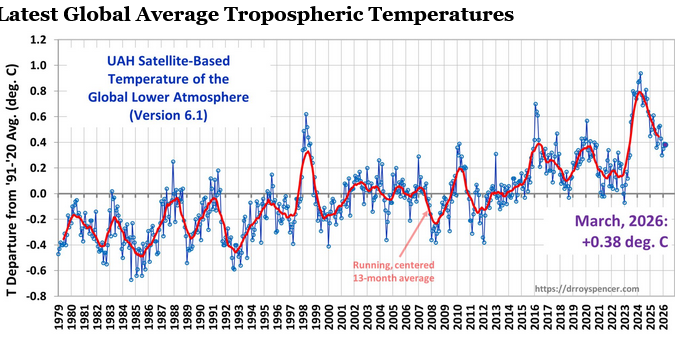

Auch die seit 1979 mit Satelliten gemessene globale Erwärmung ist erst recht kein Grund zur Beunruhigung, wenn man die Anstiegswerte nicht in Hundertstel-Grad aufträgt wie die uns ausraubende Klimakirche das gerne tut, sondern die Zehntelgrade ins Klimageschehen der Erdgeschichte einreiht. Und außerdem begannen die Satelliten-Messungen aus einer Abkühlungsphase heraus. – dem „Seventies Cooling“.

Grafik 4: Laut Satellitenmessungen haben die globalen Temperaturen gerade mal um 0,3 Grad seit 1979 zugenommen. Das ist unbedeutend, wenn man diese angebliche“ furchterregende Erwärmung“ in den Verlauf der Erdgeschichte einreiht. Und ob die angenehme 0,3 Grad Temperaturzunahme dauerhaft sein wird ist ebenso ungewiss.

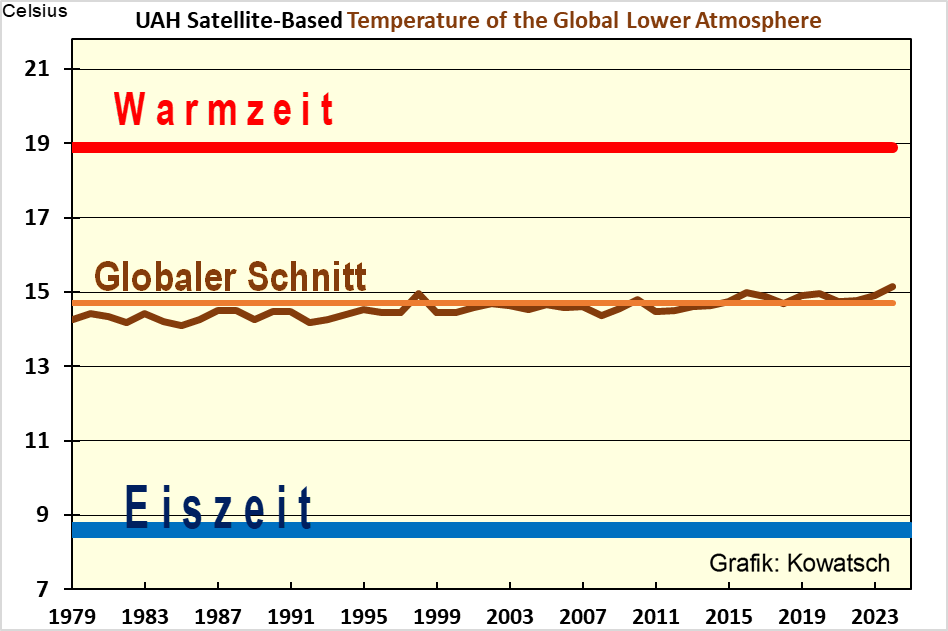

Das Ergebnis dieser Erwärmung zeigt uns die nächste Grafik:

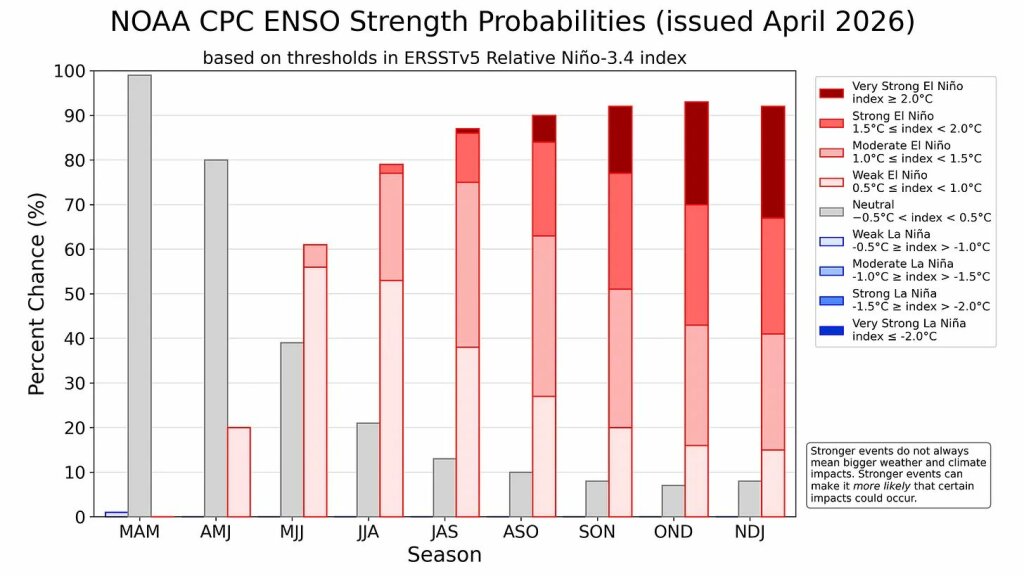

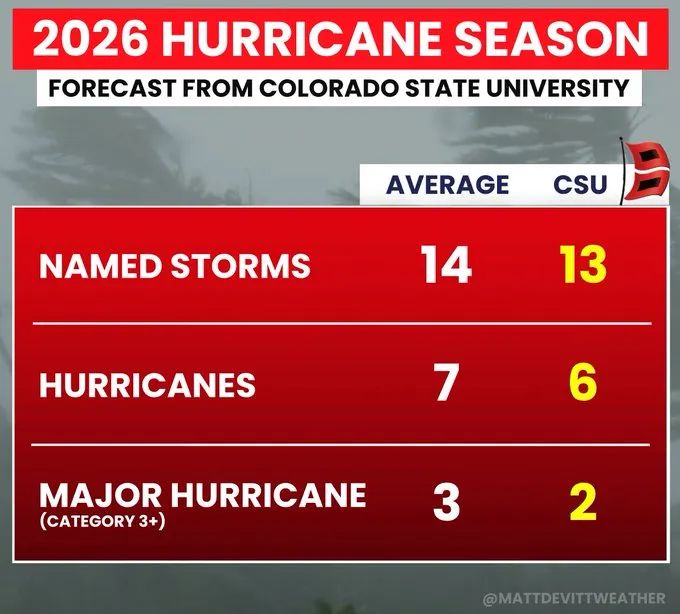

Grafik 5: Die momentan global ermittelten Temperaturen sind weit entfernt von einem Hitzetod der Erde. Die „letzte Generation“ und viele Deutsche Gutgläubige sind auch ein Opfer übertriebener und entstellter Grafiken. Das Geschäftsmodell Treibhaus betreibt nebst vielen anderen Klimalügen und Katastrophenübertreibungen auch eine ausgewählte „Grafikpanik“

Zwei Grundforderungen von uns Natur- und Umweltschützern:

Die werbe- und geschäftsmäßig geplante und regierungsgewollte CO₂-Klimaangstmache vor einer angeblichen Erdüberhitzung und Lebensbedrohung muss sofort eingestellt werden.

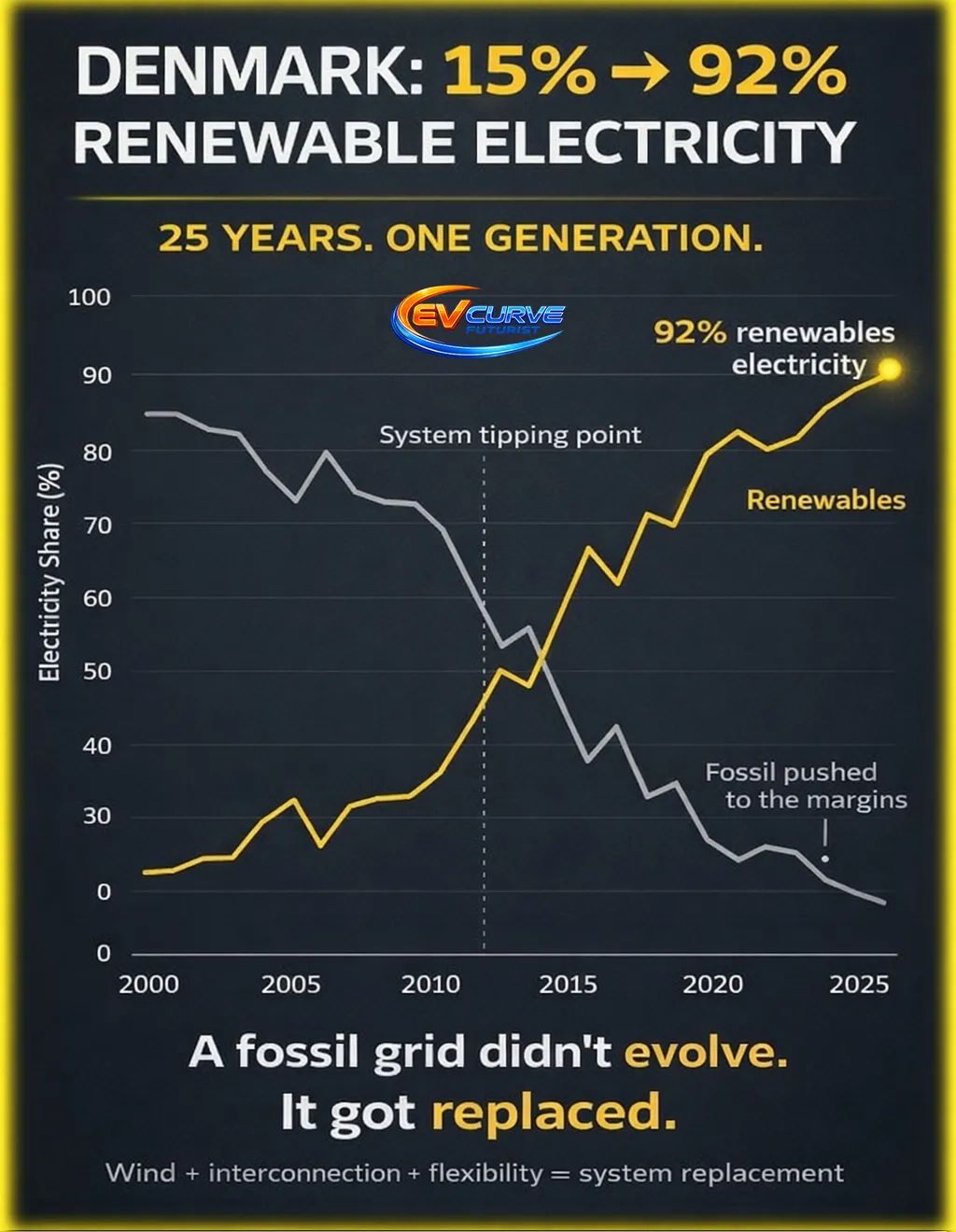

Wir sind deshalb gegen teure technische CO₂-Reduzierungsmaßnahmen, die dem Klima nichts nützen, sondern der Natur und Umwelt oft zusätzlich schaden. Wir lehnen auch jede Luftbesprühung aus Flugzeugen mit weißen Chemikalien-Staubwolken ab, um die Sonneneinstrahlung zu reflektieren und die Albedo wieder zu vergrößern. (Vorschlag aus den USA). Das ist ebenfalls ein Geschäftsmodell für eine angebliche Klimarettung. Das derzeitige Klima braucht überhaupt nicht gerettet zu werden.

Jedoch zeigt die Erde aufgrund massiver menschlicher Eingriffe, die wir Naturschützer als Natur- und Umweltzerstörung bezeichnen, Anfälligkeiten für das tägliche Wettergeschehen, z.B. heiße Sommertage mit einer längeren Trockenperiode:

Was man gegen heiße Sommertage und gegen die Trockenlegung Deutschlands vorgehen sollte, haben wir in 15 Punkten beschrieben.

Aber diese Hilfsmaßnahmen, die tatsächlich helfen würden, würden der CO₂-Treibhaustheorie widersprechen, deshalb entscheidet sich die Politik lieber für die teure CO₂-Bodenverpressung oder CO₂ aus der Luft ausfiltern und andere vollkommen sinnlose CO₂-Reduzierungs-maßnahmen, die nur die grüne Ideologie befriedigen. Unsere Vorschläge im obigen link würden nicht nur helfen, sondern wären zugleich ein Beitrag zum Naturschutz, die Vielfalt der Arten und die Ökologie der Landschaft würde sich wesentlich verbessern.

Es wird Zeit, dass endlich Natur- und Umweltschutz in den Mittelpunkt des politischen Handelns gerückt werden und nicht das teure Geschäftsmodell Klimaschutz, das keinerlei Klima schützt, sondern über gesteuerte Panik- und Angstmache auf unser Geld zielt. Gegen die Terrorgruppe „letzte Generation“ muss mit allen gesetzlichen Mitteln vorgegangen werden, da die Gruppe keine Natur- und Umweltschützer sind, sondern bezahlte Chaosanstifter. Abzocke ohne Gegenleistung nennt man das Geschäftsmodell, das ähnlich wie das Sündenablassmodell der Kirche im Mittelalter funktioniert, nur raffinierter und durchdachter. Ausführlich hier beschrieben.

Diesem Geschäftsmodell Treibhauskirche, der Zerstörung der Schöpfung auf der Erde müssen wir vereint und offensiv entgegenwirken. Es gibt überhaupt keinen Klimanotstand, dieser ist erfunden. Wir verweisen auf das neue Buch von Axel Bojanowski, der gut am Schluss den Aufstieg der Klimalobby mit all ihren Seilschaften beschreibt, deren Angst machende Behauptungen nichts mehr mit Wissenschaft zu tun hat, obwohl man sich ständig auf die alimentierte CO₂-Klimawissenschaft beruft und diese als seriös bezeichnet. Wer an der Verbreitung der Klimaangst verdient, der kann überhaupt nicht seriös sein. Wir müssen mithelfen, diesem schlimmen, vor allem in den letzten 15 Jahren entstandenem Klimakartell ein Ende zu bereiten. Viele Wege führen nach Rom und jeder muss seinen Weg gehen und mit seinen Argumenten dem CO₂-Ablasshandel ein Ende bereiten.

Wer oder was hat dann die Erwärmung herbeigeführt?

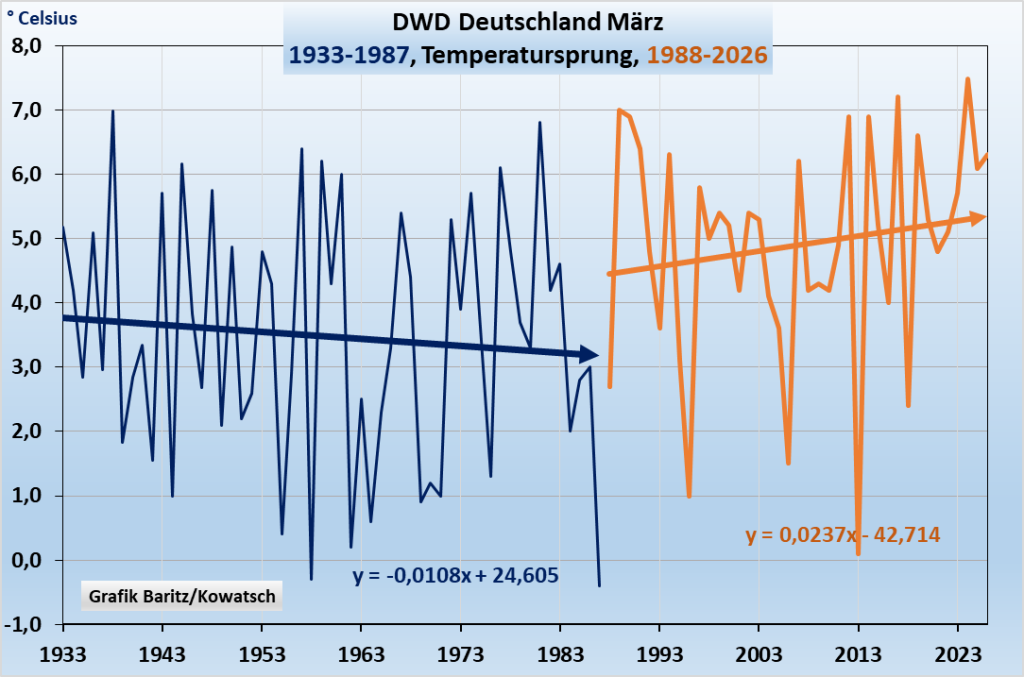

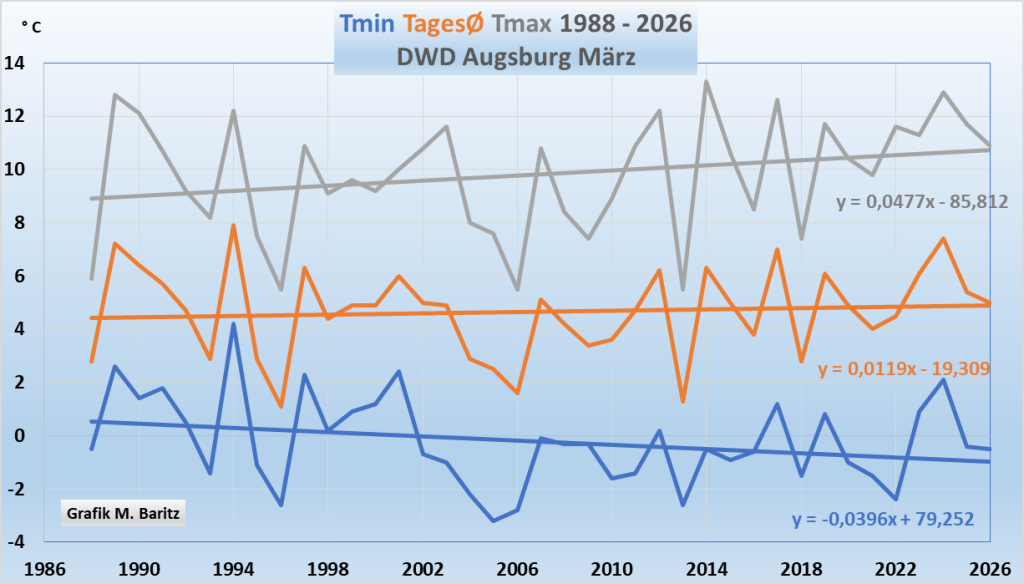

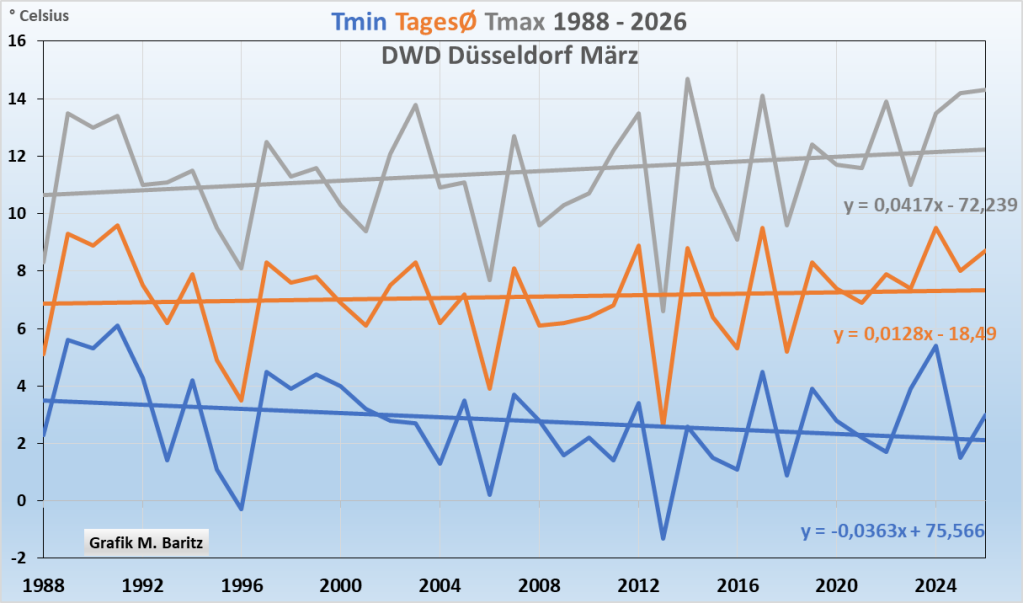

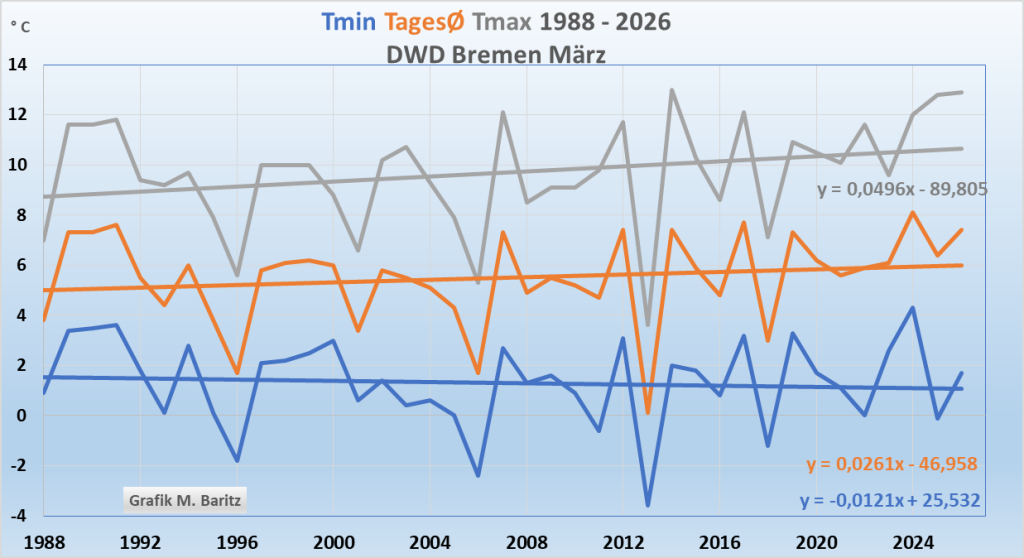

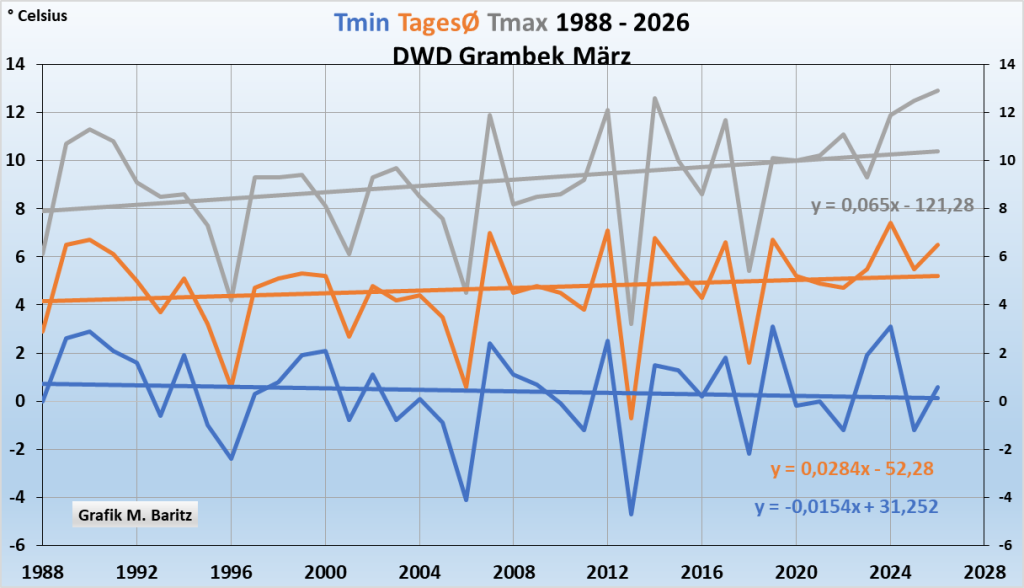

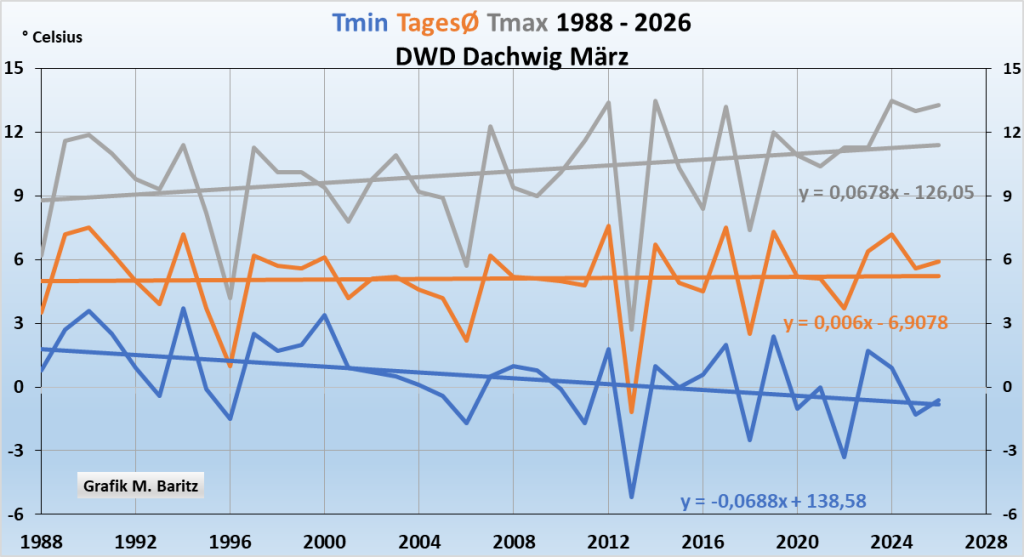

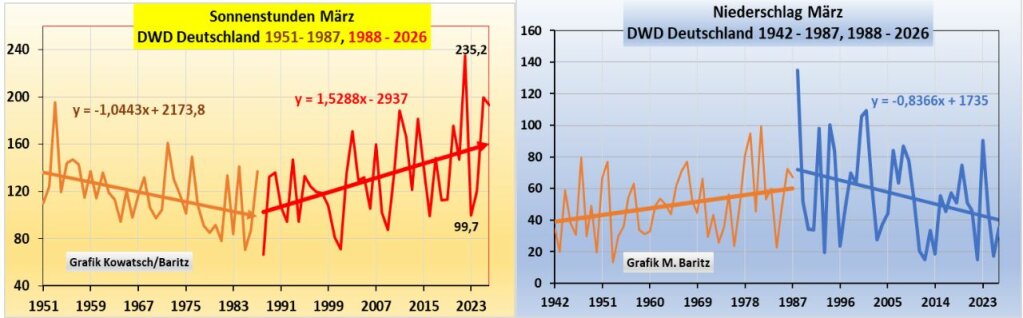

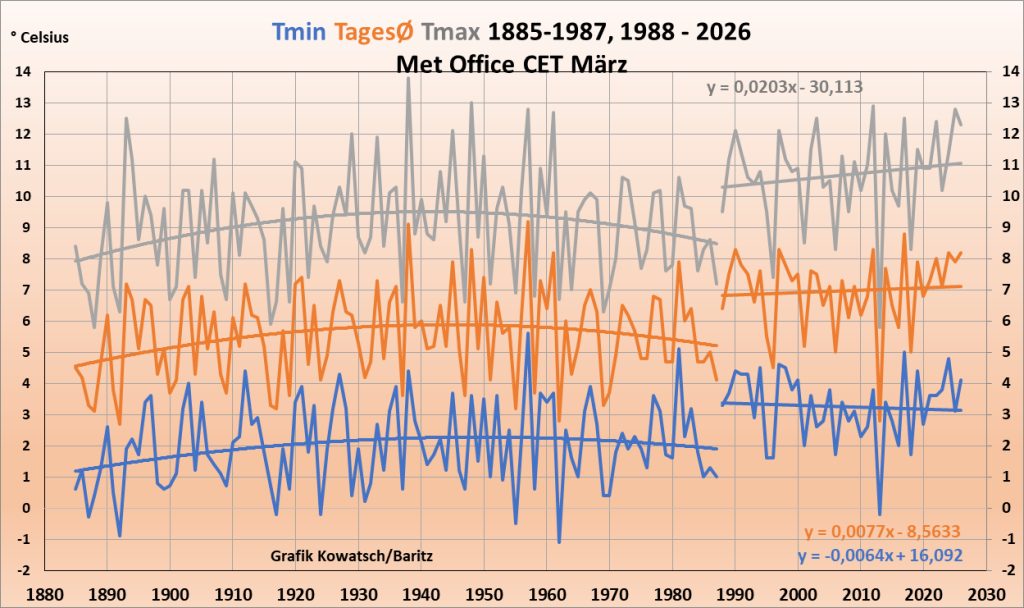

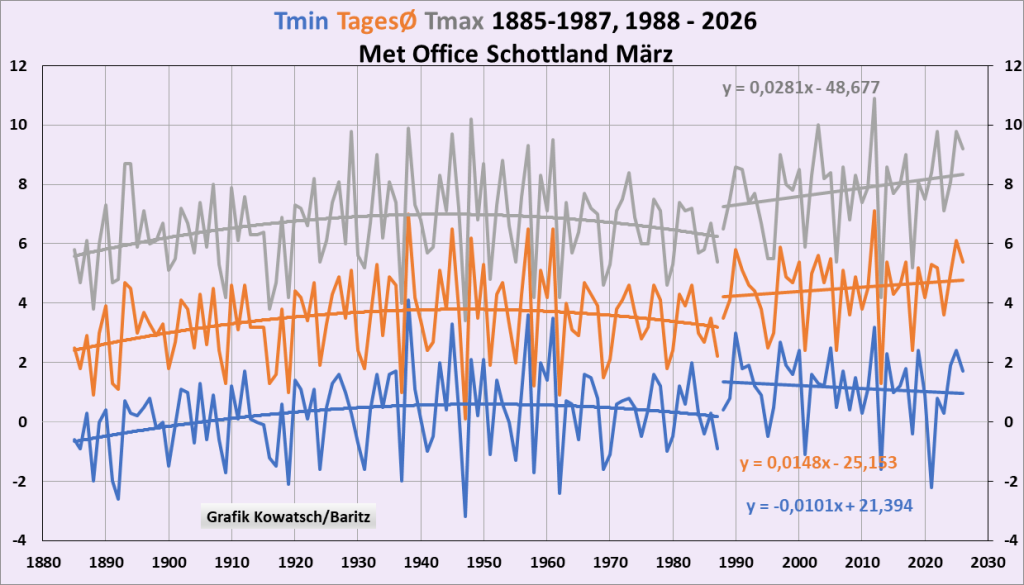

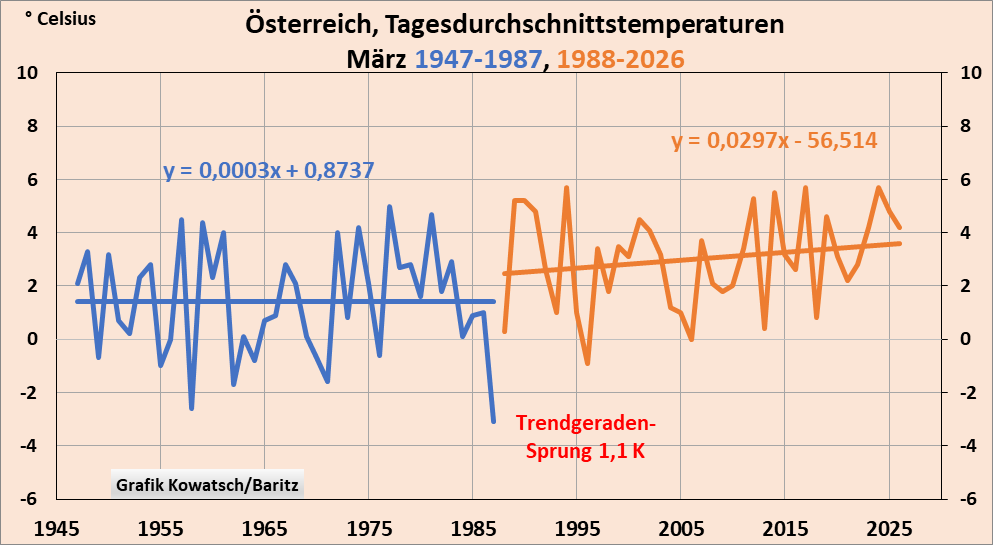

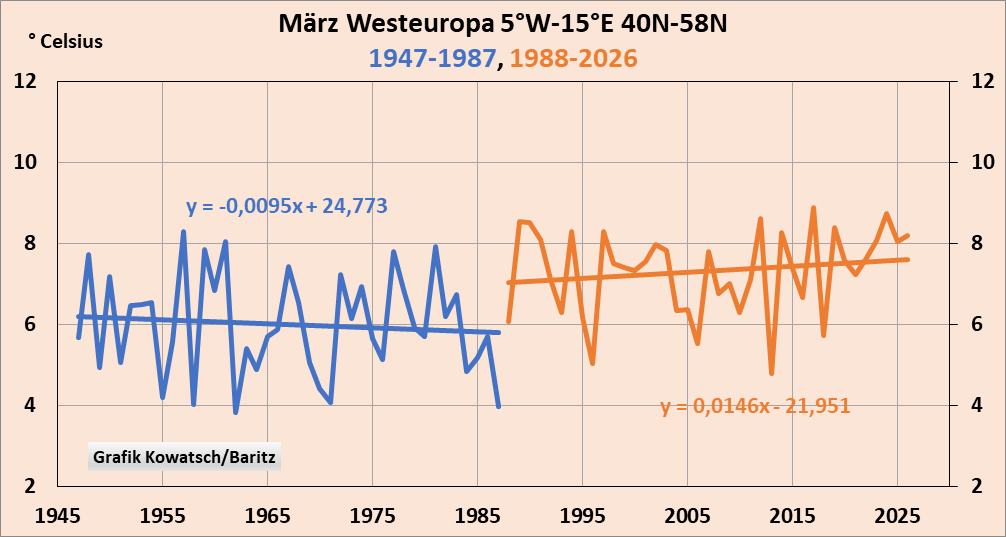

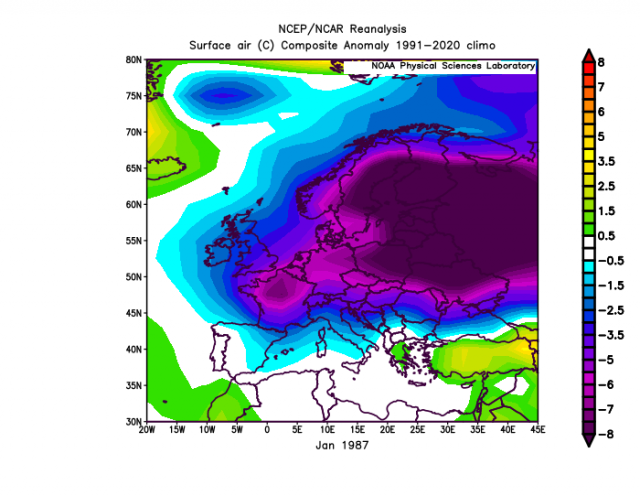

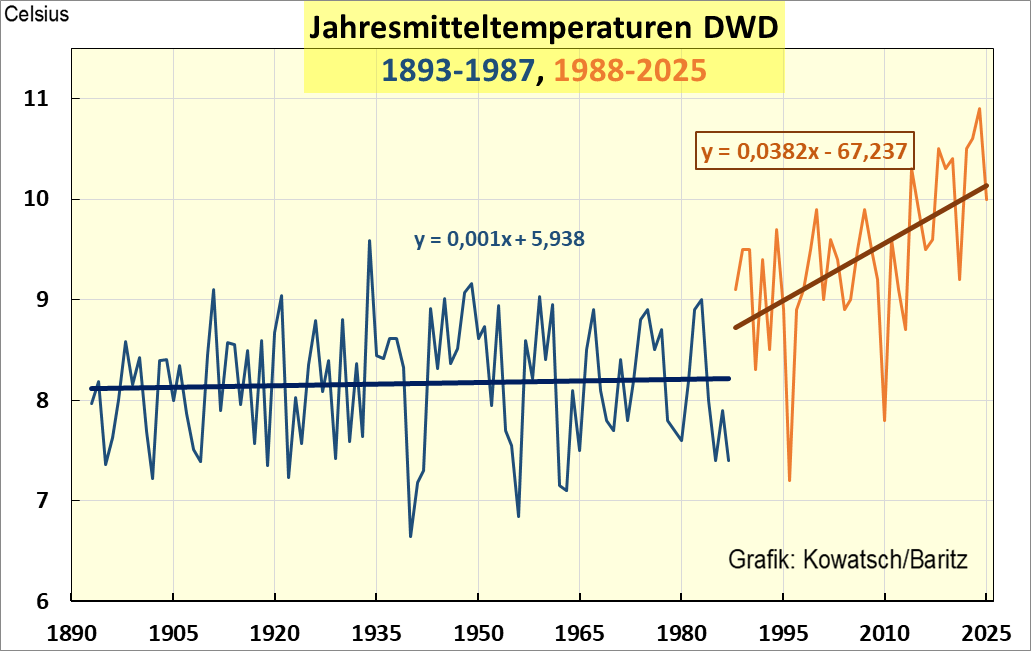

Zunächst mal: Die Klimaerwärmung in Mitteleuropa begann erst 1987/88

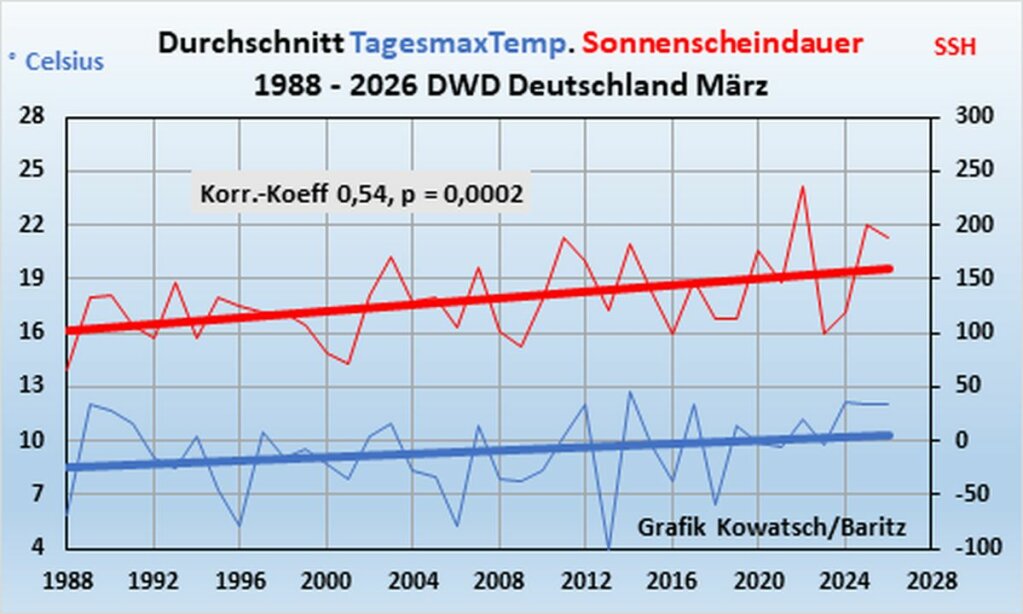

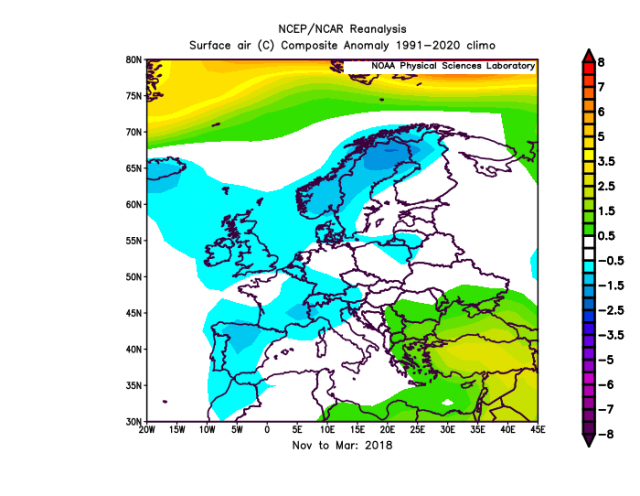

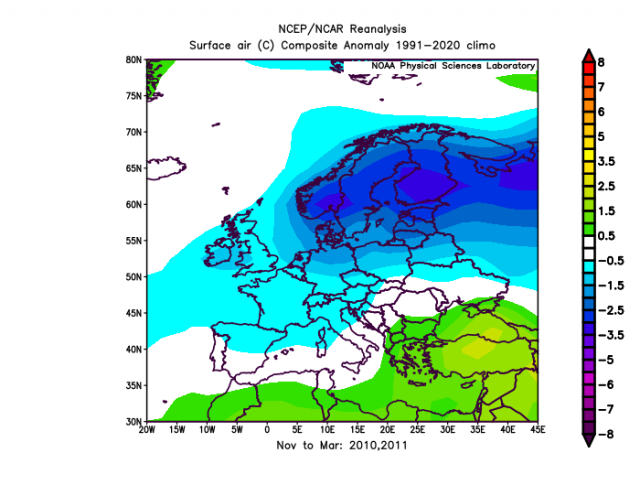

Grafik 6: Nicht nur Kinder springen – die Temperatur kann das auch – z.B. von 1987 auf 1988, ab 1988 wurde es plötzlich wärmer bei uns.

Zusammenfassend nochmals in Kürze die viele Gründe, weshalb es plötzlich ab 1987/88 wärmer wurde in Mittel- und Westeuropa. Hier 10 Gründe, es gibt sicherlich noch mehr.

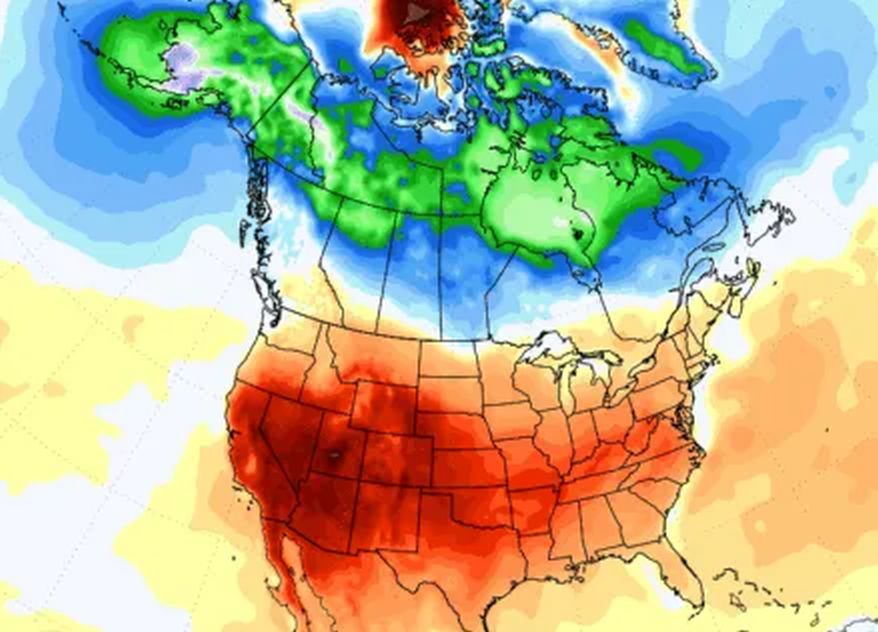

1) Die Drehung der Wetterlagen, von NW auf mehr südliche Richtungen

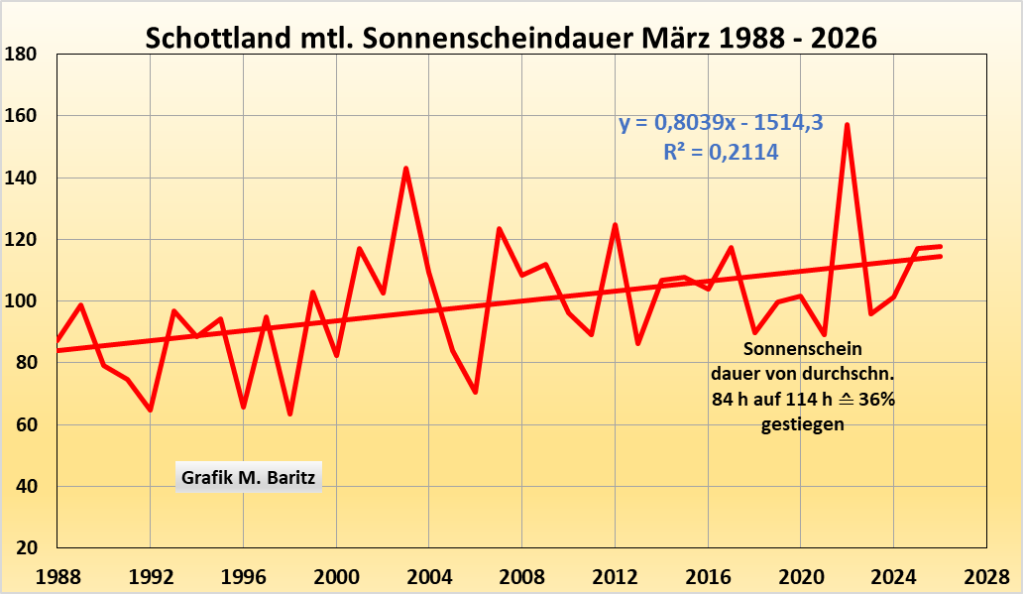

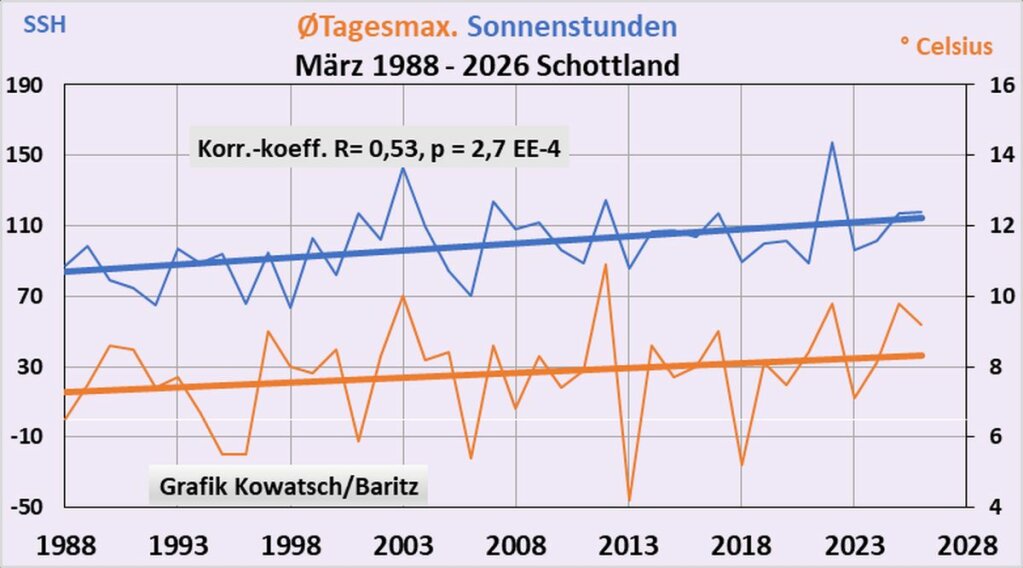

2) Die Zunahme der Sonnenstunden, samt den verstärkend wirkenden Luftreinhaltemaßnahmen

3) Die Abnahme der Niederschläge

4) Die Zunahme der Wärmeinselflächen, städtisch und flächenhaft in der einst freien Natur

5) Die anhaltende Trockenlegung der deutschen Landschaften durch Sickerschläuche und Drainageröhren, und zwar in Feld, Wald, Wiesen und Fluren.

6) Die AMO-Warmphase, die aber auch zyklisch ein Ende finden wird. (Inselwetterstationen, siehe Helgoland)

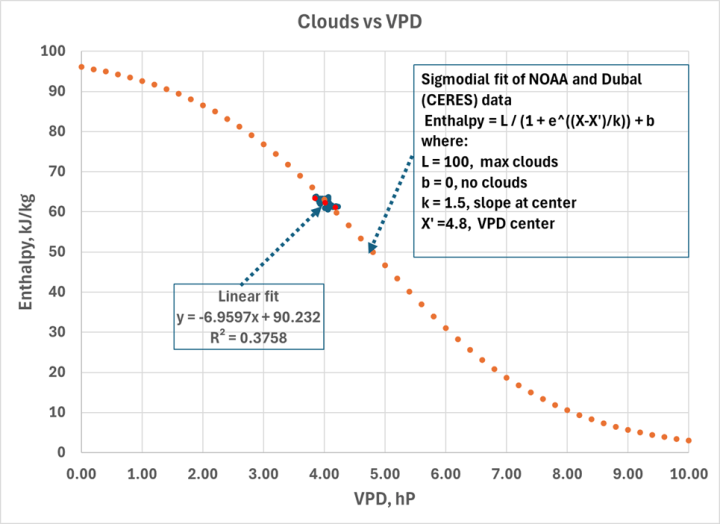

7)Laut DWD und dem Physikochemiker Dr. Hans Rolf Dübal die Abnahme der Bewölkungsdichte, siehe: https://www.youtube.com/watch?v=ONZZGrw62SQ&t=1339s

8) Die Verringerung der Albedo seit 40 Jahren, dadurch wird weniger Sonnenenergie ins Weltall zurückreflektiert.

9) Die statistische Erwärmung der DWD Temperaturreihen durch Stationentausch.

10) Die gänzliche neue Erfassungsmethode der Tagestemperatur – Wetterhütte und Mannheimer Stunden seit 2000 allmählich abgeschafft- die digitale Einheit muss nun frei und ganztägig in der Sonne stehen mit einer genormten Abschirmung. Näheres hier

Was die plötzliche erwärmende Änderung des Klimas ab 1987/88 in Mittel- und Westeuropa herbeiführte, also die 10 Einzelpunkte, das haben wir öfters schon beschrieben, z.B. hier ganz ausführlich.

Für die Behauptung der Klimakirche, dass fast allein CO₂, ein Spurengas in der Atmosphäre diese plötzliche Erwärmung 1987/88 bewirkt haben soll, gibt es keine wissenschaftlichen Beweise, nur Modellrechnungen, die dem Geschäftsmodell Klimaabzocke zuarbeiten.

- Es gibt keinen Versuch, der die Klimasensitivität von CO₂ auch nur annähernd bestimmen kann. Behauptet werden 2° bis 5°C Erwärmung. Jeder Versuch liefert Null oder das Ergebnis verschwindet im Rauschen der Messfehler.

- Es gibt auch keinerlei technisches Anwendungsbeispiel, bei welchem wir Menschen uns den behaupteten CO₂-Treibhauseffekt positiv zunutze machen könnten.

- Bei der Sprengung der Nordstream-Pipeline am 26. Sept. 2022 entwichen 300 000 Tonnen des 25x stärkeren Treibhausgases Methan. Erhöhte Konzentrationen konnten gemessen werden, die dazugehörige Treibhauserwärmung gab es nicht. Damit ist bewiesen, dass die sog. Treibhausgase auch in überhöhten Konzentrationen allerhöchstens in homöopathischen Dosen wirken können.

- Schon bei der Elite der deutschen Physiker wie Einstein, Heisenberg, Hahn, Planck spielte der CO₂-Treibhauseffekt keine Rolle. Er existierte für sie schlichtweg nicht, obwohl die Hypothese dazu schon Jahrzehnte zuvor entwickelte wurde.

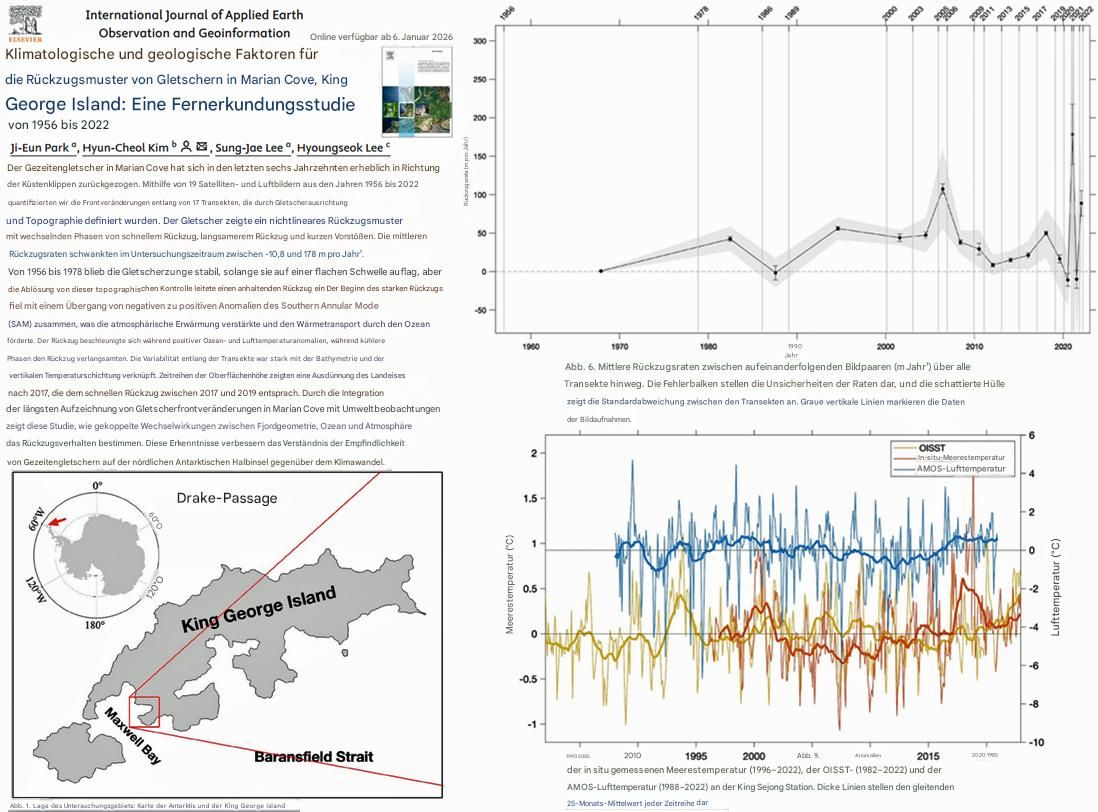

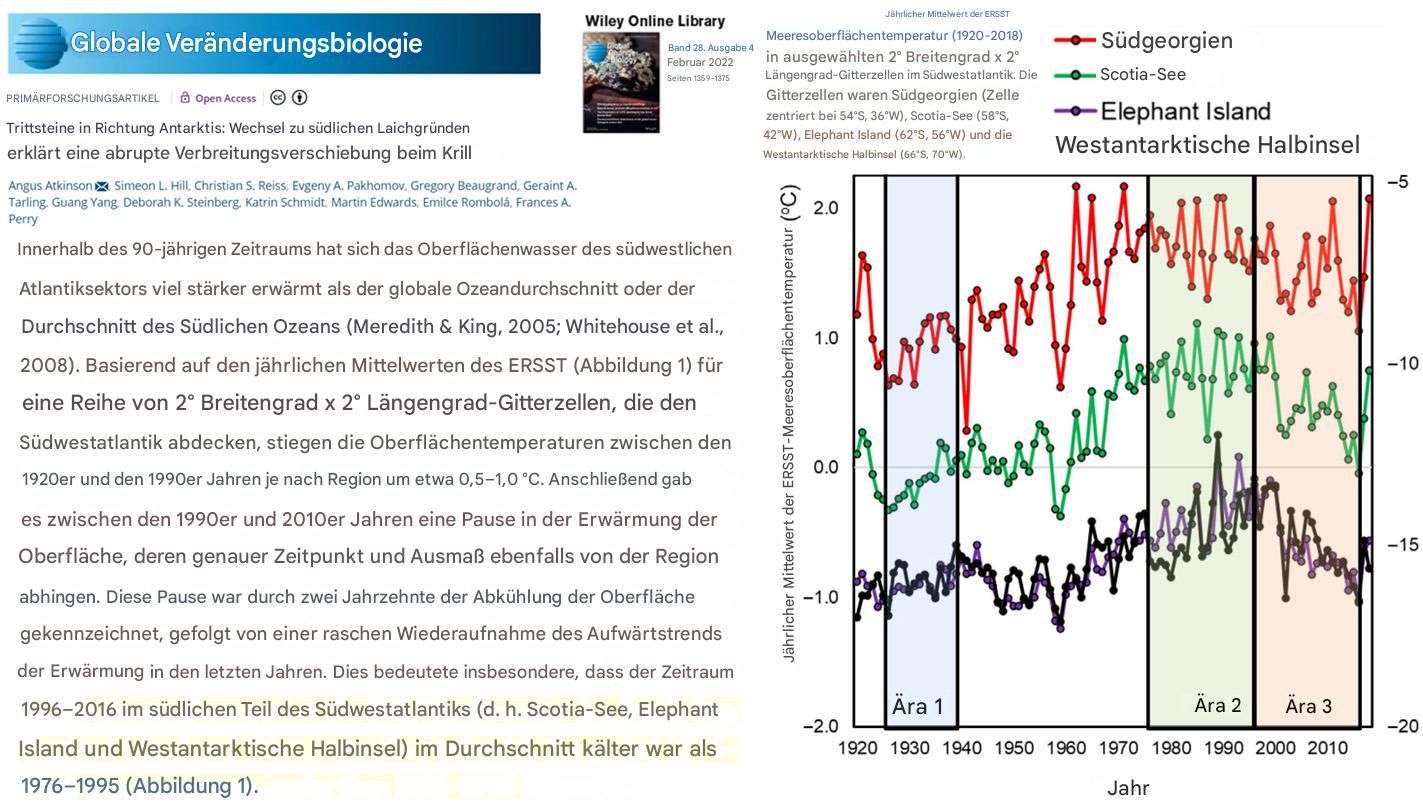

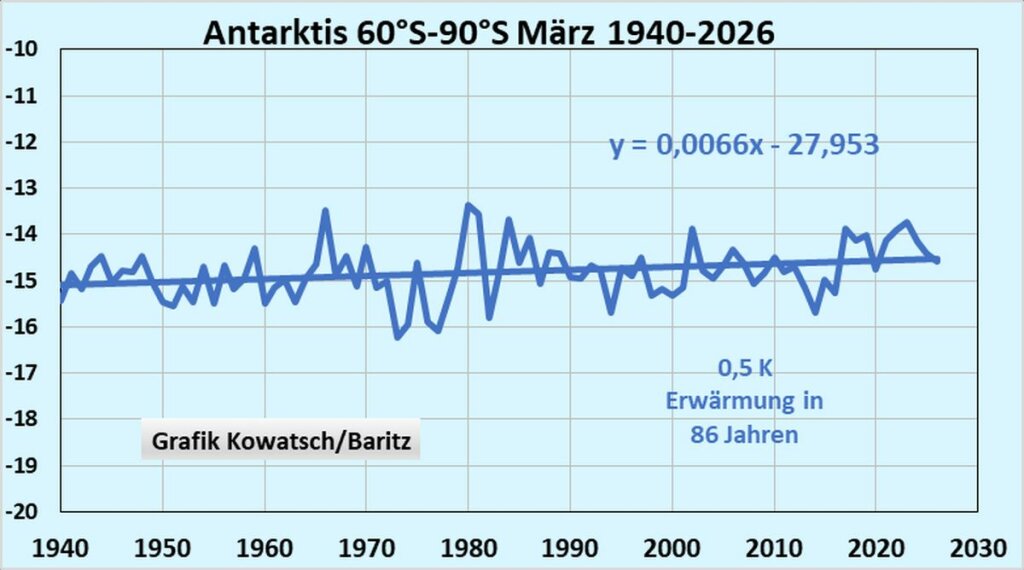

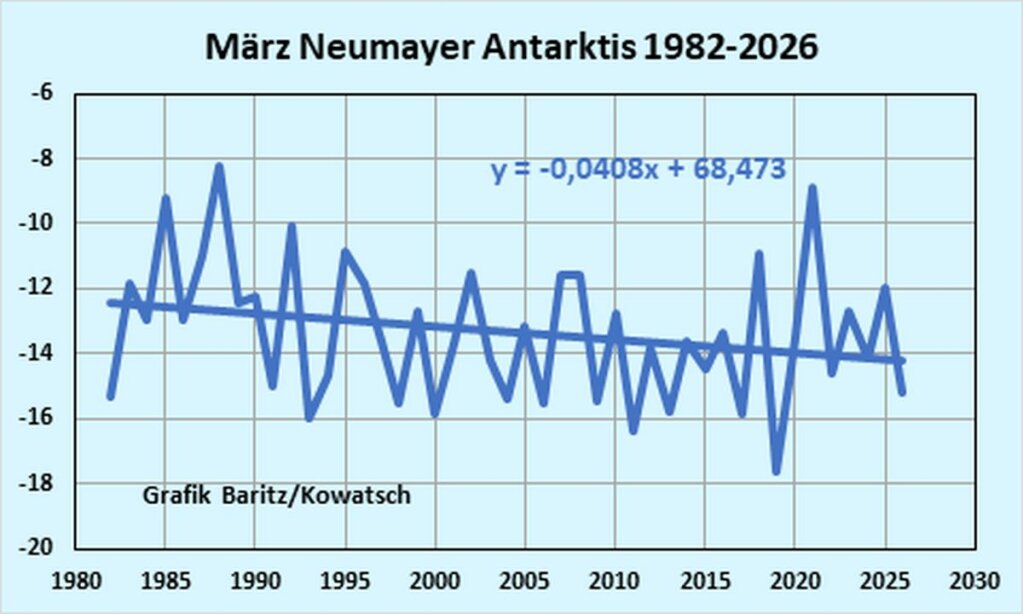

- Und in anderen Teilen der Welt wie in der Antarktis steigen die Temperaturen seit Jahrzehnten überhaupt nicht an, trotz CO₂-Zunahme. Wir zeigen das immer wieder anhand der Temperaturgraphiken der deutschen Neumayerstation.

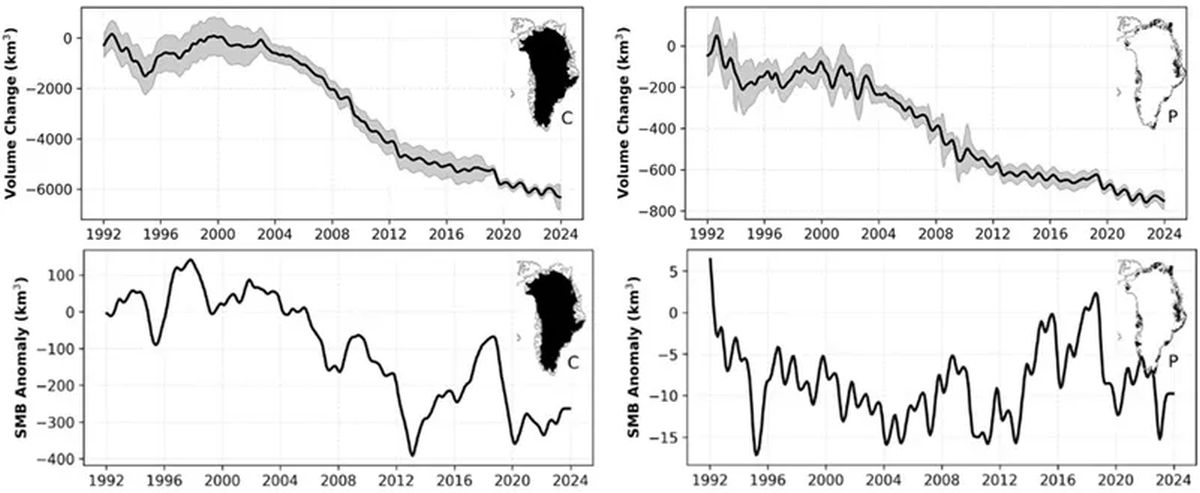

- Und in Grönland ist die Erwärmung vor etwa 15 Jahren zu einem Stillstand auf dem jetzigen Niveau angelangt.

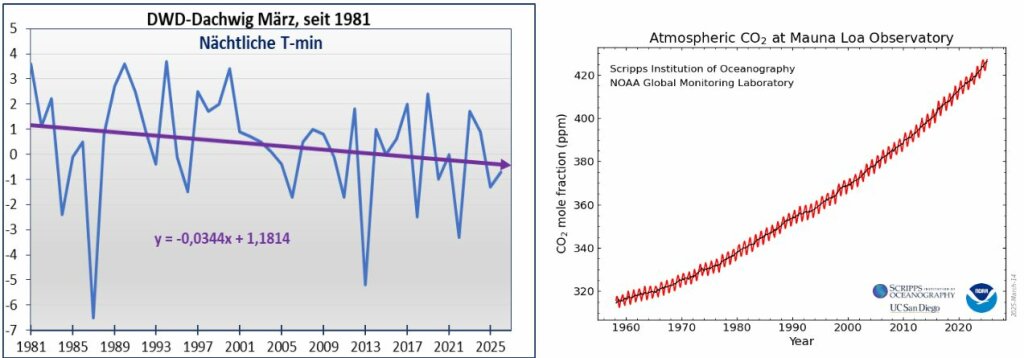

- In Mitteleuropa haben sich nur die Tagestemperaturen stark erwärmt seit 1987/88, die Nächte nicht. Bei ländlichen Stationen wurden die Nächte sogar leicht kälter. Und manche „Experten“ der CO₂-Theorie behauten doch genau das Gegenteil.

- Und im Zeitraum 1943 bis 1987 war es genau umgekehrt, die Tage tagsüber wurden kälter, die Nächte wärmer.

Schlussfolgerung: CO₂ ist zwar ein klimaaktives Gas, aber in diesen geringen Konzentrationen wirkt CO₂ allerhöchstens in homöopathischen Dosen bei der Temperaturgestaltung mit.

Also nicht nur Freispruch für CO₂, sondern wir müssen zu Kohlendioxid wieder die richtige wissenschaftliche und lebensbejahende positive Einstellung herstellen. CO₂ ist der Lebensmotor dieses Planeten. Und nicht der Temperaturregelknopf. Und wer zerstört schon freiwillig seinen Motor und behauptet, ohne Motor fährt das Auto besser.

Merke: CO₂ ist der Lebensmotor dieses Planeten. Und nicht der Temperaturregelknopf.

Wir sind deshalb gegen teure technische CO₂-Reduzierungsmaßnahmen, die dem Klima nichts nützen, sondern der Natur und Umwelt oft zusätzlich schaden. Wir lehnen auch jede Luftbesprühung aus Flugzeugen mit weißen Chemikalien-Staubwolken ab, um die Sonneneinstrahlung zu reflektieren und die Albedo wieder zu vergrößern. (Vorschlag aus den USA). Es könnte auch sein, dass der Schuss nach hinten losgeht und die Erwärmung verstärkt wird, siehe hier.

Nicht nur Freispruch für CO₂, sondern wir müssen zu Kohlendioxid wieder die richtige wissenschaftliche und positive Einstellung herstellen.

Schützt den bei uns seit 1988 wirkenden Klimawandel, schützt die seit 100 Jahren segensreich wirkende CO₂-Zunahme!

Die angenehme Erwärmung seit 1987/88 bis heute in Mitteleuropa ist ein Glücksfall für Deutschland und seine Menschen. Dass zugleich auch das Lebens- und Schöpfungsgas Kohlendioxid seit 100 Jahren weltweit zunimmt ist ein weiterer segensreicher Umstand, der die Ernten ständig steigen ließ. Die Zeit des Hungerns ist seit gut 70 Jahren vorbei. Dank der CO₂-Zunahme.

Wir leben in Deutschland derzeit klimatisch in einer außerordentlich gesegneten Zeit, die noch lange anhalten möge. Das CO₂ meint es gut mit der Welt und das Klima meint es derzeit gut mit uns Deutschen und unserem Land. Mehr Ernte, weniger Kälte im Winter. Wir sollten positiv in die Zukunft blicken und dem Schöpfer dankbar sein für dieses tolle Klima, das sich bei uns seit 1988 eingestellt hat.

Wir alle sind aufgerufen, jeder auf seinem Weg und nach seinem Können die derzeitige Klima-Panikmache und die Verteufelung des lebensnotwendigen Kohlendioxids zu bekämpfen. Ein Umdenken in der Bevölkerung und bei den Kirchen ist schnellstens erforderlich, um den völlig unsinnigen CO₂-Reduzierungsmaßnahmen der linksgrünen Klimapolitik ein Ende zu bereiten. Weg mit der CO₂-Steuer, weg mit dem angeblichen Klimaschutz. Das ist eine geplante Zerstörung unseres Landes. Nicht das Klima ist bedroht, sondern unsere Freiheit.

Josef Kowatsch, Naturbeobachter, aktiver Naturschützer, unabhängiger, weil unbezahlter Klimaforscher

Matthias Baritz, Naturwissenschaftler und Umweltschützer.

Literatur: uns zugesandtes Manuscript zu diesem Thema von Dr. Johannes Wildmann, Marburg.

Der Beitrag Kohlendioxid ist Leben, Kohlendioxid ist Schöpfung! erschien zuerst auf EIKE - Europäisches Institut für Klima & Energie.