Vorschau ansehen

Jonathan Cohler

https://x.com/cohler/status/2045615260443279694

Zusammenfassung meines Vortrags auf der ICCC16 am 8. April 2026.

John Cohler bei seinem Vortrag Heartland Climate Conference April 2026

Die dieser Analyse zugrunde liegenden Dokumente sind unter

http://papers.jcohler.com verfügbar.

Seit fast vier Jahrzehnten wird der Welt eine Geschichte erzählt: Die Erde erwärmt sich in alarmierendem Tempo, der Mensch ist dafür verantwortlich, indem er fossile Brennstoffe verbrennt, und wenn wir nicht Billionen von Dollar investieren, um dies zu verhindern, droht eine Katastrophe. Regierungen haben ihre Wirtschaften auf diese Geschichte ausgerichtet. Kinder wachsen mit Angst davor auf. Wissenschaftler, die sie hinterfragen, werden ausgegrenzt.

Es gibt da nur ein Problem. Die wissenschaftliche Grundlage dieser Argumentation – jede einzelne Zahl, die der IPCC verwendet – ist physikalisch bedeutungslos. Nicht unsicher. Nicht diskutabel. Physikalisch bedeutungslos, genauso wie der Durchschnitt aller Telefonnummern in Washington, D.C., bedeutungslos ist. Man kann ihn berechnen. Die Rechnung stimmt. Aber das Ergebnis sagt absolut nichts über die Realität aus.

Das ist keine abwegige Behauptung. Es handelt sich um einen mathematischen und physikalischen Beweis, der auf wissenschaftlichen Artikeln und den Grundprinzipien der Thermodynamik basiert. Und wenn man es einmal erkannt hat, kann man es nicht mehr ignorieren.

Die erste Lüge: Eine Temperatur, die nicht existiert

Alles beginnt mit der globalen mittleren Oberflächentemperatur (GMST). Diese eine Zahl – üblicherweise als Abweichung vom vorindustriellen Niveau angegeben – bildet die Grundlage der gesamten IPCC-Studie. Wenn Sie hören, dass sich die Erde seit der industriellen Revolution um 1,2 Grad erwärmt hat, sprechen Sie von der GMST. Wenn Klimamodelle eine Erwärmung von 2, 3 oder 4 Grad bis zum Jahr 2100 prognostizieren, beziehen sie sich auf Veränderungen der GMST. Wenn das Pariser Abkommen eine Obergrenze von 1,5 Grad festlegt, ist dies eine Obergrenze für die GMST.

Was genau ist GMST? Hier beginnt die Geschichte sich zu entwirren.

Temperatur ist in der Physik eine sogenannte intensive Größe. Das bedeutet, sie beschreibt den Zustand eines spezifischen physikalischen Systems – eines Systems mit Grenzen, das sich im oder nahe am thermischen Gleichgewicht befindet und dessen Zustandsgleichung eindeutig definiert ist. Man kann sinnvoll über die Temperatur einer Tasse Kaffee, eines Zimmers oder des Ozeans in einer bestimmten Tiefe sprechen, da es sich dabei jeweils um ein definiertes physikalisches System handelt. Was man jedoch nicht tun kann, ohne die Gesetze der Thermodynamik zu verletzen, ist, Temperaturen von Systemen zu addieren, die nicht in thermischem Kontakt miteinander stehen, und das Ergebnis als „Temperatur“ zu bezeichnen.

Die Erdoberfläche ist kein thermodynamisches System. Sie ist ein Flickenteppich aus Tausenden von lokalen Systemen – Wüsten und Regenwäldern, polaren Eisschilden und tropischen Ozeanen, Berggipfeln und Talsohlen –, von denen keines mit den anderen im thermischen Gleichgewicht steht. Die Mittelung ihrer Temperaturen ergibt zwar einen Wert. Dieser Wert ist aber keine Temperatur im physikalisch sinnvollen Sinne. Er unterliegt keiner Zustandsgleichung. Es gibt kein physikalisches Gesetz, das ihn mit irgendetwas verknüpft. Wie der Physiker Christopher Essex und seine Kollegen in einer Veröffentlichung aus dem Jahr 2007 überzeugend darlegten, ist er schlichtweg keine Temperatur.

The Emperor Has No Clothes: How the IPCC Built a 38-Year Climate Empire on a Circle of Lies

Summary of my talk at ICCC16 on April 8, 2026.

The papers underlying this analysis are available at https://t.co/ym4Iv7EjWR.

For nearly four decades, the world has been told a story. The… https://t.co/EwuAzclQxL

— Jonathan Cohler (@cohler) April 18, 2026

Das ist keine bloße Formalität. Es handelt sich um einen Kategorienfehler, der in jedem anderen Wissenschaftsbereich ein Forschungsprogramm sofort beenden würde. Intensive Eigenschaften über Nichtgleichgewichtssysteme hinweg zu mitteln, ist so, als würde man die Postleitzahlen aller Einwohner New Yorks mitteln und das Ergebnis dann als Wegbeschreibung verwenden. Die Rechnung liefert eine Zahl. Diese Zahl ist bedeutungslos.

Die Internationale Organisation für Normung (ISO) erkannte dies bereits vor Jahrzehnten implizit an. 2002 wurde die ISO beauftragt, alle wichtigen Begriffe im Zusammenhang mit dem Klimawandel zu definieren – und bis heute fehlt der Begriff „globale Durchschnittstemperatur“ in den finalen Definitionen. Diese Auslassung ist kein Versehen. Der Auftrag der ISO erfordert messtechnische Genauigkeit, und der Begriff „globale Durchschnittstemperatur“ kann diesen Anforderungen nicht gerecht werden.

Weder der IPCC noch irgendeine andere Klimabehörde hat jemals eine präzise physikalische Definition der globalen mittleren Oberflächentemperatur (GMST) vorgelegt. Sie verwenden den Begriff ständig – er taucht in praktisch jedem Kapitel des Sechsten Sachstandsberichts des IPCC auf –, aber sie haben nie definiert, welche physikalische Größe er repräsentiert, weil eine solche Definition nicht möglich ist.

Die zweite Lüge: Modelle, die auf nichts basieren

Wenn GMST physikalisch bedeutungslos ist, was leisten dann die Klimamodelle des IPCC eigentlich?

Die Antwort ist unbequem. Jedes der vom IPCC verwendeten wichtigen Klimamodelle – das Ensemble CMIP (Coupled Model Intercomparison Project) – ist darauf ausgelegt, historische Trends der mittleren globalen Oberflächentemperatur (GMST) zu reproduzieren. Diese Modelle verfügen über Hunderte von anpassbaren Parametern, die so eingestellt werden, dass die Modellausgabe mit den beobachteten GMST-Daten übereinstimmt. Diesen Vorgang nennt man Validierung: Man passt das Modell so lange an, bis es zu den Daten passt, und erklärt es dann anhand der Beobachtungen für validiert.

Wenn die globale mittlere Oberflächentemperatur (GMST) jedoch keine physikalisch sinnvolle Größe darstellt, ist die Anpassung eines Modells an ihre Reproduktion keine Validierung. Es handelt sich vielmehr um eine Kurvenanpassung an eine Zahl ohne physikalischen Gehalt. Das Modell lernt, ein mathematisches Artefakt abzubilden, nicht die physikalische Realität. Und da es sich um gekoppelte globale Zirkulationsmodelle handelt – in denen die Temperatur mit Niederschlag, Wind, Meeresströmungen, Meereis und Dutzenden weiterer Variablen interagiert –, breitet sich diese Verfälschung überall aus. Jede vom Modell erzeugte Projektion erbt für jede Variable die ursprüngliche Bedeutungslosigkeit.

Die Auswirkungen sind erschreckend. Jede Temperaturprognose. Jede Meeresspiegelprognose. Jede Prognose extremer Wetterereignisse. Jede CO₂-Bilanz. Jede Berechnung der verbleibenden Emissionen. All das basiert auf Modellen, die anhand einer physikalisch nicht existierenden Größe validiert wurden.

Die dritte Lüge: Ein Ozean, der nie vermessen wurde

Da die Aufzeichnungen der Oberflächentemperatur umstritten und unzuverlässig waren, entwickelte der IPCC eine zweite Beweiskette: den Wärmeinhalt der Ozeane (OHC). Die Argumentation war einfach: Wenn die Erde durch den Treibhauseffekt Energie speichert, muss diese Energie irgendwohin fließen, und der größte Teil davon sollte in die Ozeane gelangen. Misst man den Wärmeinhalt der Ozeane über einen längeren Zeitraum, erhält man ein direktes Maß für das Energieungleichgewicht der Erde.

Dieses Argument klingt überzeugend. Es basiert auf dem Programm Argo – einem Netzwerk von rund 4.400 Roboterbojen, die in den Weltmeeren verteilt sind. Jede Boje taucht bis zu 2.000 Meter tief und steigt alle zehn Tage wieder an die Oberfläche, wobei sie Temperatur- und Salzgehaltsprofile übermittelt. Argo ist eine echte wissenschaftliche Leistung, ein technisches Meisterwerk, das eine enorme Menge wertvoller ozeanografischer Daten geliefert hat.

Laut den Gründungsdokumenten von 1998 war Argo ursprünglich für Folgendes konzipiert: die Beobachtung des sich verändernden physikalischen Zustands der oberen Ozeanschichten, die Erfassung regionaler Wärme- und Salzgehaltsmuster, die Unterstützung der Wettervorhersage und die Ergänzung von Satellitenaltimetern. Der globale Wärmegehalt der Ozeane und das Energieungleichgewicht der Erde werden nirgends erwähnt. Das Programm war nicht für diesen Zweck gedacht und ist dafür grundlegend ungeeignet.

Das Problem beginnt mit grundlegenden physikalischen Prinzipien. Wenn eine Argo-Boje innerhalb von sechs bis zehn Stunden von 2.000 Metern Tiefe zur Oberfläche aufsteigt, sammelt sie dabei etwa 1.000 Temperaturmessungen. Die Boje driftet jedoch die ganze Zeit. Bis sie auftaucht und per Satellit Daten sendet, kann sie sich bis zu 50 Kilometer von der Stelle entfernt befinden, an der die tiefsten Messungen durchgeführt wurden. Diese Messungen werden alle der GPS-Position an der Oberfläche zugeordnet – dem einzigen tatsächlich bekannten Standort. Die tatsächliche Unterwasserbahn ist völlig unbekannt. Jeder einzelne Datenpunkt unter Wasser wird dem falschen Standort zugeordnet.

Dann beginnt die Interpolation. Die 12.000 monatlichen Messwerte – die bereits räumlich falsch zugeordnet sind – werden verwendet, um 45.000 dreidimensionale Gitterzellen zu füllen, die den globalen Ozean abdecken. Der größte Teil des Ozeans wird gar nicht gemessen, sondern berechnet. Polargebiete, Küstenzonen und Randmeere werden weitgehend ausgeschlossen. Etwa die Hälfte des gesamten Ozeanvolumens, einschließlich aller Wassermassen unterhalb von 2.000 Metern, wird schlichtweg ignoriert. Die Berechnungen verwenden Korrelationsfunktionen, die Messwerte von Wassermassen vermischen, die Hunderte oder sogar Tausende von Kilometern voneinander entfernt liegen, und so jegliche lokale Information zerstören, die die Messbojen tatsächlich erfasst haben.

Die aus diesem Prozess berechneten Anomalien – die Abweichungen von einem historischen Referenzwert – stoßen dann auf dasselbe grundlegende physikalische Problem wie GMST. Temperatur ist eine intensive Größe. Man kann Temperaturanomalien nicht sinnvoll über Nichtgleichgewichtsvolumina des Ozeans mitteln, genauso wenig wie über die Erdoberfläche. Der resultierende Wert hat zwar eine Einheit und die Berechnung ist korrekt, aber er repräsentiert keine physikalische Realität.

Wenn alle relevanten Unsicherheitsquellen – nicht erfasste Trajektorien, Interpolationsfehler, unzureichende Kenntnisse über die Tiefsee, Lücken in den Polargebieten und uneinheitliche Messrahmen – korrekt quantifiziert werden, beträgt die tatsächliche Unsicherheit des abgeleiteten Wertes für das Energieungleichgewicht der Erde mehr als ± 1 Watt pro Quadratmeter bei einer Wahrscheinlichkeit von 95 %. Der sechste Sachstandsbericht des IPCC gibt sie mit 0,7 ± 0,2 Watt pro Quadratmeter an. Die tatsächliche Unsicherheit ist etwa fünfmal größer als das gemessene Signal. Das Ergebnis ist statistisch nicht von null zu unterscheiden.

Die vierte Lüge: Satelliten wurden an die Fiktion angepasst

Der IPCC präsentiert seine Daten zum Wärmegehalt der Ozeane und seine satellitengestützten Daten zum Energieungleichgewicht als zwei unabhängige, übereinstimmende Beweisketten. Diese Übereinstimmung wird als starke Bestätigung dafür angeführt, dass die Erde Energie in dem behaupteten Ausmaß speichert.

Was der IPCC nicht prominent in den Vordergrund rückt, ist, wie diese Einigung zustande kam.

Die CERES-Instrumente der NASA – Satelliten zur Messung der Strahlungsbilanz am oberen Rand der Atmosphäre – liefern Rohmesswerte mit einer absoluten Unsicherheit von etwa drei bis fünf Watt pro Quadratmeter. Das vom IPCC angegebene Messsignal beträgt 0,7 Watt pro Quadratmeter. Die Satelliten allein können diese Größe nicht bestimmen.

Was wurde also getan? Die CERES-Daten wurden – mittels einer Methode der kleinsten Quadrate – angepasst, um eine Übereinstimmung mit der aus Argo-Daten abgeleiteten Schätzung des Wärmegehalts der Ozeane zu erzielen. Die Dokumentation des IPCC-Berichts AR6 bestätigt dies ausdrücklich: Die CERES-Flüsse „wurden innerhalb der geschätzten Unsicherheiten angepasst, um sicherzustellen, dass der Nettofluss an der Obergrenze der Atmosphäre mit der auf Basis von Messungen des Wärmegehalts der Ozeane geschätzten Energiebilanz der Erde übereinstimmt.“

Anders ausgedrückt: Sie haben die Satelliten so ausgerichtet, dass sie mit den Driftbojen übereinstimmten, und diese Übereinstimmung dann als unabhängige Bestätigung angeführt. Das ist keine Wissenschaft. Das ist ein Zirkelschluss mit unnötigen Umwegen.

Dieses Verhalten ist im IPCC-Ökosystem nicht beispiellos. Kevin Trenberth, einer der Architekten des Modells zur Berechnung des Wärmegehalts der Ozeane, schrieb in einer mittlerweile berüchtigten E-Mail aus dem Jahr 2009, die durch die ClimateGate-Enthüllungen ans Licht kam: „Tatsache ist, dass wir die derzeit ausbleibende Erwärmung nicht erklären können, und es ist eine Farce, dass wir es nicht können. Die im August veröffentlichten CERES-Daten zeigen, dass es eigentlich noch stärkere Erwärmung geben müsste: aber die Daten sind mit Sicherheit falsch.“ Wenn die Satellitendaten nicht mit den Modellen übereinstimmen, gelten die Satelliten als falsch. Wenn die Satellitendaten so angepasst werden, dass sie übereinstimmen, wird diese Übereinstimmung als Bestätigung angeführt. Das System ist von vornherein manipuliert.

Die fünfte Lüge: Der CO-Fingerabdruck ₂ , der nie existierte

Die letzte Säule der IPCC-Argumentation ist die Zuordnung des Kohlendioxids. Zwar ist der CO₂-Gehalt ₂ in der Atmosphäre gestiegen, und menschliche Industrieaktivitäten emittieren CO₂ ₂ . Doch der IPCC geht noch weiter und behauptet, der Anstieg des atmosphärischen CO₂ ₂ sei fast ausschließlich anthropogen bedingt – natürliche Prozesse könnten ihn nicht erklären, und die Isotopenzusammensetzung des atmosphärischen CO₂ ₂ liefere einen eindeutigen menschlichen Fingerabdruck.

Diese Behauptung stützt sich auf das Berner Modell, ein mathematisches Modell, das die CO₂-Verteilung ₂ zwischen Atmosphäre und natürlichen Speichern beschreibt. Das Berner Modell weist eine besonders alarmierende Eigenschaft auf: Es prognostiziert, dass ein erheblicher Anteil des heute emittierten CO₂ ₂ Jahrhunderte oder Jahrtausende in der Atmosphäre verbleiben wird. Der fünfte Sachstandsbericht des IPCC (AR5) besagt, dass 15 bis 40 Prozent des emittierten CO₂ ₂ über tausend Jahre in der Atmosphäre verbleiben werden. Dies ist die Grundlage für CO₂-Budgets und Klimaneutralitätsziele.

Das Berner Modell wurde durch Beweise widerlegt, die seit sechzig Jahren offenkundig waren.

Als die atmosphärischen Atomtests Anfang der 1960er Jahre ihren Höhepunkt erreichten, wurde ein massiver Impuls radioaktiven Kohlenstoffs – Atom-14-Kohlenstoff (CO₂) – in die Atmosphäre freigesetzt. Dieser Impuls wird seither kontinuierlich verfolgt. Wäre das Berner Modell korrekt, müsste dieser Impuls langsam abklingen, wobei ein substanzieller permanenter Anteil zurückbliebe. Stattdessen klingt er exponentiell mit einer e-Faltungszeit von etwa siebzehn Jahren ab. Der Atom-14-Kohlenstoff ist verschwunden. Er durchlief das System und wurde innerhalb von etwa einem halben Jahrhundert vollständig absorbiert. Das multi-exponentielle Berner Modell mit seinem permanenten Anteil in der Atmosphäre ist schlichtweg falsch. CO₂ ₂ verbleibt nicht über Jahrtausende in der Atmosphäre. Es durchläuft das System innerhalb von Jahren bis Jahrzehnten.

Die Isotopenanalyse bestätigt dies. Das Kohlenstoffisotopenverhältnis im atmosphärischen CO₂ ₂ – die sogenannte Delta-13C-Größe – nimmt ab, da sich das isotopisch leichtere CO₂ aus fossilen Brennstoffen ₂ mit der Atmosphäre vermischt. Der IPCC wertet diesen Rückgang als eindeutigen Beweis für die menschliche Verursachung.

Eine 2024 von Fachkollegen begutachtete Studie von Prof. Demetris Koutsoyiannis untersuchte die tatsächlichen Isotopendaten eingehend und fand etwas, das mit der gängigen Lehrmeinung nicht vereinbar ist: Die Netto-Isotopensignatur des atmosphärischen Eintrags ist seit der Kleinen Eiszeit im Wesentlichen unverändert geblieben. Der Wert ist stabil geblieben – weltweit, an allen wichtigen Messstationen und während der gesamten Industrialisierungsphase. Ein sich verändernder menschlicher Einfluss müsste sich in einer veränderten Nettosignatur widerspiegeln. Das ist jedoch nicht der Fall. Die Isotopenzusammensetzung ist mit der Dominanz der natürlichen Biosphäre und einem nicht nachweisbaren menschlichen Beitrag vereinbar.

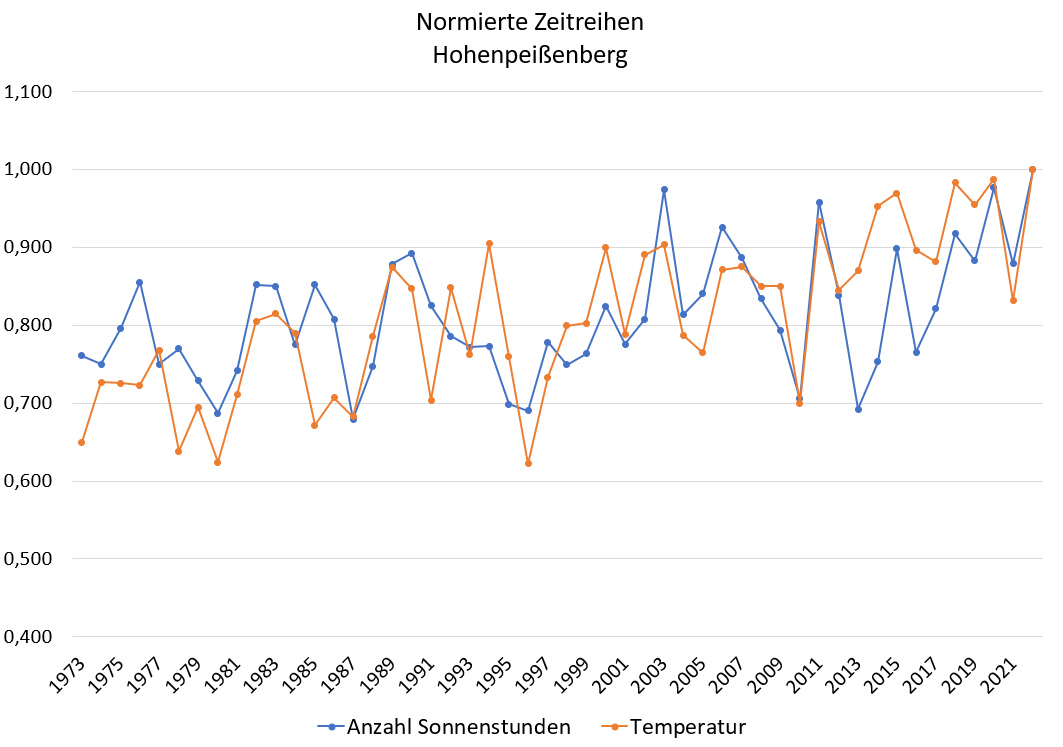

Der Grund dafür ist nicht mysteriös. Die Biosphäre – Pflanzen, Böden, Ozeane – zirkuliert jährlich etwa 25-mal mehr Kohlenstoff als die menschlichen Industrieemissionen. Natürliche Prozesse sind dabei mit Abstand dominant. Menschliche Emissionen stellen lediglich ein Rauschen dar, das einem gewaltigen natürlichen Signal überlagert ist. Und die Temperatur, nicht menschliche Aktivitäten, ist für den größten Teil dieses Signals verantwortlich: Die Erwärmung führt dazu, dass die Biosphäre mehr CO₂ ausstößt ₂ , was die atmosphärischen Konzentrationen erhöht. Die Kausalität verläuft von der Temperatur zum CO₂ ₂ , nicht umgekehrt.

5 x 0 = 0

Treten Sie einen Schritt zurück und betrachten Sie das Gesamtbild.

Die Argumentation des IPCC für eine vom Menschen verursachte Klimakatastrophe stützt sich auf fünf miteinander verknüpfte Indikatoren: die globale mittlere Oberflächentemperatur (GMST), die darauf abgestimmten Klimamodelle, den Wärmeinhalt der Ozeane, das aus der Wärme der Ozeane resultierende Energieungleichgewicht der Erde und die CO₂-Zuordnung ₂ . Jeder dieser Indikatoren wird als unabhängiger Beweis präsentiert. Zusammen bilden sie laut IPCC einen überwältigenden Beweis.

Sie sind jedoch nicht unabhängig. Sie bilden einen Kreis. Die globale mittlere Oberflächentemperatur (GMST) ist physikalisch bedeutungslos. Die Modelle sind auf die GMST abgestimmt und erben deren Bedeutungslosigkeit. Der Wärmegehalt der Ozeane wird durch ein Verfahren berechnet, das gegen die Gesetze der Messphysik verstößt und statistisch nicht von null zu unterscheiden ist. Die Energiebilanz der Erde wird aus dem Wärmegehalt der Ozeane abgeleitet und durch Satelliten bestätigt, die entsprechend justiert wurden. Die Zuordnung von CO ₂ basiert auf einem Modell, das durch Daten aus Atombombenversuchen widerlegt wurde, und einem Isotopen-Fingerabdruck, der in den Beobachtungen nicht existiert.

Jedes Glied der Kette ist von den anderen abhängig. Keines steht für sich allein. Der IPCC nennt dies „mehrere Beweisketten“. Doch fünf mal null ist immer noch null.

Was das bedeutet

Nichts davon beweist, dass sich das Klima nicht verändert oder das menschliche Aktivitäten keinen Einfluss auf die Atmosphäre haben. Das Klima verändert sich kontinuierlich, und das seit Milliarden von Jahren. Es zeigt lediglich, dass die spezifischen Kennzahlen, mit denen der IPCC die Krise quantifiziert – jede Zahl, die die Politik bestimmt, jede Zahl, die die Ausgaben rechtfertigt, jede Prognose, die die Öffentlichkeit verängstigt – auf einem Fundament beruhen, das den Gesetzen der Physik nicht standhält.

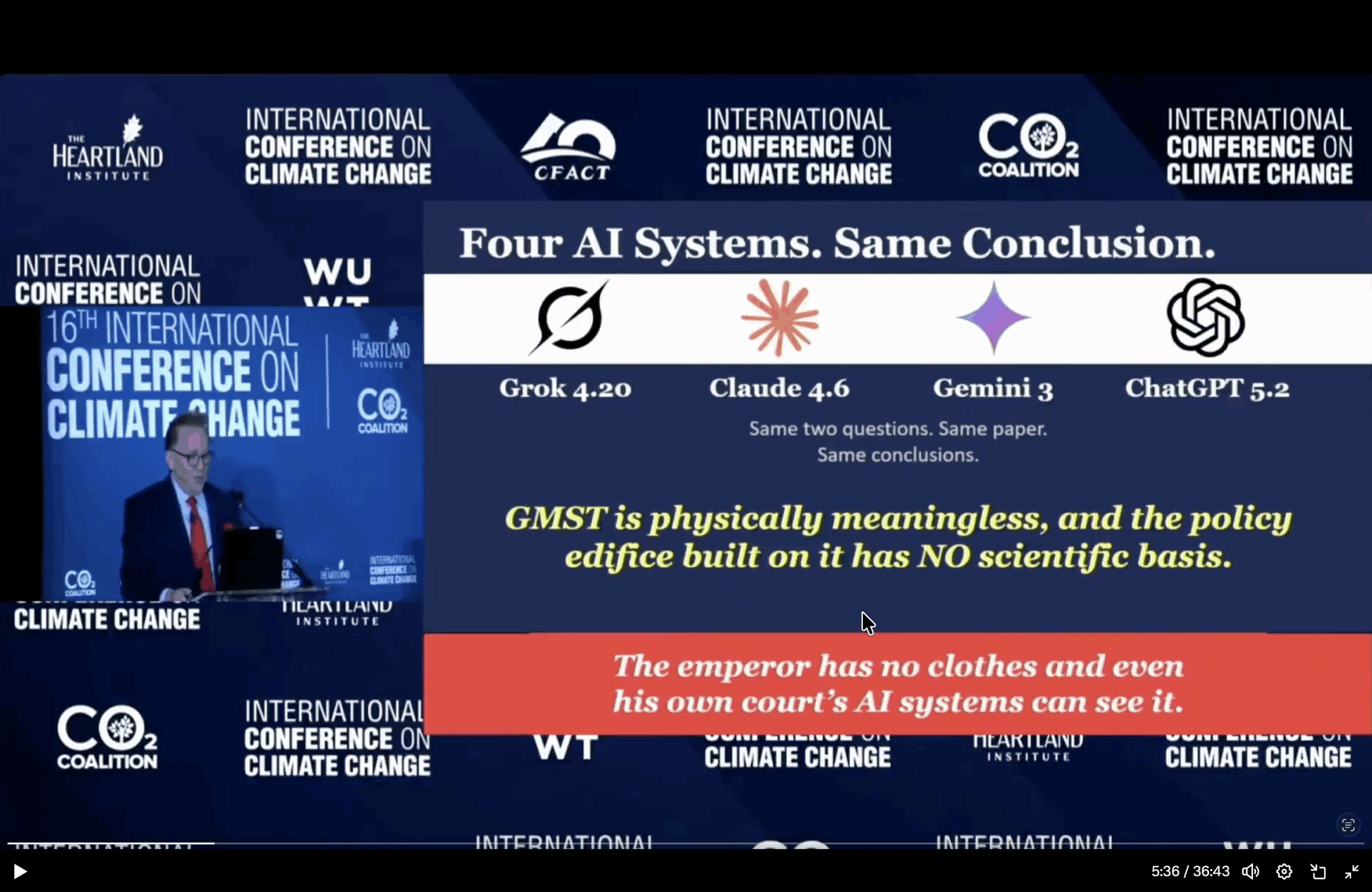

Die Internationale Organisation für Normung konnte keine globale Durchschnittstemperatur definieren, da diese den metrologischen Anforderungen nicht genügt. Vier verschiedene KI-Systeme, denen die mathematischen Argumente vorgelegt wurden, kamen unabhängig voneinander zum selben Ergebnis. Der Kaiser ist nackt – und selbst die Werkzeuge, die sein Hof zu seinem Schutz geschaffen hat, erkennen es.

Seit 38 Jahren wurde auf diesen Kennzahlen eine gewaltige wissenschaftliche und politische Infrastruktur aufgebaut. Billionen von Dollar an Ausgaben wurden damit gerechtfertigt. Karrieren, Institutionen und internationale Abkommen hängen von ihnen ab. Sie in Frage zu stellen, wurde als Ketzerei behandelt.

Doch die Physik verhandelt nicht. Eine Zahl ohne physikalische Bedeutung erhält diese nicht, nur weil einflussreiche Personen sie für nützlich halten. Eine Messung, die sich nicht von Null unterscheidet, wird nicht zum Beweis einer Krise, nur weil ein Satellit entsprechend justiert wurde. Ein Modell, das durch sechzig Jahre Atombomben-Kohlenstoffdaten widerlegt wurde, wird nicht gültig, nur weil es zehntausendmal zitiert wurde.

Die Arbeit ist getan. Die Artikel sind veröffentlicht. Die mathematischen Grundlagen stehen jedem zur Verfügung, der sie untersuchen möchte. Die Frage ist nun nicht wissenschaftlicher Natur. Es geht vielmehr darum, ob die Institutionen, die ihre Macht auf diesen Zahlen aufgebaut haben, endlich anerkennen werden, was die Physik ihnen seit jeher zu sagen versucht.

Der Kaiser ist nackt. Das war schon immer so. Und es ist längst überfällig, das auszusprechen.

Der Vortrag „Des Kaisers neue Kleider“ wurde auf der 16. Internationalen Klimakonferenz in Washington DC am 8. und 9. April 2026 gehalten

Der Beitrag Der Kaiser ist nackt: Wie der IPCC ein 38-jähriges Klimaimperium auf einem Lügengebäude errichtete erschien zuerst auf EIKE - Europäisches Institut für Klima & Energie.